《Perceptual Losses for Real-Time Style Transfer and Super-Resolution》论文笔记

参考 http://blog.csdn.net/u011534057/article/details/55052304

代码 https://github.com/yusuketomoto/chainer-fast-neuralstyle

出处

2016 · european conference on computer vision

Motivation

研究Image transfomation的方法。有别于现有的typically train feed-forward convolutional neural networks using a per-pixel loss between the output and ground-truth images,本文使用基于perceptual loss的方式来提取特征,生成风格转换图片和高分辨率图片

Introduction

章节开始介绍了Image transformation的定义和一些work,简单地说喂一张图片,吐一张不同的图片即是。举例说明perceptual loss相对于per-pixel loss的优势,两张几乎一样的图片会因为一个像素点的偏差导致per-pixel loss完全不同,但在感官层面,是没有区别的,这显然使得像素级的损失函数不太科学了。现有的工作已经开始用perceptual loss 来抽取视觉特征生成高质量图片,但速度非常缓慢。该文的模型在Image transformation方面能生成和[1]效果大致相仿的高质量图片,并在速度上快了3个数量级,在重建分辨率方面,能有4倍到8倍的分辨率提升。

Related work

1.各种基于per-pixel的Feed-forward image transformation work

2.Perceptual optimization.

3.Style Transfer.

4.Image super-resolution.

Method

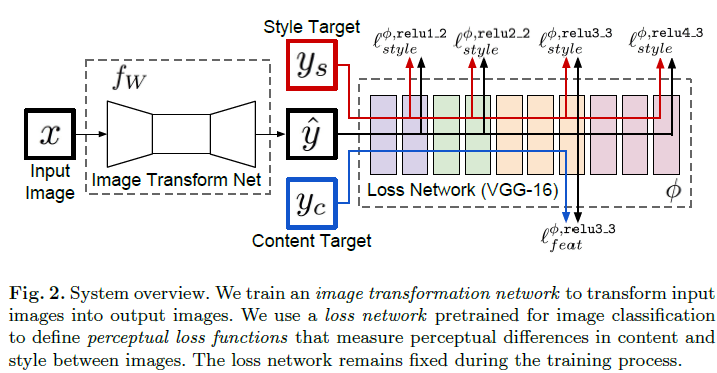

整个模型系统框架如下所示:

模型分为两个部分

Image transformation networks $f_w$ 和 loss network(vgg-16 pretrained on Imagenet) $\phi$

- Image Transformation

a deep residual convolutional neural network parameterized by weights $W$,使用映射 将输入的Image $X$映射成

将输入的Image $X$映射成 。Image Transformation的网络架构基本上基于DCGAN模型并使用了5个残差网络层。因 为整个网络是全卷积网络,所以在test-time输入可以是任意大小的图片。

。Image Transformation的网络架构基本上基于DCGAN模型并使用了5个残差网络层。因 为整个网络是全卷积网络,所以在test-time输入可以是任意大小的图片。

对Transform network来说,优化目标为

- Loss network

经过预训练的Loss network在整个训练过程中保持超参数不变。 在$\phi$中定义了一堆loss 函数$l_1,l_2...$,每一个loss function计算了 ,即映射输出的图片

,即映射输出的图片 和target image $y_i$的loss

和target image $y_i$的loss

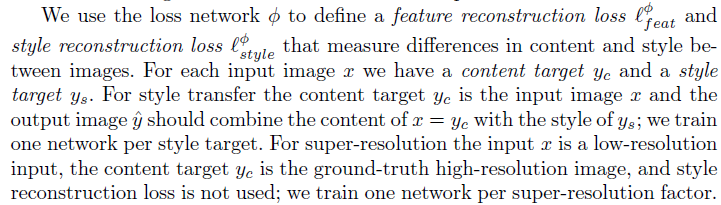

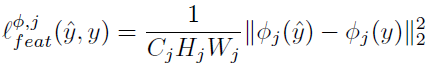

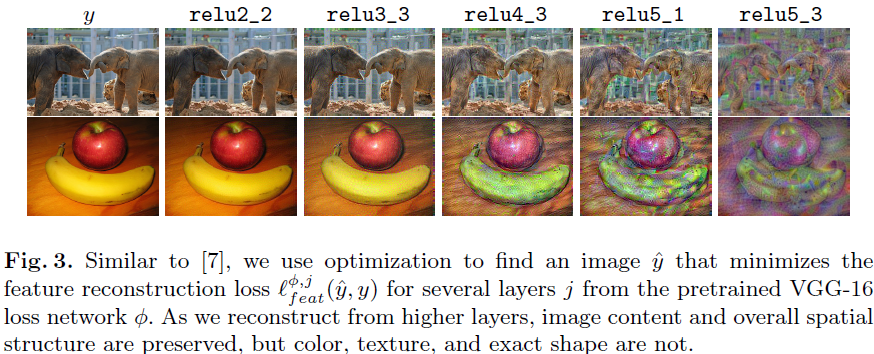

同时,作者定义了两种Perceptual Loss Functions,Feature Reconstruction Loss 和Style Reconstruction Loss

perceptual loss:  保证了在feature层面上生成图片和原图片保持一致

保证了在feature层面上生成图片和原图片保持一致

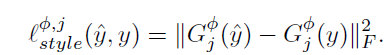

Style Loss:在feature层面保证了生成图片和风格图片的一直

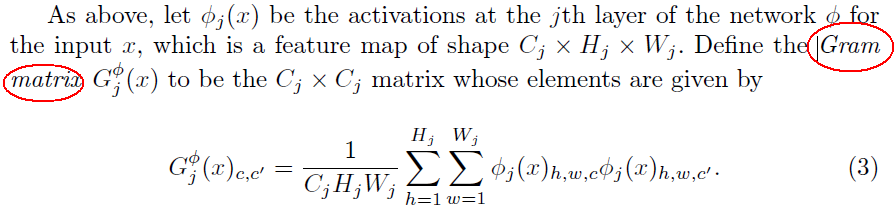

构建了一个Gram矩阵,即$i$通道的feature map与$j$通道的feature map进行内积,用以衡量两个feature map之间的差异度,从而可以从两张图的Gam矩阵入手,构建loss函数:

两张图的size即使完全不一致也可以计算出该style loss,因为Gram矩阵计算时基于的是卷积层的feature map的总差异。

[1]Gatys, L.A., Ecker, A.S., Bethge, M.: A neural algorithm of artistic style. arXiv preprint arXiv:1508.06576 (2015)

[2]Gatys, L.A., Ecker, A.S., Bethge, M.: Texture synthesis using convolutional neuralnetworks. In: NIPS. (2015)

《Perceptual Losses for Real-Time Style Transfer and Super-Resolution》论文笔记的更多相关文章

- 《Vision Permutator: A Permutable MLP-Like ArchItecture For Visual Recognition》论文笔记

论文题目:<Vision Permutator: A Permutable MLP-Like ArchItecture For Visual Recognition> 论文作者:Qibin ...

- [place recognition]NetVLAD: CNN architecture for weakly supervised place recognition 论文翻译及解析(转)

https://blog.csdn.net/qq_32417287/article/details/80102466 abstract introduction method overview Dee ...

- 论文笔记系列-Auto-DeepLab:Hierarchical Neural Architecture Search for Semantic Image Segmentation

Pytorch实现代码:https://github.com/MenghaoGuo/AutoDeeplab 创新点 cell-level and network-level search 以往的NAS ...

- 论文笔记——Rethinking the Inception Architecture for Computer Vision

1. 论文思想 factorized convolutions and aggressive regularization. 本文给出了一些网络设计的技巧. 2. 结果 用5G的计算量和25M的参数. ...

- 论文笔记:Fast Neural Architecture Search of Compact Semantic Segmentation Models via Auxiliary Cells

Fast Neural Architecture Search of Compact Semantic Segmentation Models via Auxiliary Cells 2019-04- ...

- 论文笔记:ProxylessNAS: Direct Neural Architecture Search on Target Task and Hardware

ProxylessNAS: Direct Neural Architecture Search on Target Task and Hardware 2019-03-19 16:13:18 Pape ...

- 论文笔记:DARTS: Differentiable Architecture Search

DARTS: Differentiable Architecture Search 2019-03-19 10:04:26accepted by ICLR 2019 Paper:https://arx ...

- 论文笔记:Progressive Neural Architecture Search

Progressive Neural Architecture Search 2019-03-18 20:28:13 Paper:http://openaccess.thecvf.com/conten ...

- 论文笔记:Auto-DeepLab: Hierarchical Neural Architecture Search for Semantic Image Segmentation

Auto-DeepLab: Hierarchical Neural Architecture Search for Semantic Image Segmentation2019-03-18 14:4 ...

- 论文笔记系列-DARTS: Differentiable Architecture Search

Summary 我的理解就是原本节点和节点之间操作是离散的,因为就是从若干个操作中选择某一个,而作者试图使用softmax和relaxation(松弛化)将操作连续化,所以模型结构搜索的任务就转变成了 ...

随机推荐

- 最长回文(hdu 3068)

Problem Description 给出一个只由小写英文字符a,b,c...y,z组成的字符串S,求S中最长回文串的长度.回文就是正反读都是一样的字符串,如aba, abba等 Input 输入有 ...

- 【NOIP模拟】数字对(RMQ,二分)

题意:小H是个善于思考的学生,现在她又在思考一个有关序列的问题. 她的面前浮现出一个长度为n的序列{ai},她想找出一段区间[L, R](1 <= L <= R <= n). 这个特 ...

- Codeforces 848C (cdq分治)

Codeforces 848C Goodbye Souvenir Problem : 给一个长度为n的序列,有q个询问.一种询问是修改某个位置的数,另一种询问是询问一段区间,对于每一种值出现的最右端点 ...

- Markdown编辑器及语法

dillinger 漂亮强大,支持md, html, pdf 文件导出.支持dropbox, onedrive,google drive, github. 来自国外,可能不够稳定. MaHua 小众软 ...

- PAT (Advanced Level) 1032. Sharing (25)

简单题,不过数据中好像存在有环的链表...... #include<iostream> #include<cstring> #include<cmath> #inc ...

- RedirectAttributes

RedirectAttributes是Spring mvc 3.1版本之后出来的一个功能,专门用于重定向之后还能带参数跳转的 他有两种带参的方式: 第一种: attr.addAttribute(&q ...

- 洛谷——P3353 在你窗外闪耀的星星

P3353 在你窗外闪耀的星星 题目描述 飞逝的的时光不会模糊我对你的记忆.难以相信从我第一次见到你以来已经过去了3年.我仍然还生动地记得,3年前,在美丽的集美中学,从我看到你微笑着走出教室,你将头向 ...

- maven 新建项目时修改默认jre路径

新建maven项目时,JRE System Library默认为J2SE-1.5 如果想修改为1.7,修改maven的settings.xml ,在profiles中添加 <profile> ...

- 重载和重写在jvm运行中的区别(一)

1.重载(overload)方法 对重载方法的调用主要看静态类型,静态类型是什么类型,就调用什么类型的参数方法. 2.重写(override)方法 对重写方法的调用主要看实际类型.实际类型如果实现了该 ...

- 3.将maven项目jar纳入maven仓库,Mave项目依赖另外一个Maven项目的案例

1 若想让maven项目依赖另外一个maven项目.被依赖的项目要在maven仓库中有对应的jar包,所以要对依赖的项目运行mvninstall命令. 2 新建第二个项目模块HelloFrien ...