PyTorch模型读写、参数初始化、Finetune

使用了一段时间PyTorch,感觉爱不释手(0-0),听说现在已经有C++接口。在应用过程中不可避免需要使用Finetune/参数初始化/模型加载等。

模型保存/加载

1.所有模型参数

训练过程中,有时候会由于各种原因停止训练,这时候我们训练过程中就需要注意将每一轮epoch的模型保存(一般保存最好模型与当前轮模型)。一般使用pytorch里面推荐的保存方法。该方法保存的是模型的参数。

#保存模型到checkpoint.pth.tar

torch.save(model.module.state_dict(), ‘checkpoint.pth.tar’)对应的加载模型方法为(这种方法需要先反序列化模型获取参数字典,因此必须先load模型,再load_state_dict):

mymodel.load_state_dict(torch.load(‘checkpoint.pth.tar’))有了上面的保存后,现以一个例子说明如何在inference AND/OR resume train使用。

#保存模型的状态,可以设置一些参数,后续可以使用

state = {'epoch': epoch + 1,#保存的当前轮数

'state_dict': mymodel.state_dict(),#训练好的参数

'optimizer': optimizer.state_dict(),#优化器参数,为了后续的resume

'best_pred': best_pred#当前最好的精度

,....,...}

#保存模型到checkpoint.pth.tar

torch.save(state, ‘checkpoint.pth.tar’)

#如果是best,则复制过去

if is_best:

shutil.copyfile(filename, directory + 'model_best.pth.tar')

checkpoint = torch.load('model_best.pth.tar')

model.load_state_dict(checkpoint['state_dict'])#模型参数

optimizer.load_state_dict(checkpoint['optimizer'])#优化参数

epoch = checkpoint['epoch']#epoch,可以用于更新学习率等

#有了以上的东西,就可以继续重新训练了,也就不需要担心停止程序重新训练。

train/eval

....

....上面是pytorch建议使用的方法,当然还有第二种方法。这种方法灵活性不高,不推荐。

#保存

torch.save(mymodel,‘checkpoint.pth.tar’)

#加载

mymodel = torch.load(‘checkpoint.pth.tar’)2.部分模型参数

在很多时候,我们加载的是已经训练好的模型,而训练好的模型可能与我们定义的模型不完全一样,而我们只想使用一样的那些层的参数。

有几种解决方法:

(1)直接在训练好的模型开始搭建自己的模型,就是先加载训练好的模型,然后再它基础上定义自己的模型;

model_ft = models.resnet18(pretrained=use_pretrained)

self.conv1 = model_ft.conv1

self.bn = model_ft.bn

... ...(2) 自己定义好模型,直接加载模型

#第一种方法:

mymodelB = TheModelBClass(*args, **kwargs)

# strict=False,设置为false,只保留键值相同的参数

mymodelB.load_state_dict(model_zoo.load_url(model_urls['resnet18']), strict=False)

#第二种方法:

# 加载模型

model_pretrained = models.resnet18(pretrained=use_pretrained)

# mymodel's state_dict,

# 如: conv1.weight

# conv1.bias

mymodelB_dict = mymodelB.state_dict()

# 将model_pretrained的建与自定义模型的建进行比较,剔除不同的

pretrained_dict = {k: v for k, v in model_pretrained.items() if k in mymodelB_dict}

# 更新现有的model_dict

mymodelB_dict.update(pretrained_dict)

# 加载我们真正需要的state_dict

mymodelB.load_state_dict(mymodelB_dict)

# 方法2可能更直观一些参数初始化

第二个问题是参数初始化问题,在很多代码里面都会使用到,毕竟不是所有的都是有预训练参数。这时就需要对不是与预训练参数进行初始化。pytorch里面的每个Tensor其实是对Variabl的封装,其包含data、grad等接口,因此可以用这些接口直接赋值。这里也提供了怎样把其他框架(caffe/tensorflow/mxnet/gluonCV等)训练好的模型参数直接赋值给pytorch.其实就是对data直接赋值。

pytorch提供了初始化参数的方法:

def weight_init(m):

if isinstance(m,nn.Conv2d):

n = m.kernel_size[0] * m.kernel_size[1] * m.out_channels

m.weight.data.normal_(0,math.sqrt(2./n))

elif isinstance(m,nn.BatchNorm2d):

m.weight.data.fill_(1)

m.bias.data.zero_()但一般如果没有很大需求初始化参数,也没有问题(不确定性能是否有影响的情况下),pytorch内部是有默认初始化参数的。

Fintune

最后就是精调了,我们平时做实验,至少backbone是用预训练的模型,将其用作特征提取器,或者在它上面做精调。

用于特征提取的时候,要求特征提取部分参数不进行学习,而pytorch提供了requires_grad参数用于确定是否进去梯度计算,也即是否更新参数。以下以minist为例,用resnet18作特征提取:

#加载预训练模型

model = torchvision.models.resnet18(pretrained=True)

#遍历每一个参数,将其设置为不更新参数,即不学习

for param in model.parameters():

param.requires_grad = False

# 将全连接层改为mnist所需的10类,注意:这样更改后requires_grad默认为True

model.fc = nn.Linear(512, 10)

# 优化

optimizer = optim.SGD(model.fc.parameters(), lr=1e-2, momentum=0.9) 用于全局精调时,我们一般对不同的层需要设置不同的学习率,预训练的层学习率小一点,其他层大一点。这要怎么做呢?

# 加载预训练模型

model = torchvision.models.resnet18(pretrained=True)

model.fc = nn.Linear(512, 10)

# 参考:https://blog.csdn.net/u012759136/article/details/65634477

ignored_params = list(map(id, model.fc.parameters()))

base_params = filter(lambda p: id(p) not in ignored_params, model.parameters())

# 对不同参数设置不同的学习率

params_list = [{'params': base_params, 'lr': 0.001},]

params_list.append({'params': model.fc.parameters(), 'lr': 0.01})

optimizer = torch.optim.SGD(params_list,

0.001,

momentum=args.momentum,

weight_decay=args.weight_decay)最后整理一下目前,pytorch预训练的基础模型:

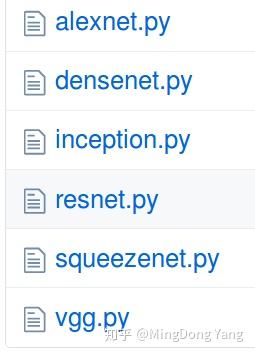

(1)torchvision

torchvision里面已经提供了不同的预训练模型,一般也够用了。

包含了alexnet/densenet各种版本(densenet121/densenet169/densenet201/densenet161)/inception_v3/resnet各种版本(resnet18', 'resnet34', 'resnet50', 'resnet101','resnet152')/SqueezeNet各种版本( 'squeezenet1_0', 'squeezenet1_1')/VGG各种版本( 'vgg11', 'vgg11_bn', 'vgg13', 'vgg13_bn', 'vgg16', 'vgg16_bn','vgg19_bn', 'vgg19')

(2)其他预训练好的模型,如,SENet/NASNet等。

Cadene/pretrained-models.pytorchgithub.com

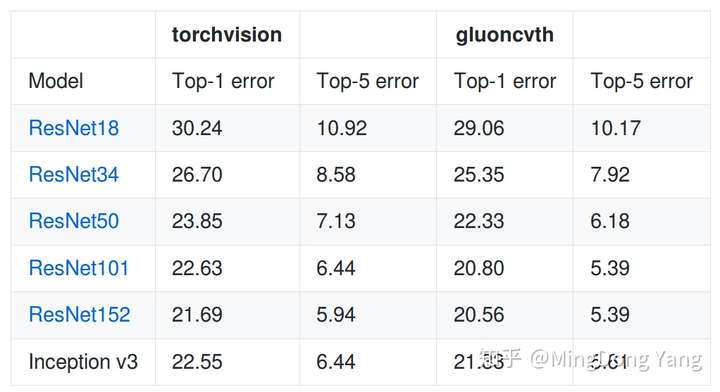

(3)gluonCV转pytorch的模型,包括,分类网络,分割网络等,这里的精度均比其他框架高几个百分点。

zhanghang1989/gluoncv-torchgithub.com

PyTorch模型读写、参数初始化、Finetune的更多相关文章

- [PyTorch]PyTorch中模型的参数初始化的几种方法(转)

~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~~ 本文目录 1. xavier初始化 2. kaiming初始化 3. 实际使用中看到的初始化 3.1 ResNeXt,de ...

- Pytorch基础(6)----参数初始化

一.使用Numpy初始化:[直接对Tensor操作] 对Sequential模型的参数进行修改: import numpy as np import torch from torch import n ...

- pytorch对模型参数初始化

1.使用apply() 举例说明: Encoder :设计的编码其模型 weights_init(): 用来初始化模型 model.apply():实现初始化 # coding:utf- from t ...

- pytorch和tensorflow的爱恨情仇之参数初始化

pytorch和tensorflow的爱恨情仇之基本数据类型 pytorch和tensorflow的爱恨情仇之张量 pytorch和tensorflow的爱恨情仇之定义可训练的参数 pytorch版本 ...

- PyTorch常用参数初始化方法详解

1. 均匀分布 torch.nn.init.uniform_(tensor, a=0, b=1) 从均匀分布U(a, b)中采样,初始化张量. 参数: tensor - 需要填充的张量 a - 均匀分 ...

- 从零搭建Pytorch模型教程(四)编写训练过程--参数解析

前言 训练过程主要是指编写train.py文件,其中包括参数的解析.训练日志的配置.设置随机数种子.classdataset的初始化.网络的初始化.学习率的设置.损失函数的设置.优化方式的设置. ...

- 【转载】 pytorch自定义网络结构不进行参数初始化会怎样?

原文地址: https://blog.csdn.net/u011668104/article/details/81670544 ------------------------------------ ...

- ubuntu之路——day15.1 只用python的numpy在底层检验参数初始化对模型的影响

首先感谢这位博主整理的Andrew Ng的deeplearning.ai的相关作业:https://blog.csdn.net/u013733326/article/details/79827273 ...

- DEX-6-caffe模型转成pytorch模型办法

在python2.7环境下 文件下载位置:https://data.vision.ee.ethz.ch/cvl/rrothe/imdb-wiki/ 1.可视化模型文件prototxt 1)在线可视化 ...

随机推荐

- vue + iview 怎样在vue项目下添加ESLint

参考:https://segmentfault.com/a/1190000012019019?utm_source=tag-newest 使用iview框架的MenuGroup标签,vscode报红, ...

- C#多线程---I/O线程实现异步请求

一.场景 利用I/O线程来模拟浏览器对服务器请求的异步操作. 二.例子 1 using System; 2 using System.Collections.Generic; 3 using Syst ...

- Ant的使用(一)

<?xml version="1.0" encoding="UTF-8"?> <project name="projectName& ...

- JDBC基础篇(MYSQL)——使用statement执行DML语句(insert/update/delete)

注意:其中的JdbcUtil是我自定义的连接工具类:代码例子链接: package day02_statement; import java.sql.Connection; import java.s ...

- 微信小程序学习笔记五 常见组件

1. 常见组件 重点讲解小程序中常用的布局组件 1.1 view 代替 原来的div标签 <!-- pages/index/index.wxml --> <view hover-cl ...

- Gradient checking

所需文件:本地下载 Gradient Checking Welcome to the final assignment for this week! In this assignment you wi ...

- myScript调研,电子手写板使用,纯干货

第二天进公司,就叫我调研myScript作为手写板的可行性,又不能不做,哎~ myScript效果十分的奈斯,前端用canvas手写的文字.数学字符,都可以识别然后转换,不知道myScript是不是你 ...

- go进阶--测试

目录 1.单元测试 1.1项目结构 1.2 源代码文件 1.3 单元测试 1.4 执行测试 1.5 单元测试总结 2.性能测试 2.1 项目结构 2.2 源码文件 2.3 测试文件 2.4 执行测试 ...

- redis 《scan命令》

此命令十分奇特建议参考文档:http://redisdoc.com/database/scan.html#scan 222222222222222并非每次迭代都要使用相同的 COUNT 值. ...

- Maven无法导入插件,pom文件报错

最近在使用IDEA导入开源项目bootshiro,更新依赖的时候,发现有些插件无法导入,以致于pom文件一直报找不到该插件的错误 一开始就网上各种百度,无论怎么更换阿里云的镜像都导不进,最后想着试试自 ...