Spark的checkpoint源码讲解

一、Checkpoint相关源码分为四个部分

1、Checkpoint的基本使用:spark_core & spark_streaming

2、初始化的源码

3、Checkpoint的job生成及执行的过程

4、读Checkpoint的过程

二、Checkpoint的基本使用

Checkpoint可以是还原药水。辅助Spark应用从故障中恢复。SparkStreaming宕机恢复,适合调度器有自动重试功能的。对于 SparkCore 则适合那些计算链条超级长或者计算耗时的

关键点进行 Checkpoint, 便于故障恢复 。

Checkpoint和persist从根本上是不一样的:

1、Cache or persist:

Cache or persist保存了RDD的血统关系,假如有部分cache的数据丢失可以根据血缘关系重新生成。

2、Checkpoint

会将RDD数据写到hdfs这种安全的文件系统里面,并且抛弃了RDD血缘关系的记录。即使persist存储到了磁盘里面,在driver停掉之后会被删除,而checkpoint可以被下次启动使用。

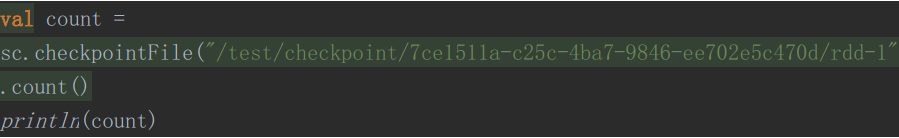

Checkpoint基本使用

对于spark_streaming的checkpoint:

spark streaming有一个单独的线程CheckpointWriteHandler,每generate一个batch interval的RDD数据都会触发checkpoint操作。对于kafka的DirectKafkaInputDStreamCheckpointData,实质是重写DStreamCheckpointData的update和restore方法,这样checkpoint的数据就是topic,partition,fromOffset和untilOffset。更多请参考源码例子RecoverableNetworkWordCount

对于spark_core的checkpoint:

docheckpoint:

recover:

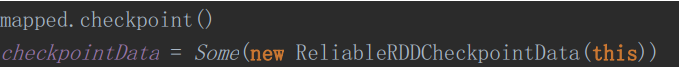

二、Checkpoint的初始化源码

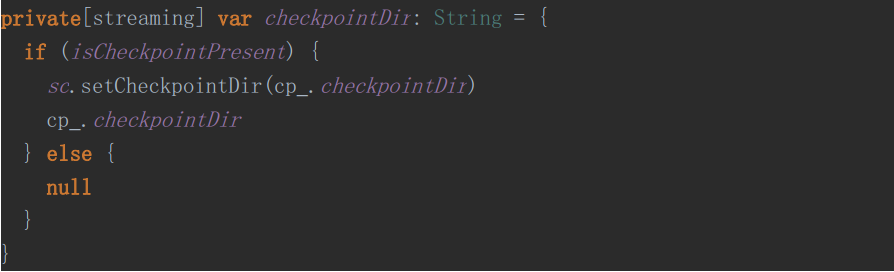

1、设置Checkpoint目录

2、调用Checkpoint方法,构建checkpointData

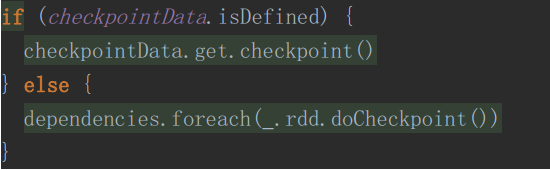

三、DoCheckpoint源码

在SparkContext的runjob方法中

进入之后

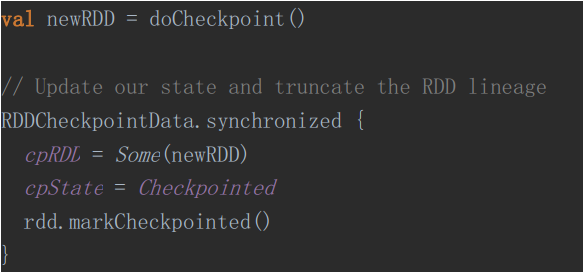

RDDCheckpointData中真正做Checkpoint返回一个新的RDD并清除掉依赖关系

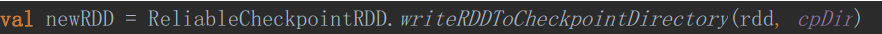

ReliableRDDCheckpointData中真正进行Checkpoint操作

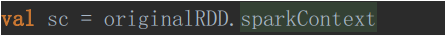

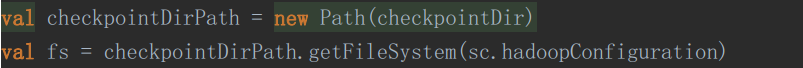

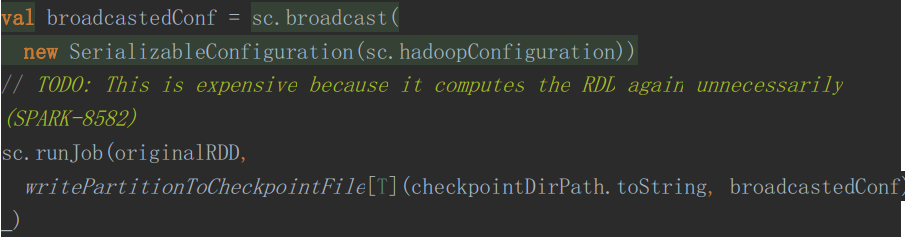

在该方法中

1、获取sc

2、创建输出目录

3、以Job的方式进行Checkpoint操作

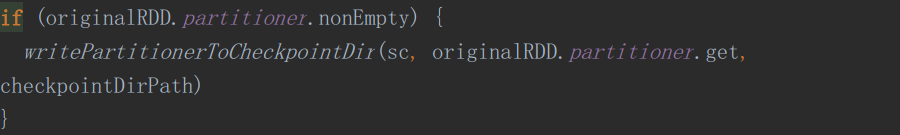

4、将分区策略写入Checkpoint目录

四、读取Checkpoint数据

三个方法:

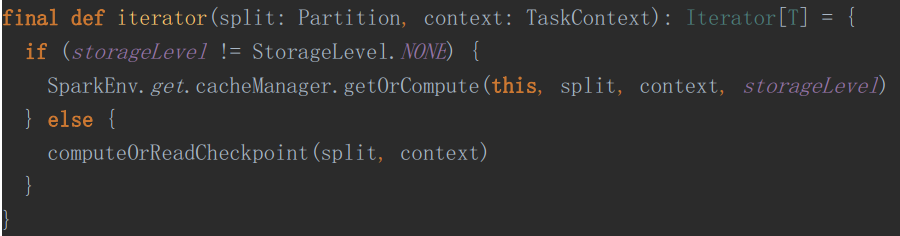

1、同一个Spark任务,共有了Checkpoint的RDD,在该RDD的iterator方法中

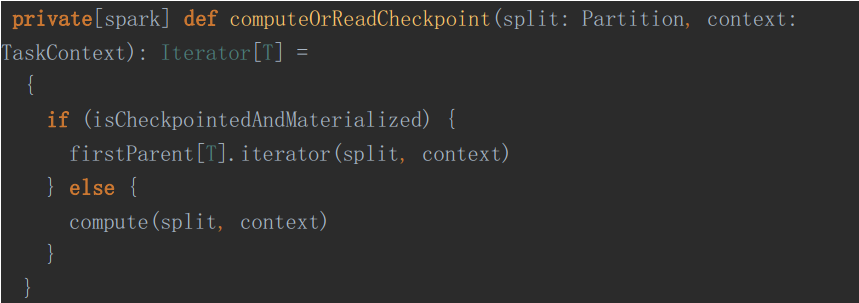

进入 computeOrReadCheckpoint

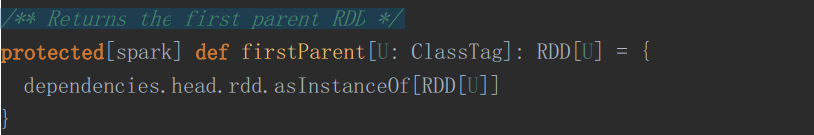

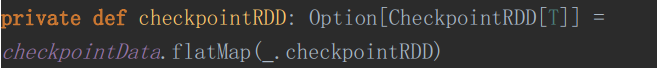

如果进行了 Checkpoint, 条件为真firstParent[T].iterator(split, context)其中, firstParent 为

/** Returns the first parent RDD */

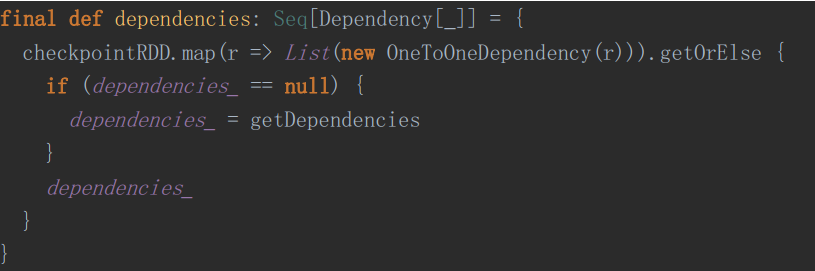

接着是获取依赖

假如进行了Checkpoint,那么CheckpointRDD就是存在

在初始化Checkpoint的时候,我们已经初始化了CheckpointData了。

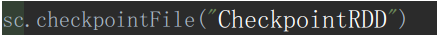

2、RDD的计算链条失败,主动去读Checkpoint文件的过程

这个要求我们的入口类在下面这个包

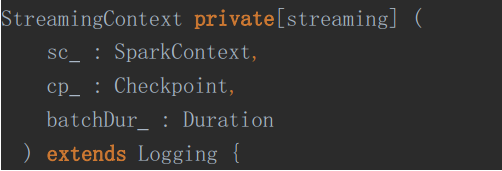

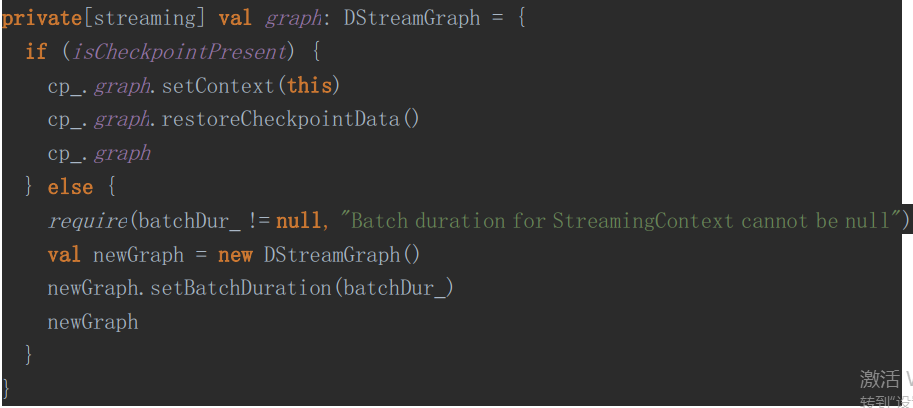

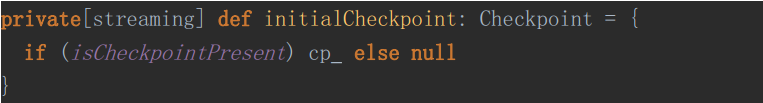

3、SparkStreaming的故障恢复

首先,看一下SteamingContext的需要

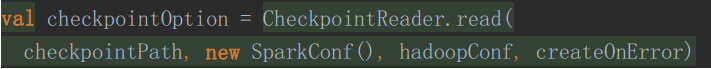

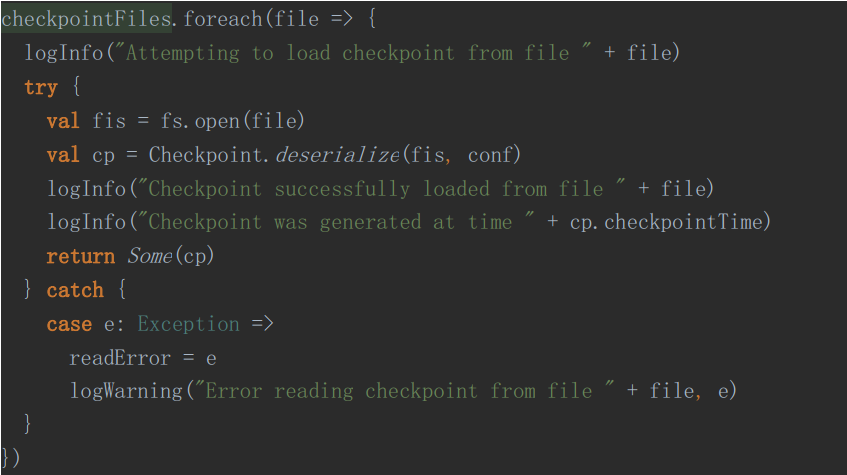

然后去读取Checkpoint

分两个步骤:

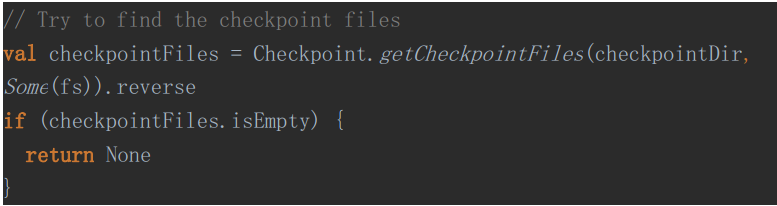

A、获取最新的Checkpoint目录

B、迭代找到最新的Checkpoint就返回

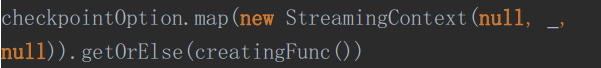

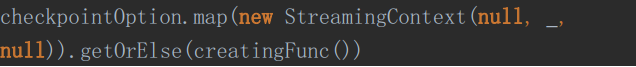

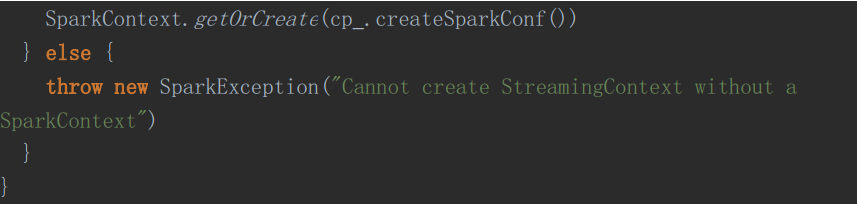

最后就是使用获取的Checkpoint去构建ssc

主要是做了一下动作

Spark的checkpoint源码讲解的更多相关文章

- Qt5.5.0使用mysql编写小软件源码讲解---顾客信息登记表

Qt5.5.0使用mysql编写小软件源码讲解---顾客信息登记表 一个个人觉得比较简单小巧的软件. 下面就如何编写如何发布打包来介绍一下吧! 先下载mysql的库文件链接:http://files. ...

- 【原】Spark中Client源码分析(二)

继续前一篇的内容.前一篇内容为: Spark中Client源码分析(一)http://www.cnblogs.com/yourarebest/p/5313006.html DriverClient中的 ...

- 【原】Spark中Master源码分析(二)

继续上一篇的内容.上一篇的内容为: Spark中Master源码分析(一) http://www.cnblogs.com/yourarebest/p/5312965.html 4.receive方法, ...

- 【原】 Spark中Worker源码分析(二)

继续前一篇的内容.前一篇内容为: Spark中Worker源码分析(一)http://www.cnblogs.com/yourarebest/p/5300202.html 4.receive方法, r ...

- 源码讲解 node+mongodb 建站攻略(一期)第二节

源码讲解 node+mongodb 建站攻略(一期)第二节 上一节,我们完成了模拟数据,这次我们来玩儿真正的数据库,mongodb. 代码http://www.imlwj.com/download/n ...

- Spark Scheduler模块源码分析之TaskScheduler和SchedulerBackend

本文是Scheduler模块源码分析的第二篇,第一篇Spark Scheduler模块源码分析之DAGScheduler主要分析了DAGScheduler.本文接下来结合Spark-1.6.0的源码继 ...

- Spark Scheduler模块源码分析之DAGScheduler

本文主要结合Spark-1.6.0的源码,对Spark中任务调度模块的执行过程进行分析.Spark Application在遇到Action操作时才会真正的提交任务并进行计算.这时Spark会根据Ac ...

- Spark RPC框架源码分析(一)简述

Spark RPC系列: Spark RPC框架源码分析(一)运行时序 Spark RPC框架源码分析(二)运行时序 Spark RPC框架源码分析(三)运行时序 一. Spark rpc框架概述 S ...

- Spark RPC框架源码分析(二)RPC运行时序

前情提要: Spark RPC框架源码分析(一)简述 一. Spark RPC概述 上一篇我们已经说明了Spark RPC框架的一个简单例子,Spark RPC相关的两个编程模型,Actor模型和Re ...

随机推荐

- Robot Framework+adb框架自动化测试Android设备案例⑸——L1层测试用例

一.L1层测试用例 1.初始化.robot *** Settings *** Resource ../L2层关键字.robot *** Test Cases *** 切换EMMC模式 [Tags] A ...

- 算法——1~n 整数中 1 出现的次数

输入一个整数 n ,求1-n这n个整数的十进制表示中1出现的次数. 例如,输入12,1-12这些整数中包含1 的数字有1.10.11和12,1一共出现了5次. leetcode 解题思路:依次遍历每一 ...

- 使用docker与宿主机文件互相拷贝

1.从容器里面拷文件到宿主机 示例:容器名为s2-061_struts2_1,要从容器里面拷贝的文件路为:/usr/local/tomcat/webapps/test/js/test.js, 现在要将 ...

- postgresql修改postgres用户密码

[postgres@pg01 ~]$ psql -Upostgres -dpostgres postgres=# alter user postgres with password 'postgres ...

- Java 8 新特性:日期处理

1. Java 8 日期处理新特性 Java 8基于ISO标准日期系统,提供了java.time包来处理时间日期,且该包下的所有类都是不可变类型而且线程安全. 2. 关键类 Instant:瞬时实 ...

- [日常摸鱼]HDU2157 How many ways??

hhh我又开始水题目了 题意:给一张有向图,多次询问一个点到另一个点刚好走$k$步的方案数取模,点数很小 每个$a,b,k$的询问直接把邻接矩阵$map$自乘$k$次后$map[a][b]$就是答案了 ...

- matplotlib的学习8-scatter散点图

import matplotlib.pyplot as plt import numpy as np n = 1024 # data size #生成1024个呈标准正太分布的二维数组(平均数为0,方 ...

- matplotlib的学习1-为什么学他

1.是一个非常强大的python画图的一个工具 2.手中有很多的数据,但是不知道如何呈现 matplotlib->能画出 线图; 散点图; 等高线图; 条形图; 柱状图; 3D 图形, 甚至是图 ...

- Redis史上最全文章教程

Redis 2020 史上最详细Redis教程 本篇文章并不讲解Redis,只是收集 Redis的优质文章教程 ,文章包含三部分: 理论.编程实战 .面试题. 需要有一定编程功底的人学习 ,如果基础不 ...

- pytorch固定BN层参数

背景:基于PyTorch的模型,想固定主分支参数,只训练子分支,结果发现在不同epoch相同的测试数据经过主分支输出的结果不同. 原因:未固定主分支BN层中的running_mean和running_ ...