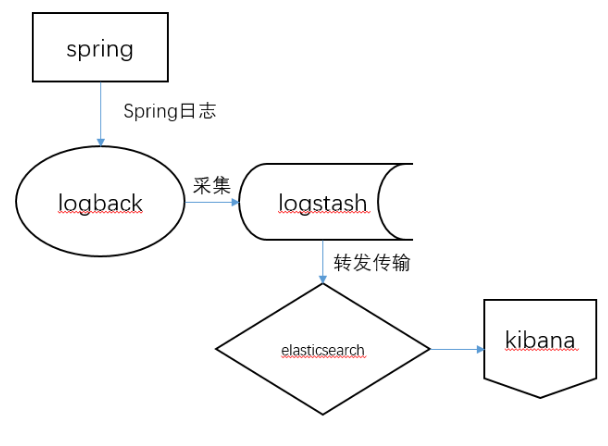

spring与logstash整合,并将数据传输到Elasticsearch

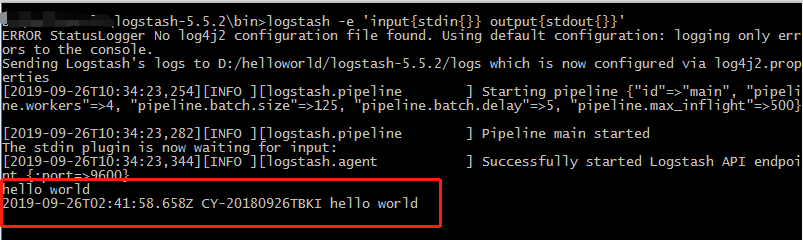

启动以后,在光标处输入:hello wrold

在这个过程里,涉及到几个概念,logstash是一个管道,里面有两个input和output的必选元素,即输入与输出,之间还可以有一个可选的过滤器filter过滤器。input插件从源头获取到数据,过滤器会根据条件来进行修改,最后通过ouput插件将数据传输,可输出给Elasticsearch、kafka、file

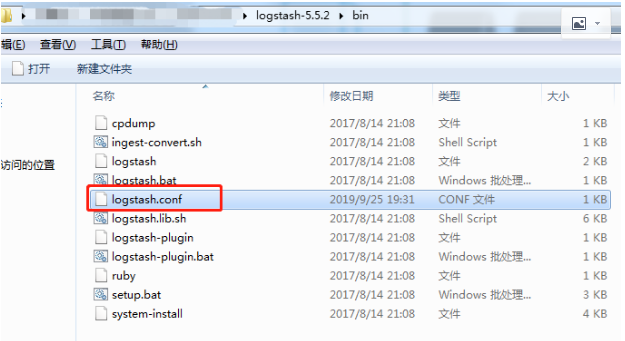

input { stdin { } }#该行可有可无

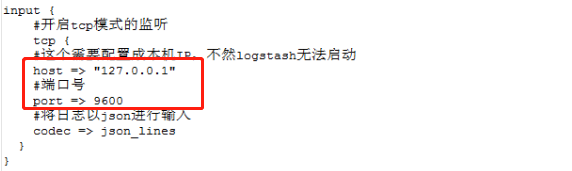

input {

#开启tcp插件的监听

tcp {

#这个需要配置成本机IP,不然logstash无法启动

host => "127.0.0.1"

#端口号

port => 9600

#将日志以json格式输入

codec => json_lines

}

}

output {

#输出打印

stdout { codec => rubydebug }

}

<dependency>

<groupId>ch.qos.logback</groupId>

<artifactId>logback-classic</artifactId>

<version>1.2.3</version>

</dependency>

<dependency>

<groupId>ch.qos.logback</groupId>

<artifactId>logback-core</artifactId>

<version>1.2.3</version>

</dependency>

<dependency>

<groupId>ch.qos.logback</groupId>

<artifactId>logback-access</artifactId>

<version>1.2.3</version>

</dependency>

<dependency>

<groupId>net.logstash.log4j</groupId>

<artifactId>jsonevent-layout</artifactId>

<version>1.6</version>

</dependency>

<dependency>

<groupId>net.logstash.logback</groupId>

<artifactId>logstash-logback-encoder</artifactId>

<version>5.0</version>

</dependency>

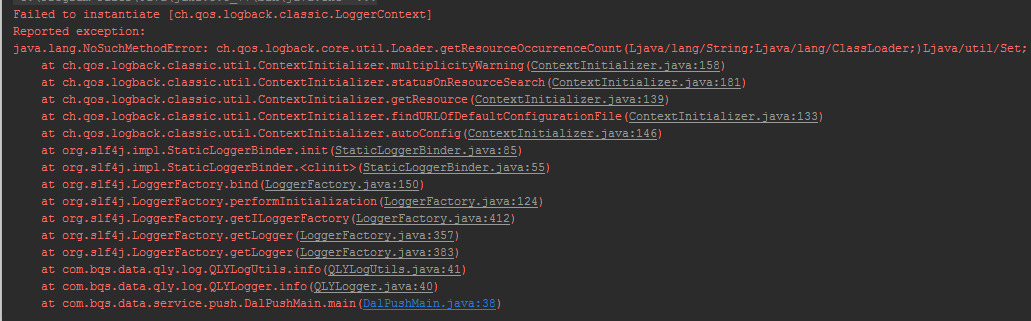

如果引用到的ch.qos.logback依赖版本太低的话,可能会出现以下错误:

可以根据项目需求来选择合适的版本,经过测试,以上的1.2.3版本是可以符合要求的。

<!--logstash配置-->

<!--开启tcp格式的logstash传输,通过TCP协议连接Logstash-->

<appender name="STASH" class="net.logstash.logback.appender.LogstashTcpSocketAppender">

<destination>127.0.0.1:9600</destination>

<encoder class="net.logstash.logback.encoder.LoggingEventCompositeJsonEncoder">

<jsonFactoryDecorator class="net.logstash.logback.decorate.CharacterEscapesJsonFactoryDecorator">

<escape>

<targetCharacterCode>10</targetCharacterCode>

<escapeSequence>\u2028</escapeSequence>

</escape>

</jsonFactoryDecorator>

<providers>

<pattern>

<pattern>

{

"timestamp":"%date{ISO8601}",

"user":"test",

"message":"[%d{yyyy-MM-dd HH:mm:ss.SSS}][%p][%t][%l{80}|%L]%m"}%n

}

</pattern>

</pattern>

</providers>

</encoder>

<keepAliveDuration>5 minutes</keepAliveDuration>

</appender>

<root level="INFO">

<appender-ref ref="STASH"/>

</root>

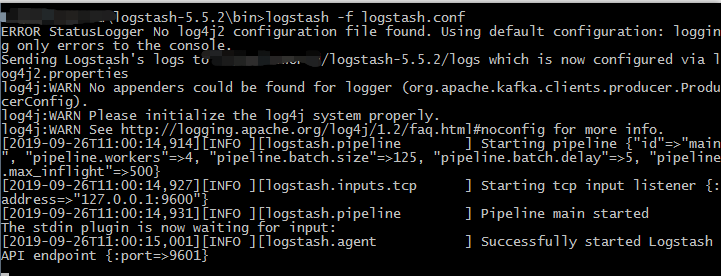

配置完成后,启动spring项目,这时原来监听tcp的logstash就可以实时监听接收到了数据,logstash的控制台显示打印如下:

若要监听到的是ERROR级别的日志,在logback.xml里的logstash配置里的appender里添加一行以下代码即可:

<filter class="ch.qos.logback.classic.filter.ThresholdFilter">

<level>ERROR</level>

</filter>

<root level="INFO">

<appender-ref ref="STASH"/>

<appender-ref ref="ERROR"/>

</root>

input { stdin { } }#该行可有可无

input {

#开启tcp模式的监听

tcp {

#这个需要配置成本机IP,不然logstash无法启动

host => "127.0.0.1"

#端口号

port => 9600

#将日志以json格式输入

codec => json_lines

}

}

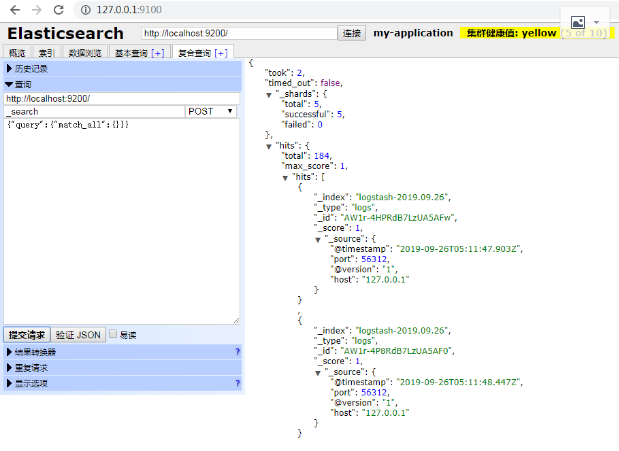

output {

#输出打印

stdout { codec => rubydebug }

elasticsearch { hosts => ["127.0.0.1:9200"] }

}

出处:https://www.cnblogs.com/zhujiqian/

本文版权归作者和博客园共有。欢迎转载,但必须保留此段声明,且在文章页面明显位置给出原文连接!

spring与logstash整合,并将数据传输到Elasticsearch的更多相关文章

- 轻量级Java EE企业应用实战(第4版):Struts 2+Spring 4+Hibernate整合开发(含CD光盘1张)

轻量级Java EE企业应用实战(第4版):Struts 2+Spring 4+Hibernate整合开发(含CD光盘1张)(国家级奖项获奖作品升级版,四版累计印刷27次发行量超10万册的轻量级Jav ...

- Spring Security 3整合CAS 实现SSO

spring security 3整合cas client用于实现各Application之间的单点登录. 1. 需要准备的jar spring-security-core-3.0.8.RELEASE ...

- 1.springMVC+spring+Mybatis的整合思路

SSM整合的过程:就是把一些东西交给spring管理,也就是添加配置文件的一个过程.那么有哪些东西我们要交给spring管理呢?大概有以下几个: 1.数据源(可配置数据库连接池) 2.SqlSessi ...

- Spring+springmvc+Mybatis整合案例 annotation版(myeclipse)详细版

Spring+springmvc+Mybatis整合案例 Version:annotation版 文档结构图: 从底层开始做起: 01.配置web.xml文件 <?xml version=&qu ...

- Spring+springmvc+Mybatis整合案例 xml配置版(myeclipse)详细版

Spring+springmvc+Mybatis整合案例 Version:xml版(myeclipse) 文档结构图: 从底层开始做起: 01.配置web.xml文件 <?xml version ...

- Spring与Mybatis整合的MapperScannerConfigurer处理过程源码分析

前言 本文将分析mybatis与spring整合的MapperScannerConfigurer的底层原理,之前已经分析过java中实现动态,可以使用jdk自带api和cglib第三方库生成动态代理. ...

- Mybatis学习--spring和Mybatis整合

简介 在前面写测试代码的时候,不管是基于原始dao还是Mapper接口开发都有许多的重复代码,将spring和mybatis整合可以减少这个重复代码,通过spring的模板方法模式,将这些重复的代码进 ...

- Spring(八)SSH整合简述

一.Spring与Struts2的整合 1.1.整合步骤 1.2.配置web.xml 1.3.配置spring配置文件applicationContext.xml 1.4.配置struts配置文件 1 ...

- Spring学习6-Spring整合Struts2

一.Spring为什么要整合Struts2 Struts2与Spring进行整合的根本目的就是要让 Spring为Struts2的Action注入所需的资源对象,它们整合的原理则是只要导入了s ...

随机推荐

- 关于事务,事务的特性,spring事务的传播特性

1.什么是事务: 事务是程序中一系列严密的操作,所有操作执行必须成功完成,否则在每个操作所做的更改将会被撤销,这也是事务的原子性(要么成功,要么失败). 2.事务特性: 事务特性分为四个:原子性(At ...

- JS中 isNaN() 方法解析

1. isNaN() 存在的意义 由于 NaN 是唯一一个不等于自身的值,不像其他的值,可以用相等操作符来判断是否等于自身,NaN == NaN和NaN === NaN都会返回false,所以isNa ...

- python 18 re模块

目录 re 模块 1. 正则表达式 2. 匹配模式 3. 常用方法 re 模块 1. 正则表达式 \w 匹配字母(包含中文)或数字或下划线 \W 匹配非字母(包含中文)或数字或下划线 \s 匹配任意的 ...

- ionic app 优化三件套,让其更贴近原生app

这里推荐一个ionic大神的简书,里面有好多关于好多ionic的技术分享! http://www.jianshu.com/u/c2e637a941ef 捣鼓了好久的ionic,终于在优化过程终于有所进 ...

- Leetcode之深度优先搜索(DFS)专题-1080. 根到叶路径上的不足节点(Insufficient Nodes in Root to Leaf Paths)

Leetcode之深度优先搜索(DFS)专题-1080. 根到叶路径上的不足节点(Insufficient Nodes in Root to Leaf Paths) 这篇是DFS专题的第一篇,所以我会 ...

- Python Web Flask源码解读(三)——模板渲染过程

关于我 一个有思想的程序猿,终身学习实践者,目前在一个创业团队任team lead,技术栈涉及Android.Python.Java和Go,这个也是我们团队的主要技术栈. Github:https:/ ...

- 2019-04-23-Python爬取有声小说

目录 Python爬取有声小说 摘要 1.获取下载链接 2.分析规律,循环爬取 3.保存到本地,批量命名 4.界面设计 5.效果展示 Python爬取有声小说 通过python爬取网站的资源,实现批量 ...

- JavaScript img标签自带的onload和onerror函数

onload 加载完成时调用触发 原生: <img src="" alt="Park" onload=“handleImageLoaded()”/> ...

- Codeforces Round #465 &935C. Fifa and Fafa计算几何

传送门 题意:在平面中,有一个圆,有一个点,问能在这个圆中围出最大的圆的圆心坐标和半径.要求这个最大圆不包含这个点. 思路:比较基础的计算几何,要分三种情况,第一种就是这个点在圆外的情况.第二种是点在 ...

- 牛客-长沙理工校赛C-取手机

传送门:https://www.nowcoder.com/acm/contest/96/C 参考:http://www.cnblogs.com/Dillonh/p/8835074.html 题意: d ...