Hadoop学习笔记三

一、设置HDFS不进行权限检查

默认的HDFS上的文件类似于Linux中的文件,是有权限的。例如test用户创建的文件,root用户如果没有写权限,则不能进行删除。

有2种办法进行修改,修改文件的权限。或者设置不进行HDFS的权限检查,在hdfs-site.xml中添加:

<property>

<name>dfs.permissions</name>

<value>false</value>

</property>

二、启动HDFS和YARN的几种方式

方式一:逐一启动/sbin/hadoop-deamon.sh /sbin/yarn-deamon.sh

方式二:分开启动/sbin/start-dfs.sh /sbin/start-yarn.sh

方式三:一起启动/sbin/start-all.sh

第三种方式不建议使用,因为要分别启动dfs和yarn,要求namenode和resourcemanager在同一个节点上,且在该节点上运行start-all.sh命令。

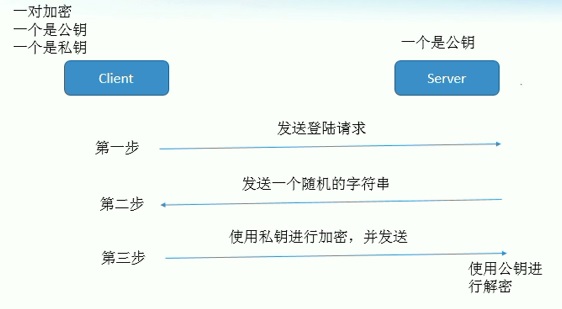

三、SSH登录过程

四、SSH免密码登录过程

客户端会先将自己的公钥保存在服务器端中,以供解密使用。

建立SSH免密码登录的过程如下:

1.ssh -keygen -t -rsa连续回车生成公钥和私钥,分别存储在/home/user/.ssh/id_rsa.pub和/home/user/.ssh/id_rsa下。

2.将公钥放到远程主机上,scp ~/.ssh/id_rsa.pub node2:/.ssh/authorized_keys。

这里是将客户端公钥放到服务器端,如果希望服务器也能免密码登录客户端,需要将服务器的公钥也在客户端放一份。

四、默认的配置文件

Hadoop自定义的配置文件在etc目录下。默认的配置文件在/share/hadoop各文件夹的jar包中。

默认的配置文件包括core-default.xml,hdfs-default.xml,yarn-default.xml,mapred-default.xml。

自定义配置文件中的配置将会覆盖默认配置文件中的配置。

从默认配置文件中拷贝配置项,修改后加入到自定义配置文件。不要修改默认配置文件中的内容。

五、默认使用本地文件系统还是HDFS文件系统

core-site.xml中的fs.defaultFS属性,默认的值是file:///,就是本地文件系统。配置为hdfs://hadoop-cloudy.com:8020时用的就是HDFS文件系统。

六、删除HDFS文件时,保留到回收站中的时间

core-site.xml中的fs.trash.interval属性,单位为分钟。默认为0,将直接删除。

HDFS默认的文件副本数为3.

七、MapReduce运行在本地还是yarn上

mapred-site.xml的属性mapreduce.framework.name默认为local,运行在本地。配置为yarn,运行在yarn上。

八、决定各进程所在主机的配置文件

namenode所在主机: core-site.xml中的fs.defaultFS属性

datanode所在主机:slaves文件指定

secondarynamenode所在主机:hdfs-site.xml中没有指定,就在默认的配置文件hdfs-default.xml

resourcemanager所在主机:yarn-site.xml中没有指定,就在默认的配置文件yarn-default.xml

nodemanager所在主机:slaves文件指定

jobhistoryserver所在主机:mapred-site.xml中没有指定,就在默认的配置文件mapred-default.xml

Hadoop学习笔记三的更多相关文章

- Hadoop学习笔记(三) ——HDFS

参考书籍:<Hadoop实战>第二版 第9章:HDFS详解 1. HDFS基本操作 @ 出现的bug信息 @-@ WARN util.NativeCodeLoader: Unable to ...

- Hadoop学习笔记—22.Hadoop2.x环境搭建与配置

自从2015年花了2个多月时间把Hadoop1.x的学习教程学习了一遍,对Hadoop这个神奇的小象有了一个初步的了解,还对每次学习的内容进行了总结,也形成了我的一个博文系列<Hadoop学习笔 ...

- Hadoop学习笔记(2)

Hadoop学习笔记(2) ——解读Hello World 上一章中,我们把hadoop下载.安装.运行起来,最后还执行了一个Hello world程序,看到了结果.现在我们就来解读一下这个Hello ...

- Hadoop学习笔记(3)——分布式环境搭建

Hadoop学习笔记(3) ——分布式环境搭建 前面,我们已经在单机上把Hadoop运行起来了,但我们知道Hadoop支持分布式的,而它的优点就是在分布上突出的,所以我们得搭个环境模拟一下. 在这里, ...

- Hadoop学习笔记(2) ——解读Hello World

Hadoop学习笔记(2) ——解读Hello World 上一章中,我们把hadoop下载.安装.运行起来,最后还执行了一个Hello world程序,看到了结果.现在我们就来解读一下这个Hello ...

- Hadoop学习笔记(两)设置单节点集群

本文描写叙述怎样设置一个单一节点的 Hadoop 安装.以便您能够高速运行简单的操作,使用 Hadoop MapReduce 和 Hadoop 分布式文件系统 (HDFS). 參考官方文档:Hadoo ...

- Hadoop学习笔记—5.自定义类型处理手机上网日志

转载自http://www.cnblogs.com/edisonchou/p/4288737.html Hadoop学习笔记—5.自定义类型处理手机上网日志 一.测试数据:手机上网日志 1.1 关于这 ...

- hadoop学习笔记-目录

以下是hadoop学习笔记的顺序: hadoop学习笔记(一):概念和组成 hadoop学习笔记(二):centos7三节点安装hadoop2.7.0 hadoop学习笔记(三):hdfs体系结构和读 ...

- Hadoop学习笔记(10) ——搭建源码学习环境

Hadoop学习笔记(10) ——搭建源码学习环境 上一章中,我们对整个hadoop的目录及源码目录有了一个初步的了解,接下来计划深入学习一下这头神象作品了.但是看代码用什么,难不成gedit?,单步 ...

随机推荐

- 51 Nod 1027 大数乘法【Java大数乱搞】

1027 大数乘法 基准时间限制:1 秒 空间限制:131072 KB 分值: 0 难度:基础题 给出2个大整数A,B,计算A*B的结果. Input 第1行:大数A 第2行:大数B (A,B的长度 ...

- [51nod1213]二维曼哈顿距离最小生成树

二维平面上有N个坐标为整数的点,点x1 y1同点x2 y2之间的距离为:横纵坐标的差的绝对值之和,即:Abs(x1 - x2) + Abs(y1 - y2)(也称曼哈顿距离).求这N个点所组成的完全图 ...

- map映照容器的使用

map映照容器可以实现各种不同类型数据的对应关系,有着类似学号表的功能. 今天在做并查集的训练时,就用上了map映照容器. 题目就不上了,直接讲一下用法.顺便说一下,实现过程是在C++的条件下. #i ...

- node.js和express创建服务器

创建web服务器 一. 使用node.js创建服务器. 使用express创建http服务. 监控服务器的变化. 二. 初始化配置文件:npm init -y 使用typescript编写,导入nod ...

- Linux-vmware tools安装与cdrom挂载(转)

昨天想直接复制虚拟机centos系统中命令行的内容到主机的txt文档上进行保存,发现不能实现虚拟机与主机之间的直接通讯,后来查资料发现原来是由于我的虚拟机没有安装vwmare tools的缘故. 一个 ...

- java中static关键字的继承问题

结论:java中静态属性和静态方法可以被继承,但是没有被重写(overwrite)而是被隐藏. 原因: 1). 静态方法和属性是属于类的,调用的时候直接通过类名.方法名完成对,不需要继承机制及可以调用 ...

- NodeJS、NPM安装配置与测试步骤(windows版本)

1.windows下的NodeJS安装是比较方便的(v0.6.0版本之后,支持windows native),只需要登陆官网(http://nodejs.org/),便可以看到首页的"INS ...

- 一简单的RPC实例(Java)

来至于阿里liangf:如有冒犯,请原谅 RPCFrameWork: package com.sunchao.demo; import java.io.IOException; import java ...

- Python-Blog2-编写Web app 骨架

撸代码之前让我们先来看几个概念: 什么是协程(Coroutine)? 假设现在有两个子程序,子程序A和子程序B: def A(): print('1') print('2') print('3') d ...

- hibernate解读之session--基于最新稳定版5.2.12

前言 hibernate是一个实现了JPA标准的,用于对象持久化的orm框架.博主近一年开发都在使用. 前段时间在工作中遇到了一个hibernate的问题,从数据库查找得到对象后,修改了其中部分字段值 ...