scrapy实战

采用scrapy实现对股票网站的爬取

功能描述:

技术路线:scrapy

目标:获取上交所和深交所所有股票名称和交易信息并存储

实例编写:

步骤1:建立工程和spider爬虫模板

步骤2:编写spider

步骤3:编写item pipeline

新建工程:

生成名为stocks的爬虫

打开IDE,将项目导入,首先我们要编辑spider文件夹下的stocks.py文件,使其能处理返回的url

import scrapy

import re class StocksSpider(scrapy.Spider):

name = 'stocks'

start_urls = ['http://quote.eastmoney.com/stocklist.html'] def parse(self, response):

for href in response.css('a::attr(href)').extract(): #将a标签中的链接进行提取

try:

stock = re.findall(r"[s][hz]\d{6}", href)[0] #通过正则表达式库来获取股票代码

url = 'https://gupiao.baidu.com/stock/' + stock + '.html'

yield scrapy.Request(url, callback=self.parse_stock) #给出了处理url的响应函数,定义出一个新的函数parse_stock

except:

continue def parse_stock(self, response):

infoDict = {}

stockInfo = response.css('.stock-bets') #找到一个属性为stock-bets的区域

name = stockInfo.css('.bets-name').extract()[0] #提取股票名字

keyList = stockInfo.css('dt').extract() #提取每个dt标签

valueList = stockInfo.css('dd').extract() #提取每个dd标签

for i in range(len(keyList)): #遍历每对标签,提取标签的键和值,并存入列表

key = re.findall(r'>.*</dt>', keyList[i])[0][1:-5]

try:

val =re.findall(r'\d+\.?.*</dd>', valueList[i])[0][1:-5]

except:

val = '--'

infoDict[key] = val infoDict.update(

{'股票名称': re.findall('\s.*\(', name)[0].split()[0] + re.findall('\>.*\<', name)[0][1:-1]}

) #将页面内股票名称和代码存入列表

yield infoDict #以备将列表内的信息传递给ITEM pipeline

接下来要配置pipelines.py文件,定义对爬取项的处理类

class BaidustockPipeline(object):

def process_item(self, item, spider):

return item class BaidustocksInfoPipeline(object):

def open_spider(self, spider): #爬虫被调用时,pipeline所启用的方法

self.f = open('BaiduStockInfo.txt', 'w') def close_spider(self, spider): #爬虫关闭时,pipeline所启用的方法

self.f.close() def process_item(self, item, spider): #将每个股票的信息写入文件中

try:

line = str(dict(item)) + '\n'

self.f.write(line)

except:

pass

return item

在pipelines.py中定义了一个类,为了让程序能找到这个类,需要配置ITEM_PIPELINES选项

打开settings.py,找到ITEM_PIPELINES参数,删除注释号

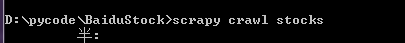

执行命令:

scrapy实战的更多相关文章

- 简单的scrapy实战:爬取腾讯招聘北京地区的相关招聘信息

简单的scrapy实战:爬取腾讯招聘北京地区的相关招聘信息 简单的scrapy实战:爬取腾讯招聘北京地区的相关招聘信息 系统环境:Fedora22(昨天已安装scrapy环境) 爬取的开始URL:ht ...

- Python分布式爬虫开发搜索引擎 Scrapy实战视频教程

点击了解更多Python课程>>> Python分布式爬虫开发搜索引擎 Scrapy实战视频教程 课程目录 |--第01集 教程推介 98.23MB |--第02集 windows下 ...

- Scrapy实战篇(六)之Scrapy配合Selenium爬取京东信息(上)

在之前的一篇实战之中,我们已经爬取过京东商城的文胸数据,但是前面的那一篇其实是有一个缺陷的,不知道你看出来没有,下面就来详细的说明和解决这个缺陷. 我们在京东搜索页面输入关键字进行搜索的时候,页面的返 ...

- Scrapy实战-新浪网分类资讯爬虫

项目要求: 爬取新浪网导航页所有下所有大类.小类.小类里的子链接,以及子链接页面的新闻内容. 什么是Scrapy框架: Scrapy是用纯Python实现一个为了爬取网站数据.提取结构性数据而编写的应 ...

- Scrapy实战篇(八)之爬取教育部高校名单抓取和分析

本节我们以网址https://daxue.eol.cn/mingdan.shtml为初始链接,爬取教育部公布的正规高校名单. 思路: 1.首先以上面的地址开始链接,抓取到下面省份对应的链接. 2.在解 ...

- Scrapy实战篇(七)之爬取爱基金网站基金业绩数据

本篇我们以scrapy+selelum的方式来爬取爱基金网站(http://fund.10jqka.com.cn/datacenter/jz/)的基金业绩数据. 思路:我们以http://fund.1 ...

- scrapy实战之scrapyrt的使用

scrapyrt为scrapy提供了一个http接口,有了它,我们不用再执行命令,而是直接请求一个http接口来启动项目,如果项目是部署在远程的,会比较方便. 1.安装: pip install sc ...

- Scrapy实战篇(六)之爬取360图片数据和图片

本篇文章我们以360图片为例,介绍scrapy框架的使用以及图片数据的下载. 目标网站:http://images.so.com/z?ch=photography 思路:分析目标网站为ajax加载方式 ...

- Scrapy实战篇(五)之爬取历史天气数据

本篇文章我们以抓取历史天气数据为例,简单说明数据抓取的两种方式: 1.一般简单或者较小量的数据需求,我们以requests(selenum)+beautiful的方式抓取数据 2.当我们需要的数据量较 ...

- Scrapy实战篇(四)爬取京东商城文胸信息

创建scrapy项目 scrapy startproject jingdong 填充 item.py文件 在这里定义想要存储的字段信息 import scrapy class JingdongItem ...

随机推荐

- 二十八、MySQL 元数据

MySQL 元数据 你可能想知道MySQL以下三种信息: 查询结果信息: SELECT, UPDATE 或 DELETE语句影响的记录数. 数据库和数据表的信息: 包含了数据库及数据表的结构信息. M ...

- HashMap原理以及自己实现HashMap

1.HashMap是什么? HashMap是java常用来存储键值对的数据结构,它是以key/value的形式存储的,它不是线程安全的,Key可以为null值. 2.HashMap的实现原理 Hash ...

- Linux 系统中 sudo 命令的 10 个技巧

概览 sudo 表示 "superuser do". 它允许已验证的用户以其他用户的身份来运行命令.其他用户可以是普通用户或者超级用户.然而,大部分时候我们用它来以提升的权限来运行 ...

- 最新手机号正则表达式php包括166等号段

if(!preg_match("/^((13[0-9])|(14[5,7])|(15[0-3,5-9])|(17[0,3,5-8])|(18[0-9])|166|198|199|(147)) ...

- codeforces 258D DP

D. Little Elephant and Broken Sorting time limit per test 2 seconds memory limit per test 256 megaby ...

- [USACO]玉米实验(单调队列)

Description 约翰决定培育新的玉米品种以提高奶牛的产奶效率.约翰所有的土地被分成 N ×N 块,其中第 r行第 c 列的玉米质量为 Ar,c.他打算找一块质量比较均匀的土地开始自己的实验.经 ...

- Kubernetes添加带Quota限额的CephFS StorageClass

1. 在Ceph上为Kubernetes创建一个文件系统 # ceph osd pool create cephfs_data # ceph osd pool create cephfs_metada ...

- Active Directory 站点和服务

Active Directory 站点和服务 更新时间: 2012年3月 应用到: Windows Server 2008, Windows Server 2008 R2, Windows Serve ...

- 项目管理者必知:适用于仪表盘项目的7个优秀JavaScript库

仪表盘是用于目标或业务流程的视觉指示工具,也用于切割杂乱无章的数据,从而分割出要点的重要工具.它可以帮助评估信息并及时做出正确的决定,一款实时可视化的仪表盘通常由图标.测绘图.图形符号以及数据表格等组 ...

- Mac教程macOS教程 苹果电脑教程

第1 章 初识MacOS 01 菜单栏 02 键盘 03 聚焦(Spotlight)