NLP文本多标签分类---HierarchicalAttentionNetwork

最近一直在做多标签分类任务,学习了一种层次注意力模型,基本结构如下:

简单说,就是两层attention机制,一层基于词,一层基于句。

首先是词层面:

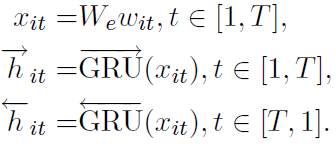

输入采用word2vec形成基本语料向量后,采用双向GRU抽特征:

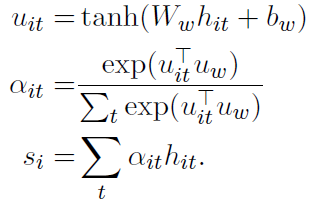

一句话中的词对于当前分类的重要性不同,采用attention机制实现如下:

tensorflow代码实现如下:

···

def attention_word_level(self, hidden_state):

"""

input1:self.hidden_state: hidden_state:list,len:sentence_length,element:[batch_size*num_sentences,hidden_size*2]

input2:sentence level context vector:[batch_size*num_sentences,hidden_size*2]

:return:representation.shape:[batch_size*num_sentences,hidden_size*2]

"""

hidden_state_ = tf.stack(hidden_state, axis=1) # shape:[batch_size*num_sentences,sequence_length,hidden_size*2]

# 0) one layer of feed forward network

hidden_state_2 = tf.reshape(hidden_state_, shape=[-1,

self.hidden_size * 2]) # shape:[batch_size*num_sentences*sequence_length,hidden_size*2]

# hidden_state_:[batch_size*num_sentences*sequence_length,hidden_size*2];W_w_attention_sentence:[,hidden_size*2,,hidden_size*2]

hidden_representation = tf.nn.tanh(tf.matmul(hidden_state_2,

self.W_w_attention_word) + self.W_b_attention_word) # shape:[batch_size*num_sentences*sequence_length,hidden_size*2]

hidden_representation = tf.reshape(hidden_representation, shape=[-1, self.sequence_length,

self.hidden_size * 2]) # shape:[batch_size*num_sentences,sequence_length,hidden_size*2]

# attention process:1.get logits for each word in the sentence. 2.get possibility distribution for each word in the sentence. 3.get weighted sum for the sentence as sentence representation.

# 1) get logits for each word in the sentence.

hidden_state_context_similiarity = tf.multiply(hidden_representation,

self.context_vecotor_word) # shape:[batch_size*num_sentences,sequence_length,hidden_size*2]

attention_logits = tf.reduce_sum(hidden_state_context_similiarity,

axis=2) # shape:[batch_size*num_sentences,sequence_length]

# subtract max for numerical stability (softmax is shift invariant). tf.reduce_max:Computes the maximum of elements across dimensions of a tensor.

attention_logits_max = tf.reduce_max(attention_logits, axis=1,

keep_dims=True) # shape:[batch_size*num_sentences,1]

# 2) get possibility distribution for each word in the sentence.

p_attention = tf.nn.softmax(

attention_logits - attention_logits_max) # shape:[batch_size*num_sentences,sequence_length]

# 3) get weighted hidden state by attention vector

p_attention_expanded = tf.expand_dims(p_attention, axis=2) # shape:[batch_size*num_sentences,sequence_length,1]

# below sentence_representation'shape:[batch_size*num_sentences,sequence_length,hidden_size*2]<----p_attention_expanded:[batch_size*num_sentences,sequence_length,1];hidden_state_:[batch_size*num_sentences,sequence_length,hidden_size*2]

sentence_representation = tf.multiply(p_attention_expanded,

hidden_state_) # shape:[batch_size*num_sentences,sequence_length,hidden_size*2]

sentence_representation = tf.reduce_sum(sentence_representation,

axis=1) # shape:[batch_size*num_sentences,hidden_size*2]

return sentence_representation # shape:[batch_size*num_sentences,hidden_size*2]

···

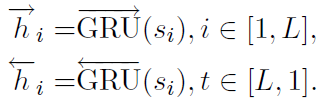

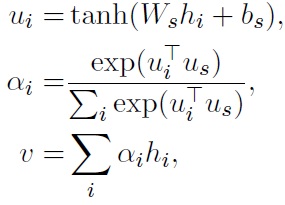

句子层面和词层面基本相同

双向GRU输入,softmax计算attention

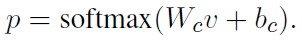

最后基于句子层面的输出,计算分类

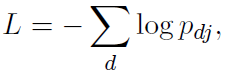

指数损失

github源代码:https://github.com/zhaowei555/multi_label_classify/tree/master/han

NLP文本多标签分类---HierarchicalAttentionNetwork的更多相关文章

- fastText、TextCNN、TextRNN……这里有一套NLP文本分类深度学习方法库供你选择

https://mp.weixin.qq.com/s/_xILvfEMx3URcB-5C8vfTw 这个库的目的是探索用深度学习进行NLP文本分类的方法. 它具有文本分类的各种基准模型,还支持多标签分 ...

- NLP文本分类方法汇总

模型: FastText TextCNN TextRNN RCNN 分层注意网络(Hierarchical Attention Network) 具有注意的seq2seq模型(seq2seq with ...

- NLP文本分类

引言 其实最近挺纠结的,有一点点焦虑,因为自己一直都期望往自然语言处理的方向发展,梦想成为一名NLP算法工程师,也正是我喜欢的事,而不是为了生存而工作.我觉得这也是我这辈子为数不多的剩下的可以自己去追 ...

- 浅谈NLP 文本分类/情感分析 任务中的文本预处理工作

目录 浅谈NLP 文本分类/情感分析 任务中的文本预处理工作 前言 NLP相关的文本预处理 浅谈NLP 文本分类/情感分析 任务中的文本预处理工作 前言 之所以心血来潮想写这篇博客,是因为最近在关注N ...

- LM-MLC 一种基于完型填空的多标签分类算法

LM-MLC 一种基于完型填空的多标签分类算法 1 前言 本文主要介绍本人在全球人工智能技术创新大赛[赛道一]设计的一种基于完型填空(模板)的多标签分类算法:LM-MLC,该算法拟合能力很强能感知标签 ...

- CSS.02 -- 样式表 及标签分类(块、行、行内块元素)、CSS三大特性、背景属性

样式表书写位置 内嵌式写法 <head> <style type="text/css"> 样式表写法 </style> </head&g ...

- html(常用标签,标签分类),页面模板, CSS(css的三种引入方式),三种引入方式优先级

HTML 标记语言为非编程语言负责完成页面的结构 组成: 标签:被<>包裹的由字母开头,可以结合合法字符( -|数字 ),能被浏览器解析的特殊符号,标签有头有尾 指令:被<>包 ...

- 从零开始学 Web 之 CSS(二)文本、标签、特性

大家好,这里是「 Daotin的梦呓 」从零开始学 Web 系列教程.此文首发于「 Daotin的梦呓 」公众号,欢迎大家订阅关注.在这里我会从 Web 前端零基础开始,一步步学习 Web 相关的知识 ...

- Python-HTML 最强标签分类

编程: 使用(展示)数据 存储数据 处理数据 前端 1. 前端是做什么的? 2. 我们为什么要学前端? 3. 前端都有哪些内容? 1. HTML 2. CSS 3. JavaScript 4.jQue ...

随机推荐

- 国际化的实现i18n--错误码国际化以及在springboot项目中使用

国际化 ,英文叫 internationalization 单词太长 ,又被简称为 i18n(取头取尾中间有18个字母); 主要涉及3个类: Locale用来设置定制的语言和国家代码 Resource ...

- 跟我一起学.NetCore之WebApi接口裸奔有风险(Jwt)

前言 撸码需谨慎,裸奔有风险.经常在一些技术交流群中了解到,还有很多小伙伴的项目中Api接口没有做任何安全机制验证,直接就裸奔了,对于一些临时项目或是个人小项目还好,其余的话,建议小伙伴们酌情考虑都加 ...

- cobbler自动化安装centos

转载于:https://www.cnblogs.com/skymydaiji/p/10877533.html 一.cobbler介绍 1.前言 cobbler 是基于 python 语言开发的 pxe ...

- lua 1.0 源码分析 -- 总结

读完 lua1.0 的源码感触:1. 把复杂的代码写简单2. pack 的内存回收3. hash 实现简单,但是应该可以改进,看高版本的代码怎么实现4. lua 初始化环境做了什么,就是一组全局变量初 ...

- 2017年 实验五 B2B模拟实验

实验五 B2B模拟实验 [实验目的] ⑴.掌握B2B中供应商的供求信息发布.阿里商铺开设和订单交易等过程. ⑵.掌握B2B中采购商的采购信息的发布.交易洽谈.网上支付和收货等过程. [实验条件] ⑴ ...

- Linux最常用的命令大全

Linux最常用的命令大全 按功能索引 目录处理命令 ls mkdir pwd cd rmdir cp mv rm 文件处理命令 touch cat tac more less head tail l ...

- centos7搭建docker环境

Docker简介 Docker是一种虚拟化技术,用来将你的应用程序及其依赖的环境一起打包成一个镜像发布,使得在任何地方都能获得相同的运行环境. Docker 是一个开源项目,诞生于 2013 年初,最 ...

- Spring mvc文件上传实现

Spring mvc文件上传实现 jsp页面客户端表单编写 三个要素: 1.表单项type="file" 2.表单的提交方式:post 3.表单的enctype属性是多部分表单形式 ...

- centos8安装fastdfs6.06(单机方式)

一,下载 fastdfs6.06 1,官方地址 https://github.com/happyfish100 2,说明:当前版本:共3个子模块 fastdfs v6.06 libfastcommon ...

- socket php

$socket = socket_create(AF_INET,SOCK_STREAM,SOL_TCP); socket_bind($socket,'0.0.0.0',6666); while(tru ...