第六篇:Eclipse上运行第一个Hadoop实例 - WordCount(单词统计程序)

需求

计算出文件中每个单词的频数。要求输出结果按照单词的字母顺序进行排序。每个单词和其频数占一行,单词和频数之间有间隔。

比如,输入两个文件,其一内容如下:

hello world

hello hadoop

hello mapreduce

另一内容如下:

bye world

bye hadoop

bye mapreduce

对应上面给出的输入样例,其输出样例为:

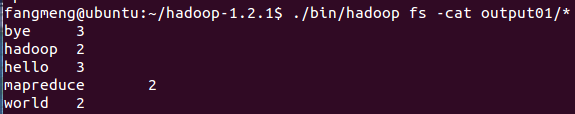

bye 3

hadoop 2

hello 3

mapreduce 2

world 2

方案制定

对该案例,可设计出如下的MapReduce方案:

1. Map阶段各节点完成由输入数据到单词切分再到单词搜集的工作

2. shuffle阶段完成相同单词的聚集再到分发到各个Reduce节点的工作 (shuffle阶段是MapReduce的默认过程)

3. Reduce阶段负责接收所有单词并计算各自频数

代码示例

/**

* Licensed under the Apache License, Version 2.0 (the "License");

* you may not use this file except in compliance with the License.

* You may obtain a copy of the License at

*

* http://www.apache.org/licenses/LICENSE-2.0

*

* Unless required by applicable law or agreed to in writing, software

* distributed under the License is distributed on an "AS IS" BASIS,

* WITHOUT WARRANTIES OR CONDITIONS OF ANY KIND, either express or implied.

* See the License for the specific language governing permissions and

* limitations under the License.

*/ package org.apache.hadoop.examples; import java.io.IOException;

import java.util.StringTokenizer; //导入各种Hadoop包

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.Mapper;

import org.apache.hadoop.mapreduce.Reducer;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import org.apache.hadoop.util.GenericOptionsParser; // 主类

public class WordCount { // Mapper类

public static class TokenizerMapper extends Mapper<Object, Text, Text, IntWritable>{ // new一个值为1的整数对象

private final static IntWritable one = new IntWritable(1);

// new一个空的Text对象

private Text word = new Text(); // 实现map函数

public void map(Object key, Text value, Context context) throws IOException, InterruptedException { // 创建value的字符串迭代器

StringTokenizer itr = new StringTokenizer(value.toString()); // 对数据进行再次分割并输出map结果。初始格式为<字节偏移量,单词> 目标格式为<单词,频率>

while (itr.hasMoreTokens()) {

word.set(itr.nextToken());

context.write(word, one);

}

}

} // Reducer类

public static class IntSumReducer extends Reducer<Text,IntWritable,Text,IntWritable> { // new一个值为空的整数对象

private IntWritable result = new IntWritable(); // 实现reduce函数

public void reduce(Text key, Iterable<IntWritable> values, Context context) throws IOException, InterruptedException { int sum = 0;

for (IntWritable val : values) {

sum += val.get();

} // 得到本次计算的单词的频数

result.set(sum); // 输出reduce结果

context.write(key, result);

}

} // 主函数

public static void main(String[] args) throws Exception { // 获取配置参数

Configuration conf = new Configuration();

String[] otherArgs = new GenericOptionsParser(conf, args).getRemainingArgs(); // 检查命令语法

if (otherArgs.length != 2) {

System.err.println("Usage: wordcount <in> <out>");

System.exit(2);

} // 定义作业对象

Job job = new Job(conf, "word count");

// 注册分布式类

job.setJarByClass(WordCount.class);

// 注册Mapper类

job.setMapperClass(TokenizerMapper.class);

// 注册合并类

job.setCombinerClass(IntSumReducer.class);

// 注册Reducer类

job.setReducerClass(IntSumReducer.class);

// 注册输出格式类

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(IntWritable.class);

// 设置输入输出路径

FileInputFormat.addInputPath(job, new Path(otherArgs[0]));

FileOutputFormat.setOutputPath(job, new Path(otherArgs[1])); // 运行程序

System.exit(job.waitForCompletion(true) ? 0 : 1);

}

}

运行方法

1. 打开Eclipse并启动Hdfs(方法请参考前文)

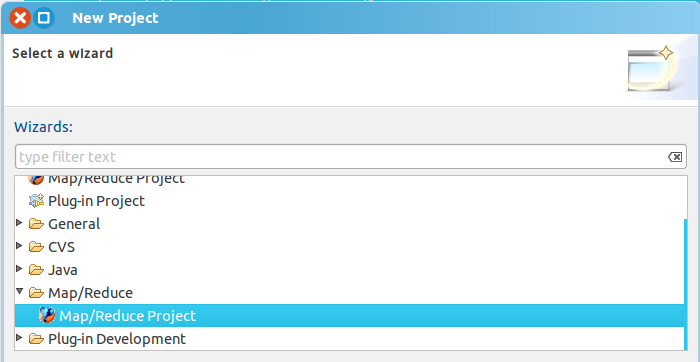

2. 新建一个MapReduce工程:”file" -> "new" -> "project",然后选择 "Map/Reduce Project"

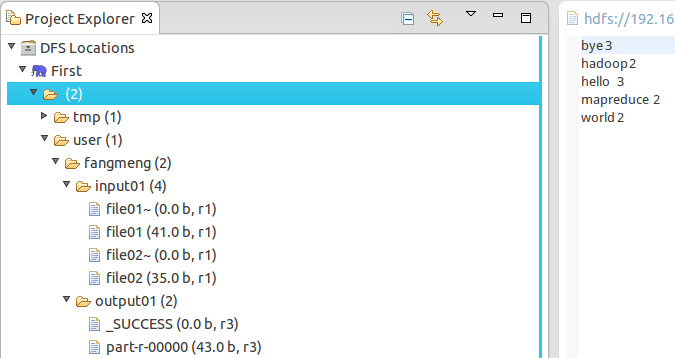

3. 设置输入目录及文件

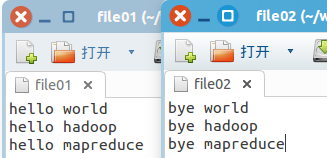

在项目工程包里面新建一个名为input的目录,里面存放需要处理的输入文件。这里选用2个文件名分别为file01和file02的文件进行测试。文件内容同需求示例。

4. 将输入文件传输入Hdfs

在终端输入以下命令即可将整个目录传输进Hdfs(input目录下的所有文件将会被送进Hdfs下名为input01的目录里),请根据MapReduce工程包实际路径对如下命令略作修改即可:

./bin/hadoop fs -put ../workspace/Hadoop_t1/input/ input01

5. 在工程包中新建一个WordCount类并将上面的源代码拷贝进去。

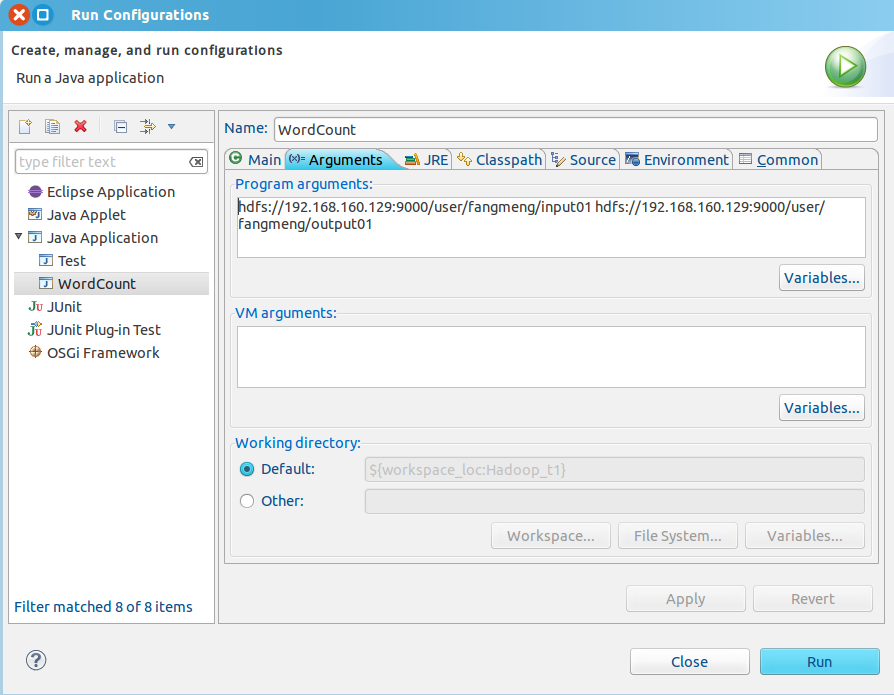

6. 调整项目运行参数:右键项目 -> “Run As" -> ”Run Configurations"

需要添加的就是"Program arguments"下的那些代码。它们其实是作为命令行参数传递进程序的,第一段是输入文件路径;第二段是输出文件路径。

路径的格式为 "[主机IP地址:hdfs端口] + [输入/输出目录在hdfs中的路径]"。

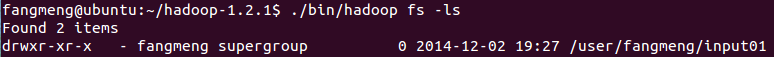

可以输入以下命令查看输入目录路径:

./bin/hadoop fs -ls

7. 点击"Run"运行程序。

8. 执行以下命令查看结果:

./bin/hadoop fs -cat output01/*

这些主机和Hdfs的文件传递,显示也可以使用Eclipse,更方便容易。在此就不提了。

小结

1. 多多熟练Hadoop平台下MapReduce项目基本创建流程。

2. WordCount是一个很经典的Hadoop示例,它虽然简单,但具有很大的代表性。

3. 从某个程度上来说也反映了其设计的初衷,对日志文件的分析。

第六篇:Eclipse上运行第一个Hadoop实例 - WordCount(单词统计程序)的更多相关文章

- Eclipse上运行第一个Hadoop实例 - WordCount(单词统计程序)

需求 计算出文件中每个单词的频数.要求输出结果按照单词的字母顺序进行排序.每个单词和其频数占一行,单词和频数之间有间隔. 比如,输入两个文件,其一内容如下: hello world hello had ...

- hadoop学习---运行第一个hadoop实例

hadoop环境搭建好后,运行第wordcount示例 1.首先启动hadoop:sbin/start-dfs.sh,sbin/start-yarn.sh(必须能够正常运行) 2.进入到hadoo ...

- 第二章 mac上运行第一个appium实例

一.打开appium客户端工具 1 检查环境是否正常运行: 点击左边第三个图标 这是测试你环境是否都配置成功了 2 执行的过程中,遇到Could not detect Mac OS ...

- 在Hadoop1.2.1上运行第一个Hadoop程序FileSystemCat

- 在Eclipse上运行Spark(Standalone,Yarn-Client)

欢迎转载,且请注明出处,在文章页面明显位置给出原文连接. 原文链接:http://www.cnblogs.com/zdfjf/p/5175566.html 我们知道有eclipse的Hadoop插件, ...

- 在Hadoop上运行基于RMM中文分词算法的MapReduce程序

原文:http://xiaoxia.org/2011/12/18/map-reduce-program-of-rmm-word-count-on-hadoop/ 在Hadoop上运行基于RMM中文分词 ...

- 运行第一个Hadoop程序,WordCount

系统: Ubuntu14.04 Hadoop版本: 2.7.2 参照http://www.cnblogs.com/taichu/p/5264185.html中的分享,来学习运行第一个hadoop程序. ...

- mac上eclipse上运行word count

1.打开eclipse之后,建立wordcount项目 package wordcount; import java.io.IOException; import java.util.StringTo ...

- Eclipse上运行Python,使用PyDev

转自:http://www.ibm.com/developerworks/cn/opensource/os-cn-ecl-pydev/index.html 级别: 初级 郑 伟芳 (zhengwf@c ...

随机推荐

- linux刻录iso到u盘

需要的工具:Linux系统.U盘.ISO镜像文件.首先在Linux系统中打开终端,使用dd命令,格式如下:sudo dd if=xxx.iso of=/dev/sdb命令中xxx.iso是你的ISO镜 ...

- 《FPGA全程进阶---实战演练》第一章之如何学习FPGA

对于很多初学者,大部分都是急于求成,熟不知越是急于求成,最终越是学无所成,到头来两手空空,要学好FPGA,必须弄懂FPGA本质的一些内容. 1.FPGA内部结构及基本原理 FPGA是可以编程的,必须通 ...

- Android中获取系统上安装的APP信息

Version:0.9 StartHTML:-1 EndHTML:-1 StartFragment:00000099 EndFragment:00003259 Android中获取系统上安装的APP信 ...

- 如何在Windows 10安装和使用Linux的Bash shell

转载自:百度经验 Windwos 10 的周年更新为开发人员提供一个大的新功能:一个完整的,基于Ubuntu的Bash shell中,可以直接在Windows上运行Linux软件. 这使得“Linux ...

- ecmall数据库表详解 二次开发必备

文章分类表ecm_acategory 字段 类型 Null 默认 注释 cate_id int(10) 否 自增ID号,分类ID号 cate_name varchar(100) 否 分类的名称 ...

- 第三百三十八节,Python分布式爬虫打造搜索引擎Scrapy精讲—深度优先与广度优先原理

第三百三十八节,Python分布式爬虫打造搜索引擎Scrapy精讲—深度优先与广度优先原理 网站树形结构 深度优先 是从左到右深度进行爬取的,以深度为准则从左到右的执行(递归方式实现)Scrapy默认 ...

- Mybatis增删改查(CURD)

前面的小节我们已经讲到用接口的方式编程.使用这种方式,需要注意的一个地方就是,在User.xml 配置文件中,mapper namespace="com.yiibai.mybatis.int ...

- LintCode #1 A + B 问题

分析:以3 + 5为例 3的二进制为 1 1,5的二进制为 1 0 1,可以这样做:1先给这两个数加起来不考虑进位,这样得到的结果为 1 1 0,会发现与^得到的结果相同,与是先给两个数 做^运算:2 ...

- Windows 2008安装Oracle10g提示操作系统版本检查未通过

原文链接:http://www.cnblogs.com/emanlee/archive/2012/12/18/2824147.html 因开发环境需要,在Windows Server 2008 R2 ...

- 转载:erlang实现安卓和IOS的推送。

erlang-百度云推送Android服务端功能实现-erlang erlang -- ios apns provider -- erlang 实现 转自:http://www.cnblogs.com ...