Tachyon Cluster: 基于Zookeeper的Master High Availability(HA)高可用配置实现

1.Tachyon简介

Tachyon是一个高容错的分布式文件系统,允许文件以内存的速度在集群框架中进行可靠的共享,就像Spark和 MapReduce那样。通过利用信息继承,内存侵入,Tachyon获得了高性能。Tachyon工作集文件缓存在内存中,并且让不同的 Jobs/Queries以及框架都能内存的速度来访问缓存文件。因此,Tachyon可以减少那些需要经常使用的数据集通过访问磁盘来获得的次数。

2.Tachyon能解决什么问题:(摘自Tachyon 分布式内存文件系统)

1.不同FrameWork之间共享内存数据Slow问题

给定一个场景,MapReduce任务的输出结果会存入到Tachyon里,Spark的Job会从Tachyon里读取MapReduce任务的输出作为输入。如果把Disk当作文件的落地,那么写的性能是十分低下的。但是如果把Memory当作落地,写的性能是非常高的,fast write,以便Spark Job不会感觉到这是2个计算框架的操作,因为写和读的速度都非常快。同样的,你可以用Impala的输出结果当作Spark的输入。

2.Spark的Executor Crash问题

Spark的执行引擎和存储引擎都是在Executor进程里,即在一个Executor内会有多个Task在运行,并且这个Executor的内存会放入cache的RDD里。

问题来了,一旦我的Executor挂了,那么Tasks会失败,并且这些cache的RDD的Block也会丢失,这就会有ReCompute的过程,重新去取数据,根据血缘关系递归的去计算丢失的数据,这当然会很耗费资源,而且性能低下。

3.内存冗余问题

这里说的内存冗余是说,Spark中不同Job之间可能同时读取了同一个文件,比如:job1和job2的计算任务都需要读取到账号信息表中的数据,那么我们都在他们各自的Executor里都cache了这一张账号表,是不是就出现了一个数据,2个内存副本,其实这样做是完全没有必要的,是冗余的。

4.GC时间过长

有时候影响程序执行的并不是代码本身,而是由于内存中存了太多的Java Objects,如果Executor这个Jvm里cache的对象太多,比如:达到80G UP,这个时候出现几次FULL GC,你就会很纳闷我的程序怎么不动了?你去看GC log,原来在GC。

3.基于Zookeeper的Fault Tolerant Tachyon Cluster 实现

3.0 配置前提

- hadoop version:2.2.0.2.0.6.0-101

- zookeeper version:2.3.5

- Tachyon version: 0.4.1

集群情况:

| Cluster | Masters | Slaves |

| Tachyon | bigdata001,bigdata002 | bigdata001,bigdata002,bigdata003,bigdata004,bigdata005,bigdata006,bigdata007,bigdata008 |

zookeeper url: bigdata001:2181,bigdata002:2181,bigdata003:2181

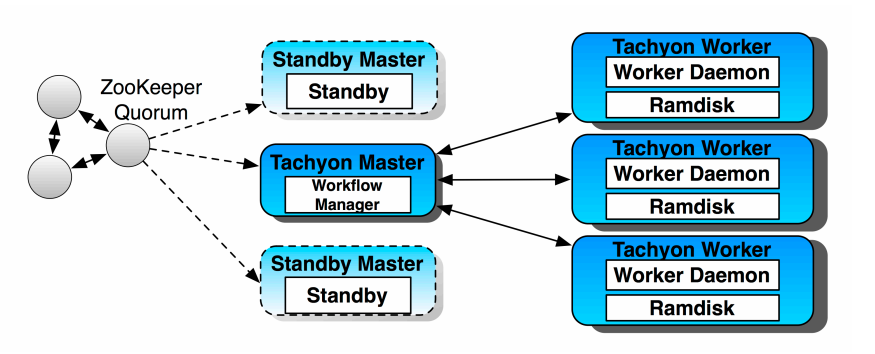

3.1 HA架构

3.2 配置(conf/tachyon-env.sh )

1.参考官方文档:Fault Tolerant Tachyon Cluster

①HDFS

export TACHYON_UNDERFS_ADDRESS=hdfs://[namenodeserver]:[namenodeport]

②ZooKeeper:

| Property Name | Example | Meaning |

|---|---|---|

| tachyon.usezookeeper | true | Whether or not Master processes should use ZooKeeper. |

| tachyon.zookeeper.address | localhost:2181 | The hostname and port ZooKeeper is running on. |

③Master Node Configuration

export TACHYON_MASTER_ADDRESS=[externally visible address of this machine]

TACHYON_JAVA_OPTS to include:

-Dtachyon.master.journal.folder=hdfs://[namenodeserver]:[namenodeport]/tachyon/journal

④Worker Node Configuration

export TACHYON_MASTER_ADDRESS=[address of one of the master nodes in the system]

2.集群配置

Master节点配置:bigdata001节点的tachyon/conf/tachyon-env.sh添加如下(下划线部分)

export TACHYON_MASTER_ADDRESS=192.168.1.101

export TACHYON_UNDERFS_ADDRESS=hdfs://192.168.1.101:8020

export TACHYON_JAVA_OPTS+="

-Dlog4j.configuration=file:$CONF_DIR/log4j.properties

-Dtachyon.debug=false

-Dtachyon.underfs.address=$TACHYON_UNDERFS_ADDRESS

-Dtachyon.underfs.hdfs.impl=$TACHYON_UNDERFS_HDFS_IMPL

-Dtachyon.data.folder=$TACHYON_UNDERFS_ADDRESS/tmp/tachyon/data

-Dtachyon.workers.folder=$TACHYON_UNDERFS_ADDRESS/tmp/tachyon/workers

-Dtachyon.worker.memory.size=$TACHYON_WORKER_MEMORY_SIZE

-Dtachyon.worker.data.folder=$TACHYON_RAM_FOLDER/tachyonworker/

-Dtachyon.master.worker.timeout.ms=

-Dtachyon.master.hostname=$TACHYON_MASTER_ADDRESS

-Dtachyon.master.journal.folder=$TACHYON_UNDERFS_ADDRESS/tachyon/journal/

-Dtachyon.master.pinlist=/pinfiles;/pindata

-Dorg.apache.jasper.compiler.disablejsr199=true

-Dtachyon.user.default.block.size.byte=

-Dtachyon.user.file.buffer.bytes=

-Dtachyon.usezookeeper=true

-Dtachyon.zookeeper.address=bigdata001:2181,bigdata002:2181,bigdata003:2181

"

配置同步到所有的slave节点:bigdata002,bigdata003,bigdata004,bigdata005,bigdata006,bigdata007,bigdata008

由于我们要将bigdata002作为另外一个master,因此,此节点的配置需要做修改TACHYON_MASTER_ADDRESS的值,如下

export TACHYON_MASTER_ADDRESS=192.168.1.102

export TACHYON_UNDERFS_ADDRESS=hdfs://192.168.1.101:8020

export TACHYON_JAVA_OPTS+="

-Dlog4j.configuration=file:$CONF_DIR/log4j.properties

-Dtachyon.debug=false

-Dtachyon.underfs.address=$TACHYON_UNDERFS_ADDRESS

-Dtachyon.underfs.hdfs.impl=$TACHYON_UNDERFS_HDFS_IMPL

-Dtachyon.data.folder=$TACHYON_UNDERFS_ADDRESS/tmp/tachyon/data

-Dtachyon.workers.folder=$TACHYON_UNDERFS_ADDRESS/tmp/tachyon/workers

-Dtachyon.worker.memory.size=$TACHYON_WORKER_MEMORY_SIZE

-Dtachyon.worker.data.folder=$TACHYON_RAM_FOLDER/tachyonworker/

-Dtachyon.master.worker.timeout.ms=

-Dtachyon.master.hostname=$TACHYON_MASTER_ADDRESS

-Dtachyon.master.journal.folder=$TACHYON_UNDERFS_ADDRESS/tachyon/journal/

-Dtachyon.master.pinlist=/pinfiles;/pindata

-Dorg.apache.jasper.compiler.disablejsr199=true

-Dtachyon.user.default.block.size.byte=

-Dtachyon.user.file.buffer.bytes=

-Dtachyon.usezookeeper=true

-Dtachyon.zookeeper.address=bigdata001:,bigdata002:,bigdata003:

"

3.启动集群

[root@bigdata001 tachyon]# ./bin/tachyon-stop.sh

Killed processes

Killed processes

192.168.1.103: Killed processes

192.168.1.101: Killed 0 processes

192.168.1.102: Killed processes

192.168.1.104: Killed processes

192.168.1.106: Killed processes

192.168.1.105: Killed processes

192.168.1.107: Killed processes

192.168.1.108: Killed processes

[root@bigdata001 tachyon]# ./bin/tachyon format

192.168.1.101: Formatting Tachyon Worker @ bigdata001

192.168.1.102: Formatting Tachyon Worker @ bigdata002

192.168.1.103: Formatting Tachyon Worker @ bigdata003

192.168.1.104: Formatting Tachyon Worker @ bigdata004

192.168.1.105: Formatting Tachyon Worker @ bigdata005

192.168.1.106: Formatting Tachyon Worker @ bigdata006

192.168.1.107: Formatting Tachyon Worker @ bigdata007

192.168.1.102: Removing local data under folder: /mnt/ramdisk/tachyonworker/

192.168.1.101: Removing local data under folder: /mnt/ramdisk/tachyonworker/

192.168.1.103: Removing local data under folder: /mnt/ramdisk/tachyonworker/

192.168.1.104: Removing local data under folder: /mnt/ramdisk/tachyonworker/

192.168.1.108: Formatting Tachyon Worker @ bigdata008

192.168.1.105: Removing local data under folder: /mnt/ramdisk/tachyonworker/

192.168.1.106: Removing local data under folder: /mnt/ramdisk/tachyonworker/

192.168.1.107: Removing local data under folder: /mnt/ramdisk/tachyonworker/

192.168.1.108: Removing local data under folder: /mnt/ramdisk/tachyonworker/

Formatting Tachyon Master @ 192.168.1.101

Formatting JOURNAL_FOLDER: hdfs://192.168.1.101:8020/tachyon/journal/

Formatting UNDERFS_DATA_FOLDER: hdfs://192.168.1.101:8020/tmp/tachyon/data

Formatting UNDERFS_WORKERS_FOLDER: hdfs://192.168.1.101:8020/tmp/tachyon/workers

[root@bigdata001 tachyon]# ./bin/tachyon-start.sh all Mount

Killed 0 processes

Killed 0 processes

192.168.1.103: Killed 0 processes

192.168.1.101: Killed 0 processes

192.168.1.105: Killed 0 processes

192.168.1.102: Killed 0 processes

192.168.1.107: Killed 0 processes

192.168.1.106: Killed 0 processes

192.168.1.104: Killed 0 processes

192.168.1.108: Killed 0 processes

Starting master @ 192.168.1.101

192.168.1.101: Formatting RamFS: /mnt/ramdisk (2gb)

192.168.1.102: Formatting RamFS: /mnt/ramdisk (2gb)

192.168.1.101: Starting worker @ bigdata001

192.168.1.103: Formatting RamFS: /mnt/ramdisk (2gb)

192.168.1.102: Starting worker @ bigdata002

192.168.1.103: Starting worker @ bigdata003

192.168.1.104: Formatting RamFS: /mnt/ramdisk (2gb)

192.168.1.105: Formatting RamFS: /mnt/ramdisk (2gb)

192.168.1.104: Starting worker @ bigdata004

192.168.1.105: Starting worker @ bigdata005

192.168.1.106: Formatting RamFS: /mnt/ramdisk (2gb)

192.168.1.106: Starting worker @ bigdata006

192.168.1.107: Formatting RamFS: /mnt/ramdisk (2gb)

192.168.1.107: Starting worker @ bigdata007

192.168.1.108: Formatting RamFS: /mnt/ramdisk (2gb)

192.168.1.108: Starting worker @ bigdata008

[root@bigdata001 tachyon]# jps

可以看到Master和Worker的进程号:8315 Master 8458 Worker

在另个master节点bigdata002上启动另外一个master:

[root@bigdata002 tachyon]# ./bin/tachyon-start.sh master

Starting master @ 192.168.1.102

4.测试HA

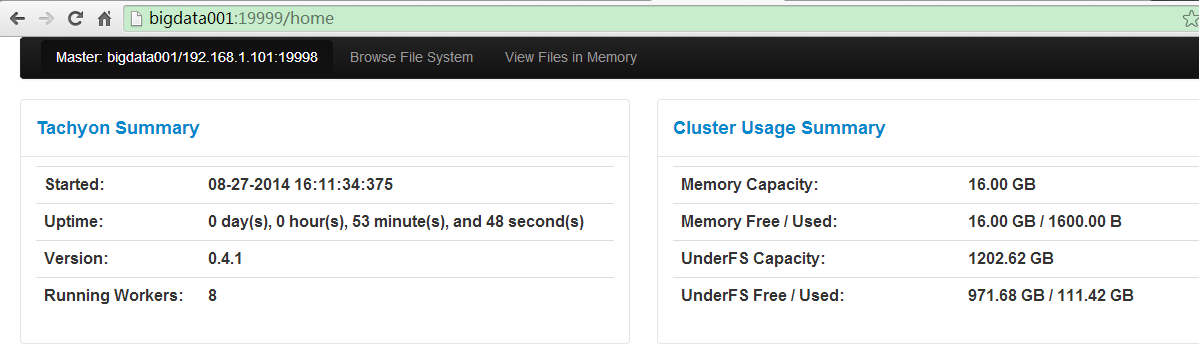

web界面查看:http://bigdata001:19999

kill掉bigdata001的master进程,切换时间大概需要20s,再次查看新的Web UI:http://bigdata002:19999/home

5.Zk上查看

[root@bigdata002 conf]# zkCli.sh

[zk: localhost:2181(CONNECTED) 61] ls /election

[_c_ae6213f4-a2e3-46f9-8fc0-5c5c64d7e773-lock-0000000027, _c_12297d87-56fc-4cd9-8f8d-7312a6af4cc2-lock-0000000026]

[zk: localhost:2181(CONNECTED) 63] ls /leader

[bigdata001:19998, bigdata002:19998]

6.遇到的问题及解决

1 ./bin/tachyon format 报错

Formatting Tachyon Master @ 0.0.0.0

Exception in thread "main" java.lang.RuntimeException: java.lang.ClassNotFoundException: Class not found

at org.apache.hadoop.conf.Configuration.getClass(Configuration.java:1720)

at org.apache.hadoop.fs.FileSystem.getFileSystemClass(FileSystem.java:2415)

at org.apache.hadoop.fs.FileSystem.createFileSystem(FileSystem.java:2428)

at org.apache.hadoop.fs.FileSystem.access$200(FileSystem.java:88)

at org.apache.hadoop.fs.FileSystem$Cache.getInternal(FileSystem.java:2467)

at org.apache.hadoop.fs.FileSystem$Cache.get(FileSystem.java:2449)

at org.apache.hadoop.fs.FileSystem.get(FileSystem.java:367)

at org.apache.hadoop.fs.Path.getFileSystem(Path.java:287)

at tachyon.UnderFileSystemHdfs.<init>(UnderFileSystemHdfs.java:69)

at tachyon.UnderFileSystemHdfs.getClient(UnderFileSystemHdfs.java:53)

at tachyon.UnderFileSystem.get(UnderFileSystem.java:53)

at tachyon.Format.main(Format.java:42)

Caused by: java.lang.ClassNotFoundException: Class not found

at org.apache.hadoop.conf.Configuration.getClassByName(Configuration.java:1626)

at org.apache.hadoop.conf.Configuration.getClass(Configuration.java:1718)

... 11 more

原因及解决:配置文件tachyon/conf/tachyon-env.sh的此项未配置:export TACHYON_UNDERFS_HDFS_IMPL=org.apache.hadoop.hdfs.DistributedFileSystem

Tachyon Cluster: 基于Zookeeper的Master High Availability(HA)高可用配置实现的更多相关文章

- Zookeeper(四)Hadoop HA高可用集群搭建

一.高可就集群搭建 1.集群规划 2.集群服务器准备 (1) 修改主机名(2) 修改 IP 地址(3) 添加主机名和 IP 映射(4) 同步服务器时间(5) 关闭防火墙(6) 配置免密登录(7) 安装 ...

- 七、Hadoop3.3.1 HA 高可用集群QJM (基于Zookeeper,NameNode高可用+Yarn高可用)

目录 前文 Hadoop3.3.1 HA 高可用集群的搭建 QJM 的 NameNode HA Hadoop HA模式搭建(高可用) 1.集群规划 2.Zookeeper集群搭建: 3.修改Hadoo ...

- Hadoop HA高可用集群搭建(Hadoop+Zookeeper+HBase)

声明:作者原创,转载注明出处. 作者:帅气陈吃苹果 一.服务器环境 主机名 IP 用户名 密码 安装目录 master188 192.168.29.188 hadoop hadoop /home/ha ...

- linux -- 基于zookeeper搭建yarn的HA高可用集群

linux -- 基于zookeeper搭建yarn的HA高可用集群 实现方式:配置yarn-site.xml配置文件 <configuration> <property> & ...

- Spark:Master High Availability(HA)高可用配置的2种实现

Spark Standalone集群是Master-Slaves架构的集群模式,和大部分的Master-Slaves结构集群一样,存在着Master单点故障的问题.如何解决这个单点故障的问题,Spar ...

- 【转】Spark:Master High Availability(HA)高可用配置的2种实现

原博文出自于: 感谢! Spark Standalone集群是Master-Slaves架构的集群模式,和大部分的Master-Slaves结构集群一样,存在着Master单点故障的问题.如何解决这个 ...

- HBase Master HA高可用

HMaster没有单点问题,HBase中可以启动多个HMaster,通过Zookeeper的Master Election机制保证总有一个Master运行. 所以这里要配置HBase高可用的话,只需要 ...

- zookeeper + LevelDB + ActiveMQ实现消息队列高可用

通过集群实现消息队列高可用. 消息队列在项目中存储订单.邮件通知.数据分发等重要信息,故对消息队列稳定可用性有高要求. 现在通过zookeeper选取activemq leader的形式实现当某个ac ...

- 基于heartbeat的单播方式实现tomcat高可用

1.节点规划 在master.backup节点上添加eth0.eth1两网卡,具体添加过程,参考“基于VMware为CentOS 6.5配置两个网卡” 2.IP规划 master backup e ...

随机推荐

- WebService学习笔记系列(一)

webservice主要是解决两个系统或者两个应用程序之间的远程调用,它提供了一种通过web方式访问的api,调用是跨语言.跨平台的. webservice的客户端与服务端进行交互的时候使用xml来传 ...

- C#面向对象(二)

一:抽象方法 1. 在面向对象编程语言中抽象方法指一些只有方法声明,而没有具体方法体的方法.抽象方法一般存在于抽象类或接口中. 在一些父类中,某些行为不是非常明确,因此无法用代码来具体实现,但是类还必 ...

- 复旦大学2016--2017学年第一学期高等代数I期末考试情况分析

一.期末考试成绩班级前十名 宁盛臻(100).朱民哲(92).徐钰伦(86).范凌虎(85).沈伊南(84).何陶然(84).丁知愚(83).焦思邈(83).董瀚泽(82).钱信(81) 二.总成绩计 ...

- Java代码操作HDFS(在/user/root/下面創建目錄)

1.创建HDFS目录并打成jar包 package Hdfs; import java.io.IOException; import java.net.URI; import org.apache.h ...

- [C# 基础知识系列]专题一:深入解析委托——C#中为什么要引入委托

转自http://www.cnblogs.com/zhili/archive/2012/10/22/Delegate.html 引言: 对于一些刚接触C# 不久的朋友可能会对C#中一些基本特性理解的不 ...

- A题笔记(10)

No.1390 代码:https://code.csdn.net/snippets/191965 另一版本:https://code.csdn.net/snippets/192009 考察点有两个: ...

- AutoResetEvent 详解

AutoResetEvent 允许线程通过发信号互相通信.通常,此通信涉及线程需要独占访问的资源. 线程通过调用 AutoResetEvent 上的 WaitOne 来等待信号.如果 AutoRese ...

- error: Unable to find vcvarsall.bat while install python library by pip install or python setup.py install.

Python 2.7 会搜索 Visual Studio 2008. 如果你电脑上没有这个版本的话,比如只有: 1.Visual Studio 2010,在cmd里面执行:SET VS90COMNTO ...

- C#程序中获取电脑硬件配置信息的一种方法

本文介绍获取cpu信息和内存信息的方法,根据本文所举例的代码可以举一反三获取更多信息. 获取cpu名称的方法: public string GetCpuInfo() { ManagementObjec ...

- 242. Valid Anagram(C++)

242. Valid Anagram Given two strings s and t, write a function to determine if t is an anagram of s. ...