Qt音视频开发42-人脸识别客户端

一、前言

人脸识别客户端程序,不需要和人脸识别相关的库在一起,而是通过协议通信来和人脸识别服务端通信交互,人脸识别客户端和服务端程序框架,主要是为了提供一套通用的框架,按照定好的协议,实现人脸识别的相关处理,很多厂家都会有也都会做类似的机制,以便第三方厂家或者自家的其他设备按照这个通信协议来处理,比如客户端程序可以在PC机上,也可以是网页,还可以是安卓客户端,前端设备比如人工访客机,访客机本地是不需要做人脸识别等处理的,而是发送到服务端处理完以后再拿到结果进行展示,这样就可以利用服务端强大的运算能力。

自定义人脸识别协议功能:

- 离线使用,同时支持百度的离线包和嵌入式linux人脸识别静态库。

- 支持多个连接并发,自动排队处理,返回的时候带上唯一标识区分。

- 传入单张图片返回人脸区域。

- 传入单张图片返回人脸特征值。

- 传入单张图片或者多张图片返回是否是活体。

- 传入两张图片返回比对结果。

- 传入两个特征值返回比对结果。

- 传入单张图片添加人脸。

- 指定唯一标识符删除人脸。

- 传入单张照片返回相似度最大的人脸信息。

- 修改人脸服务的配置参数比如是否快速查找、人脸占比等。

二、功能特点

- 支持的功能包括人脸识别、人脸比对、人脸搜索、活体检测等。

- 在线版还支持身份证、驾驶证、行驶证、银行卡等识别。

- 在线版的协议支持百度、旷视,离线版的支持百度,可定制。

- 除了支持X86架构,还支持嵌入式linux比如contex-A9、树莓派等。

- 每个功能的执行除了返回结果还返回执行用时时间。

- 多线程处理,通过type控制当前处理类型。

- 支持单张图片检索相似度最高的图片。

- 支持指定目录图片用来生成人脸特征值文件。

- 可设置等待处理图片队列中的数量。

- 每次执行都有成功或者失败的信号返回。

- 人脸搜索的返回结果包含了原图+最大相似度图+相似度等。

- 人脸比对同时支持两张图片和两个特征值比对。

- 相关功能自定义一套协议用于客户端和服务端,可以通过TCP通信进行交互。

- 自定义人脸识别协议非常适用于中心一台服务器,现场若干设备请求的场景。

- 每个模块全部是独立的一个类,代码整洁、注释完善。

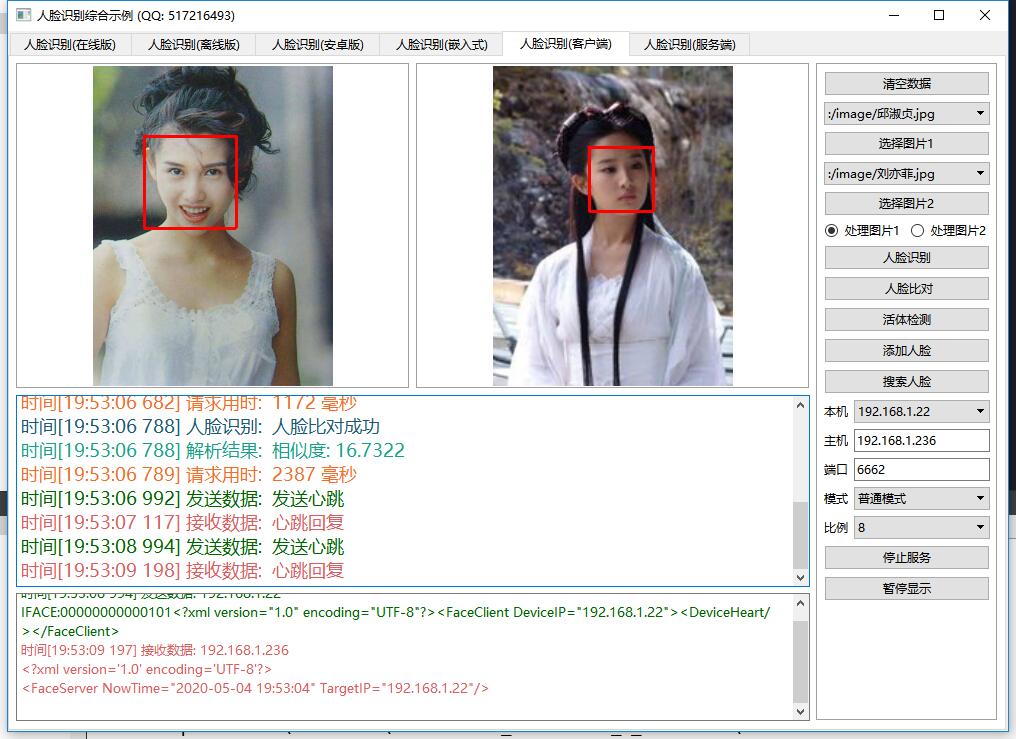

三、效果图

四、相关站点

- 国内站点:https://gitee.com/feiyangqingyun/QWidgetDemo

- 国际站点:https://github.com/feiyangqingyun/QWidgetDemo

- 个人主页:https://blog.csdn.net/feiyangqingyun

- 知乎主页:https://www.zhihu.com/people/feiyangqingyun/

- 体验地址:https://blog.csdn.net/feiyangqingyun/article/details/97565652

五、核心代码

FaceSdkClient::FaceSdkClient(QObject *parent) : QObject(parent)

{

isOk = false;

timeout = 10;

lastTime = QDateTime::currentDateTime();

//随机生成IP用于测试

clientIP = QString("192.168.1.%1").arg(qrand() % 255);

serverIP = "192.168.1.239";

serverPort = 6662;

//实例化连接对象

tcpSocket = new QTcpSocket(this);

connect(tcpSocket, SIGNAL(connected()), this, SLOT(connected()));

connect(tcpSocket, SIGNAL(disconnected()), this, SLOT(disconnected()));

connect(tcpSocket, SIGNAL(readyRead()), this, SLOT(readData()));

//定时器处理数据

timerData = new QTimer(this);

connect(timerData, SIGNAL(timeout()), this, SLOT(checkData()));

timerData->setInterval(100);

//定时器处理重连

timerConn = new QTimer(this);

connect(timerConn, SIGNAL(timeout()), this, SLOT(checkConn()));

timerConn->setInterval(3000);

//定时器发送心跳

timerHeart = new QTimer(this);

connect(timerHeart, SIGNAL(timeout()), this, SLOT(sendHeart()));

timerHeart->setInterval(2000);

}

void FaceSdkClient::connected()

{

isOk = true;

sendHeart();

}

void FaceSdkClient::disconnected()

{

isOk = false;

emit receiveAnaly(serverIP, "服务器断开");

}

void FaceSdkClient::checkConn()

{

QDateTime now = QDateTime::currentDateTime();

if (lastTime.secsTo(now) >= timeout) {

isOk = false;

start();

emit receiveAnaly(serverIP, "重连服务器");

}

}

void FaceSdkClient::readData()

{

lastTime = QDateTime::currentDateTime();

QMutexLocker locker(&mutex);

buffer.append(tcpSocket->readAll());

}

void FaceSdkClient::checkData()

{

QMutexLocker locker(&mutex);

QDomDocument dom;

if (!DeviceFun::getReceiveXmlData(buffer, dom, "IFACE:", 10)) {

return;

}

//逐个取出节点判断数据

emit receiveData(serverIP, dom.toString());

QDomElement element = dom.documentElement();

if (element.tagName() == "FaceServer") {

//查找时间字段属性

QString nowTime = element.attribute("NowTime");

QString year, month, day, hour, min, sec;

DeviceFun::getNowTime(nowTime, year, month, day, hour, min, sec);

//QUIHelper::setSystemDateTime(year, month, day, hour, min, sec);

//根据子节点处理

QDomNode childNode = element.firstChild();

QString name = childNode.nodeName();

QString value = element.text();

//qDebug() << TIMEMS << name << value;

//取出faceID和耗时

element = childNode.toElement();

QString faceID = element.attribute("FaceID");

int msec = element.attribute("TimeUsed").toInt();

if (name == "Msg") {

if (value.startsWith("Init Face Finsh")) {

emit receiveFaceFeatureFinsh();

} else if (value.startsWith("Find Face Rect Fail")) {

emit receiveFaceRectFail(faceID);

} else if (value.startsWith("Find Face Feature Fail")) {

emit receiveFaceFeatureFail(faceID);

} else if (value.startsWith("Find Face Compare Fail")) {

emit receiveFaceCompareFail(faceID);

} else if (value.startsWith("Find Face Live Fail")) {

emit receiveFaceLiveFail(faceID);

} else if (value.startsWith("Image Size Is Too Large")) {

emit receiveAnaly(serverIP, "图片尺寸过大");

} else {

emit receiveAnaly(serverIP, value);

}

} else if (name == "FaceRect") {

QStringList list = value.split(",");

QRect faceRect(list.at(0).toInt(), list.at(1).toInt(), list.at(2).toInt(), list.at(3).toInt());

emit receiveFaceRect(faceID, faceRect, msec);

} else if (name == "FaceFeature") {

QStringList list = value.split("|");

QList<float> feature;

for (int i = 0; i < 256; i++) {

feature << list.at(i).toFloat();

}

emit receiveFaceFeature(faceID, feature, msec);

} else if (name == "FaceLive") {

float result = element.attribute("Result").toFloat();

emit receiveFaceLive(faceID, result, msec);

} else if (name == "FaceCompare") {

float result = element.attribute("Result").toFloat();

emit receiveFaceCompare(faceID, result, msec);

} else if (name == "FaceCompareOne") {

QStringList list = value.split("|");

QImage image1 = DeviceFun::getImage(list.at(0));

QImage image2 = DeviceFun::getImage(list.at(1));

QString targetName = element.attribute("TargetName");

float result = element.attribute("Result").toFloat();

emit receiveFaceCompareOne(faceID, image1, image2, targetName, result, msec);

} else if (name == "FaceConfig") {

QString findFast = element.attribute("FindFast");

QString facePercent = element.attribute("FacePercent");

QString info = QString("模式: %1 比例: %2").arg(findFast == "true" ? "快速模式" : "正常模式").arg(facePercent);

emit receiveAnaly(serverIP, "人脸配置 " + info);

} else {

emit receiveAnaly(serverIP, "心跳回复");

}

}

}

void FaceSdkClient::setClientIP(const QString &clientIP)

{

this->clientIP = clientIP;

}

void FaceSdkClient::setServerIP(const QString &serverIP)

{

this->serverIP = serverIP;

}

void FaceSdkClient::setServerPort(int serverPort)

{

this->serverPort = serverPort;

}

bool FaceSdkClient::start()

{

tcpSocket->abort();

tcpSocket->connectToHost(serverIP, serverPort);

timerData->start();

timerConn->start();

timerHeart->start();

return true;

}

void FaceSdkClient::stop()

{

tcpSocket->disconnectFromHost();

timerData->stop();

timerConn->stop();

timerHeart->stop();

}

void FaceSdkClient::sendData(const QString &body)

{

if (!isOk) {

return;

}

//构建xml字符串

QStringList list;

list.append(QString("<FaceClient DeviceIP=\"%1\">").arg(clientIP));

list.append(body);

list.append("</FaceClient>");

QString data = DeviceFun::getSendXmlData(list.join(""), "IFACE:");

tcpSocket->write(data.toUtf8());

emit sendData(clientIP, data);

}

void FaceSdkClient::sendHeart()

{

if (!isOk) {

return;

}

sendData("<DeviceHeart/>");

emit sendAnaly(clientIP, "发送心跳");

}

void FaceSdkClient::sendFindFace(const QString &faceID, const QImage &image)

{

if (!isOk) {

return;

}

QString data = QString("<FindFace FaceID=\"%1\">%2</FindFace>").arg(faceID).arg(DeviceFun::getImageData(image));

sendData(data);

emit sendAnaly(clientIP, "请求人脸区域");

}

void FaceSdkClient::sendFindFeature(const QString &faceID, const QImage &image)

{

if (!isOk) {

return;

}

QString data = QString("<FindFeature FaceID=\"%1\">%2</FindFeature>").arg(faceID).arg(DeviceFun::getImageData(image));

sendData(data);

emit sendAnaly(clientIP, "请求人脸特征");

}

void FaceSdkClient::sendFindLive(const QString &faceID, const QImage &image)

{

if (!isOk) {

return;

}

QString data = QString("<FindLive FaceID=\"%1\">%2</FindLive>").arg(faceID).arg(DeviceFun::getImageData(image));

sendData(data);

emit sendAnaly(clientIP, "请求活体检测");

}

void FaceSdkClient::sendCompareByImage(const QString &faceID1, const QImage &image1,

const QString &faceID2, const QImage &image2)

{

if (!isOk) {

return;

}

QStringList list;

list.append("<CompareByImage>");

list.append(QString("<FaceImage1 FaceID=\"%1\">%2</FaceImage1>").arg(faceID1).arg(DeviceFun::getImageData(image1)));

list.append(QString("<FaceImage2 FaceID=\"%1\">%2</FaceImage2>").arg(faceID2).arg(DeviceFun::getImageData(image2)));

list.append("</CompareByImage>");

sendData(list.join(""));

emit sendAnaly(clientIP, "请求人脸比对");

}

void FaceSdkClient::sendCompareByFeature(const QString &faceID1, const QString &feature1,

const QString &faceID2, const QString &feature2)

{

if (!isOk) {

return;

}

QStringList list;

list.append("<CompareByFeature>");

list.append(QString("<FaceFeature1 FaceID=\"%1\">%2</FaceFeature1>").arg(faceID1).arg(feature1));

list.append(QString("<FaceFeature2 FaceID=\"%1\">%2</FaceFeature2>").arg(faceID2).arg(feature2));

list.append("</CompareByFeature>");

sendData(list.join(""));

emit sendAnaly(clientIP, "请求人脸比对");

}

void FaceSdkClient::sendAppendFace(const QString &faceID, const QImage &image)

{

if (!isOk) {

return;

}

QString data = QString("<AppendFace FaceID=\"%1\">%2</AppendFace>").arg(faceID).arg(DeviceFun::getImageData(image));

sendData(data);

emit sendAnaly(clientIP, "添加人脸");

}

void FaceSdkClient::sendDeleteFace(const QString &faceID)

{

if (!isOk) {

return;

}

QString data = QString("<DeleteFace FaceID=\"%1\" />").arg(faceID);

sendData(data);

emit sendAnaly(clientIP, "删除人脸");

}

void FaceSdkClient::sendFindByImage(const QString &faceID, const QImage &image)

{

if (!isOk) {

return;

}

QString data = QString("<FindByImage FaceID=\"%1\">%2</FindByImage>").arg(faceID).arg(DeviceFun::getImageData(image));

sendData(data);

emit sendAnaly(clientIP, "查找最大人脸");

}

void FaceSdkClient::sendFindByFeature(const QString &faceID, const QString &feature)

{

if (!isOk) {

return;

}

QString data = QString("<FindByFeature FaceID=\"%1\">%2</FindByFeature>").arg(faceID).arg(feature);

sendData(data);

emit sendAnaly(clientIP, "查找最大人脸");

}

Qt音视频开发42-人脸识别客户端的更多相关文章

- Android IOS WebRTC 音视频开发总结(八十五)-- 使用WebRTC广播网络摄像头视频(下)

本文主要介绍WebRTC (我们翻译和整理的,译者:weizhenwei,校验:blacker),最早发表在[编风网] 支持原创,转载必须注明出处,欢迎关注我的微信公众号blacker(微信ID:bl ...

- WebRTC 音视频开发

WebRTC 音视频开发 webrtc Android IOS WebRTC 音视频开发总结(七八)-- 为什么WebRTC端到端监控很关键? 摘要: 本文主要介绍WebRTC端到端监控(我们翻译 ...

- 转:Android IOS WebRTC 音视频开发总结 (系列文章集合)

随笔分类 - webrtc Android IOS WebRTC 音视频开发总结(七八)-- 为什么WebRTC端到端监控很关键? 摘要: 本文主要介绍WebRTC端到端监控(我们翻译和整理的,译 ...

- Android开发 音视频开发需要了解的专业术语知识

前言 在摸索一段时间的音视频开发后,越来越发现这个坑的深度真是特别的深. 除了了解Android自带的音视频处理API以外,还得了解一些视频与音频方面的知识.这篇博客就是主要讲解这方面的专业术语.内容 ...

- Python音视频开发:消除抖音短视频Logo的图形化工具实现

☞ ░ 前往老猿Python博文目录 ░ 一.引言 在<Python音视频开发:消除抖音短视频Logo和去电视台标的实现详解>节介绍了怎么通过Python+Moviepy+OpenCV实现 ...

- Python音视频开发:消除抖音短视频Logo和去电视台标

☞ ░ 前往老猿Python博文目录 ░ 一.引言 对于带Logo(如抖音Logo.电视台标)的视频,有三种方案进行Logo消除: 直接将对应区域用对应图像替换: 直接将对应区域模糊化: 通过变换将要 ...

- Moviepy音视频开发:视频转gif动画或jpg图片exe图形化工具开发案例

☞ ░ 前往老猿Python博文目录 ░ 一.引言 老猿之所以学习和研究Moviepy的使用,是因为需要一个将视频转成动画的工具,当时在网上到处搜索查找免费使用工具,结果找了很多自称免费的工具,但转完 ...

- 【秒懂音视频开发】02_Windows开发环境搭建

音视频开发库的选择 每个主流平台基本都有自己的音视频开发库(API),用以处理音视频数据,比如: iOS:AVFoundation.AudioUnit等 Android:MediaPlayer.Med ...

- Android音视频开发(1):H264 基本原理

前言 H264 视频压缩算法现在无疑是所有视频压缩技术中使用最广泛,最流行的.随着 x264/openh264 以及 ffmpeg 等开源库的推出,大多数使用者无需再对H264的细节做过多的研究,这大 ...

- Android IOS WebRTC 音视频开发总结(八十三)-- 使用WebRTC广播网络摄像头视频(上)

本文主要介绍WebRTC (我们翻译和整理的,译者:weizhenwei,校验:blacker),最早发表在[编风网] 支持原创,转载必须注明出处,欢迎关注我的微信公众号blacker(微信ID:bl ...

随机推荐

- 007 Python、Anaconda、pip、Pycharm、Jupyter都是啥?

博客配套视频链接: https://space.bilibili.com/383551518?spm_id_from=333.1007.0.0 b 站直接看 配套 github 链接:https:// ...

- charles+Nox

Charles设置 一.添加SSL证书  \cdot\mathbf{n}=0 \] ...

- 什么是 Nodejs

这集来聊什么是 Nodejs ,看看 Node.js 是为了解决什么样的痛点而生的,为啥说它是一个 JS 的运行环境,以及 npm 是什么,为何能引发了 Web 开发的革命. Node.js 的诞生 ...

- @RequestBody注解转对象中驼峰格式的参数无法接收到数据的问题解决方法

1.问题:驼峰格式的参数传递到后端,@RequestBody注解标注的实体对象参数没有接收到对应的数据 前端传参:执行结果:请求参数实体: import lombok.Data; /** * 请求参数 ...

- Vue2.x 常用功能和方法

Vue 生命周期 beforeCreate (组件实例刚被创建,组件属性计算之前,如 data 属性等) created (组件实例创建完成, 属性已绑定,但 DOM 还未生成, $el 属性不存在) ...

- WPS Excel中配置下拉多选(VBA)

网上找到两种方案,一种利用数据选择其他单元格,也就是在其他单元格建数据.需求是模板,不合适 这里我用的VBA,踩了挺多坑,详细说下 首先更新WPS为最新版,确保可用VBA和JSA 确定使用VBA还是J ...

- Socket编程与IO多路复用

0.引言 本篇博客将从socket模型为起点,引入IO多路复用的学习. 1.Socket模型 1.1.Socket的诞生 Socket的诞生背景: Socket最早出现在20实际80年代的Unix操作 ...

- CF207C3 Game with Two Trees

CF207C3 Game with Two Trees 妙到家的树上字符串问题. 约定 树 \(1\):\(t_1\). 树 \(2\):\(t_2\). \(S_{1/2}(i,l)\) 为树 \( ...

- CSP2023 游寄

CSP2023 游寄 没错,又寄. day -n 停课集训,天天打联测模拟赛,人麻了. day -n 请假回家了,人更麻了. 和姐姐拥抱了. 差点睡过头,天天下大雨,悲. 我妈和亲戚出去了,和哥在家通 ...