Python爬虫实战之提高CSDN访问量

python爬虫之建立代理池(一)_CodingInCV的博客-CSDN博客

python爬虫之建立代理池(二)_CodingInCV的博客-CSDN博客

前面2篇分别介绍了从2个免费代理网站爬取免费代理来构建我们自己的代理池。这一篇我们从实战的角度来将我们的代理池用起来,通过代理的方式访问我们的CSDN博客(CSDN会认为是一次访问,访问量+1),从而实现访问量的增长,仅供学习爬虫使用···

获取博客文章列表和链接

获取博客列表的链接是https://blog.csdn.net/xxx/article/list/, 通过在后面添加页数,获取不同页的博客列表。

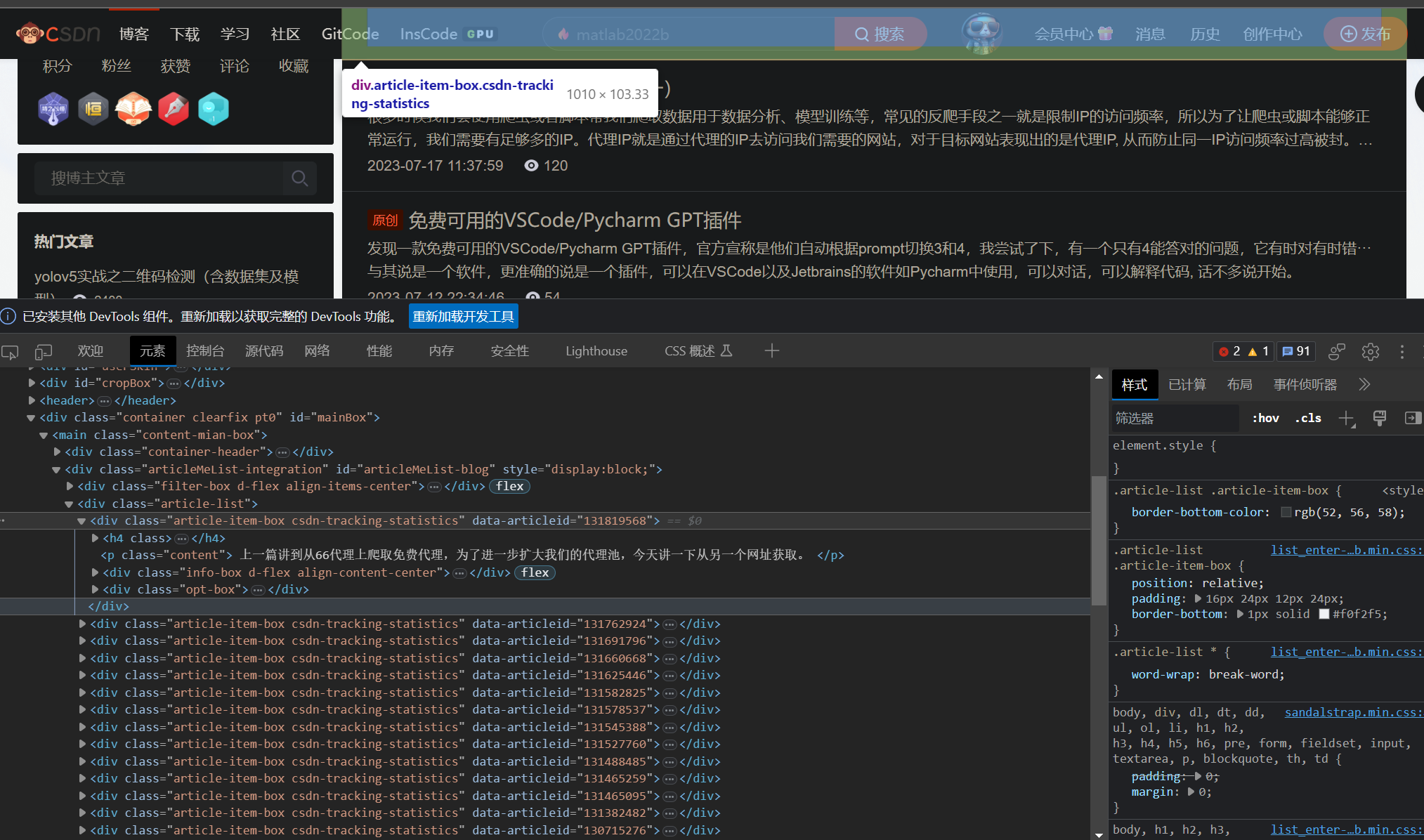

通过分析页面的html,我们可以知道文章都在html的“article-item-box”中,因此我们可以通过在返回的html中查找“article-item-box”来得到所有的文章链接。

html_text = requests.get(url=url, headers=type(self).headers).text

arts = []

soup = BeautifulSoup(html_text, 'html.parser')

articles = soup.findAll('div', {"class": "article-item-box"})

for art in articles:

tag_a = art.find_next('a') # 搜索a标签

url = tag_a.attrs['href'] # 文章链接

read_num = int((art.find_next('span', {'class': 'read-num'}).text)) # 文章阅读数量

title = tag_a.text.replace('\n', '') # 文章标题

arts.append({

'title': title,

'url': url,

'read_num': read_num

})

通过代理访问CSDN文章

proxy = self.local_proxy.get_one_proxy()

blog = self.csdn_blog.get_one_blog()

blog_url = blog['url']

headers = {

'User-Agent': self._refresh_headers()

}

proxies = {

k:v for k, v in proxy.items() if k !="unusable_cnt"

}

r = requests.get(blog_url, headers=headers, proxies=proxies, timeout=5)

if r.status_code != 200:

raise Exception('status_code is not 200')

通过设置requests接口的proxies参数,即可以代理的方式访问CSDN的博客。为了更像一个真正的浏览器,我们还要经常切换User-Agent,也就是浏览器的头。

进阶

User-Agent

The Latest and Most Common User Agents List (Updated Weekly)

我们可以从这个网站下载User-Agent列表,每次访问时从中随机一个。

代理池管理

前面只是从代理网站爬取了代理,为了有效管理,我们可以在这些代理基础上,进一步开发代理池的持久化功能,比如当有代理增加或者删除时,立即保存到本地;也可以将代理保存到redis, 实时更新,要获取代理时,也从redis中获取。简单起见,这里以保存到本地json为例:

class ProxyPool:

lock = Lock()

def __init__(self):

self.proxy_file = "proxy.json"

self.proxies = {}

self.load_proxies()

def _dump_proxies(self):

with self.lock:

with open(self.proxy_file, "w") as f:

json.dump(self.proxies, f)

def load_proxies(self):

if not os.path.exists(self.proxy_file):

return

with open(self.proxy_file, "r") as f:

self.proxies = json.load(f)

def set_proxies(self, proxies):

self.proxies.update(proxies)

self._dump_proxies()

def get_one_proxy(self):

if len(self.proxies) == 0:

return None

proxy = random.choice(list(self.proxies.keys()))

return json.loads(proxy)

def get_unusable_cnt(self, proxy):

proxy = json.dumps(proxy)

if proxy not in self.proxies:

return 0

return self.proxies[proxy]

def remove_proxy(self, proxy):

proxy = json.dumps(proxy)

if proxy not in self.proxies:

return

self.proxies.pop(proxy)

self._dump_proxies()

def update_proxy_unusable_cnt(self, proxy, cnt=0):

proxy = json.dumps(proxy)

if proxy not in self.proxies:

return

self.proxies[proxy] = cnt

self._dump_proxies()

定时爬取最新的代理和文章列表

可以借助apscheduler建立2个定时任务,免去自己手动实现定时任务:

from apscheduler.schedulers.blocking import BlockingScheduler

self.scheduler = BlockingScheduler()

self.scheduler.add_job(self._refresh_proxy_and_blog, 'interval', hours=24, next_run_time=datetime.now())

self.scheduler.add_job(self.read_jobs, 'interval', hours=24,next_run_time=datetime.now())

完整代码:

面包多:https://mbd.pub/o/bread/ZJuam5lx

Python爬虫实战之提高CSDN访问量的更多相关文章

- Python爬虫实战——反爬策略之模拟登录【CSDN】

在<Python爬虫实战-- Request对象之header伪装策略>中,我们就已经讲到:=="在header当中,我们经常会添加两个参数--cookie 和 User-Age ...

- 路飞学城—Python爬虫实战密训班 第三章

路飞学城—Python爬虫实战密训班 第三章 一.scrapy-redis插件实现简单分布式爬虫 scrapy-redis插件用于将scrapy和redis结合实现简单分布式爬虫: - 定义调度器 - ...

- 路飞学城—Python爬虫实战密训班 第二章

路飞学城—Python爬虫实战密训班 第二章 一.Selenium基础 Selenium是一个第三方模块,可以完全模拟用户在浏览器上操作(相当于在浏览器上点点点). 1.安装 - pip instal ...

- 【图文详解】python爬虫实战——5分钟做个图片自动下载器

python爬虫实战——图片自动下载器 之前介绍了那么多基本知识[Python爬虫]入门知识,(没看的先去看!!)大家也估计手痒了.想要实际做个小东西来看看,毕竟: talk is cheap sho ...

- Python爬虫实战(4):豆瓣小组话题数据采集—动态网页

1, 引言 注释:上一篇<Python爬虫实战(3):安居客房产经纪人信息采集>,访问的网页是静态网页,有朋友模仿那个实战来采集动态加载豆瓣小组的网页,结果不成功.本篇是针对动态网页的数据 ...

- Python爬虫实战(2):爬取京东商品列表

1,引言 在上一篇<Python爬虫实战:爬取Drupal论坛帖子列表>,爬取了一个用Drupal做的论坛,是静态页面,抓取比较容易,即使直接解析html源文件都可以抓取到需要的内容.相反 ...

- Python爬虫实战四之抓取淘宝MM照片

原文:Python爬虫实战四之抓取淘宝MM照片其实还有好多,大家可以看 Python爬虫学习系列教程 福利啊福利,本次为大家带来的项目是抓取淘宝MM照片并保存起来,大家有没有很激动呢? 本篇目标 1. ...

- Python爬虫实战---抓取图书馆借阅信息

Python爬虫实战---抓取图书馆借阅信息 原创作品,引用请表明出处:Python爬虫实战---抓取图书馆借阅信息 前段时间在图书馆借了很多书,借得多了就容易忘记每本书的应还日期,老是担心自己会违约 ...

- Python爬虫实战七之计算大学本学期绩点

大家好,本次为大家带来的项目是计算大学本学期绩点.首先说明的是,博主来自山东大学,有属于个人的学生成绩管理系统,需要学号密码才可以登录,不过可能广大读者没有这个学号密码,不能实际进行操作,所以最主要的 ...

- Python爬虫实战八之利用Selenium抓取淘宝匿名旺旺

更新 其实本文的初衷是为了获取淘宝的非匿名旺旺,在淘宝详情页的最下方有相关评论,含有非匿名旺旺号,快一年了淘宝都没有修复这个. 可就在今天,淘宝把所有的账号设置成了匿名显示,SO,获取非匿名旺旺号已经 ...

随机推荐

- Azure DevOps(二)Azure Pipeline 集成 SonarQube 维护代码质量和安全性

一,引言 对于今天所分析的 SonarQube,首先我们得了解什么是 SonarQube ? SonarQube 又能帮我们做什么?我们是否在项目开发的过程中遇到人为 Review 代码审核规范?带着 ...

- C# 打开蓝牙设置界面

蓝牙设置相关界面,以下是通过C#方式打开的几个方式,记录一下 蓝牙设置界面 1.控制面板命令bthprops.cpl 可以用控制面板 control+bthprops.cpl,也可以直接bthprop ...

- Kubernetes Gateway API 深入解读和落地指南

背景 Kubernetes Gateway API 是 Kubernetes 1.18 版本引入的一种新的 API 规范,是 Kubernetes 官方正在开发的新的 API,Ingress 是 Ku ...

- 2022-03-17:所有黑洞的中心点记录在holes数组里, 比如[[3,5] [6,9]]表示,第一个黑洞在(3,5),第二个黑洞在(6,9), 并且所有黑洞的中心点都在左下角(0,0),右上角(

2022-03-17:所有黑洞的中心点记录在holes数组里, 比如[[3,5] [6,9]]表示,第一个黑洞在(3,5),第二个黑洞在(6,9), 并且所有黑洞的中心点都在左下角(0,0),右上角( ...

- 2021-04-04:给定一个非负数组arr,和一个正数m。 返回arr的所有子序列中累加和%m之后的最大值。

2021-04-04:给定一个非负数组arr,和一个正数m. 返回arr的所有子序列中累加和%m之后的最大值. 福大大 答案2021-04-04: 自然智慧即可. 1.递归,累加和. 2.动态规划,累 ...

- golang基础面试题,不完整

启动流程 Q.go的init函数是什么时候执行的? Q.多个init函数执行顺序能保证吗? Q.go init 的执行顺序,注意是不按导入规则的(这里是编译时按文件名的顺序执行的) Q.init函数能 ...

- 2021-10-28:打家劫舍 II。你是一个专业的小偷,计划偷窃沿街的房屋,每间房内都藏有一定的现金。这个地方所有的房屋都 围成一圈 ,这意味着第一个房屋和最后一个房屋是紧挨着的。同时,相邻的房屋装

2021-10-28:打家劫舍 II.你是一个专业的小偷,计划偷窃沿街的房屋,每间房内都藏有一定的现金.这个地方所有的房屋都 围成一圈 ,这意味着第一个房屋和最后一个房屋是紧挨着的.同时,相邻的房屋装 ...

- Python潮流周刊#5:并发一百万个任务要用多少内存?

你好,我是猫哥.这里记录每周值得分享的 Python 及通用技术内容,部分为英文,已在小标题注明.(标题取自其中一则分享,不代表全部内容都是该主题,特此声明.) 博客原文:https://python ...

- kotlin 函数格式大赏

fun main() { // 一个有引用的lambda表达式 val f11: (Int, Int) -> Unit = {n1, n2 -> println("f11 is ...

- 园子的商业化努力-行行AI人才培养「常青藤计划」

各位园子的小伙伴: 感谢大家长期对园子的支持,AI大模型出现之后,各行各业都在积极思考如何应对,如何把业务场景和AI结合.在这个过程中,AI人才缺乏是最核心的问题. 基于此,园子打算在AI人才培养方面 ...