3 基于梯度的攻击——MIM

MIM攻击原论文地址——https://arxiv.org/pdf/1710.06081.pdf

1.MIM攻击的原理

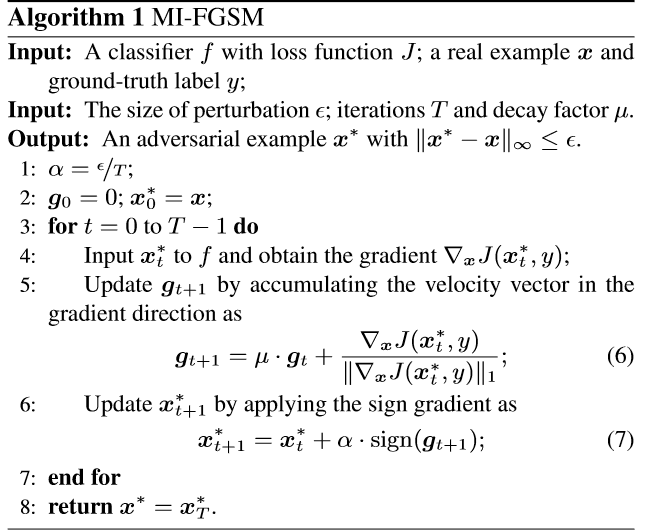

MIM攻击全称是 Momentum Iterative Method,其实这也是一种类似于PGD的基于梯度的迭代攻击算法。它的本质就是,在进行迭代的时候,每一轮的扰动不仅与当前的梯度方向有关,还与之前算出来的梯度方向相关。其中的衰减因子就是用来调节相关度的,decay_factor在(0,1)之间,decay_factor越小,迭代轮数靠前算出来的梯度对当前的梯度方向影响越小。由于之前的梯度对后面的迭代也有影响,迭代的方向不会跑偏,总体的大方向是对的。

为了加速梯度下降,通过累积损失函数的梯度方向上的矢量,从而(1)稳定更新(2)有助于通过 narrow valleys, small humps and poor local minima or maxima.(大致意思就是,可以有效避免局部最优)

是decay_factor, 另外,在原论文中,每一次迭代对x的导数是直接算的1-范数,然后求平均,但在各个算法库以及论文实现的补充中,并没有求平均,估计这个对结果影响不太大。

是decay_factor, 另外,在原论文中,每一次迭代对x的导数是直接算的1-范数,然后求平均,但在各个算法库以及论文实现的补充中,并没有求平均,估计这个对结果影响不太大。

2.代码实现

class MomentumIterativeAttack(Attack, LabelMixin):

"""

The L-inf projected gradient descent attack (Dong et al. 2017).

The attack performs nb_iter steps of size eps_iter, while always staying

within eps from the initial point. The optimization is performed with

momentum.

Paper: https://arxiv.org/pdf/1710.06081.pdf

""" def __init__(

self, predict, loss_fn=None, eps=0.3, nb_iter=40, decay_factor=1.,

eps_iter=0.01, clip_min=0., clip_max=1., targeted=False):

"""

Create an instance of the MomentumIterativeAttack. :param predict: forward pass function.

:param loss_fn: loss function.

:param eps: maximum distortion.

:param nb_iter: number of iterations

:param decay_factor: momentum decay factor.

:param eps_iter: attack step size.

:param clip_min: mininum value per input dimension.

:param clip_max: maximum value per input dimension.

:param targeted: if the attack is targeted.

"""

super(MomentumIterativeAttack, self).__init__(

predict, loss_fn, clip_min, clip_max)

self.eps = eps

self.nb_iter = nb_iter

self.decay_factor = decay_factor

self.eps_iter = eps_iter

self.targeted = targeted

if self.loss_fn is None:

self.loss_fn = nn.CrossEntropyLoss(reduction="sum") def perturb(self, x, y=None):

"""

Given examples (x, y), returns their adversarial counterparts with

an attack length of eps. :param x: input tensor.

:param y: label tensor.

- if None and self.targeted=False, compute y as predicted

labels.

- if self.targeted=True, then y must be the targeted labels.

:return: tensor containing perturbed inputs.

"""

x, y = self._verify_and_process_inputs(x, y) delta = torch.zeros_like(x)

g = torch.zeros_like(x) delta = nn.Parameter(delta) for i in range(self.nb_iter): if delta.grad is not None:

delta.grad.detach_()

delta.grad.zero_() imgadv = x + delta

outputs = self.predict(imgadv)

loss = self.loss_fn(outputs, y)

if self.targeted:

loss = -loss

loss.backward() g = self.decay_factor * g + normalize_by_pnorm(

delta.grad.data, p=1)

# according to the paper it should be .sum(), but in their

# implementations (both cleverhans and the link from the paper)

# it is .mean(), but actually it shouldn't matter delta.data += self.eps_iter * torch.sign(g)

# delta.data += self.eps / self.nb_iter * torch.sign(g) delta.data = clamp(

delta.data, min=-self.eps, max=self.eps)

delta.data = clamp(

x + delta.data, min=self.clip_min, max=self.clip_max) - x rval = x + delta.data

return rval

有人认为,advertorch中在迭代过程中,应该是对imgadv求导,而不是对delta求导,foolbox和cleverhans的实现都是对每一轮的对抗样本求导。

3 基于梯度的攻击——MIM的更多相关文章

- 4.基于梯度的攻击——MIM

MIM攻击原论文地址——https://arxiv.org/pdf/1710.06081.pdf 1.MIM攻击的原理 MIM攻击全称是 Momentum Iterative Method,其实这也是 ...

- 2.基于梯度的攻击——FGSM

FGSM原论文地址:https://arxiv.org/abs/1412.6572 1.FGSM的原理 FGSM的全称是Fast Gradient Sign Method(快速梯度下降法),在白盒环境 ...

- 1 基于梯度的攻击——FGSM

FGSM原论文地址:https://arxiv.org/abs/1412.6572 1.FGSM的原理 FGSM的全称是Fast Gradient Sign Method(快速梯度下降法),在白盒环境 ...

- 3.基于梯度的攻击——PGD

PGD攻击原论文地址——https://arxiv.org/pdf/1706.06083.pdf 1.PGD攻击的原理 PGD(Project Gradient Descent)攻击是一种迭代攻击,可 ...

- 2 基于梯度的攻击——PGD

PGD攻击原论文地址——https://arxiv.org/pdf/1706.06083.pdf 1.PGD攻击的原理 PGD(Project Gradient Descent)攻击是一种迭代攻击,可 ...

- 5.基于优化的攻击——CW

CW攻击原论文地址——https://arxiv.org/pdf/1608.04644.pdf 1.CW攻击的原理 CW攻击是一种基于优化的攻击,攻击的名称是两个作者的首字母.首先还是贴出攻击算法的公 ...

- 基于梯度场和Hessian特征值分别获得图像的方向场

一.我们想要求的方向场的定义为: 对于任意一点(x,y),该点的方向可以定义为其所在脊线(或谷线)位置的切线方向与水平轴之间的夹角: 将一条直线顺时针或逆时针旋转 180°,直线的方向保持不变. 因 ...

- 4 基于优化的攻击——CW

CW攻击原论文地址——https://arxiv.org/pdf/1608.04644.pdf 1.CW攻击的原理 CW攻击是一种基于优化的攻击,攻击的名称是两个作者的首字母.首先还是贴出攻击算法的公 ...

- C / C ++ 基于梯度下降法的线性回归法(适用于机器学习)

写在前面的话: 在第一学期做项目的时候用到过相应的知识,觉得挺有趣的,就记录整理了下来,基于C/C++语言 原贴地址:https://helloacm.com/cc-linear-regression ...

随机推荐

- C# 列排序

private void button2_Click(object sender, EventArgs e) { DataTable dt = new DataTable(); dt.Columns. ...

- CDOJ 1255 斓少摘苹果 图论 2016_5_14

斓少摘苹果 Time Limit: 3000/3000MS (Java/Others) Memory Limit: 65535/65535KB (Java/Others) Submit St ...

- 深度学习笔记(十一)网络 Inception, Xception, MobileNet, ShuffeNet, ResNeXt, SqueezeNet, EfficientNet, MixConv

1. Abstract 本文旨在简单介绍下各种轻量级网络,纳尼?!好吧,不限于轻量级 2. Introduction 2.1 Inception 在最初的版本 Inception/GoogleNet, ...

- 对iOS锁的一些研究

#import <objc/runtime.h> #import <objc/message.h> #import <libkern/OSAtomic.h> #im ...

- zookeeper系列(二)zookeeper的使用--javaAPI

作者:leesf 掌控之中,才会成功:掌控之外,注定失败: 出处:http://www.cnblogs.com/leesf456/ (尊重原创,感谢作者整理的这么好,作者的部分内容添加了我的理解 ...

- Java - 可循环队列

队列是一种特殊的线性表,是一种先进先出的数据结构.只允许在表的前端进行删除操作,在表的后端进行插入操作.进行插入操作的端称为队尾,进行删除操作的端称为队头.队列中没有元素时,称为空队列. 简单的循环队 ...

- win10无法连接windows服务器,无法连接SENS服务

本文链接:https://blog.csdn.net/weixin_38374974/article/details/80475566 膜拜大佬 首先,进入windows界面的时候,前期加载速度变得极 ...

- leetcode-hard-array-239. Sliding Window Maximum

mycode 89.27% class Solution(object): def maxSlidingWindow(self, nums, k): """ :type ...

- 在jdk7下慎用String.intern()作为synchronized的对象锁

有一段这样的代码: for (int i = 0; i < 10000000; i++) { ("bluedavy" + i).intern(); if(i % 100 == ...

- Django之缓存配置

01-什么是缓存 缓存(cache),其作用是缓和较慢存储的高频次请求,简单来说,就是加速满存储的访问效率. 02-几种缓存配置 # 内存缓存:local-memory caching CACHES ...