spark 源码分析之三 -- LiveListenerBus介绍

LiveListenerBus

官方说明如下:

Asynchronously passes SparkListenerEvents to registered SparkListeners.

即它的功能是异步地将SparkListenerEvent传递给已经注册的SparkListener,这种异步的机制是通过生产消费者模型来实现的。

首先,它定义了 4 个 消息堵塞队列,队列的名字分别为shared、appStatus、executorManagement、eventLog。队列的类型是 org.apache.spark.scheduler.AsyncEventQueue#AsyncEventQueue,保存在 queues 变量中。每一个队列上都可以注册监听器,如果队列没有监听器,则会被移除。

它有启动和stop和start两个标志位来指示 监听总线的的启动停止状态。 如果总线没有启动,有事件过来,先放到 一个待添加的可变数组中,否则直接将事件 post 到每一个队列中。

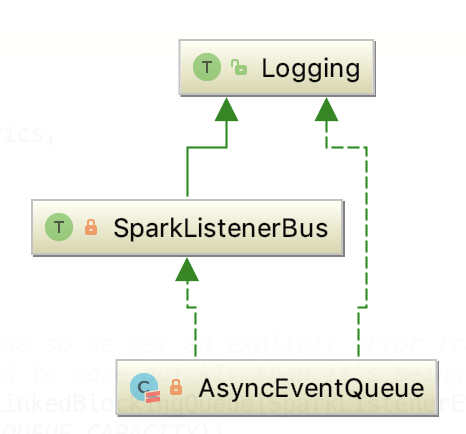

其直接依赖类是 AsyncEventQueue, 相当于 LiveListenerBus 的多事件队列是对 AsyncEventQueue 进一步的封装。

AsyncEventQueue

其继承关系如下:

它有启动和stop和start两个标志位来指示 监听总线的的启动停止状态。

其内部维护了listenersPlusTimers 主要就是用来保存注册到这个总线上的监听器对象的。

post 操作将事件放入内部的 LinkedBlockingQueue中,默认大小是 10000。

有一个事件分发器,它不停地从 LinkedBlockingQueue 执行 take 操作,获取事件,并将事件进一步分发给所有的监听器,由org.apache.spark.scheduler.SparkListenerBus#doPostEvent 方法实现事件转发,具体代码如下:

1 protected override def doPostEvent(

2 listener: SparkListenerInterface,

3 event: SparkListenerEvent): Unit = {

4 event match {

5 case stageSubmitted: SparkListenerStageSubmitted =>

6 listener.onStageSubmitted(stageSubmitted)

7 case stageCompleted: SparkListenerStageCompleted =>

8 listener.onStageCompleted(stageCompleted)

9 case jobStart: SparkListenerJobStart =>

10 listener.onJobStart(jobStart)

11 case jobEnd: SparkListenerJobEnd =>

12 listener.onJobEnd(jobEnd)

13 case taskStart: SparkListenerTaskStart =>

14 listener.onTaskStart(taskStart)

15 case taskGettingResult: SparkListenerTaskGettingResult =>

16 listener.onTaskGettingResult(taskGettingResult)

17 case taskEnd: SparkListenerTaskEnd =>

18 listener.onTaskEnd(taskEnd)

19 case environmentUpdate: SparkListenerEnvironmentUpdate =>

20 listener.onEnvironmentUpdate(environmentUpdate)

21 case blockManagerAdded: SparkListenerBlockManagerAdded =>

22 listener.onBlockManagerAdded(blockManagerAdded)

23 case blockManagerRemoved: SparkListenerBlockManagerRemoved =>

24 listener.onBlockManagerRemoved(blockManagerRemoved)

25 case unpersistRDD: SparkListenerUnpersistRDD =>

26 listener.onUnpersistRDD(unpersistRDD)

27 case applicationStart: SparkListenerApplicationStart =>

28 listener.onApplicationStart(applicationStart)

29 case applicationEnd: SparkListenerApplicationEnd =>

30 listener.onApplicationEnd(applicationEnd)

31 case metricsUpdate: SparkListenerExecutorMetricsUpdate =>

32 listener.onExecutorMetricsUpdate(metricsUpdate)

33 case executorAdded: SparkListenerExecutorAdded =>

34 listener.onExecutorAdded(executorAdded)

35 case executorRemoved: SparkListenerExecutorRemoved =>

36 listener.onExecutorRemoved(executorRemoved)

37 case executorBlacklistedForStage: SparkListenerExecutorBlacklistedForStage =>

38 listener.onExecutorBlacklistedForStage(executorBlacklistedForStage)

39 case nodeBlacklistedForStage: SparkListenerNodeBlacklistedForStage =>

40 listener.onNodeBlacklistedForStage(nodeBlacklistedForStage)

41 case executorBlacklisted: SparkListenerExecutorBlacklisted =>

42 listener.onExecutorBlacklisted(executorBlacklisted)

43 case executorUnblacklisted: SparkListenerExecutorUnblacklisted =>

44 listener.onExecutorUnblacklisted(executorUnblacklisted)

45 case nodeBlacklisted: SparkListenerNodeBlacklisted =>

46 listener.onNodeBlacklisted(nodeBlacklisted)

47 case nodeUnblacklisted: SparkListenerNodeUnblacklisted =>

48 listener.onNodeUnblacklisted(nodeUnblacklisted)

49 case blockUpdated: SparkListenerBlockUpdated =>

50 listener.onBlockUpdated(blockUpdated)

51 case speculativeTaskSubmitted: SparkListenerSpeculativeTaskSubmitted =>

52 listener.onSpeculativeTaskSubmitted(speculativeTaskSubmitted)

53 case _ => listener.onOtherEvent(event)

54 }

55 }

然后去调用 listener 的相对应的方法。

就这样,事件总线上的消息事件被监听器消费了。

spark 源码分析之三 -- LiveListenerBus介绍的更多相关文章

- Spark源码分析之三:Stage划分

继上篇<Spark源码分析之Job的调度模型与运行反馈>之后,我们继续来看第二阶段--Stage划分. Stage划分的大体流程如下图所示: 前面提到,对于JobSubmitted事件,我 ...

- spark 源码分析之十九 -- Stage的提交

引言 上篇 spark 源码分析之十九 -- DAG的生成和Stage的划分 中,主要介绍了下图中的前两个阶段DAG的构建和Stage的划分. 本篇文章主要剖析,Stage是如何提交的. rdd的依赖 ...

- Spark 源码分析系列

如下,是 spark 源码分析系列的一些文章汇总,持续更新中...... Spark RPC spark 源码分析之五--Spark RPC剖析之创建NettyRpcEnv spark 源码分析之六- ...

- spark源码分析以及优化

第一章.spark源码分析之RDD四种依赖关系 一.RDD四种依赖关系 RDD四种依赖关系,分别是 ShuffleDependency.PrunDependency.RangeDependency和O ...

- Spark源码分析(三)-TaskScheduler创建

原创文章,转载请注明: 转载自http://www.cnblogs.com/tovin/p/3879151.html 在SparkContext创建过程中会调用createTaskScheduler函 ...

- 【转】Spark源码分析之-deploy模块

原文地址:http://jerryshao.me/architecture/2013/04/30/Spark%E6%BA%90%E7%A0%81%E5%88%86%E6%9E%90%E4%B9%8B- ...

- Spark源码分析:多种部署方式之间的区别与联系(转)

原文链接:Spark源码分析:多种部署方式之间的区别与联系(1) 从官方的文档我们可以知道,Spark的部署方式有很多种:local.Standalone.Mesos.YARN.....不同部署方式的 ...

- Spark源码分析之九:内存管理模型

Spark是现在很流行的一个基于内存的分布式计算框架,既然是基于内存,那么自然而然的,内存的管理就是Spark存储管理的重中之重了.那么,Spark究竟采用什么样的内存管理模型呢?本文就为大家揭开Sp ...

- Spark源码分析之八:Task运行(二)

在<Spark源码分析之七:Task运行(一)>一文中,我们详细叙述了Task运行的整体流程,最终Task被传输到Executor上,启动一个对应的TaskRunner线程,并且在线程池中 ...

随机推荐

- Kafka笔记7

Kafka提供了一些命令行工具,用于管理集群变更.这些工具使用Java实现,Kafka提供了一些脚本调用这些Java类. 9.1主题操作 使用Kafka-topics.sh工具可以执行主题大部分工作, ...

- 我整理的一份来自于线上的Nginx配置(Nginx.conf),希望对学习Nginx的有帮助

我整理了一份Nginx的配置文件说明,是真正经历过正式线上考验过.如果有优化的地方,也请朋友们指点一二,整理出一份比较全而实用的配置. 主要包含配置:负载均衡配置,页面重定向,转发,HTTPS和HTT ...

- Hexo+NexT(六):手把手教你编写一个Hexo过滤器插件

Hexo+NexT介绍到这里,我认为已经可以很好地完成任务了.它所提供的一些基础功能及配置,都已经进行了讲解.你已经可以随心所欲地配置一个自己的博客环境,然后享受码字的乐趣. 把博客托管到Github ...

- 曹工说Tomcat1:从XML解析说起

一.前言 第一次被人喊曹工,我相当诧异,那是有点久的事情了,楼主13年校招进华为,14年在东莞出差,给东莞移动的通信设备进行版本更新.他们那边的一个小伙子来接我的时候,这么叫我的,刚听到的时候,心里一 ...

- 补习系列(21)-SpringBoot初始化之7招式

目录 背景 1. @PostConstruct 注解 2. InitializingBean 接口 3. @Bean initMethod方法 4. 构造器注入 5. ApplicationListe ...

- Scala 学习之路(三)—— 流程控制语句

一.条件表达式if Scala中的if/else语法结构与Java中的一样,唯一不同的是,Scala中的if表达式是有返回值的. object ScalaApp extends App { val x ...

- 初步接触 Java Net 网络编程

本文目的是大概了解 Java 网络编程体系,需要一点点 Java IO 基础,推荐教程 系统学习 Java IO.主要参考 JavaDoc 和 Jakob Jenkov 的英文教程<Java N ...

- 【设计模式】行为型06命令模式(Command Pattern)

命令模式 个人理解:命令模式,本质上是一种多层次的封装. 好处:降低耦合,扩展极其方便. 以下一段文案摘抄自:http://www.runoob.com/design-pattern/command- ...

- Linux服务器使用Docker部署.net Core项目

发布ASP.NET Core项目 和普通的项目发布一样,将项目发布到目标文件夹中 构建Dockerfile文件 在目标文件根目录新建Dockerfile文件(没有后缀) FROM microsoft/ ...

- kafka入门(二)分区和group

topic 在kafka中消息是按照topic进行分类的:每条发布到Kafka集群的消息都有一个类别,这个类别被称为topic parition 一个topic可以配置几个parition,每一个分区 ...