深度学习原理与框架-Tensorflow基本操作-变量常用操作 1.tf.random_normal(生成正态分布随机数) 2.tf.random_shuffle(进行洗牌操作) 3. tf.assign(赋值操作) 4.tf.convert_to_tensor(转换为tensor类型) 5.tf.add(相加操作) tf.divide(相乘操作) 6.tf.placeholder(输入数据占位

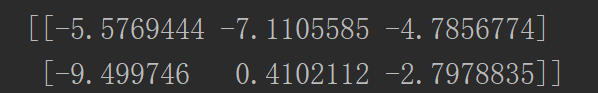

1. 使用tf.random_normal([2, 3], mean=-1, stddev=4) 创建一个正态分布的随机数

参数说明:[2, 3]表示随机数的维度,mean表示平均值,stddev表示标准差

代码:生成一个随机分布的值

#1. 创建一个正态分布的随机数

sess = tf.Session()

x = tf.random_normal([2, 3], mean=-1, stddev=4)

print(sess.run(x))

2. np.random.shuffle(y) # 对数据按照行进行洗牌操作

参数说明:y表示输入的矩阵

代码:对二维常量进行行的洗牌操作

# 2. 使用tf.random_shuffle进行洗牌操作

sess = tf.Session()

x = tf.constant([[1, 2], [3, 4], [5, 6]])

c = tf.random_shuffle(x)

print(sess.run(c))

第3行和第2行交换了位置

第3行和第2行交换了位置

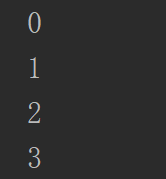

3. opt = np.assign(state, new_state) 进行赋值操作,使用sess.run执行该操作

参数说明:将new_state数据赋值给state数据

代码:将数据进行加和,并将结果赋值给新的数据,sess.run操作,表示对操作即上述相关的操作都进行运行

# 3.进行赋值操作, 赋值操作使用的是变量tf.Variable

state = tf.Variable(0)

new_state = tf.add(state, tf.constant(1))

opt = tf.assign(state, new_state)

init = tf.global_variables_initializer()

with tf.Session() as sess:

sess.run(init)

print(sess.run(state))

for _ in range(3):

# 执行赋值操作

sess.run(opt)

print(sess.run(state))

4. 使用tf.convert_to_tensor(x) 将数据转换为tensorflow格式

参数说明:x表示输入的参数为其他类型的

代码:下面将np.array格式的数据转换为tensor格式,并使用sess.run进行运行

# 4.使用tf.convert_to_tensor将数据转换为tensor

import numpy as np x = np.array([1, 2, 3])

t = tf.convert_to_tensor(x)

with tf.Session() as sess:

print(sess.run(t))

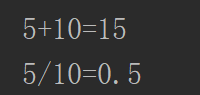

5. 使用tf.add(a, b) 进行加和操作, 使用tf.divide(a, b) 进行乘法操作

参数说明:tf.add表示a + b, tf.divide(a, b)表示a/b

代码:使用tf.constant生成两个变量,使用tf.add进行加和,使用tf.divide进行除法操作

# 5. 进行加减乘除操作

a = tf.constant(5.0)

b = tf.constant(10.0)

c = tf.add(a, b)

d = tf.divide(a, b)

with tf.Session() as sess:

print('%d+%d=%g'%(sess.run(a), sess.run(b), sess.run(c)))

print('%d/%d=%g'%(sess.run(a), sess.run(b), sess.run(d)))

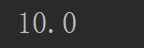

6. 使用tf.placeholder(tf.float32) # 进行输入参数的占位操作,在sess.run(output, feed_dict={x:7.0, y:1.0})进行真实数据的输入

代码:首先使用tf.placeholder进行占位操作,使用tf.multiply进行点乘操作,最后使用sess.run(output, feed_dict={x:7.0, y:1.0}) 将真实数据输入计算

# 6. 使用tf.placeholder进行数据的输入

x = tf.placeholder(tf.float32)

y = tf.placeholder(tf.float32)

z = tf.multiply(x, y)

with tf.Session() as sess:

# c表示用于承接z返回的结果

c = sess.run(z, feed_dict={x:5.0, y:2.0})

print(c)

深度学习原理与框架-Tensorflow基本操作-变量常用操作 1.tf.random_normal(生成正态分布随机数) 2.tf.random_shuffle(进行洗牌操作) 3. tf.assign(赋值操作) 4.tf.convert_to_tensor(转换为tensor类型) 5.tf.add(相加操作) tf.divide(相乘操作) 6.tf.placeholder(输入数据占位的更多相关文章

- 深度学习原理与框架-Tensorflow基本操作-mnist数据集的逻辑回归 1.tf.matmul(点乘操作) 2.tf.equal(对应位置是否相等) 3.tf.cast(将布尔类型转换为数值类型) 4.tf.argmax(返回最大值的索引) 5.tf.nn.softmax(计算softmax概率值) 6.tf.train.GradientDescentOptimizer(损失值梯度下降器)

1. tf.matmul(X, w) # 进行点乘操作 参数说明:X,w都表示输入的数据, 2.tf.equal(x, y) # 比较两个数据对应位置的数是否相等,返回值为True,或者False 参 ...

- 深度学习原理与框架-Tensorflow基本操作-实现线性拟合

代码:使用tensorflow进行数据点的线性拟合操作 第一步:使用np.random.normal生成正态分布的数据 第二步:将数据分为X_data 和 y_data 第三步:对参数W和b, 使用t ...

- 深度学习原理与框架-Tensorflow基本操作-Tensorflow中的变量

1.tf.Variable([[1, 2]]) # 创建一个变量 参数说明:[[1, 2]] 表示输入的数据,为一行二列的数据 2.tf.global_variables_initializer() ...

- 深度学习原理与框架-Tensorflow卷积神经网络-cifar10图片分类(代码) 1.tf.nn.lrn(局部响应归一化操作) 2.random.sample(在列表中随机选值) 3.tf.one_hot(对标签进行one_hot编码)

1.tf.nn.lrn(pool_h1, 4, bias=1.0, alpha=0.001/9.0, beta=0.75) # 局部响应归一化,使用相同位置的前后的filter进行响应归一化操作 参数 ...

- 深度学习原理与框架-Tensorflow卷积神经网络-神经网络mnist分类

使用tensorflow构造神经网络用来进行mnist数据集的分类 相比与上一节讲到的逻辑回归,神经网络比逻辑回归多了隐藏层,同时在每一个线性变化后添加了relu作为激活函数, 神经网络使用的损失值为 ...

- 深度学习原理与框架-Tensorflow卷积神经网络-卷积神经网络mnist分类 1.tf.nn.conv2d(卷积操作) 2.tf.nn.max_pool(最大池化操作) 3.tf.nn.dropout(执行dropout操作) 4.tf.nn.softmax_cross_entropy_with_logits(交叉熵损失) 5.tf.truncated_normal(两个标准差内的正态分布)

1. tf.nn.conv2d(x, w, strides=[1, 1, 1, 1], padding='SAME') # 对数据进行卷积操作 参数说明:x表示输入数据,w表示卷积核, stride ...

- 深度学习原理与框架-图像补全(原理与代码) 1.tf.nn.moments(求平均值和标准差) 2.tf.control_dependencies(先执行内部操作) 3.tf.cond(判别执行前或后函数) 4.tf.nn.atrous_conv2d 5.tf.nn.conv2d_transpose(反卷积) 7.tf.train.get_checkpoint_state(判断sess是否存在

1. tf.nn.moments(x, axes=[0, 1, 2]) # 对前三个维度求平均值和标准差,结果为最后一个维度,即对每个feature_map求平均值和标准差 参数说明:x为输入的fe ...

- 深度学习原理与框架-Alexnet(迁移学习代码) 1.sys.argv[1:](控制台输入的参数获取第二个参数开始) 2.tf.split(对数据进行切分操作) 3.tf.concat(对数据进行合并操作) 4.tf.variable_scope(指定w的使用范围) 5.tf.get_variable(构造和获得参数) 6.np.load(加载.npy文件)

1. sys.argv[1:] # 在控制台进行参数的输入时,只使用第二个参数以后的数据 参数说明:控制台的输入:python test.py what, 使用sys.argv[1:],那么将获得w ...

- 深度学习原理与框架-Tfrecord数据集的读取与训练(代码) 1.tf.train.batch(获取batch图片) 2.tf.image.resize_image_with_crop_or_pad(图片压缩) 3.tf.train.per_image_stand..(图片标准化) 4.tf.train.string_input_producer(字符串入队列) 5.tf.TFRecord(读

1.tf.train.batch(image, batch_size=batch_size, num_threads=1) # 获取一个batch的数据 参数说明:image表示输入图片,batch_ ...

随机推荐

- [Chrome]点击页面元素后全屏

function isFullScreen() { return (document.fullScreenElement && document.fullScreenElement ! ...

- php的方法

字符串: strlen(): 字符串的个数: . : 通过.来进行字符串的拼接: 数组: count(): 数组的 个数: is_array(): 判断是不是一个数组: 实参的方法: func_num ...

- sleep function error ("Advanced Programming in the UNIX Environment" Third Edition No.374)

测试证明代码: #include <unistd.h> #include <fcntl.h> #include <time.h> #include "ap ...

- MySQL事务提交过程(转载)

http://blog.csdn.net/sofia1217/article/details/53968214 上一篇文章我们介绍了在关闭binlog的情况下,事务提交的大概流程.之所以关闭binlo ...

- docker镜像文件的导入与导出(docker镜像迁移)

1.查看镜像ID # docker images [root@localhost ~]# docker images REPOSITORY TAG IMAGE ID CREATED SIZE myto ...

- STM32 f407 温湿度采集报警

软件 keil5 实现 1.使用stm32f407中的DS18B20传感器采集空气温度 2.使用stm32f407中的DHT11传感器采集空气的温度和湿度 3.显示到stm32f407的LCD液晶显示 ...

- Java中的Future相关

先上一个场景:假如你突然想做饭,但是没有厨具,也没有食材.网上购买厨具比较方便,食材去超市买更放心. 实现分析:在快递员送厨具的期间,我们肯定不会闲着,可以去超市买食材.所以,在主线程里面另起一个子线 ...

- pandas函数get_dummies的坑

转载:https://blog.csdn.net/mvpboss1004/article/details/79188190 pandas中的get_dummies得到的one-hot编码数据类型是ui ...

- Java基础知识_毕向东_Java基础视频教程笔记(11-12 多线程)

11天-01-多线程进程:是一个正在执行中的程序.每个进程执行都有一个执行顺序.该顺序是一个执行路径或者叫一个控制单元.线程:是进程中的一个独立的控制单元,线程在控制着进程的执行.一个进程至少有一个线 ...

- 在django中,执行原始sql语句

extra()方法 结果集修改器,一种提供额外查询参数的机制 使用extra: 1:Book.objects.filter(publisher__name='广东人员出版社').extra(where ...