Tensorflow-卷积神经网络CNN

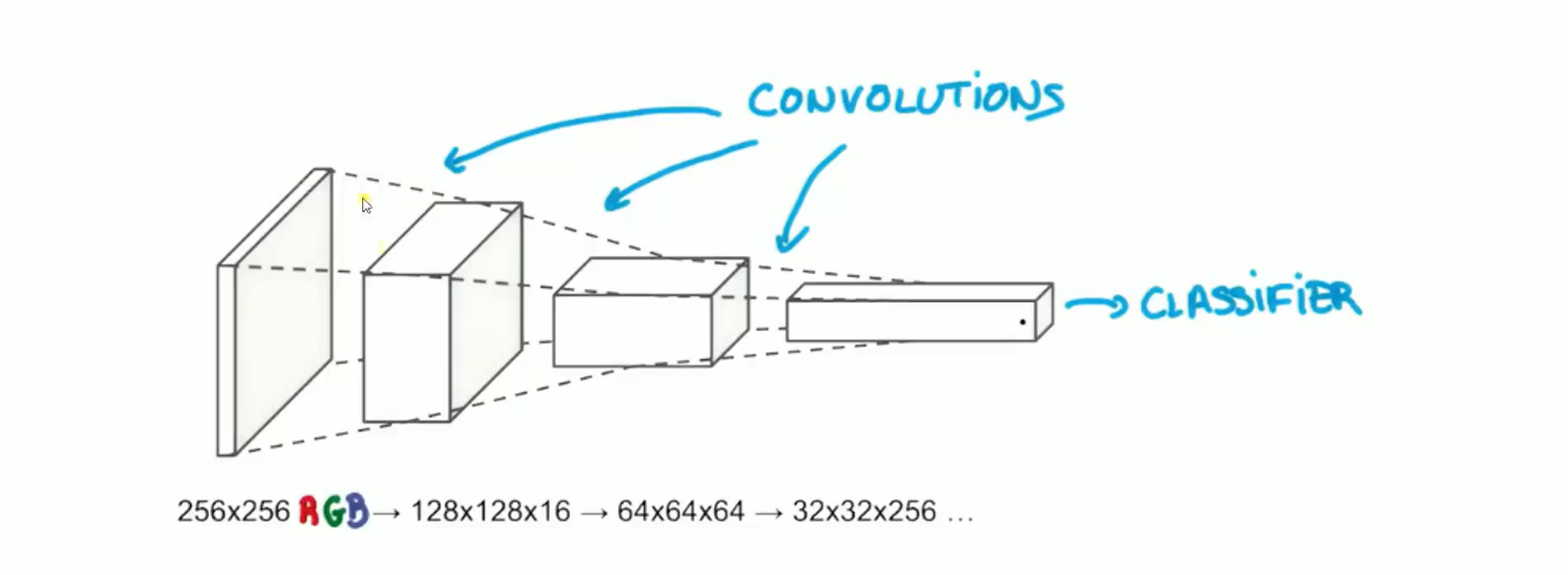

卷积神经网络CNN

结构

池化操作

手写数字-卷积神经网络实现

import tensorflow as tf

from tensorflow.examples.tutorials.mnist import input_data

tf.compat.v1.disable_eager_execution()

import numpy as np #载入数据集

mnist=input_data.read_data_sets("MNIST_data",one_hot=True) #每个批次大小

batch_size=100

#计算一共有多少个批次

n_bath=mnist.train.num_examples // batch_size #初始化权值

def weight_variable(shape):

initial=tf.compat.v1.truncated_normal(shape,stddev=0.1)#生成一个截断的正态分布

return tf.Variable(initial) #初始化偏置值

def bias_variable(shape):

initial=tf.compat.v1.constant(0.1,shape=shape)#生成一个截断的正态分布

return tf.Variable(initial) #卷积层

def conv2d(x,W):

#strides[0]=strides[3]=1,strides[1]代表x方向的步长,strides[2]代表y方向的步长

return tf.nn.conv2d(x,W,strides=[1,1,1,1],padding='SAME') #池化层

def max_pool_2x2(x):

#ksize[1,x,y,1]

return tf.nn.max_pool(x,ksize=[1,2,2,1],strides=[1,2,2,1],padding='SAME') #定义两个placeholder

x=tf.compat.v1.placeholder(tf.float32,[None,784])#28*28

y=tf.compat.v1.placeholder(tf.float32,[None,10]) #改变x的格式转为4D的向量【batch,in_height,in_width,in_channels】

x_image=tf.compat.v1.reshape(x,[-1,28,28,1]) #初始化第一个卷积层的权值和偏置

W_conv1=weight_variable([5,5,1,32])#5*5的采样窗口,32个卷积核从1个平面抽取特征

b_conv1=bias_variable([32])#每一个卷积核一个偏置值 #把x_image和权值向量进行卷积,再加上偏置值,然后应用于relu激活函数

h_conv1=tf.nn.relu(conv2d(x_image,W_conv1)+b_conv1)

h_pool1=max_pool_2x2(h_conv1)#进行max-pooling #初始化第二个卷积层的权值和偏置

W_conv2=weight_variable([5,5,32,64])#5*5的采样窗口,64个卷积核从32个平面抽取特征

b_conv2=bias_variable([64])#每一个卷积核一个偏置值 #把x_image和权值向量进行卷积,再加上偏置值,然后应用于relu激活函数

h_conv2=tf.nn.relu(conv2d(h_pool1,W_conv2)+b_conv2)

h_pool2=max_pool_2x2(h_conv2)#进行max-pooling #28*28的图片第一次卷积后还是28*28(步长为1),第一次池化变为14*14(因为步长2)

#第二次卷积后为14*14,第二次池化为7*7

#经过以上步骤后得到64张7*7平面 #初始化第一个全连接层的权值

W_fc1=weight_variable([7*7*64,1024])#上一层有7*7*64个神经元,全连接层有1024个神经元

b_fc1=bias_variable([1024])#1024个节点 #把池化层的第二层输出扁平化为1维

h_pool2_flat=tf.compat.v1.reshape(h_pool2,[-1,7*7*64])

#求第一个全连接层的输出

h_fc1=tf.nn.relu(tf.matmul(h_pool2_flat,W_fc1)+b_fc1) #用keep_prob来表示神经元的输出概率

# keep_prob=tf.compat.v1.placeholder(tf.float32)

# h_fc1_drop=tf.nn.dropout(h_fc1,keep_prob) #初始化第二个全连接层的权值

W_fc2=weight_variable([1024,10])#上一层有7*7*64个神经元,全连接层有1024个神经元

b_fc2=bias_variable([10])#1024个节点 #计算输出

prediction=tf.nn.softmax(tf.matmul(h_fc1,W_fc2)+b_fc2) #交叉熵函数

loss=tf.reduce_mean(tf.nn.softmax_cross_entropy_with_logits(labels=y,logits=prediction))

#梯度下降

train_step=tf.compat.v1.train.AdamOptimizer(1e-4).minimize(loss) #初始化变量

init=tf.compat.v1.global_variables_initializer() #结果存放在一个布尔型列表中

#返回的是一系列的True或False argmax返回一维张量中最大的值所在的位置,对比两个最大位置是否一致

correct_prediction=tf.equal(tf.argmax(y,1),tf.argmax(prediction,1)) #求准确率

#cast:将布尔类型转换为float,将True为1.0,False为0,然后求平均值

accuracy=tf.reduce_mean(tf.cast(correct_prediction,tf.float32)) with tf.compat.v1.Session() as sess:

sess.run(init)

for epoch in range(51):

for batch in range(n_bath):

#获得一批次的数据,batch_xs为图片,batch_ys为图片标签

batch_xs,batch_ys=mnist.train.next_batch(batch_size)

#进行训练

sess.run(train_step,feed_dict={x:batch_xs,y:batch_ys}) test_acc=sess.run(accuracy,feed_dict={x:mnist.test.images,y:mnist.test.labels}) print("Iter "+str(epoch)+",Testing Accuracy "+str(test_acc))

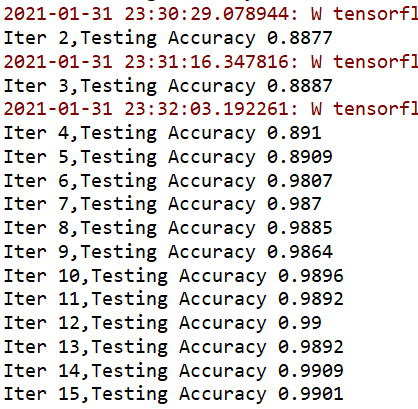

输出结果:

跑的时间有点长。。。。。

Tensorflow-卷积神经网络CNN的更多相关文章

- 深度学习之卷积神经网络CNN及tensorflow代码实例

深度学习之卷积神经网络CNN及tensorflow代码实例 什么是卷积? 卷积的定义 从数学上讲,卷积就是一种运算,是我们学习高等数学之后,新接触的一种运算,因为涉及到积分.级数,所以看起来觉得很复杂 ...

- 深度学习之卷积神经网络CNN及tensorflow代码实现示例

深度学习之卷积神经网络CNN及tensorflow代码实现示例 2017年05月01日 13:28:21 cxmscb 阅读数 151413更多 分类专栏: 机器学习 深度学习 机器学习 版权声明 ...

- 卷积神经网络CNN原理以及TensorFlow实现

在知乎上看到一段介绍卷积神经网络的文章,感觉讲的特别直观明了,我整理了一下.首先介绍原理部分. [透析] 卷积神经网络CNN究竟是怎样一步一步工作的? 通过一个图像分类问题介绍卷积神经网络是如何工作的 ...

- TensorFlow 2.0 深度学习实战 —— 浅谈卷积神经网络 CNN

前言 上一章为大家介绍过深度学习的基础和多层感知机 MLP 的应用,本章开始将深入讲解卷积神经网络的实用场景.卷积神经网络 CNN(Convolutional Neural Networks,Conv ...

- 卷积神经网络CNN总结

从神经网络到卷积神经网络(CNN)我们知道神经网络的结构是这样的: 那卷积神经网络跟它是什么关系呢?其实卷积神经网络依旧是层级网络,只是层的功能和形式做了变化,可以说是传统神经网络的一个改进.比如下图 ...

- 深度学习之卷积神经网络(CNN)详解与代码实现(二)

用Tensorflow实现卷积神经网络(CNN) 本文系作者原创,转载请注明出处:https://www.cnblogs.com/further-further-further/p/10737065. ...

- 深度学习之卷积神经网络(CNN)详解与代码实现(一)

卷积神经网络(CNN)详解与代码实现 本文系作者原创,转载请注明出处:https://www.cnblogs.com/further-further-further/p/10430073.html 目 ...

- Tensorflow卷积神经网络[转]

Tensorflow卷积神经网络 卷积神经网络(Convolutional Neural Network, CNN)是一种前馈神经网络, 在计算机视觉等领域被广泛应用. 本文将简单介绍其原理并分析Te ...

- 深度学习之卷积神经网络CNN

转自:https://blog.csdn.net/cxmscb/article/details/71023576 一.CNN的引入 在人工的全连接神经网络中,每相邻两层之间的每个神经元之间都是有边相连 ...

- 基于MNIST数据的卷积神经网络CNN

基于tensorflow使用CNN识别MNIST 参数数量:第一个卷积层5x5x1x32=800个参数,第二个卷积层5x5x32x64=51200个参数,第三个全连接层7x7x64x1024=3211 ...

随机推荐

- ArrayList的删除姿势你都知道了吗

引言 前几天有个读者由于看了<ArrayList哪种遍历效率最好,你真的弄明白了吗?>问了个问题普通for循环ArrayList为什么不能删除连续重复的两个元素?其实这个描述是不正确的.正 ...

- docker容器中布置静态网站

docker容器中布置静态网站(基于云服务器ubuntu系统) 服务器准备(ubuntu) docker nginx 静态网页制作 浏览器测试 服务器布置 这里推荐使用云服务器(阿里云.华为云.腾讯云 ...

- Refit集成consul在asp.net core中的实践

前言 github:https://github.com/alphayu/ Refit.WebApiClient.Feign等都是支持声名式的Restful服务调用的开源组件. 这个几个组件都综合研究 ...

- hbase:ERROR: org.apache.hadoop.hbase.ipc.ServerNotRunningYetException: Server is not running yet

hbase连接deug:DEBUG [main-SendThread(bigdata.server1:2181)] - Reading reply sessionid:0x16f764e7f6e000 ...

- Date、SimpleDateFormat以及Calendar

Date类 毫秒值 java.util.Date:表示日期和时间的类 类Date表示特定的瞬间,精确到毫秒 日期转毫秒,号秒转日期 中国属于东八区,会把事件增加8个小时 1天 = 4 * 60 * 6 ...

- Cisco常用命令

• 首次配置网络设备 ○ 需要使用Console线连接进行初始化配置 § 在PC使用"超级终端"或其他软件. • 交换机的工作模式: ...

- Java远程下载文件到本地(http协议和ssh2协议)

Java中java.io包为我们提供了输入流和输出流,对文件的读写基本上都依赖于这些封装好的关于流的类中来实现.前段时间遇到了以下两种需求: 1.与某系统对接,每天获取最新的图片并显示在前端页面.该系 ...

- paramunittest参数化测试基础

samples: import paramunittestimport unittest@paramunittest.parametrized( (10,20), (30,40), # (100,20 ...

- 【Spring】Spring的事务管理 - 2、声明式事务管理(实现基于XML、Annotation的方式。)

声明式事务管理 文章目录 声明式事务管理 基于XML方式的声明式事务 基于Annotation方式的声明式事务 简单记录 - 简单记录-Java EE企业级应用开发教程(Spring+Spring M ...

- 【Linux】saltstack 安装及简单使用

准备三台server,一台为master(10.96.20.113),另两台为minion(10.96.20.117,10.96.20.118) 主机名(master.minion1.minion2) ...