HBase、Hive、MapReduce、Hadoop、Spark 开发环境搭建后的一些步骤(export导出jar包方式 或 Ant 方式)

步骤一

若是,不会HBase开发环境搭建的博文们,见我下面的这篇博客。

HBase 开发环境搭建(Eclipse\MyEclipse + Maven)

步骤一里的,需要补充的。如下:

在项目名,右键,

然后,编写pom.xml,这里不多赘述。见

HBase 开发环境搭建(Eclipse\MyEclipse + Maven)

完成之后呢,编写好代码,对吧。

步骤二 HBase 开发环境搭建后的一些步骤(export导出jar包方式 或 Ant 方式)

这里,不多说,玩过大数据一段时间的博友们,都知道。

步骤三 HBase 开发环境搭建后的一些步骤(export导出jar包方式 或 Ant 方式)

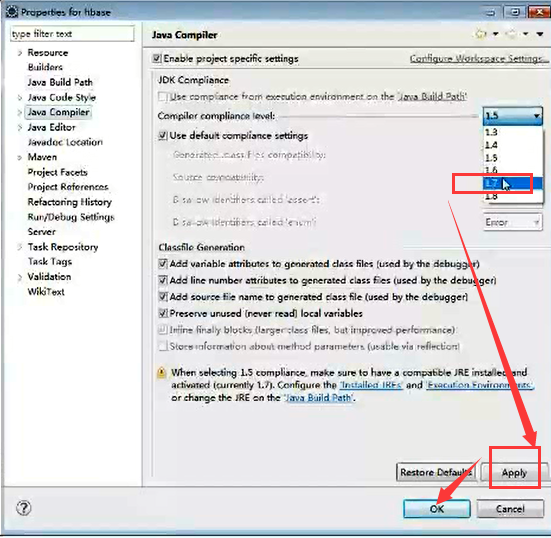

首先,在MyEclispe里

看到了吗,MyEclipse默认是只有自带的Ant,没有外置的Ant。一般,我们都不用默认的。

比如我这里。

注意,这里有个jar包,一定要放在我们本地ANT_HOME下的lib下,

下载,见

http://download.csdn.net/detail/u010106732/9705437

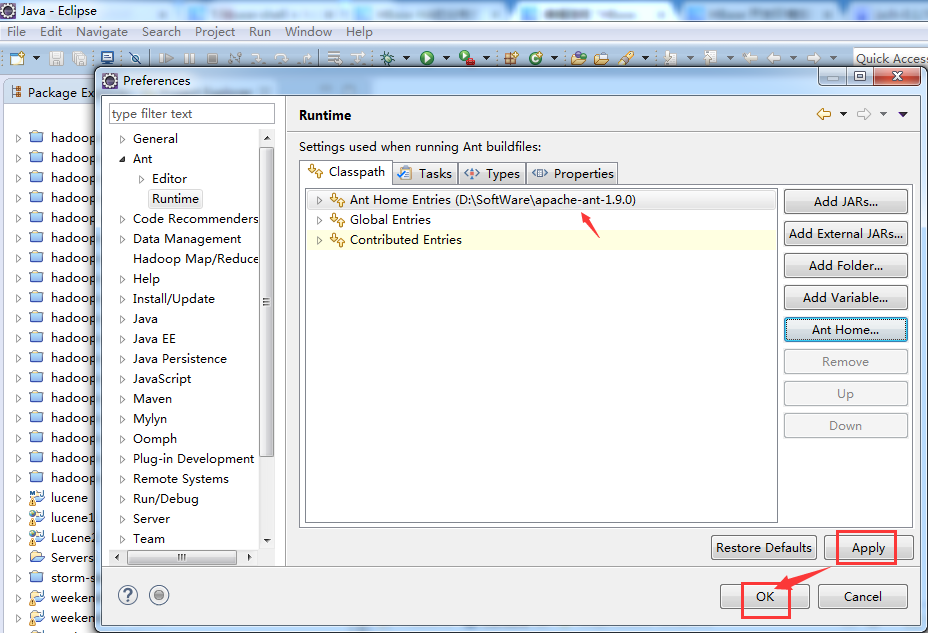

其次,Eclipse里,一样的步骤,类似的

看到了吗,Eclipse默认是只有自带的Ant,没有外置的Ant。一般,我们都不用默认的。

注意,这里有个jar包,一定要放在我们本地ANT_HOME下的lib下,

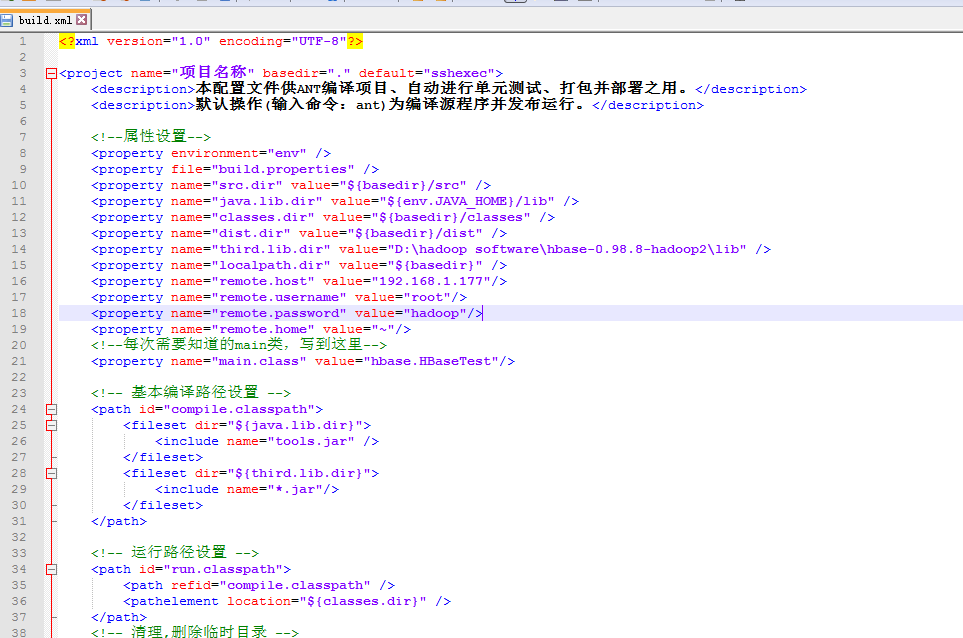

<?xml version="1.0" encoding="UTF-8"?>

<project name="项目名称" basedir="." default="sshexec">

<description>本配置文件供ANT编译项目、自动进行单元测试、打包并部署之用。</description>

<description>默认操作(输入命令:ant)为编译源程序并发布运行。</description>

<!--属性设置-->

<property environment="env" />

<property file="build.properties" />

<property name="src.dir" value="${basedir}/src" />

<property name="java.lib.dir" value="${env.JAVA_HOME}/lib" />

<property name="classes.dir" value="${basedir}/classes" />

<property name="dist.dir" value="${basedir}/dist" />

<property name="third.lib.dir" value="D:\hadoop software\hbase-0.98.8-hadoop2\lib" />

<property name="localpath.dir" value="${basedir}" />

<property name="remote.host" value="192.168.1.177"/>

<property name="remote.username" value="root"/>

<property name="remote.password" value="hadoop"/>

<property name="remote.home" value="~"/>

<!--每次需要知道的main类,写到这里-->

<property name="main.class" value="hbase.HBaseTest"/>

<!-- 基本编译路径设置 -->

<path id="compile.classpath">

<fileset dir="${java.lib.dir}">

<include name="tools.jar" />

</fileset>

<fileset dir="${third.lib.dir}">

<include name="*.jar"/>

</fileset>

</path>

<!-- 运行路径设置 -->

<path id="run.classpath">

<path refid="compile.classpath" />

<pathelement location="${classes.dir}" />

</path>

<!-- 清理,删除临时目录 -->

<target name="clean" description="清理,删除临时目录">

<!--delete dir="${build.dir}" /-->

<delete dir="${dist.dir}" />

<delete dir="${classes.dir}" />

<echo level="info">清理完毕</echo>

</target>

<!-- 初始化,建立目录,复制文件 -->

<target name="init" depends="clean" description="初始化,建立目录,复制文件">

<mkdir dir="${classes.dir}" />

<mkdir dir="${dist.dir}" />

</target>

<!-- 编译源文件-->

<target name="compile" depends="init" description="编译源文件">

<javac srcdir="${src.dir}" destdir="${classes.dir}" source="1.7" target="1.7" includeAntRuntime="false" debug="false" verbose="false">

<compilerarg line="-encoding UTF-8 "/>

<classpath refid="compile.classpath" />

</javac>

</target>

<!-- 打包类文件 -->

<target name="jar" depends="compile" description="打包类文件">

<jar jarfile="${dist.dir}/jar.jar">

<fileset dir="${classes.dir}" includes="**/*.*" />

</jar>

</target>

<!--上传到服务器

**需要把lib目录下的jsch-0.1.51拷贝到$ANT_HOME/lib下,如果是Eclipse下的Ant环境必须在Window->Preferences->Ant->Runtime->Classpath中加入jsch-0.1.51。

-->

<target name="ssh" depends="jar">

<scp file="${dist.dir}/jar.jar" todir="${remote.username}@${remote.host}:${remote.home}" password="${remote.password}" trust="true"/>

</target>

<target name="sshexec" depends="ssh">

<sshexec host="${remote.host}" username="${remote.username}" password="${remote.password}" trust="true" command="source /etc/profile;hadoop jar ${remote.home}/jar.jar ${main.class}"/>

</target>

</project>

把这个build.xml模板文件,复制到项目根目录下。

若有时间的话,需要了解更多,见

关于MAVEN和ANT的讨论(整理)

ant 连接linux 缺少jsch.jar 及添加jar包无效解决方法

HBase、Hive、MapReduce、Hadoop、Spark 开发环境搭建后的一些步骤(export导出jar包方式 或 Ant 方式)的更多相关文章

- 【原创干货】大数据Hadoop/Spark开发环境搭建

已经自学了好几个月的大数据了,第一个月里自己通过看书.看视频.网上查资料也把hadoop(1.x.2.x).spark单机.伪分布式.集群都部署了一遍,但经历短暂的兴奋后,还是觉得不得门而入. 只有深 ...

- Hadoop项目开发环境搭建(Eclipse\MyEclipse + Maven)

写在前面的话 可详细参考,一定得去看 HBase 开发环境搭建(Eclipse\MyEclipse + Maven) Zookeeper项目开发环境搭建(Eclipse\MyEclipse + Mav ...

- Spark编译及spark开发环境搭建

最近需要将生产环境的spark1.3版本升级到spark1.6(尽管spark2.0已经发布一段时间了,稳定可靠起见,还是选择了spark1.6),同时需要基于spark开发一些中间件,因此需要搭建一 ...

- Hadoop Eclipse开发环境搭建

This document is from my evernote, when I was still at baidu, I have a complete hadoop developme ...

- (转)Hadoop Eclipse开发环境搭建

来源:http://www.cnblogs.com/justinzhang/p/4261851.html This document is from my evernote, when I was s ...

- Spark开发环境搭建和作业提交

Spark高可用集群搭建 在所有节点上下载或上传spark文件,解压缩安装,建立软连接 配置所有节点spark安装目录下的spark-evn.sh文件 配置slaves 配置spark-default ...

- Spark 开发环境搭建

原文见 http://xiguada.org/spark-develop/ 本文基于Spark 0.9.0,由于它基于Scala 2.10,因此必须安装Scala 2.10,否则将无法运行Spar ...

- ubuntu14.04 Hadoop单机开发环境搭建MapReduce项目

Hadoop官网:http://hadoop.apache.org/ 目前最新的版本是Hadoop 3.0.0-alpha1前提:java 1.6 版本以上 首先从官网下载压缩包(hadoop-3.0 ...

- Hadoop基本开发环境搭建(原创,已实践)

软件包: hadoop-2.7.2.tar.gz hadoop-eclipse-plugin-2.7.2.jar hadoop-common-2.7.1-bin.zip eclipse jdk1.8 ...

随机推荐

- (2)搜索广告CTR预估

https://www.cnblogs.com/futurehau/p/6184585.html 1. CTR预估的流程 数据 -> 预处理 ->特征抽取 ->模型训练 ->后 ...

- Excel 绘制正态概率图-正态性检验

- Problem 29

Problem 29 Consider all integer combinations of ab for 2 ≤ a ≤ 5 and 2 ≤ b ≤ 5: 仔细看看以下a与b的组合 22=4, 2 ...

- 《hello-world》第八次团队作业:Alpha冲刺-Scrum Meeting 4

项目 内容 这个作业属于哪个课程 2016级计算机科学与工程学院软件工程(西北师范大学) 这个作业的要求在哪里 实验十二 团队作业8:软件测试与Alpha冲刺 团队名称 <hello--worl ...

- 【[Offer收割]编程练习赛 14 B】投掷硬币

[题目链接]:http://hihocoder.com/problemset/problem/1506 [题意] 中文题 [题解] 这种题是概率DP-. 设f[i][j]表示i个硬币里面有j个正面朝上 ...

- hdu 4859 最大点权独立集的变形(方格取数的变形)

/*刚开始不会写,最大点权独立集神马都不知道,在潘神的指导下终于做出来,灰常感谢ps: 和方格取数差不多奇偶建图,对于D必割点权为0,对于.必然不割点权为inf.然后和方格取数差不多的建图 .--.| ...

- 在django里用xlwt作EXCEL导出功能

参考了以前kevin的代码,搞起来快呀,哈哈哈,,阿里亚多.... 代码的意思比较明白,不注释,几乎自解释... 就是定义EXCEL时,比较硬生生的,一步一步没有快捷的方法. 另外就是取时间出来时,如 ...

- C#--正则匹配

一个好用的Regex测试插件 快捷键:ctrl+ r , ctrl+ x 打开正则表达式工具 C#的正则表达式的常用的规则: [abc] 里面的每一次字符都可以进行匹配 a{2} 匹配2个a a{2, ...

- [bzoj1010][HNOI2008]玩具装箱toy_斜率优化dp

玩具装箱toy bzoj-1010 HNOI-2008 题目大意:P教授要去看奥运,但是他舍不下他的玩具,于是他决定把所有的玩具运到北京.他使用自己的压缩器进行压缩,其可以将任意物品变成一堆,再放到一 ...

- django 和 mysql的一次troubleshooting

下面是一次用django连接mysql的经历,记录下来也许以后会有帮助. 首先是用django的./manage.py syncdb 去连接mysql -bash-3.2$ ./manage.py s ...