find cat sed awk 简单组合使用

find:查找

// .表示当前目录; /表示根目录; | 管道符; xargs表示将前面的搜索接口作为参数传递到后面的命令中;grep 过滤

// xxxx表示文件名

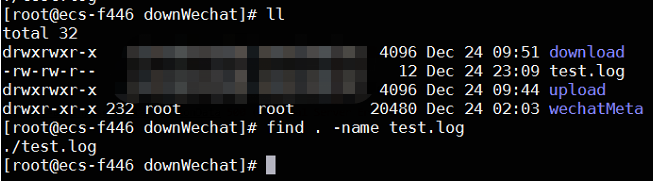

1.查找指定文件名的文件

find . -name xxxx // 区分大小写

find . -iname xxxx // 不区分大小写

2.查找当前目录中文件名后缀为 .json的所有文件

find . -type f -name '*.json'

3.查找当前目录下所有文件夹

find . -type d

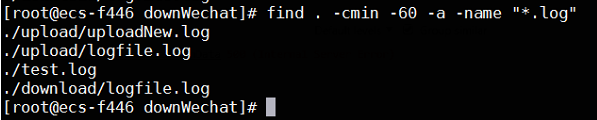

4.查找当前目录1小时内被修改的文件

find . -cmin -60 // 单位: 分钟

-a 表示前后条件都满足

-o 表示前后条件满足一条即可

5.查找当前目录中包含 function 字符串的文件

find . | xargs grep function

6.查找文件名包含 function 字符串的文件

find . -type f -name '*function*'

7.查找3天前创建的后缀为.function的文件

find . -type f -name '*.function' -ctime +3

8.查找3天前创建的后缀为.function的文件并删除

find . -type f -name '*.function' -ctime +3 | xargs rm -r

awk:切分列

// xxxx 是被操作的文件

1.查看某文件指定列数的内容

awk '{print $1}' xxxx

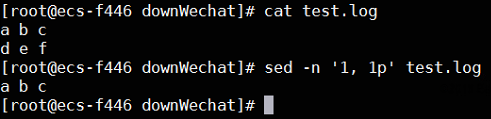

sed:切分行

// xxxx 是当前被操作的文件

1.查看某文件指定列数的内容

sed -n 'startLine, endLinep' xxxx

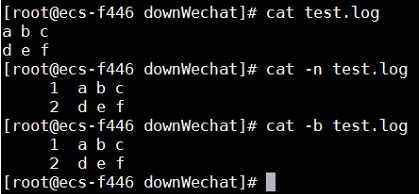

cat:查看

// xxxx 是当前要查看的文件名

1.查看文件内容cat

cat xxxx

2.查看带行数的内容

cat -n xxxx 或 cat -b xxxx

3.统计文件中去重复后的行数

cat xxxx | sort | uniq | wc -l // sort 排序 // uniq去除重复

4.获取指定列内容 awk 切分列 $num 表示第几列

// num 表示想获取的列数

cat xxxx | awk '{print $num}'

// 写进新文件

cat xxxx | awk '{print $num}' > xxxx_new

5.获取指定行数内容 sed 切分行 -n 表示行数 startline 起始行数 endline 截止行数

cat xxxx | sed -n 'startline,endlinep' // 最后的p不能丢

// 写进新文件

cat xxxx | sed -n 'startline,endlinep' > xxxx_new // 最后的p不能丢

6.将指定列指定行数的内容放入新文件

// awk 切分列 $ 后面的数字表示第几列

// sed 切分行 -n 表示行数 startline 起始行数 endline 截止行数

cat xxxx | awk '{print $num}' | sed -n 'startline,endlinep' > xxxx_new

获取指定进程的ID

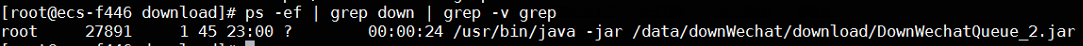

1.ps -ef | grep down 获取包含指定进程的信息,第二列就是进程ID

2.ps -ef | grep down | grep -v grep 过滤grep本身

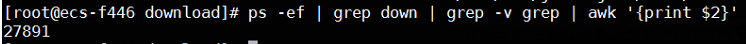

3.获取指定进程的进程ID 两种方式,结果一样

ps -ef | grep down | grep -v grep | awk '{print $2}' 或 ps -ef | grep down | awk '{print $2}' | sed -n '1, 1p'

4.查找指定文件中包含指定字符串的行数

find -type f -name logfile.log | xargs grep '267468'

分析nginx日志时获取访问量较高的前几名IP:

cat access.log | awk '{print $1}' | sort | uniq -c | sort -nr | head -10

命令解释:cat、awk见此文章上面; sort: 排序 -nr倒序 uniq:去重复 -c统计个数 head: 取前几个 -10前10个

find cat sed awk 简单组合使用的更多相关文章

- Sed&awk笔记之awk篇

http://blog.csdn.net/a81895898/article/details/8482333 Awk是什么 Awk.sed与grep,俗称Linux下的三剑客,它们之间有很多相似点,但 ...

- Sed&awk笔记之sed篇

http://blog.csdn.net/a81895898/article/details/8482387 Sed是什么 <sed and awk>一书中(1.2 A Stream Ed ...

- linux四剑客-grep/find/sed/awk/详解-技术流ken

四剑客简介 相信接触过linux的大家应该都学过或者听过四剑客,即sed,grep,find,awk,有人对其望而生畏,有人对其爱不释手.参数太多,变化形式太多,使用超级灵活,让一部分人难以适从继而望 ...

- Sed&awk笔记之sed篇(转)

Sed是什么 <sed and awk>一书中(1.2 A Stream Editor)是这样解释的: Sed is a "non-interactive" strea ...

- Sed&awk笔记之awk篇(转)

Awk是什么 Awk.sed与grep,俗称Linux下的三剑客,它们之间有很多相似点,但是同样也各有各的特色,相似的地方是它们都可以匹配文本,其中sed和awk还可以用于文本编辑,而grep则不具备 ...

- awk简单用法

awk是一个强大的文本分析工具,相对于grep的查找,sed的编辑,awk在其对数据分析并生成报告时,显得尤为强大.简单来说awk就是把文件逐行的读入,以空格为默认分隔符将每行切片,切开的部分再进行各 ...

- linux sed awk seq 正则使用 截取字符 之技巧

[root@room9pc01 ~]# seq 5 1 2 3 4 5 [root@room9pc01 ~]# seq 2 5 2 3 4 5 seq 1 2 10 1 3 5 7 9 [root@d ...

- Sed Awk 日常使用总结

Sed命令语法sed [option] {sed-commands}{input-file}sed首先从input-file中读取第一行,然后执行所有的sed-commands:再读取第二行,执行所有 ...

- awk简单用法-(1)

一.awk基本操作 awk指定多个分割符,分隔符中有:和空格,还有:和空格的组合,这个时候需要指定多个分隔符 -F'[ :]+',[ :]表示分隔符为:和空格,一个或者多个+号表示空格和:的组合也为一 ...

随机推荐

- JQuery的extend扩展方法

jQuery.extend 函数使用详解 JQuery的extend扩展方法: Jquery的扩展方法extend是我们在写插件的过程中常用的方法,该方法有一些重载原型,在此,我们一起去 ...

- 带图片的word快速插入到博客中

最近在博客中写文章的时候,最烦的就是将word文档整体传到博客中,不能一次把图片粘贴上去,再次去添加图片的时候要截图还要找对位置才可上传,偶尔的机会在网上看到有人这么处理,挺好用的,这里我也做个备注. ...

- POJ 3321 Apple Tree DFS序 + 树状数组

多次修改一棵树节点的值,或者询问当前这个节点的子树所有节点权值总和. 首先预处理出DFS序L[i]和R[i] 把问题转化为区间查询总和问题.单点修改,区间查询,树状数组即可. 注意修改的时候也要按照d ...

- Java文件与io——常见字符编码

在计算机世界里,任何的文字都是以指定的编码方式存在的. 常见编码有:ISO8859-1.GBK/GB2312.unicode.UTF ISO8859-1:编码属于单字节编码,最多只能表示0-255的字 ...

- c语言字符串操作总结(转)

本文转自:http://www.jb51.net/article/37410.htm 1)字符串操作 strcpy(p, p1) 复制字符串 strncpy(p, p1, n) 复制指定长度字符串 s ...

- Windows下 bat调用TSql问题

一.建立sql文件 在sql管理工具中写好sql文件,并保证能够正常运行,之后用unique编码保存. 二.建立一个bat文件osql -U登录用户 -P密码 -S服务器 <sql文件.sql ...

- Docker | 第五章:构建自定义镜像

前言 上一章节,主要是介绍了下Dockerfile的一些常用命令的说明.我们知道,利用Dockerfile可以构建一个新的镜像,比如运行Java环境,就需要一个JDK环境的镜像,但直接使用公共的镜像时 ...

- ElasticSearch2.2.0安装(win7)

ElasticSearch2.2.0必须在jdk1.7上才可以启动起来哦. 一.ElasticSearch2.2.0安装 1.下载ElasticSearch2.2.0安装包 https://downl ...

- js和JQuery中offset等属性对比

HTML: 内容在滚动条下面 <div id="outerDiv"> <div id="myDiv" class="myDiv&qu ...

- 无需控件直接导出xls(csv)

/// <summary> /// 执行导出 /// </summary> /// <param name="ds">要导出的DataSet&l ...