【Spark】快来学习RDD的创建以及操作方式吧!

目录

RDD的创建

三种方式

从一个集合中创建

val rdd1 = sc.parallelize(Array(1,2,3,4,5,6,7,8))

从文件中创建

val rdd2 = sc.textFile("/words.txt")

从其他的RDD转化而来

val rdd3=rdd2.flatMap(_.split(" "))

RDD编程常用API

算子分类

Transformation

概述

Transformation —— 根据数据集创建一个新的数据集,计算后返回一个新的RDD,但不会直接返回计算结果,二是记住这些应用到数据集(例如一个文件)上的转换动作,只有当发生一个要求返回结果给Driver的动作是,这些转换才会真正运行。

帮助文档

http://spark.apache.org/docs/2.2.0/rdd-programming-guide.html#transformations

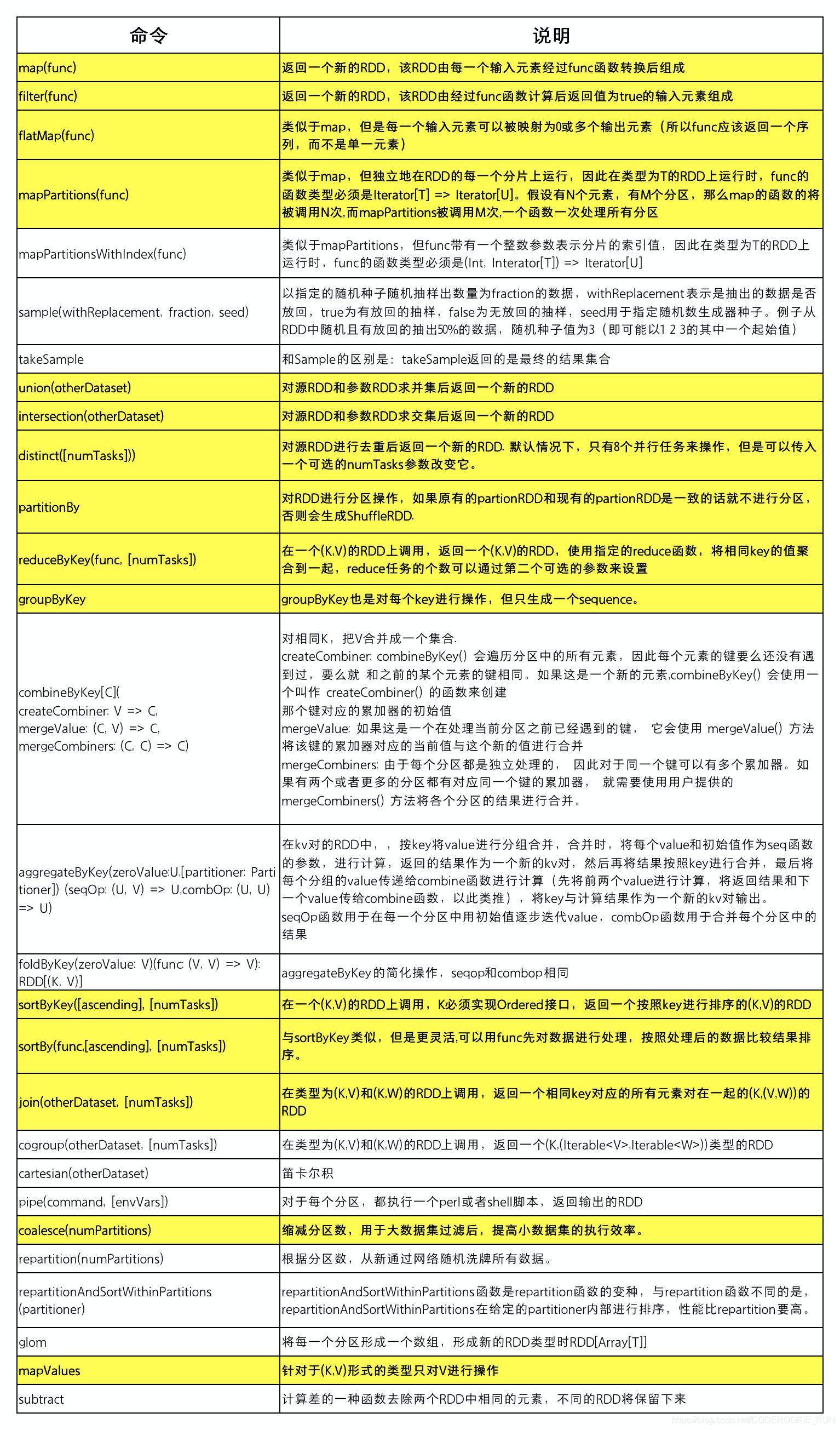

常用Transformation表

Transformation使用实例

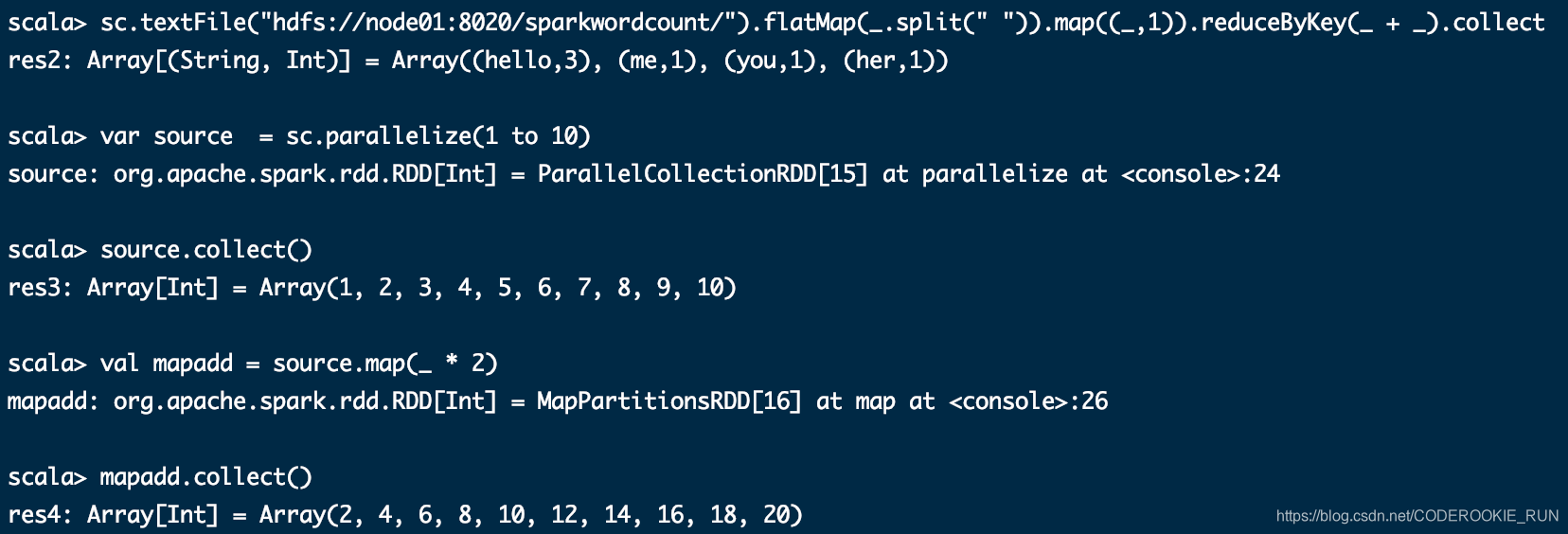

map(func)

将分区里面每一条数据取出来,进行处理

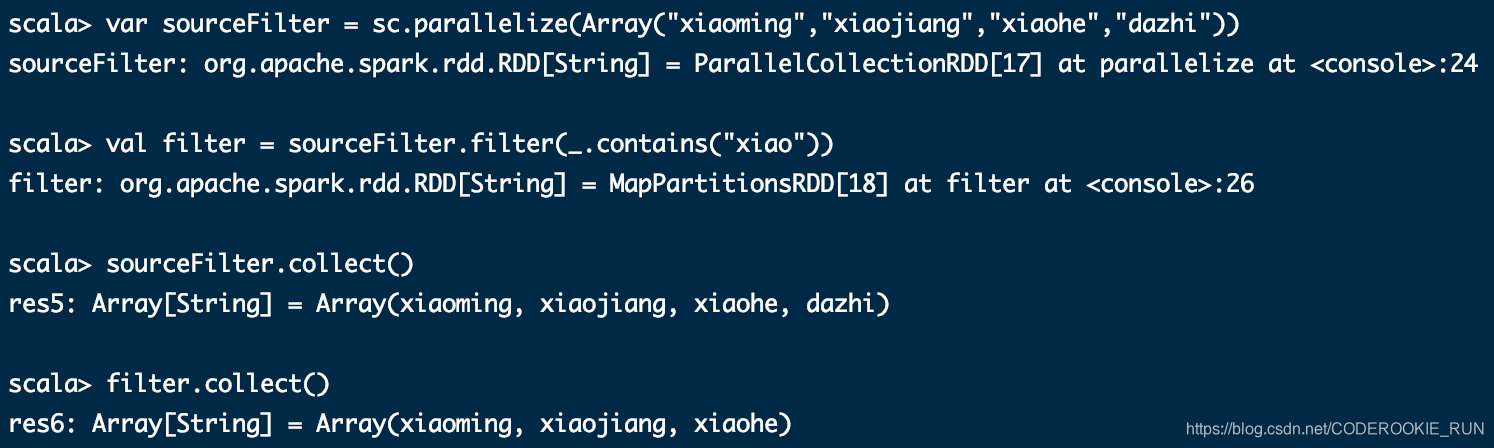

filter(func)

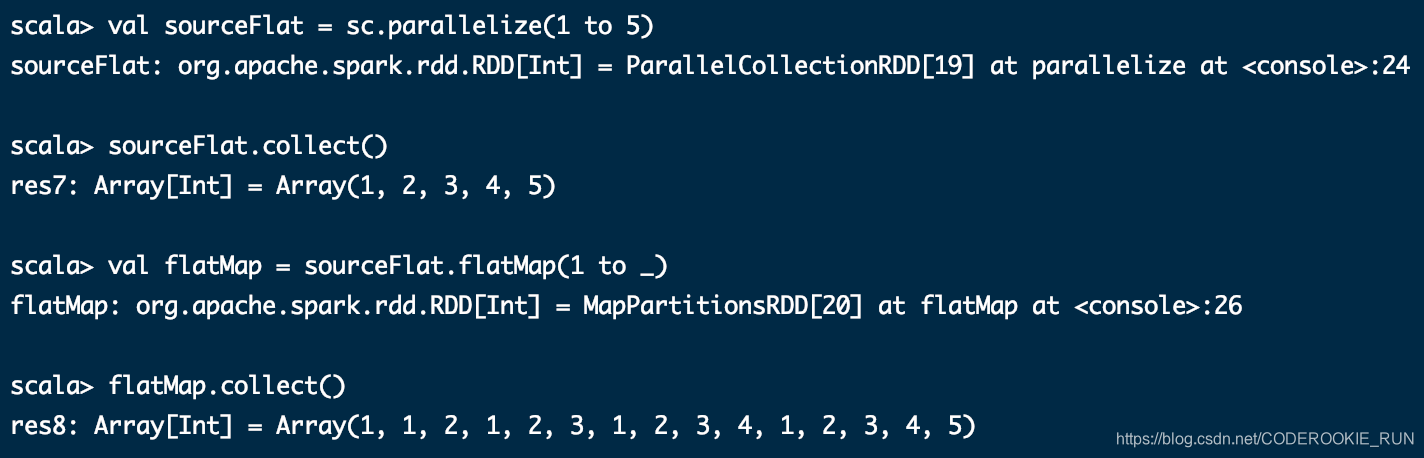

flatMap(func)

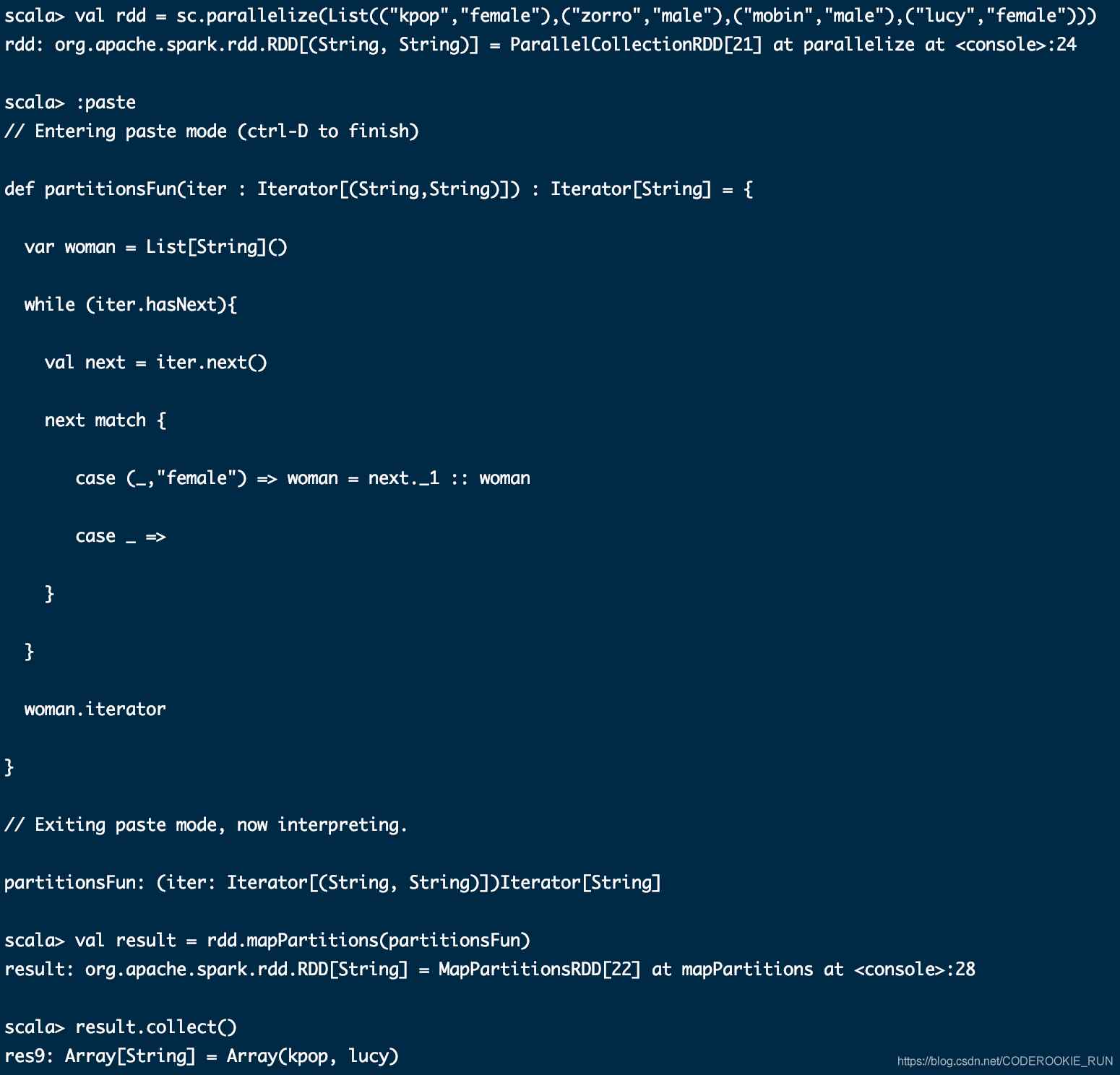

mapPartitions(func)

一次性将一个分区里面的数据全部取出来。效率更高

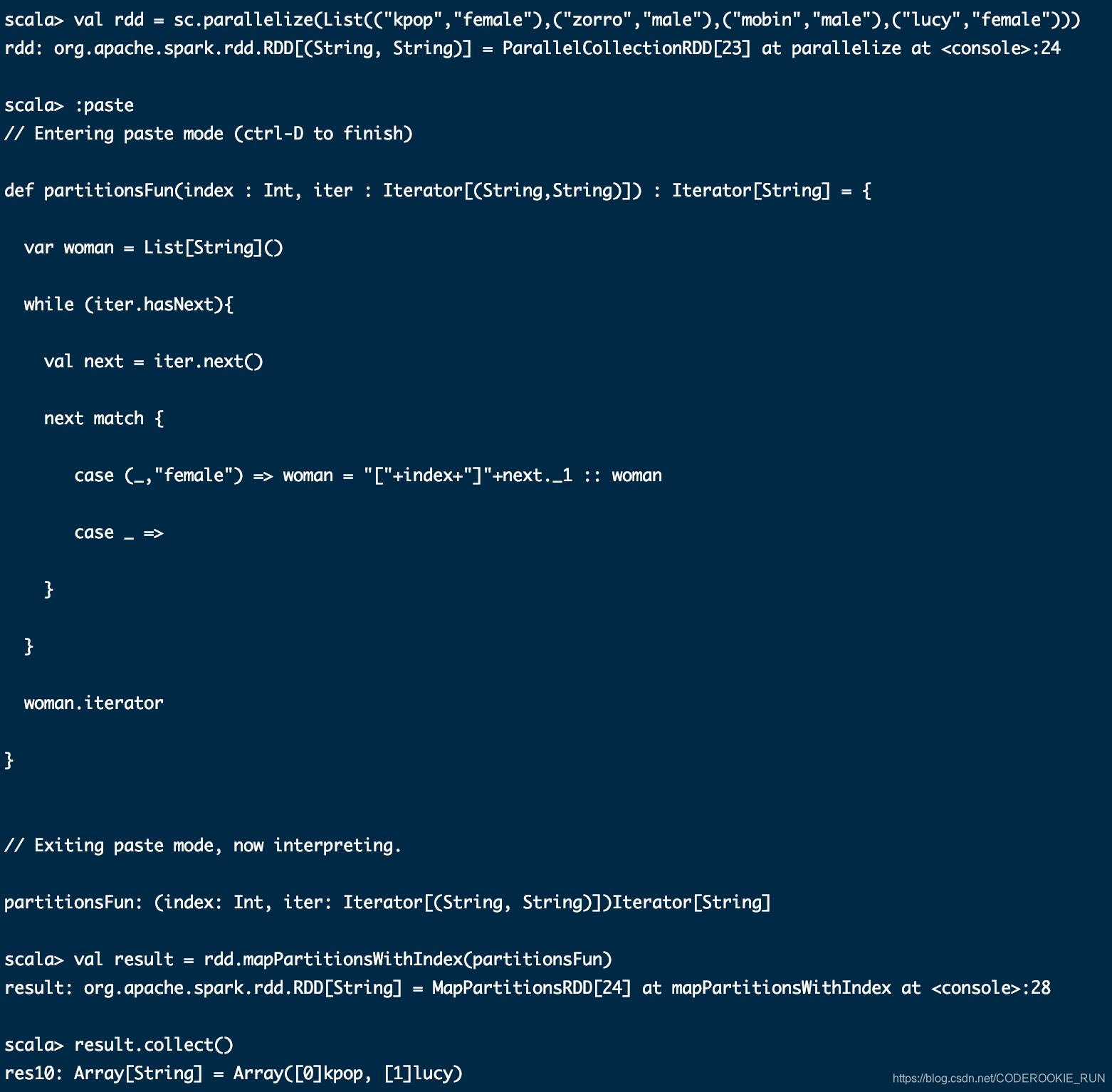

mapPartitionsWithIndex(func)

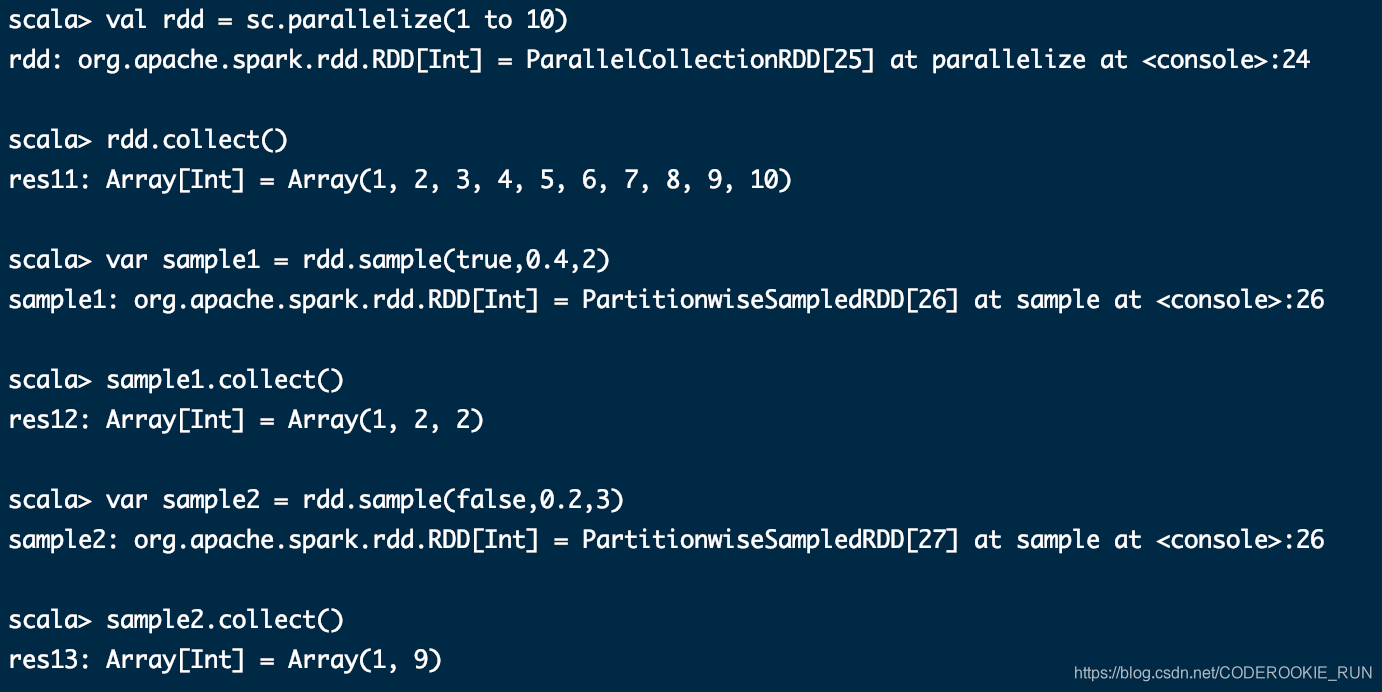

sample(withReplacement, fraction, seed)

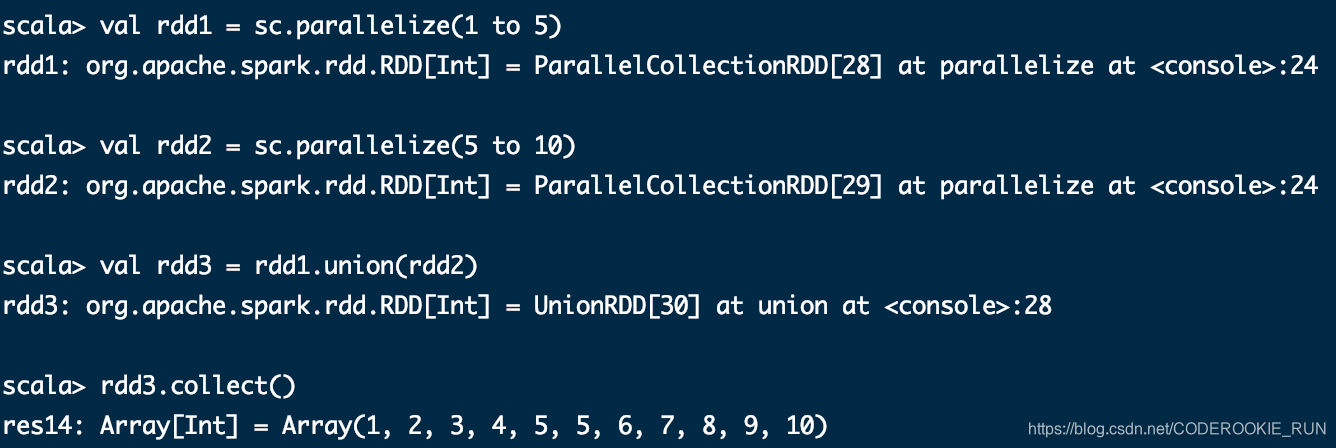

union(otherDataset)

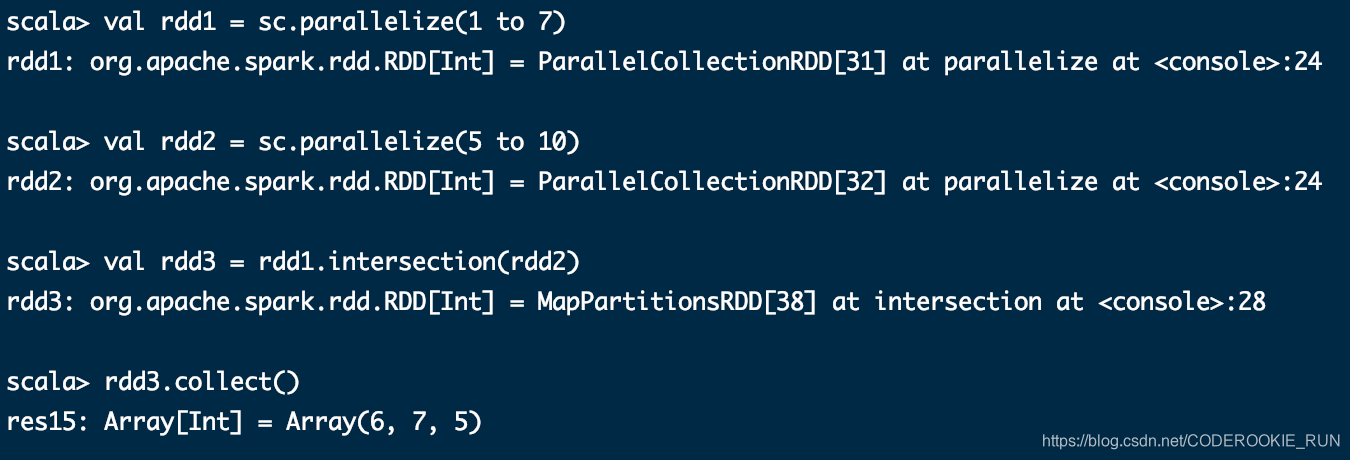

intersection(otherDataset)

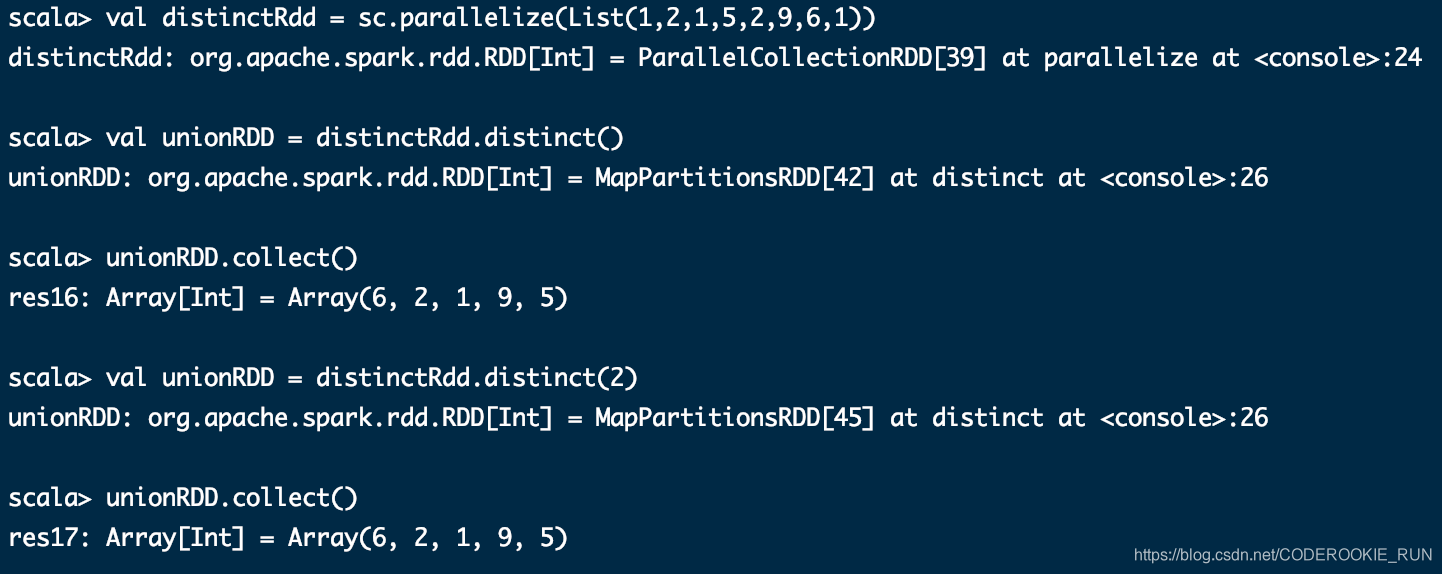

distinct([numTasks]))

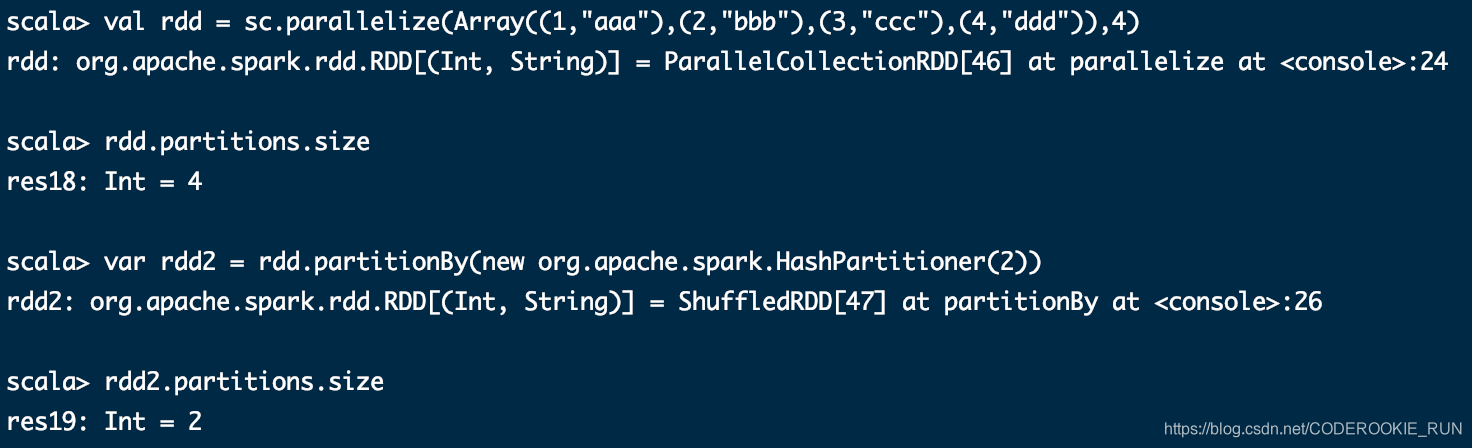

partitionBy

重新分区,分区数可以手动指定的。分区可能变多也可能变少,而且partitionBy还会产生shuffle过程

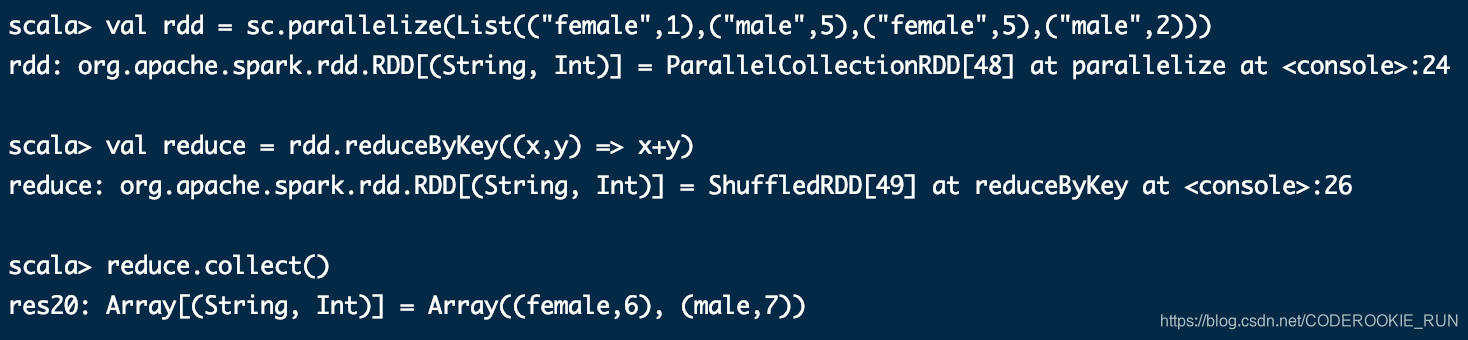

reduceByKey(func, [numTasks])

效率更高,会对数据提前进行部分的聚合,减少数据的key的shuffle

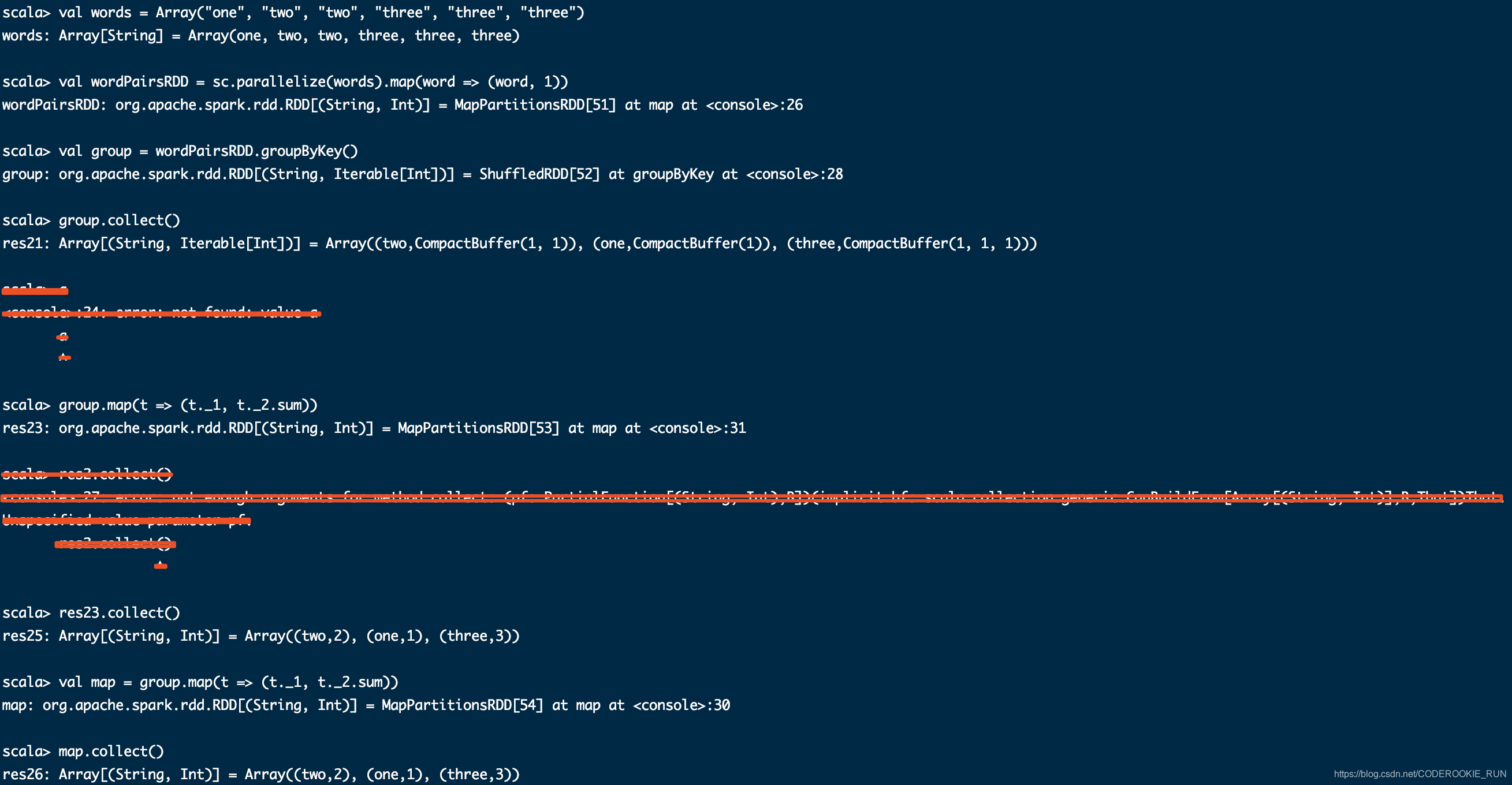

groupByKey

效率低下,尽量不要用

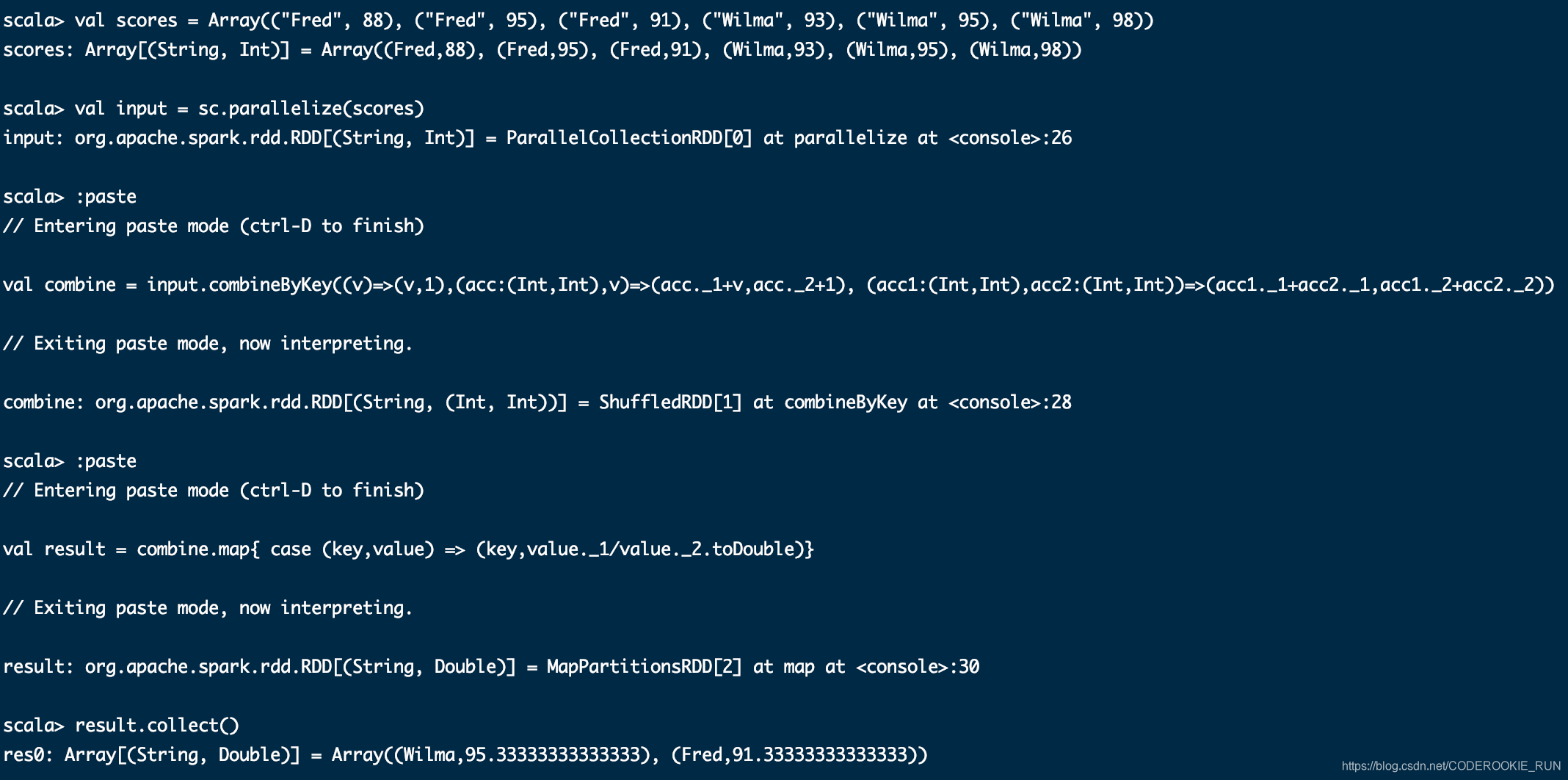

combineByKey

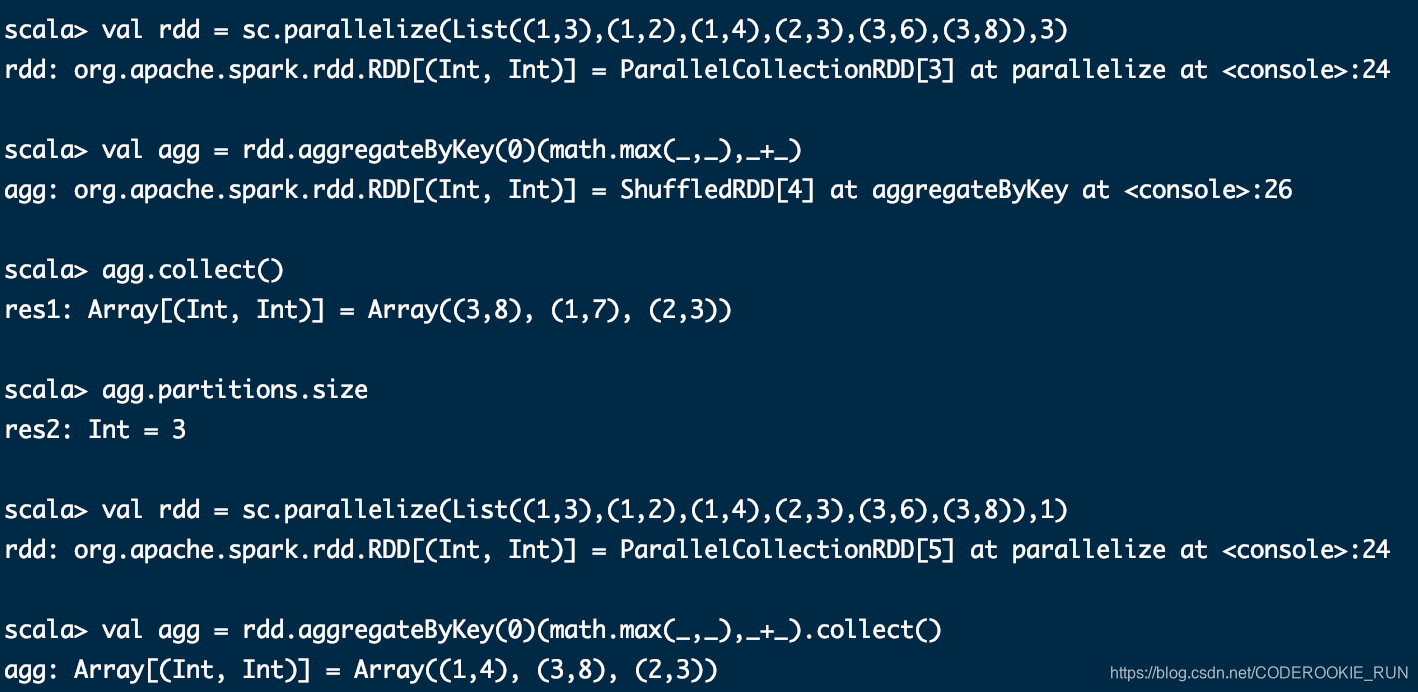

aggregateByKey(zeroValue:U,[partitioner: Partitioner]) (seqOp: (U, V) => U,combOp: (U, U) => U)

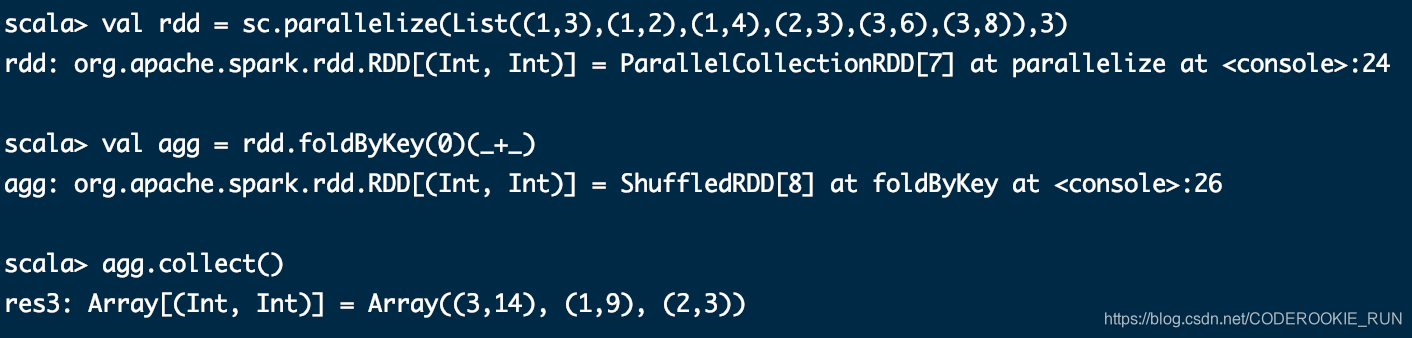

foldByKey(zeroValue: V)(func: (V, V) => V): RDD[(K, V)]

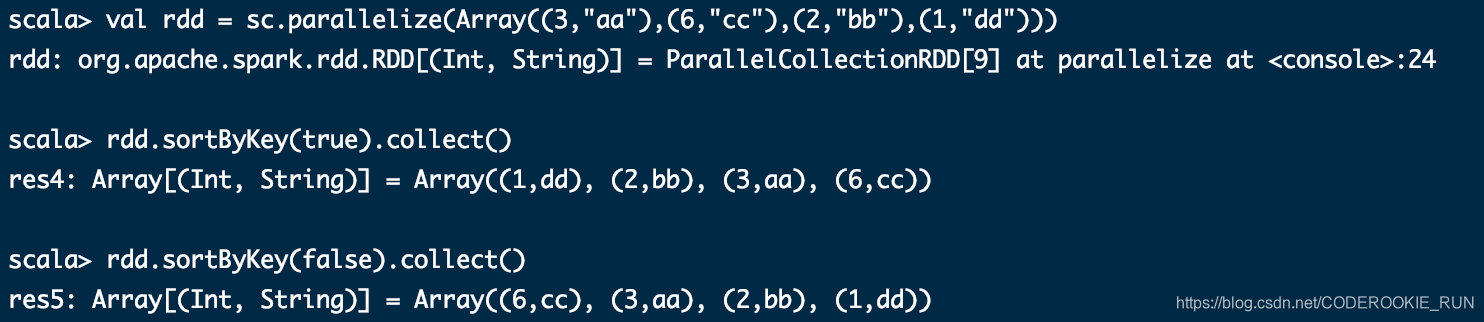

sortByKey([ascending], [numTasks])

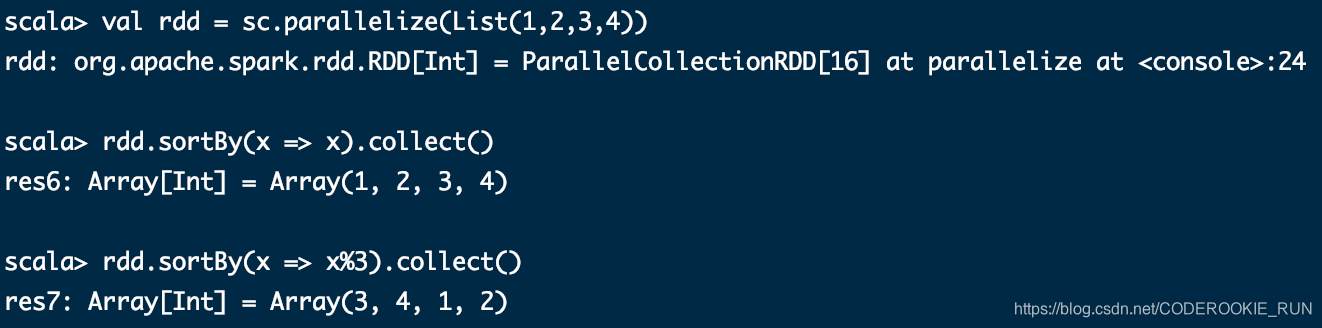

sortBy(func,[ascending], [numTasks])

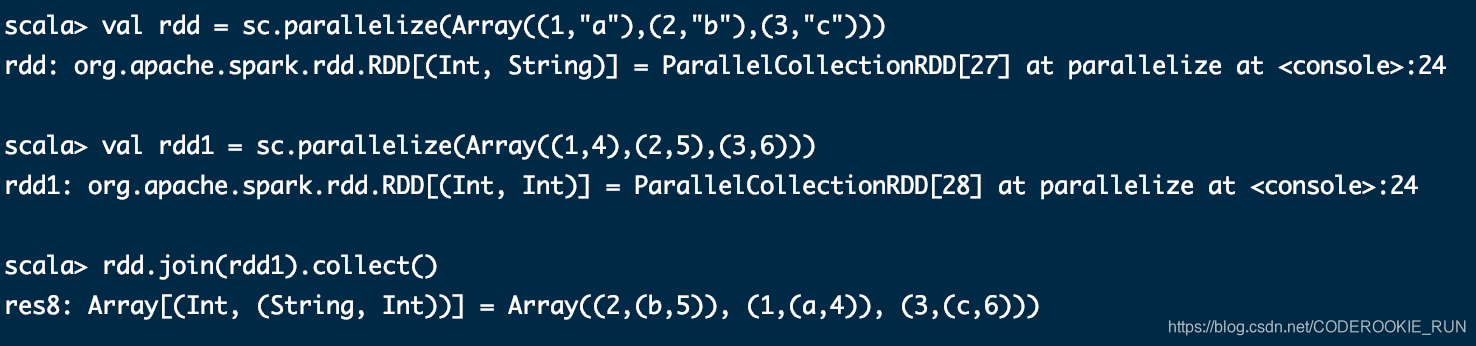

join(otherDataset, [numTasks])

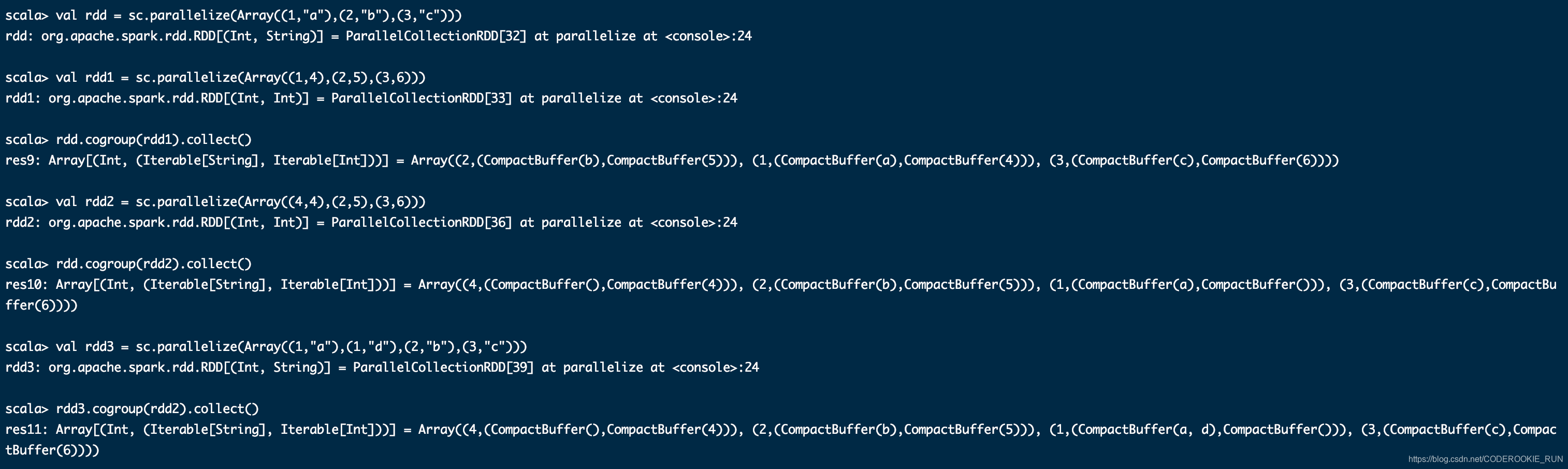

cogroup(otherDataset, [numTasks])

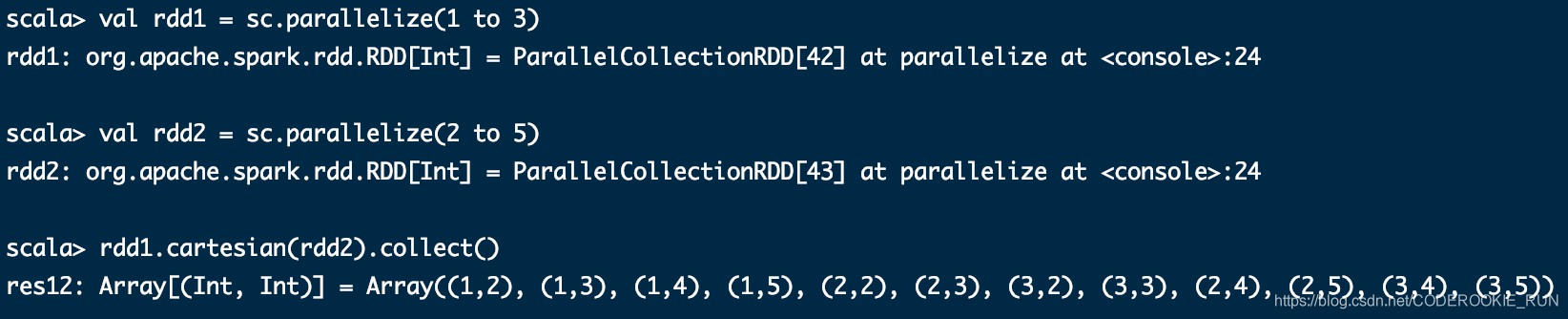

cartesian(otherDataset)

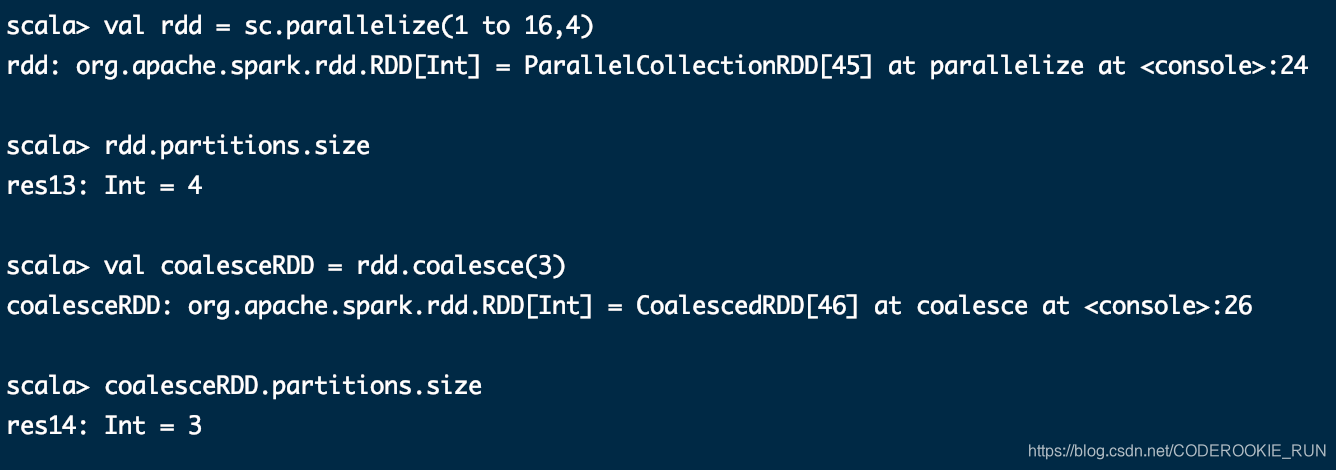

coalesce(numPartitions)

缩减分区数到指定的值,分区的个数只能减少,不能变多。不会产生shuffle过程

适用于一些大的数据集filter过滤之后,进行缩减分区,提高效率

1280M数据 ==> 10个block块 ==> 10个分区,每个分区128M数据 ==> filter ==> 10个分区,每个分区里面剩下了1KB数据 ==> coalesce => 1个分区

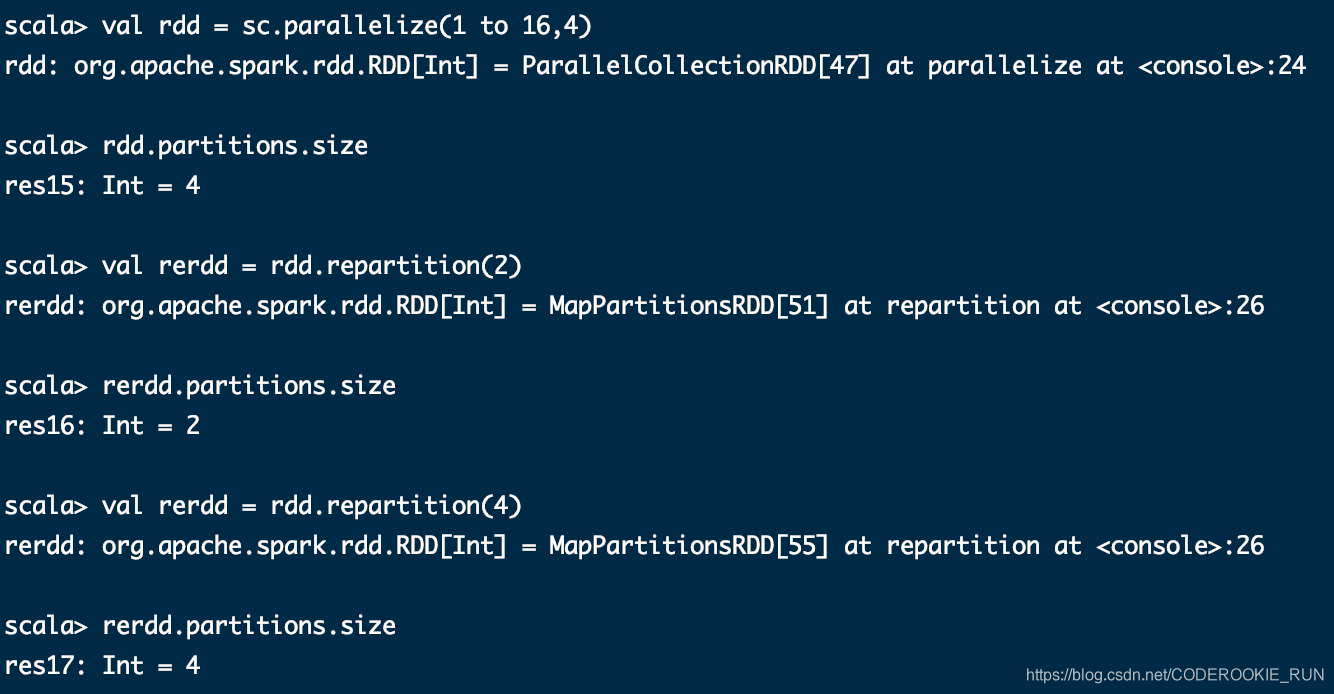

repartition(numPartitions)

数据随机洗牌冲洗分区,没有任何规则,可以将分区数变大,或者变小,会产生shuffle的过程

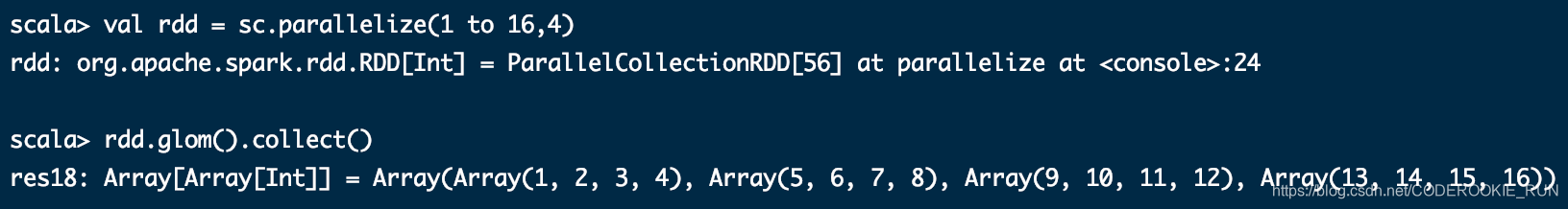

glom

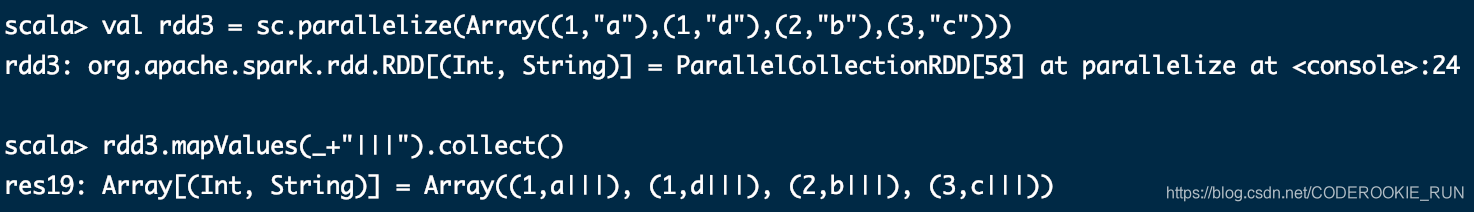

mapValues

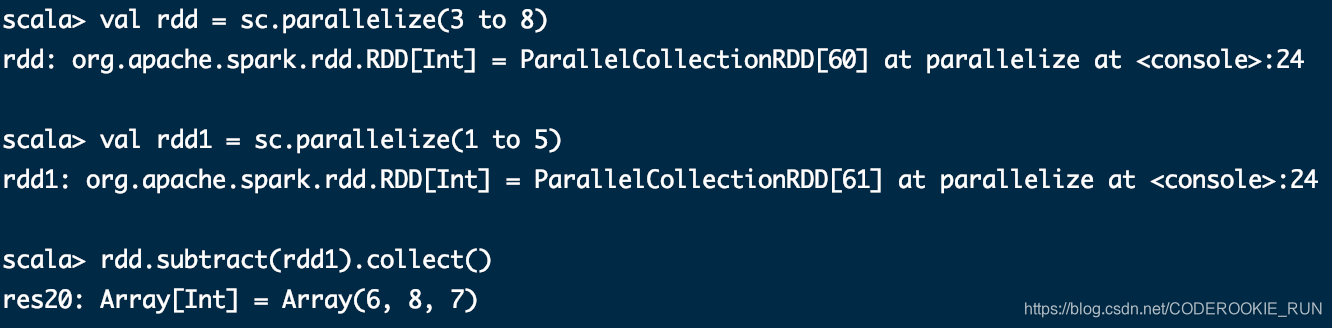

subtract

Action

帮助文档

http://spark.apache.org/docs/2.2.0/rdd-programming-guide.html#actions

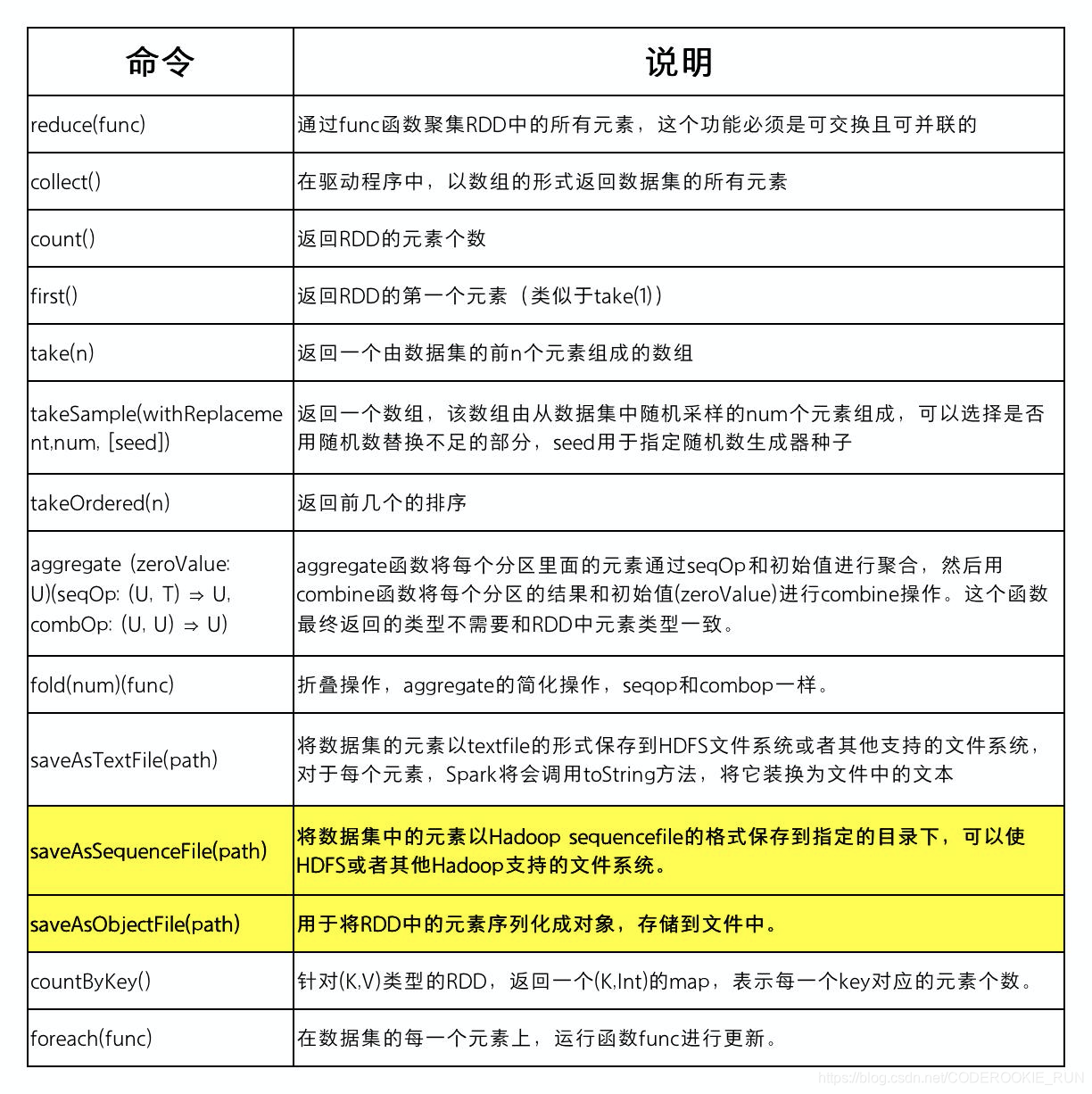

常用Action表

Action使用实例

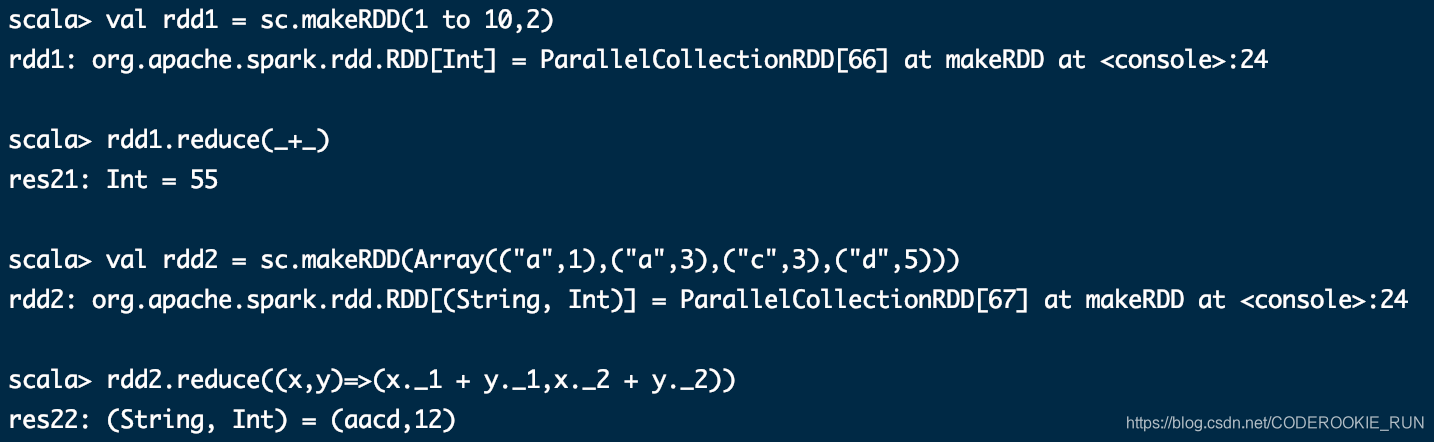

reduce(func)

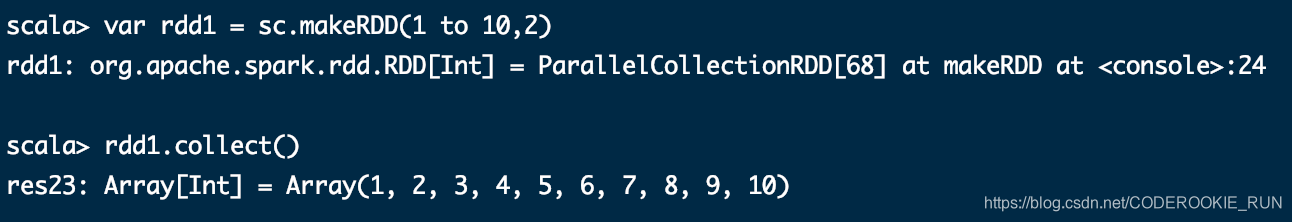

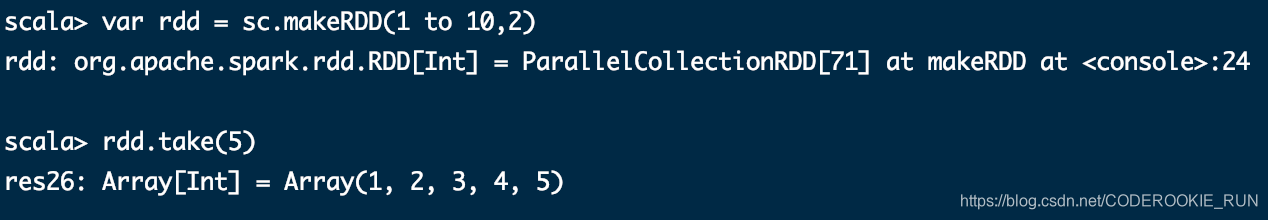

collect()

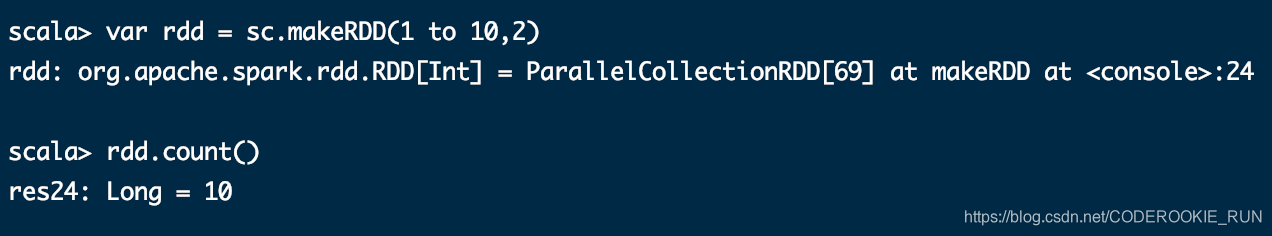

count()

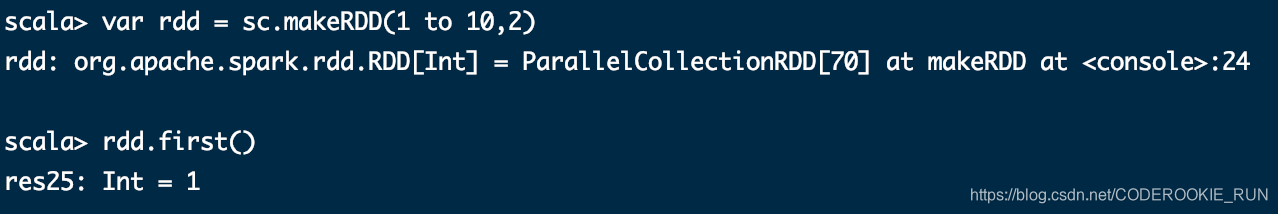

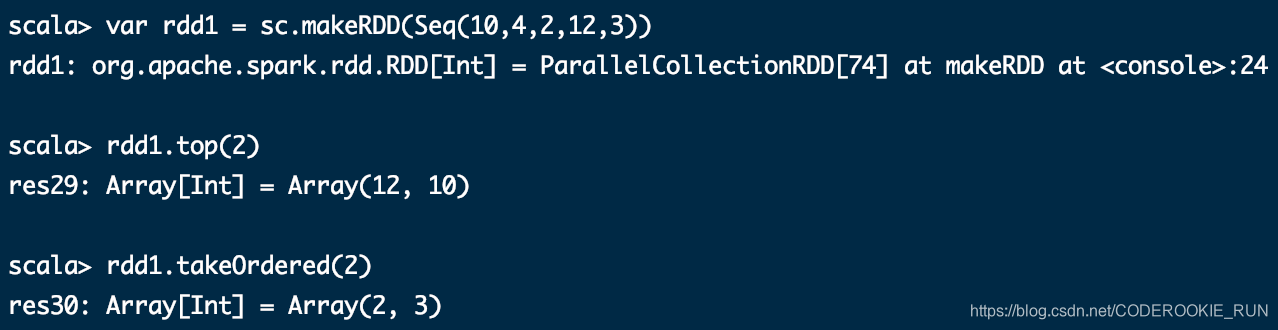

first()

take(n)

takeSample(withReplacement,num, [seed])

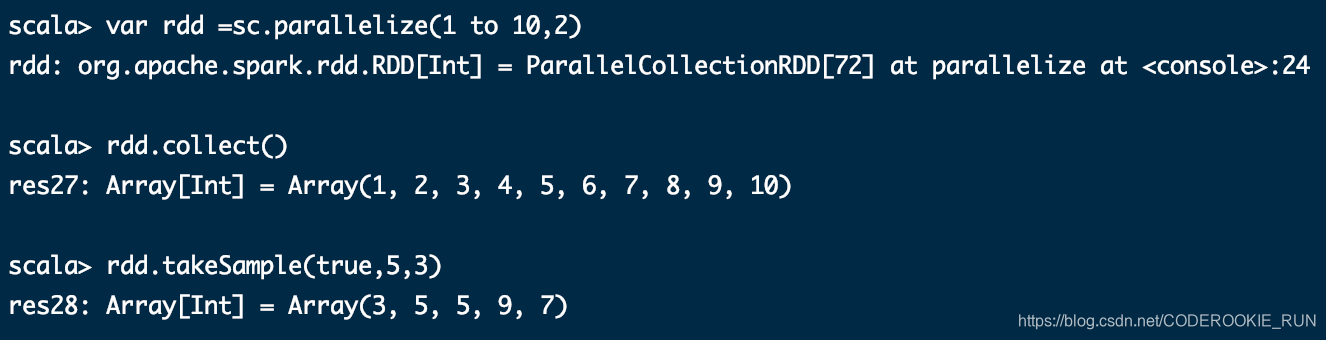

takeOrdered(n)

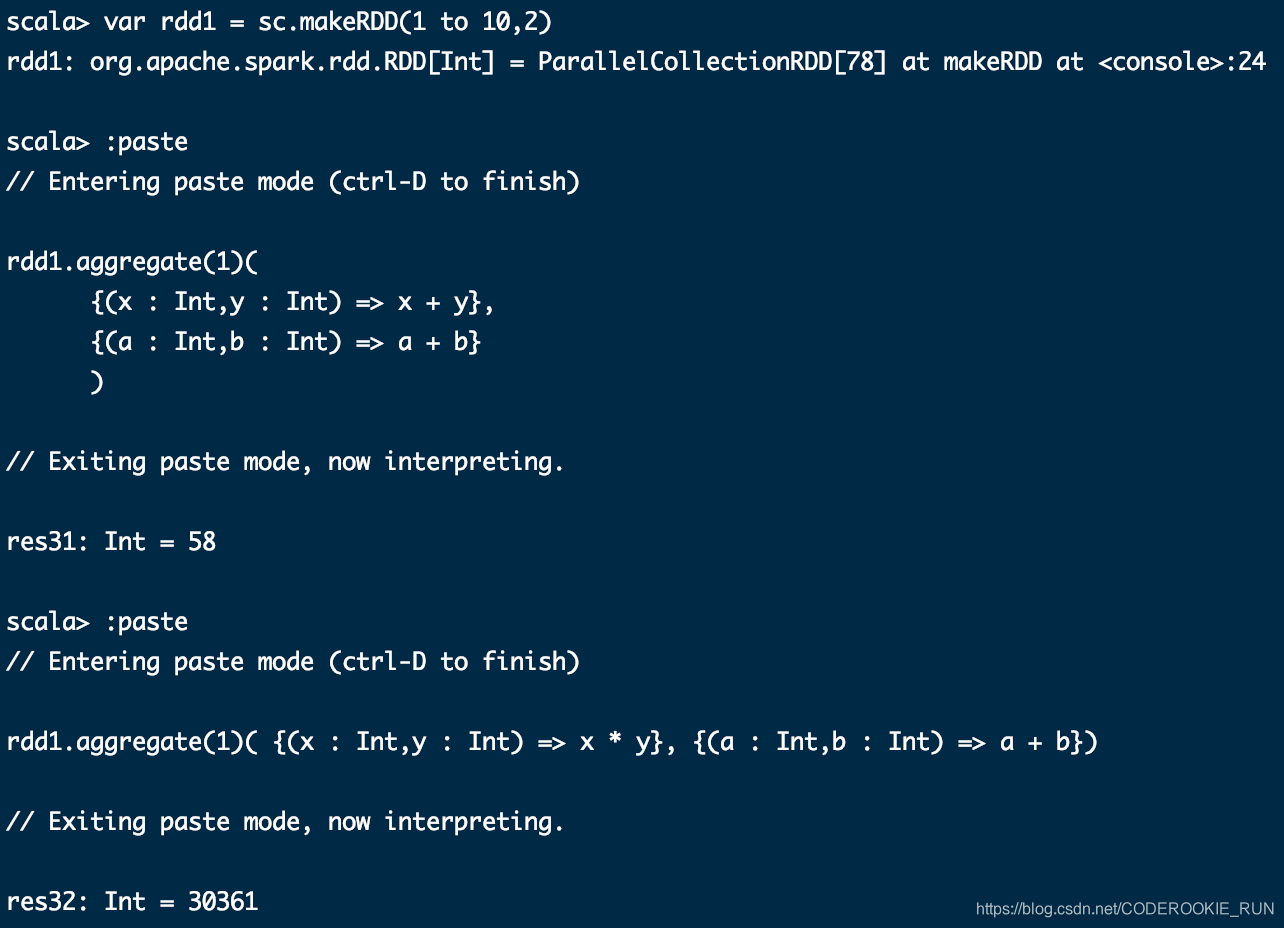

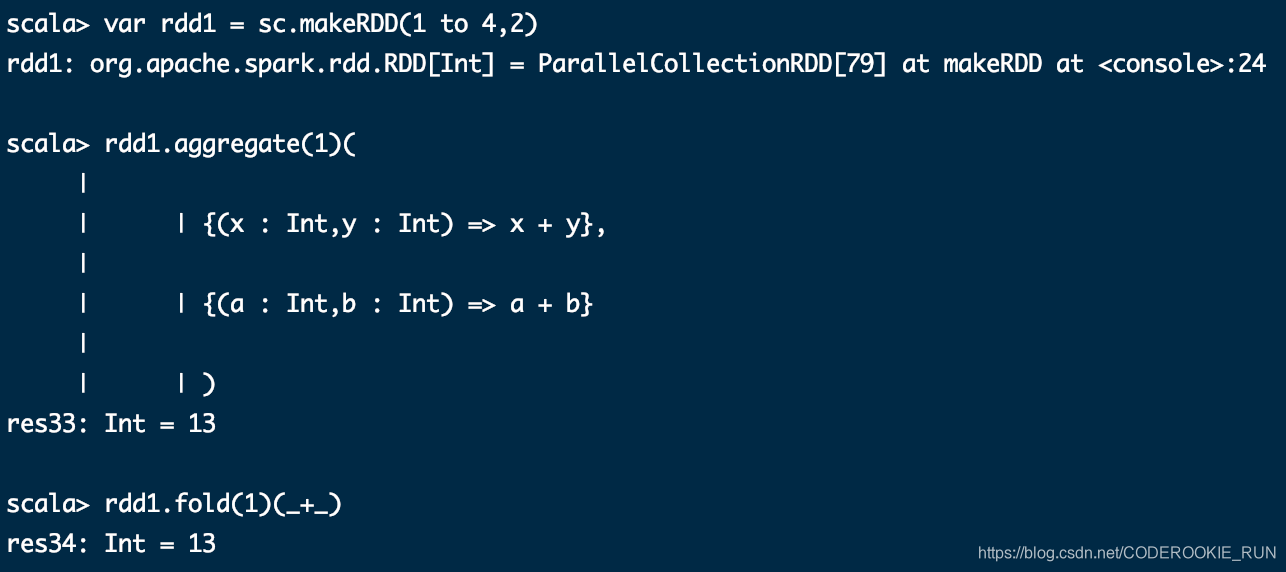

aggregate (zeroValue: U)(seqOp: (U, T) ⇒ U, combOp: (U, U) ⇒ U)

fold(num)(func)

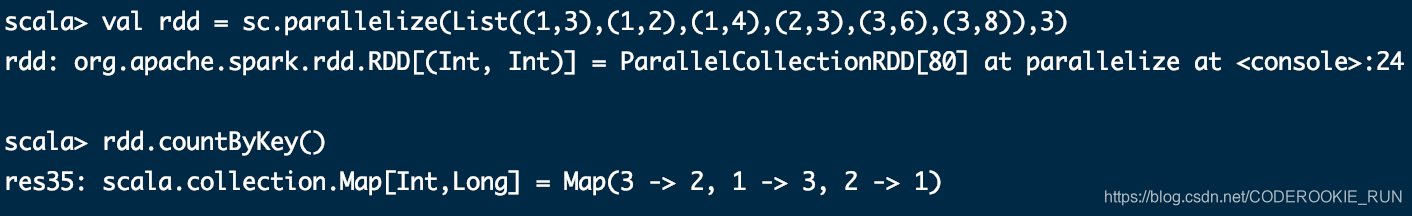

countByKey

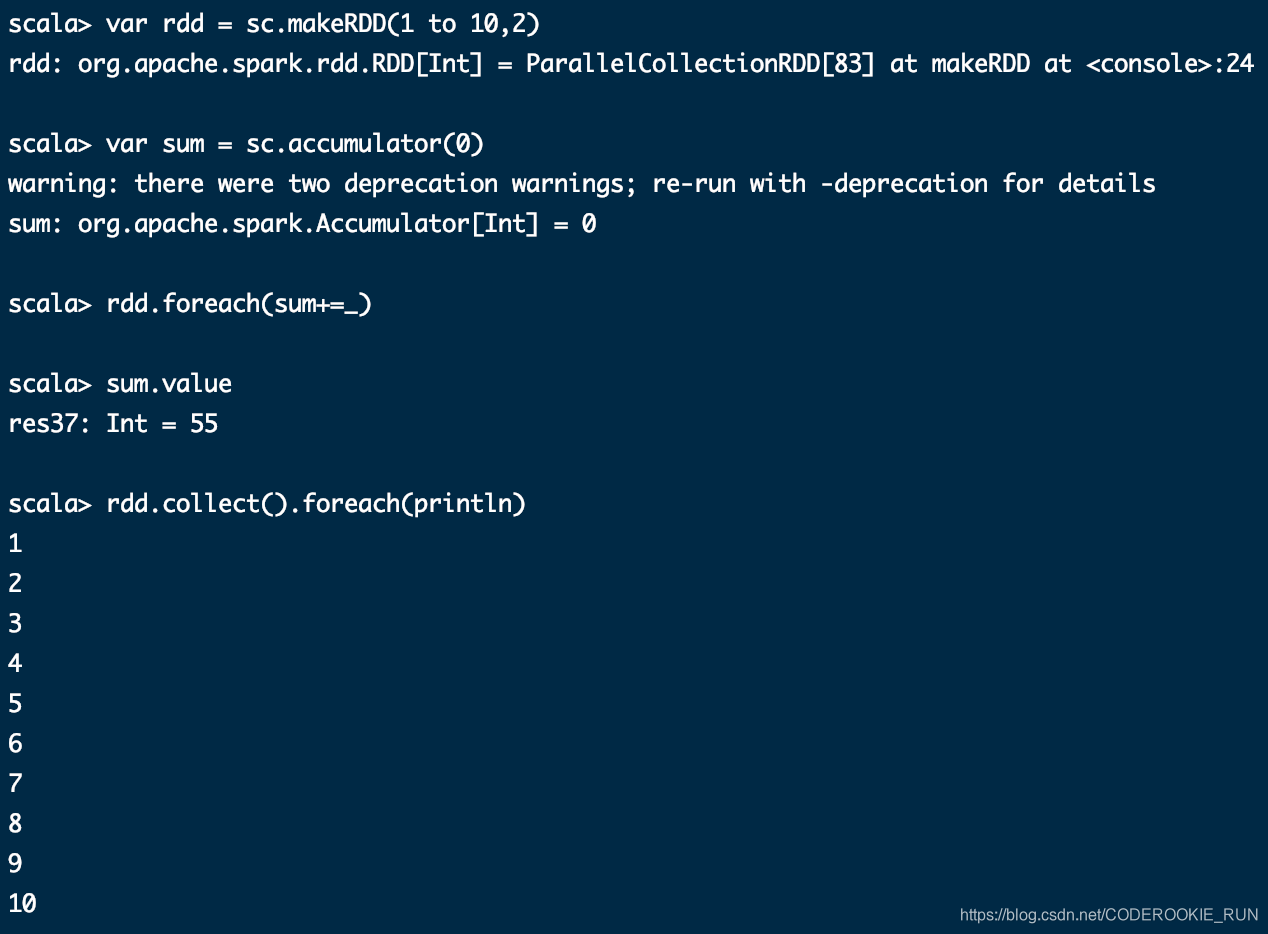

foreach(func)

这里没有列出所有的算子,更多算子可以到RDD的源码中查看

【Spark】快来学习RDD的创建以及操作方式吧!的更多相关文章

- 【原】Learning Spark (Python版) 学习笔记(一)----RDD 基本概念与命令

<Learning Spark>这本书算是Spark入门的必读书了,中文版是<Spark快速大数据分析>,不过豆瓣书评很有意思的是,英文原版评分7.4,评论都说入门而已深入不足 ...

- Spark RDD概念学习系列之RDD的创建(六)

RDD的创建 两种方式来创建RDD: 1)由一个已经存在的Scala集合创建 2)由外部存储系统的数据集创建,包括本地文件系统,还有所有Hadoop支持的数据集,比如HDFS.Cassandra.H ...

- Learning Spark (Python版) 学习笔记(一)----RDD 基本概念与命令

<Learning Spark>这本书算是Spark入门的必读书了,中文版是<Spark快速大数据分析>,不过豆瓣书评很有意思的是,英文原版评分7.4,评论都说入门而已深入不足 ...

- 【Spark】【RDD】初次学习RDD 笔记 汇总

RDD Author:萌狼蓝天 [哔哩哔哩]萌狼蓝天 [博客]https://mllt.cc [博客园]萌狼蓝天 - 博客园 [微信公众号]mllt9920 [学习交流QQ群]238948804 目录 ...

- 【原】Learning Spark (Python版) 学习笔记(三)----工作原理、调优与Spark SQL

周末的任务是更新Learning Spark系列第三篇,以为自己写不完了,但为了改正拖延症,还是得完成给自己定的任务啊 = =.这三章主要讲Spark的运行过程(本地+集群),性能调优以及Spark ...

- SPARK快学大数据分析概要

Spark 是一个用来实现快速而通用的集群计算的平台.在速度方面,Spark 扩展了广泛使用的MapReduce 计算模型,而且高效地支持更多计算模式,包括交互式查询和流处理.在处理大规模数据集时,速 ...

- 【原创】大数据基础之Spark(4)RDD原理及代码解析

一 简介 spark核心是RDD,官方文档地址:https://spark.apache.org/docs/latest/rdd-programming-guide.html#resilient-di ...

- spark第一篇:RDD Programming Guide

预览 在高层次上,每一个Spark应用(application)都包含一个驱动程序(driver program),该程序运行用户的主函数(main function),并在集群上执行各种并行操作. ...

- Spark 并行计算模型:RDD

Spark 允许用户为driver(或主节点)编写运行在计算集群上,并行处理数据的程序.在Spark中,它使用RDDs代表大型的数据集,RDDs是一组不可变的分布式的对象的集合,存储在executor ...

随机推荐

- 怎么自定义DataGridViewColumn(日期列,C#)

参考:https://msdn.microsoft.com/en-us/library/7tas5c80.aspx 未解决的问题:如果日期要设置为null,怎么办? DataGridView控件提供了 ...

- 官方解读:Salesforce线上考试新政与福利

随着疫情在世界范围内的迅速蔓延,Salesforce推出了一系列的线上认证考试改进方案,方便Salesforce从业者在疫情阶段也能够安全.便利地参与考试,今天让我们一起来捋一捋那些,和我们密切相关的 ...

- 一个好的olap框架

一.何为一个好的olap框架? 框架大概分为两种: (1)底层技术框架,专注于抽象底层技术,如网络通信netty.中间件kafka等 (2)开发人员框架,专注于提高开发效率,如spring的面向切面和 ...

- 使用redis-dump与redis-load方式迁移redis数据库

实际生产场景中,有可能会因为迁移机房或者更换物理机等原因需要在生产环境迁移redis数据.本文就来为大家介绍一下迁移redis数据的方法. 迁移redis数据一般有如下3种方式: 1.第三方工具red ...

- 2.react-插件

PC: antd(蚂蚁金服)https://ant.design/index-cn 移动: mobile-antd(蚂蚁金服)https://mobile.ant.design =========== ...

- PHP代码审计理解(一)----Metinfo5.0变量覆盖

0x01 漏洞简介 这个漏洞是metinfo5.0变量覆盖漏洞,并且需要结合文件包含.我使用的cms版本是5.3,事实上已经修复了这个漏洞(5.0的cms源码已经找不到了哈),但是我们可以借他来学习理 ...

- mysql 使用记录

修改 mysql 数据库密码 mysqladmin -u username -h host_name password -P <port> "new_password" ...

- Mac安装Nginx、Mysql、PHP、Redis

安装xcode命令行工具的命令 xcode-select --install 安装homebrew: ruby -e "$(curl -fsSL https://raw.githubus ...

- elementaryos5安装mysql5.7、php7.2、nginx1.14.0

一.mysql5.7 安装mysql5.7: sudo apt-get install mysql-server-5.7 查看安装的mysql版本: mysql -V 5.7版本mysql安装过程中以 ...

- (第七篇)系统编码、自启动配置、HOSTNAME、系统启动、定时任务、进程管理、硬盘及其分区

linux查看系统编码和修改系统编码的方法 查看支持的字符编码 使用locale命令, 如: root@ubuntu:/etc# locale 然后修改/etc/locale.conf,如改成中文编码 ...