Python3实现文本预处理

1、数据集准备

测试数据集下载:https://github.com/Asia-Lee/Vulnerability_classify/blob/master/testdata.xls

停用词过滤表下载:https://github.com/Asia-Lee/Vulnerability_classify/blob/master/stopwords.txt

2、数据预处理

(1)简单分词

# -*- coding: utf-8 -*- import pandas as pd

import jieba

"""

函数说明:简单分词

Parameters:

filename:数据文件

Returns:

list_word_split:分词后的数据集列表

category_labels: 文本标签列表

"""

def word_split(filename):

read_data=pd.read_excel(filename)

list_word_split=[]

category_labels=[]

for i in range(len(read_data)):

row_data = read_data.iloc[i, 1] # 读取单个漏洞描述文本

list_row_data = list(jieba.cut(row_data)) # 对单个漏洞进行分词

list_row_data=[x for x in list_row_data if x!=' '] #去除列表中的空格字符

list_word_split.append(list_row_data) row_data_label=read_data.iloc[i,2] #读取单个漏洞的类别标签

category_labels.append(row_data_label) #将单个漏洞的类别标签加入列表

return list_word_split, category_labels if __name__=='__main__':

list_word_split, category_labels=word_split('testdata.xls') #获得每条文本的分词列表和标签列表

print(list_word_split)

print(category_labels)

print('分词成功')

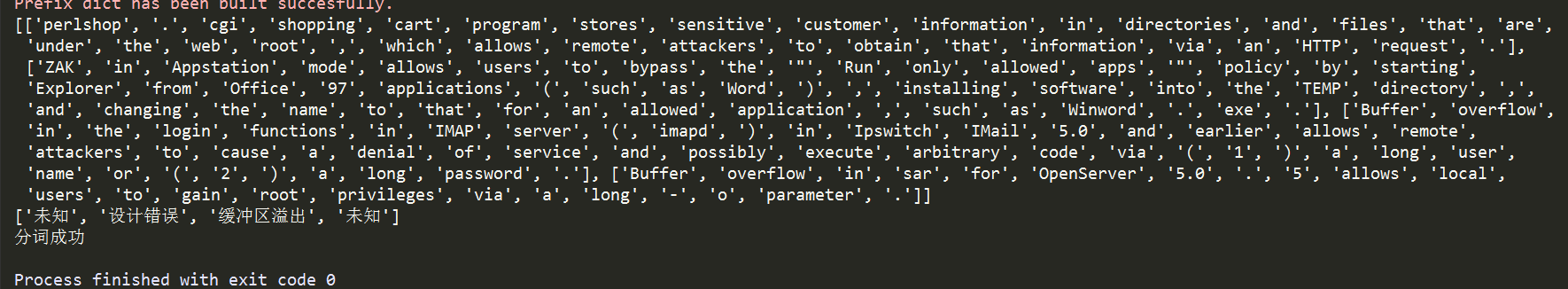

分词结果:

(2)词性还原

# -*- coding: utf-8 -*- import pandas as pd

import jieba

from nltk.stem import WordNetLemmatizer """

函数说明:词性还原

Parameters:

list_words:数据列表

Returns:

list_words_lemmatizer:词性还原后的数据集列表

"""

def word_lemmatizer(list_words):

wordnet_lemmatizer = WordNetLemmatizer()

list_words_lemmatizer = []

for word_list in list_words:

lemmatizer_word = []

for i in word_list:

lemmatizer_word.append(wordnet_lemmatizer.lemmatize(i))

list_words_lemmatizer.append(lemmatizer_word)

return list_words_lemmatizer if __name__=='__main__':

list_word_split, category_labels=word_split('testdata.xls') #获得每条文本的分词列表和标签列表

print('分词成功')

list_words_lemmatizer=word_lemmatizer(list_word_split) #词性还原

print('词性还原成功')

(3)停用词过滤

# -*- coding: utf-8 -*- import pandas as pd

import jieba

from nltk.stem import WordNetLemmatizer """

函数说明:停用词过滤

Parameters:

filename:停用词文件

list_words_lemmatizer:词列表

Returns:

list_filter_stopwords:停用词过滤后的词列表

"""

def stopwords_filter(filename,list_words_lemmatizer):

list_filter_stopwords=[] #声明一个停用词过滤后的词列表

with open(filename,'r') as fr:

stop_words=list(fr.read().split('\n')) #将停用词读取到列表里

for i in range(len(list_words_lemmatizer)):

word_list = []

for j in list_words_lemmatizer[i]:

if j not in stop_words:

word_list.append(j.lower()) #将词变为小写加入词列表

list_filter_stopwords.append(word_list)

return list_filter_stopwords if __name__=='__main__':

list_word_split, category_labels=word_split('testdata.xls') #获得每条文本的分词列表和标签列表

print('分词成功')

list_words_lemmatizer=word_lemmatizer(list_word_split) #词性还原

print('词性还原成功')

list_filter_stopwords=stopwords_filter('stopwords.txt',list_words_lemmatizer) #获得停用词过滤后的列表

print("停用词过滤成功")

(4)特征选择

对于处理这类文本数据,常用的特征选择方法有: TF-IDF(词频-逆向文档频率),信息增益、卡方检验、互信息、N-Gram

(5)文本标签向量化

"""

函数说明:文本向量化,标签向量化 one-hot编码

Parameters:

feature_words:特征词集

doc_words:文本列表

doc_category_labels:文本类别标签

Returns:

docvec_list:文本向量列表

labelvec_list:标签向量列表

"""

def words2vec(feature_words,doc_words,doc_category_labels):

#文本列表转向量列表

docvec_list=[]

for words in doc_words:

docvec = [0] * len(feature_words)

for j in words:

if j in feature_words:

docvec[feature_words.index(j)]=1

docvec_list.append(docvec)

#标签列表转向量列表

labelvec_list = []

labelset=list(set(doc_category_labels))

for label in doc_category_labels:

doclabel = [0] * len(labelset)

doclabel[labelset.index(label)]=1

labelvec_list.append(doclabel)

return docvec_list,labelvec_list

(6)选择算法模型进行训练(机器学习、深度学习)

Python3实现文本预处理的更多相关文章

- 浅谈NLP 文本分类/情感分析 任务中的文本预处理工作

目录 浅谈NLP 文本分类/情感分析 任务中的文本预处理工作 前言 NLP相关的文本预处理 浅谈NLP 文本分类/情感分析 任务中的文本预处理工作 前言 之所以心血来潮想写这篇博客,是因为最近在关注N ...

- 【NLP】Tika 文本预处理:抽取各种格式文件内容

Tika常见格式文件抽取内容并做预处理 作者 白宁超 2016年3月30日18:57:08 摘要:本文主要针对自然语言处理(NLP)过程中,重要基础部分抽取文本内容的预处理.首先我们要意识到预处理的重 ...

- Keras文本预处理

学习了Keras文档里的文本预处理部分,参考网上代码写了个例子 import keras.preprocessing.text as T from keras.preprocessing.text i ...

- [ DLPytorch ] 文本预处理&语言模型&循环神经网络基础

文本预处理 实现步骤(处理语言模型数据集距离) 文本预处理的实现步骤 读入文本:读入zip / txt 等数据集 with zipfile.ZipFile('./jaychou_lyrics.txt. ...

- NLP自然语言处理入门-- 文本预处理Pre-processing

引言 自然语言处理NLP(nature language processing),顾名思义,就是使用计算机对语言文字进行处理的相关技术以及应用.在对文本做数据分析时,我们一大半的时间都会花在文本预处理 ...

- L4文本预处理

文本预处理 timemachine.txt数据下载地址 链接:https://pan.baidu.com/s/1RO2OLyTRQZ90HJUW7V7BCQ 提取码:bjox NLTK数据集下载 链接 ...

- 学习笔记--python中使用多进程、多线程加速文本预处理

一.任务描述 最近尝试自行构建skip-gram模型训练word2vec词向量表.其中有一步需要统计各词汇的出现频率,截取出现频率最高的10000个词汇进行保留,形成常用词词典.对于这个问题,我建立了 ...

- NLP 文本预处理

1.不同类别文本量统计,类别不平衡差异 2.文本长度统计 3.文本处理,比如文本语料中简体与繁体共存,这会加大模型的学习难度.因此,他们对数据进行繁体转简体的处理. 同时,过滤掉了对分类没有任何作用的 ...

- Python3之文本操作

文件操作示例分析: 文件操作一般要经历三个步骤: 打开文件 操作文件 关闭文件 读取操作示例: >>>f = open('test.txt', 'r') # 打开文件test.txt ...

随机推荐

- 特征提取算法(4)——LoG特征提取算法

目录 1.介绍 2.LoG原理 3.数学原理 4.模板性质 1.介绍 LoG(DoG是一阶边缘提取)是二阶拉普拉斯-高斯边缘提取算法,先高斯滤波然后拉普拉斯边缘提取. Laplace算子对通过图像进行 ...

- 如何理解重载与重写——Overload vs Override/Overwrite

重载: 在同一个类中,拥有类似功能的同名方法之间的关系叫做重载. 重载的条件:1.具有相同方法名和类似功能: 2.参数的类型或者个数不同: 3.与返回值无关: 重写: 在子父类的继承关系中,子类继承父 ...

- 前端String类型转JSON类型

在js中通过ajax获取数据后,赋值给前端树形插件zTree中的zNodes,但一直失败如图: 浏览器端报错: 于是我将zNodes变量的值直接写死,并打印这两个的值,如图 再次运行成功.浏览器控制台 ...

- jq和js用法:入口写法

jq和js入口写法demo: <!DOCTYPE html> <html lang="en"> <head> <meta charset= ...

- ORACLE Physical Standby 级联备库搭建

搭建oracle 级联DG 现有架构:physical standby 一主二备,在此基础上,在主库下新建备库standby3.级联备库cascade 数据库版本 11.2.0.4 db_name=p ...

- 图书-软件架构:《Design Patterns: Elements of Reusable Object-Oriented Software》(即后述《设计模式》一书)

ylbtech-图书-软件架构:<Design Patterns: Elements of Reusable Object-Oriented Software>(即后述<设计模式&g ...

- 005-unity3d 添加背景音乐、音效 以及 天空盒子

一.基础知识 1.项目中需要有AudioListener,播放器中播放的声音就是AudioListener组件坐在的位置听到的声音.默认AudioListener是放到Main Camera上.没有A ...

- iptables中文帮助

Iptables(8) ...

- sorted()与sort()函数

1 sorted可以对series,ndarry,list类型进行排序 默认会从小到大进行排序 arr1 = np.array([1,2,3,4,44,3243,43,8678]) print(sor ...

- try...catch语句

程序的异常:Throwable 严重问题Error我们不处理,这种问题一般都是很严重的,比如内存溢出 问题Exception 编译期问题不是RuntimeException的异常必须进行处理,如果不处 ...