JDBC批量Insert深度优化(有事务)

CREATE TABLE tuser ( id bigint(20) NOT NULL AUTO_INCREMENT, name varchar(12) DEFAULT NULL, remark varchar(24) DEFAULT NULL, createtime datetime DEFAULT NULL, updatetime datetime DEFAULT NULL, PRIMARY KEY (id) ) ENGINE=InnoDB AUTO_INCREMENT=1 DEFAULT CHARSET=utf8;

import java.io.IOException;

import java.sql.*;

/**

* JDBC批量Insert优化(下)

*

* @author leizhimin 2009-7-29 10:03:10

*/

public class TestBatch {

public static DbConnectionBroker myBroker = null;

static {

try {

myBroker = new DbConnectionBroker("com.mysql.jdbc.Driver",

"jdbc:mysql://192.168.104.163:3306/testdb",

"vcom", "vcom", 2, 4,

"c:\\testdb.log", 0.01);

} catch (IOException e) {

e.printStackTrace();

}

}

/**

* 初始化测试环境

*

* @throws SQLException 异常时抛出

*/

public static void init() throws SQLException {

Connection conn = myBroker.getConnection();

conn.setAutoCommit(false);

Statement stmt = conn.createStatement();

stmt.addBatch("DROP TABLE IF EXISTS tuser");

stmt.addBatch("CREATE TABLE tuser (\n" +

" id bigint(20) NOT NULL AUTO_INCREMENT,\n" +

" name varchar(12) DEFAULT NULL,\n" +

" remark varchar(24) DEFAULT NULL,\n" +

" createtime datetime DEFAULT NULL,\n" +

" updatetime datetime DEFAULT NULL,\n" +

" PRIMARY KEY (id)\n" +

") ENGINE=InnoDB AUTO_INCREMENT=1 DEFAULT CHARSET=utf8");

stmt.executeBatch();

conn.commit();

myBroker.freeConnection(conn);

}

/**

* 100000条静态SQL插入

*

* @throws Exception 异常时抛出

*/

public static void testInsert() throws Exception {

init(); //初始化环境

Long start = System.currentTimeMillis();

for (int i = 0; i < 100000; i++) {

String sql = "\n" +

"insert into testdb.tuser \n" +

"\t(name, \n" +

"\tremark, \n" +

"\tcreatetime, \n" +

"\tupdatetime\n" +

"\t)\n" +

"\tvalues\n" +

"\t('" + RandomToolkit.generateString(12) + "', \n" +

"\t'" + RandomToolkit.generateString(24) + "', \n" +

"\tnow(), \n" +

"\tnow()\n" +

")";

Connection conn = myBroker.getConnection();

conn.setAutoCommit(false);

Statement stmt = conn.createStatement();

stmt.execute(sql);

conn.commit();

myBroker.freeConnection(conn);

}

Long end = System.currentTimeMillis();

System.out.println("单条执行100000条Insert操作,共耗时:" + (end - start) / 1000f + "秒!");

}

/**

* 批处理执行静态SQL测试

*

* @param m 批次

* @param n 每批数量

* @throws Exception 异常时抛出

*/

public static void testInsertBatch(int m, int n) throws Exception {

init(); //初始化环境

Long start = System.currentTimeMillis();

for (int i = 0; i < m; i++) {

//从池中获取连接

Connection conn = myBroker.getConnection();

conn.setAutoCommit(false);

Statement stmt = conn.createStatement();

for (int k = 0; k < n; k++) {

String sql = "\n" +

"insert into testdb.tuser \n" +

"\t(name, \n" +

"\tremark, \n" +

"\tcreatetime, \n" +

"\tupdatetime\n" +

"\t)\n" +

"\tvalues\n" +

"\t('" + RandomToolkit.generateString(12) + "', \n" +

"\t'" + RandomToolkit.generateString(24) + "', \n" +

"\tnow(), \n" +

"\tnow()\n" +

")";

//加入批处理

stmt.addBatch(sql);

}

stmt.executeBatch(); //执行批处理

conn.commit();

// stmt.clearBatch(); //清理批处理

stmt.close();

myBroker.freeConnection(conn); //连接归池

}

Long end = System.currentTimeMillis();

System.out.println("批量执行" + m + "*" + n + "=" + m * n + "条Insert操作,共耗时:" + (end - start) / 1000f + "秒!");

}

/**

* 100000条预定义SQL插入

*

* @throws Exception 异常时抛出

*/

public static void testInsert2() throws Exception { //单条执行100000条Insert操作,共耗时:40.422秒!

init(); //初始化环境

Long start = System.currentTimeMillis();

String sql = "" +

"insert into testdb.tuser\n" +

" (name, remark, createtime, updatetime)\n" +

"values\n" +

" (?, ?, ?, ?)";

for (int i = 0; i < 100000; i++) {

Connection conn = myBroker.getConnection();

conn.setAutoCommit(false);

PreparedStatement pstmt = conn.prepareStatement(sql);

pstmt.setString(1, RandomToolkit.generateString(12));

pstmt.setString(2, RandomToolkit.generateString(24));

pstmt.setDate(3, new Date(System.currentTimeMillis()));

pstmt.setDate(4, new Date(System.currentTimeMillis()));

pstmt.executeUpdate();

conn.commit();

pstmt.close();

myBroker.freeConnection(conn);

}

Long end = System.currentTimeMillis();

System.out.println("单条执行100000条Insert操作,共耗时:" + (end - start) / 1000f + "秒!");

}

/**

* 批处理执行预处理SQL测试

*

* @param m 批次

* @param n 每批数量

* @throws Exception 异常时抛出

*/

public static void testInsertBatch2(int m, int n) throws Exception {

init(); //初始化环境

Long start = System.currentTimeMillis();

String sql = "" +

"insert into testdb.tuser\n" +

" (name, remark, createtime, updatetime)\n" +

"values\n" +

" (?, ?, ?, ?)";

for (int i = 0; i < m; i++) {

//从池中获取连接

Connection conn = myBroker.getConnection();

conn.setAutoCommit(false);

PreparedStatement pstmt = conn.prepareStatement(sql);

for (int k = 0; k < n; k++) {

pstmt.setString(1, RandomToolkit.generateString(12));

pstmt.setString(2, RandomToolkit.generateString(24));

pstmt.setDate(3, new Date(System.currentTimeMillis()));

pstmt.setDate(4, new Date(System.currentTimeMillis()));

//加入批处理

pstmt.addBatch();

}

pstmt.executeBatch(); //执行批处理

conn.commit();

// pstmt.clearBatch(); //清理批处理

pstmt.close();

myBroker.freeConnection(conn); //连接归池

}

Long end = System.currentTimeMillis();

System.out.println("批量执行" + m + "*" + n + "=" + m * n + "条Insert操作,共耗时:" + (end - start) / 1000f + "秒!");

}

public static void main(String[] args) throws Exception {

init();

Long start = System.currentTimeMillis();

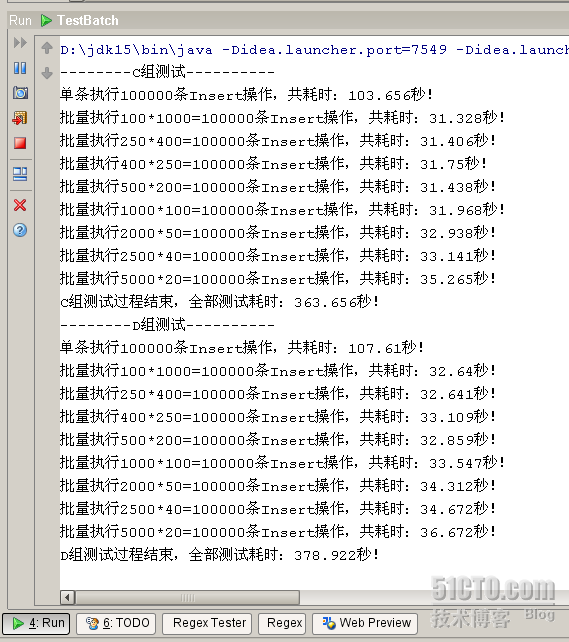

System.out.println("--------C组测试----------");

testInsert();

testInsertBatch(100, 1000);

testInsertBatch(250, 400);

testInsertBatch(400, 250);

testInsertBatch(500, 200);

testInsertBatch(1000, 100);

testInsertBatch(2000, 50);

testInsertBatch(2500, 40);

testInsertBatch(5000, 20);

Long end1 = System.currentTimeMillis();

System.out.println("C组测试过程结束,全部测试耗时:" + (end1 - start) / 1000f + "秒!");

System.out.println("--------D组测试----------");

testInsert2();

testInsertBatch2(100, 1000);

testInsertBatch2(250, 400);

testInsertBatch2(400, 250);

testInsertBatch2(500, 200);

testInsertBatch2(1000, 100);

testInsertBatch2(2000, 50);

testInsertBatch2(2500, 40);

testInsertBatch2(5000, 20);

Long end2 = System.currentTimeMillis();

System.out.println("D组测试过程结束,全部测试耗时:" + (end2 - end1) / 1000f + "秒!");

}

}

JDBC批量Insert深度优化(有事务)的更多相关文章

- JDBC批量插入数据优化,使用addBatch和executeBatch

JDBC批量插入数据优化,使用addBatch和executeBatch SQL的批量插入的问题,如果来个for循环,执行上万次,肯定会很慢,那么,如何去优化呢? 解决方案:用 preparedSta ...

- JDBC批量插入优化addbatch

// 获取要设置的Arp基准的List后,插入Arp基准表中 public boolean insertArpStandardList(List<ArpTable> list) { Con ...

- Mybatis与JDBC批量插入MySQL数据库性能测试及解决方案

转自http://www.cnblogs.com/fnz0/p/5713102.html 不知道自己什么时候才有这种钻研精神- -. 1 背景 系统中需要批量生成单据数据到数据库表,所以采用 ...

- JDBC批量执行executeBatch

JDBC事务 在数据库中,所谓事务是指一组逻辑操作单元,使数据从一种状态变换到另一种状态.为确保数据库中数据的一致性,数据的操纵应当是离散的成组的逻辑单元:当它全部完成时,数据的一致性可以保持,而当这 ...

- Spring源码深度解析之事务

Spring源码深度解析之事务 目录 一.JDBC方式下的事务使用示例 (1)创建数据表结构 (2)创建对应数据表的PO (3)创建表和实体之间的映射 (4)创建数据操作接口 (5)创建数据操作接口实 ...

- JDBC、JTA、Spring的事务管理

Java事务的类型有三种:JDBC事务.JTA(Java Transaction API)事务.容器事务. 事务就是对一系列的数据库操作(比如插入多条数据)进行统一的提交或回滚操作,如果插入成功,那么 ...

- java批量insert入mysql数据库

mysql 批量insert语句为 insert into Table_(col1,col2...) values(val11,val12...),(val11,val12...),...; java ...

- OracleHelper(对增删改查分页查询操作进行了面向对象的封装,对批量增删改操作的事务封装)

公司的一个新项目使用ASP.NET MVC开发,经理让我写个OracleHelper,我从网上找了一个比较全的OracleHelper类,缺点是查询的时候返回DataSet,数据增删改要写很多代码(当 ...

- MySQL内核深度优化

版权声明:本文由简怀兵原创文章,转载请注明出处: 文章原文链接:https://www.qcloud.com/community/article/179 来源:腾云阁 https://www.qclo ...

随机推荐

- JAVA NIO系列(三) Buffer 解读

缓冲区分类 NIO中的buffer用于和通道交互,数据是从通道读入缓冲区,从缓冲区中写入通道的.Buffer就像一个数组,可以保存多个类型相同的数据.每种基本数据类型都有对应的Buffer类: 缓冲区 ...

- 通用窗口类 Inventory Pro 2.1.2 Demo1(下续篇 ),物品消耗扇形显示功能

本篇想总结的是Inventory Pro中通用窗口的具体实现,但还是要强调下该插件的重点还是装备系统而不是通用窗口系统,所以这里提到的通用窗口类其实是通用装备窗口类(其实该插件中也有非装备窗口比如No ...

- IDEA SDK(Software Development Kit) 介绍

如上图标注 1 所示,IntelliJ IDEA 支持 6 种 SDK.最常用的就是 JDK 和 Android SDK,其中在创建 Android SDK 的时候如果你没有先配置一个 JDK 的话, ...

- Activity之间的数据传递

最常用的Activity之间的数据传递. btnStartAty1.setOnClickListener(new View.OnClickListener() { @Override public v ...

- [原创]java WEB学习笔记64:Struts2学习之路--主题

本博客的目的:①总结自己的学习过程,相当于学习笔记 ②将自己的经验分享给大家,相互学习,互相交流,不可商用 内容难免出现问题,欢迎指正,交流,探讨,可以留言,也可以通过以下方式联系. 本人互联网技术爱 ...

- hdu5390 tree

先求出dfs序,然后建立线段树,线段树每个节点套一个set. 修改操作只需要改被子树区间完全覆盖的线段树节点,将其节点中set的原来的值删除,加入新值. 询问操作查询单点到根的所有节点上的set中与查 ...

- MySQL 请选择合适的列! 转载(http://www.cnblogs.com/baochuan/archive/2012/05/23/2513224.html)

点击图片,可查看大图. 介绍 情况:如果你的表结构设计不良或你的索引设计不佳,那么请你优化你的表结构设计和给予合适的索引,这样你的查询性能就能提高几个数量级.——数据越大,索引的价值越能体现 ...

- paper 60 :转载关于视觉SCI期刊

ChanLee_1整理的计算机视觉领域稍微容易中的期刊 模式识别,计算机视觉领域,期刊 (1)pattern recognition letters, 从投稿到发表,一年半时间 (2)Pattern ...

- 转:Order&Shipping Transactions Status Summary

详细内容: http://blog.csdn.net/pan_tian/article/details/7696528 WSH_DELIVERY_DETAILS.Release_Status can ...

- 项目中empty遇到的一个问题

搜索传参时,数据能获取到,搜索结果不是根据参数得出的,在定义搜索条件时因为empty引起的一个问题,键为0的值没有获取到, 记住:!empty 已经把0排除了