爬虫实践---悦音台mv排行榜与简单反爬虫技术应用

由于要抓取的是悦音台mv的排行榜,这个排行榜是实时更新的,如果要求不停地抓取,这将有可能导致悦音台官方采用反爬虫的技术将ip给封掉。所以这里要应用一些反爬虫相关知识。

目标网址:http://vchart.yinyuetai.com/vchart/trends?area=ML

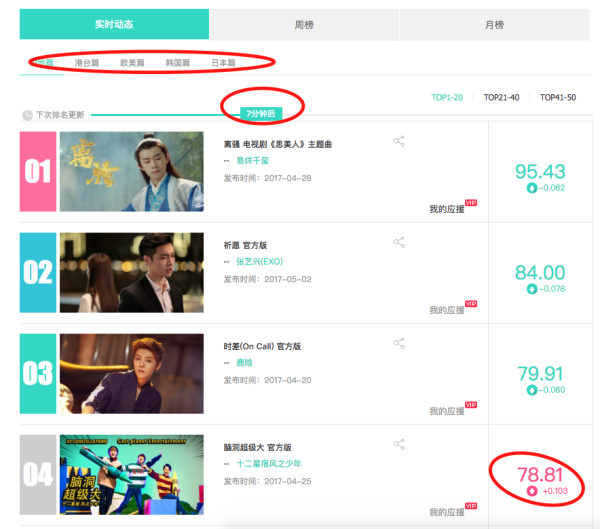

网站结构:

上面红线圈出来的地方都是需要注意的小细节:

首先 排行榜分为,内地、港台、欧美、韩国、日本五个地区

分别将其点开能够观察到url的变化为在最尾部加了一个参数:area=地区参数

很容易的就能知道参数列表:['ML','HT','US','JP','KR'] 分别对应着内地、香港、欧美、日本、以及韩国。发现这个规律之后,只要通过简单的对url的变化就能多次请求,筛选出想要的信息。

其次 可以发现,有的mv分数是呈现上升趋势,有的mv的分数是成下降趋势,这在网页的代码结构稍有不同。

最后,可以看到 这里mv的排行榜数据是实时更新的,所以爬虫程序要不停的在后台运行才能保证获得的数据是最新的,这样就会引起官方人员的注意,他们的反爬虫技术有可能就会将爬虫的IP封掉。

完整代码:

import requests

from bs4 import BeautifulSoup

import random def get_html(url):

try:

r = requests.get(url,timeout=30)

r.raise_for_status

r.encoding = 'utf-8'

return r.text

except:

return 'error' def get_agent():

'''

模拟header的user-agent字段,

返回一个随机的user-agent字典类型的键值对

'''

agents = ['Mozilla/5.0 (compatible; MSIE 9.0; Windows NT 6.1; Trident/5.0;',

'Mozilla/5.0 (Macintosh; Intel Mac OS X 10.6; rv,2.0.1) Gecko/20100101 Firefox/4.0.1',

'Opera/9.80 (Macintosh; Intel Mac OS X 10.6.8; U; en) Presto/2.8.131 Version/11.11',

'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_7_0) AppleWebKit/535.11 (KHTML, like Gecko) Chrome/17.0.963.56 Safari/535.11',

'Mozilla/4.0 (compatible; MSIE 7.0; Windows NT 5.1; 360SE)']

fakeheader = {}

fakeheader['User-agent'] = agents[random.randint(0, len(agents))]

return fakeheader def get_proxy():

'''

简单模拟代理池

返回一个字典类型的键值对,

'''

proxy = ["http://116.211.143.11:80",

"http://183.1.86.235:8118",

"http://183.32.88.244:808",

"http://121.40.42.35:9999",

"http://222.94.148.210:808"]

fakepxs = {}

fakepxs['http'] = proxy[random.randint(0, len(proxy))]

return fakepxs def get_content(url):

# 先打印一下表头

if url[-2:] == 'ML':

print('内地排行榜')

elif url[-2:] == 'HT':

print('香港排行榜')

elif url[-2:] == 'US':

print('欧美排行榜')

elif url[-2:] == 'KR':

print('韩国排行榜')

else:

print('日本排行榜') html = get_html(url)

soup = BeautifulSoup(html,'lxml')

li_list = soup.find_all('li',class_='vitem J_li_toggle_date ') for li in li_list:

content = {}

try:

# 判断分数升降

if li.find('h3',class_='desc_score'):

content['分数'] = li.find('h3',class_='desc_score').text

else:

content['分数'] = li.find('h3',class_='asc_score').text content['排名'] = li.find('div',class_='top_num').text

content['名字'] = li.find('a',class_='mvname').text

content['发布时间'] = li.find('p',class_='c9').text[5:]

content['歌手'] = li.find('a',class_='special').text

except:

return None print(content) def main():

base_url = 'http://vchart.yinyuetai.com/vchart/trends?area='

suffix = ['ML','HT','US','JP','KR']

for suff in suffix:

url = base_url + suff

print()

get_content(url) if __name__ == '__main__':

main()

输出结果:

爬虫实践---悦音台mv排行榜与简单反爬虫技术应用的更多相关文章

- 大众点评评论数据抓取 反爬虫措施有css文字映射和字体库反爬虫

大众点评评论数据抓取 反爬虫措施有css文字映射和字体库反爬虫 大众点评的反爬虫手段有那些: 封ip,封账号,字体库反爬虫,css文字映射,图形滑动验证码 这个图片是滑动验证码,访问频率高的话,会出 ...

- Python3 网络爬虫:漫画下载,动态加载、反爬虫这都不叫事

一.前言 作者:Jack Cui 很多人学习python,不知道从何学起.很多人学习python,掌握了基本语法过后,不知道在哪里寻找案例上手.很多已经做案例的人,却不知道如何去学习更加高深的知识.那 ...

- Python 有道翻译 爬虫 有道翻译API 突破有道翻译反爬虫机制

py2.7 #coding: utf-8 import time import random import hashlib import requests while(1): url = 'http: ...

- 简单的抓取淘宝关键字信息、图片的Python爬虫|Python3中级玩家:淘宝天猫商品搜索爬虫自动化工具(第一篇)

Python3中级玩家:淘宝天猫商品搜索爬虫自动化工具(第一篇) 淘宝改字段,Bugfix,查看https://github.com/hunterhug/taobaoscrapy.git 由于Gith ...

- 【Python3爬虫】常见反爬虫措施及解决办法(一)

这一篇博客,是关于反反爬虫的,我会分享一些我遇到的反爬虫的措施,并且会分享我自己的解决办法.如果能对你有什么帮助的话,麻烦点一下推荐啦. 一.UserAgent UserAgent中文名为用户代理,它 ...

- 爬虫---Beautiful Soup 反反爬虫事例

前两章简单的讲了Beautiful Soup的用法,在爬虫的过程中相信都遇到过一些反爬虫,如何跳过这些反爬虫呢?今天通过知乎网写一个简单的反爬中 什么是反爬虫 简单的说就是使用任何技术手段,阻止别人批 ...

- 极验反爬虫防护分析之slide验证方式下图片的处理及滑动轨迹的生成思路

本文要分享的内容是去年为了抢鞋而分析 极验(GeeTest)反爬虫防护的笔记,由于篇幅较长(为了多混点CB)我会按照我的分析顺序,分成如下四个主题与大家分享: 极验反爬虫防护分析之交互流程分析 极验反 ...

- 大型企业都在用的Python反爬虫手段,破了它!

SVG 映射反爬虫 很多人学习python,不知道从何学起.很多人学习python,掌握了基本语法过后,不知道在哪里寻找案例上手.很多已经做案例的人,却不知道如何去学习更加高深的知识.那么针对这三类人 ...

- python爬虫实践(二)——爬取张艺谋导演的电影《影》的豆瓣影评并进行简单分析

学了爬虫之后,都只是爬取一些简单的小页面,觉得没意思,所以我现在准备爬取一下豆瓣上张艺谋导演的“影”的短评,存入数据库,并进行简单的分析和数据可视化,因为用到的只是比较多,所以写一篇博客当做笔记. 第 ...

随机推荐

- Unhandled event loop exception No more handles

1.错误描述 2.错误原因 3.解决办法

- Cortex-M3

大家听说过Cortex-M3吗?在嵌入式处理器的世界,cortex-M3是一位人见人爱的后生.它的成本和功耗低,可配置性很高.如今,很多ARM的工程师加入了cortex-M3的学习与开发中,WIZne ...

- Struts2(六) 用Struts完成客户列表显示

Struts完成客户列表显示 所用的基础知识 在之前的随笔中已经讲过.这篇是介绍如何使用Struts 完成客户列表显示 . 下面是 完成的代码执行逻辑图: 抽取项目部分代码 相信大家认真看一遍就明 ...

- CentOS添加磁盘分区

(这里的磁盘在vmware workstation VM中添加) 1.关闭虚拟机,在虚拟机设置中添加一个硬盘,然后开启虚拟机. 2.使用fdisk -l命令查看,这时会发现一个为被使用的设备,有2G的 ...

- 浅谈JS中的浅拷贝与深拷贝

前端工程师应该都比较熟悉浅拷贝和深拷贝的概念,在日常业务代码的过程中,特别是做数据处理的时候,经常行的会遇到,比如如何在不修改原对象的基础上,重新生成一个一模一样的对象,加以利用,又或是,如何巧妙地运 ...

- 改造 vue-cli 脚手架

改造 vue-cli 脚手架 注意,这里使用的 vue-cli 的版本为 2.8.2,不同版本的 vue-cli 可能会有些许不一样. 一.配置多页面 项目开发目录: 需要注意一点,每个页面的文件夹命 ...

- H5 EventSource 实现web页面推送功能demo

/** * H5 EventSource 实现web页面推送功能demo */ var serverData,statusDiv; var SERVER_URL = "index.php&q ...

- 【CJOJ2482】【POI2000】促销活动

题面 Description 促销活动遵守以下规则: 一个消费者 -- 想参加促销活动的消费者,在账单下记下他自己所付的费用,他个人的详细情况,然后将账单放入一个特殊的投票箱. 当每天促销活动结束时, ...

- 【SHOI2012】魔法树(树链剖分,线段树)

[SHOI2012]魔法树 题面 BZOJ上找不到这道题目 只有洛谷上有.. 所以粘贴洛谷的题面 题解 树链剖分之后直接维护线段树就可以了 树链剖分良心模板题 #include<iostream ...

- [BZOJ1010] [HNOI2008] 玩具装箱toy (斜率优化)

Description P教授要去看奥运,但是他舍不下他的玩具,于是他决定把所有的玩具运到北京.他使用自己的压缩器进行压缩,其可以将任意物品变成一堆,再放到一种特殊的一维容器中.P教授有编号为1... ...