Spark Dataframe 转 Json

import org.apache.spark.sql.DataFrame

import org.apache.spark.sql.functions._

import org.apache.spark.sql.types._ // Convenience function for turning JSON strings into DataFrames.

def jsonToDataFrame(json: String, schema: StructType = null): DataFrame = {

// SparkSessions are available with Spark 2.0+

val reader = spark.read Option(schema).foreach(reader.schema)

reader.json(sc.parallelize(Array(json)))

}

// Using a struct

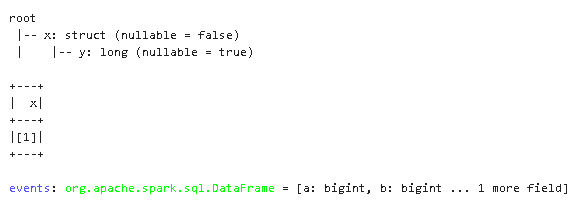

val schema = new StructType().add("a", new StructType().add("b", IntegerType)) val events = jsonToDataFrame("""

{

"a": {

"b": 1

}

}

""", schema) events.select("a.b").show()

val events = jsonToDataFrame("""

{

"a": 1,

"b": 2,

"c": 3

}

""")

events.select(struct('a as 'y) as 'x).printSchema()

events.select(struct('a as 'y) as 'x).show()

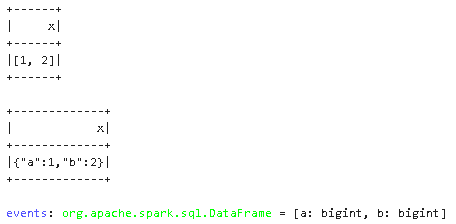

val events = jsonToDataFrame("""

{

"a": 1,

"b": 2

}

""")

events.select((struct("*") as 'x)).show()

events.select(to_json(struct("*")) as 'x).show()

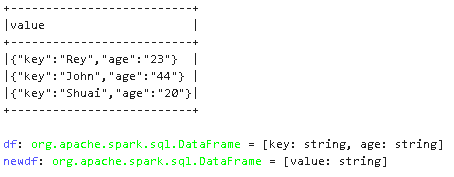

val df = Seq(("Rey", "23"), ("John", "44"),("Shuai", "20") ).toDF("key", "age")

df.columns.map(column)

val newdf = df.select(to_json(struct(df.columns.map(column):_*)).alias("value"))

newdf.show(false)

Ref:

https://docs.databricks.com/_static/notebooks/transform-complex-data-types-scala.html

Spark Dataframe 转 Json的更多相关文章

- Spark SQL,如何将 DataFrame 转为 json 格式

今天主要介绍一下如何将 Spark dataframe 的数据转成 json 数据.用到的是 scala 提供的 json 处理的 api. 用过 Spark SQL 应该知道,Spark dataf ...

- spark DataFrame的创建几种方式和存储

一. 从Spark2.0以上版本开始,Spark使用全新的SparkSession接口替代Spark1.6中的SQLContext及HiveContext接口来实现其对数据加载.转换.处理等功能.Sp ...

- spark dataframe unionall

今天本来想写一个spark dataframe unionall的demo,由于粗心报下面错误: Exception in thread "main" org.apache.spa ...

- spark dataframe操作集锦(提取前几行,合并,入库等)

https://blog.csdn.net/sparkexpert/article/details/51042970 spark dataframe派生于RDD类,但是提供了非常强大的数据操作功能.当 ...

- spark DataFrame 常见操作

spark dataframe派生于RDD类,但是提供了非常强大的数据操作功能.当然主要对类SQL的支持. 在实际工作中会遇到这样的情况,主要是会进行两个数据集的筛选.合并,重新入库. 首先加载数据集 ...

- Spark DataFrame中的join使用说明

spark sql 中join的类型 Spark DataFrame中join与SQL很像,都有inner join, left join, right join, full join; 类型 说明 ...

- 转】Spark DataFrame小试牛刀

原博文出自于: https://segmentfault.com/a/1190000002614456 感谢! 三月中旬,Spark发布了最新的1.3.0版本,其中最重要的变化,便是DataFrame ...

- spark DataFrame 读写和保存数据

一.读写Parquet(DataFrame) Spark SQL可以支持Parquet.JSON.Hive等数据源,并且可以通过JDBC连接外部数据源.前面的介绍中,我们已经涉及到了JSON.文本格式 ...

- spark dataFrame withColumn

说明:withColumn用于在原有DF新增一列 1. 初始化sqlContext val sqlContext = new org.apache.spark.sql.SQLContext(sc) 2 ...

- spark&dataframe

1.今天,我们来介绍spark以及dataframe的相关的知识点,但是在此之前先说一下对以前的hadoop的一些理解 当我启动hadoop的时候,上面有hdfs的存储结构,由于这个是分布式存储,所以 ...

随机推荐

- 浙江省赛决赛 misc2 蝎子

Misc 2 tcp.stream eq 0 内得知是冰蝎3.0,key是e46023a69f8db309 <?php @error_reporting(0); session_start(); ...

- Linux常用指令及shell脚本记录

记录一些常用指令在博客上,以防哪天因太久不敲而忘却,还可以直接翻看博客记录,不用再一条条百度搜...... 一.Linux常用指令 一.设置文件权限为aapp用户及用户组-- chown -R app ...

- 透视开源生态,OSGraph——GitHub全域数据图谱的智能洞察工具

"透视开源生态,OSGraph--GitHub全域数据图谱的智能洞察工具 OSGraph (Open Source Graph) 是一个开源图谱关系洞察工具,基于GitHub开源数据全域图谱 ...

- LSTM实现文本情感分类demo

import torch import torch.optim as optim import torch.nn as nn import numpy as np import torch.nn.fu ...

- [oeasy]python0078_变量部分总结_variable_summary

删除变量 回忆上次内容 上次研究了变量的死 有生就有死 原本的死是在程序退出的时候自动执行的 也可以手动给变量执行死刑 del del(a)之后 dir()就无法在当前作用域(scope)内观 ...

- SQL Server调用OLE对象

T-SQL 中是可以调用 OLE 的,将这一功能应用到触发器.存储过程等对象中,SQL Server 运用变得更贴近我们的功能,更加满足我们的需要. T-SQL 中有七个存储过程是围绕本节内容进行的, ...

- C# LINQ之IEqualityComparer<>接口应用

在C#语言中,对集合的条件查询.分组统计等操作使用LINQ非常方便,LINQ的语法格式与SQL非常相似和便捷,而LINQ扩展方法配合Lambda更为简洁,如All.Any.Count.Max等Enum ...

- 学习笔记--Java构造方法

Java构造方法 关于构造方法 构造方法又被称作:构造函数/构造器/Constructor 语法结构: [修饰符列表] 构造方法名(形式参数列表){ 构造方法体; } 对比普通方法语法结构 [修饰符列 ...

- 手把手教你!STM32单片机入门指南:从初级到中级工程师的学习路线

在当今科技日新月异的时代,嵌入式系统作为智能设备的核心驱动力,正以前所未有的速度渗透到我们生活的方方面面.STM32系列微控制器,以其高性能.低功耗及丰富的外设资源,成了许多开发者踏入嵌入式领域首选 ...

- 如何理解计算机类论文、机器学习论文、人工智能AI论文中的“soft”和“hard”呢?

如何理解计算机类论文.机器学习论文.人工智能AI论文中的"soft"和"hard"呢? 最近在看论文中总看到带有"soft"和"h ...