15-糗事百科(python+xpath)

爬取糗事百科的段子:

1.用xpath分析首要爬去内容的表达式;

2.用发起请求,获得原码;

3.用xpath分析源码,提取有用信息;

4.由python格式转为json格式,写入文件

#_*_ coding: utf-8 _*_

'''

Created on 2018年7月17日

@author: sss

function: 爬取糗事百科里面的内容 ''' import requests

import json

from lxml import etree url = "https://www.qiushibaike.com/8hr/page/3/"

headers = {'User-Agent': 'Mozilla/5.0 (compatible; MSIE 9.0; Windows NT 6.1 Trident/5.0;'}

html= requests.get(url, headers = headers).text

# print(html) #将返回的字符串格式,转为HTML DOM模式

text = etree.HTML(html) #获得包含每个糗事的链表

#返回所有糗事的节点位置,contains()模糊查询方法,第一个参数为要匹配的标签,第二个参数为标签的内容

node_list = text.xpath('//div[contains(@id, "qiushi_tag_")]') items = {}

for node in node_list:

#用户名

# username = node.xpath('./div/a/h2')[0].text

username = node.xpath('.//h2')[0].text

#图片连接

image = node.xpath('.//img/@src')#[0]

#取出标题下的内容

content = node.xpath('./a/div/span')[0].text

#点赞

zan = node.xpath('./div/span/i')[0].text

#评论

comment = node.xpath('./div/span/a/i')[0].text items = {

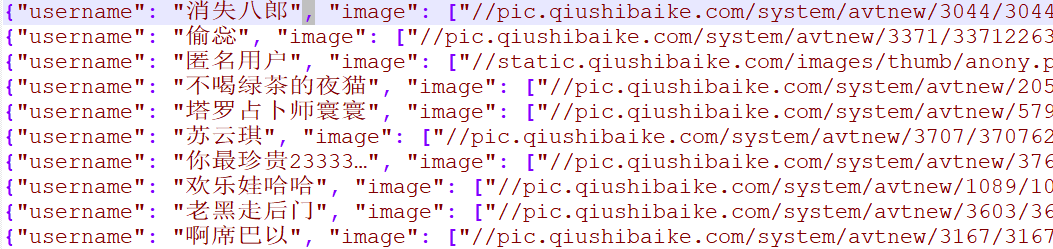

'username' : username,

'image' : image,

'content' : content,

'zan' : zan,

'comments' : comment

} #把python格式的转换为json格式,此时转换成了字符串,就可以写入糗事段子.txt文件中了

we=json.dumps(items, ensure_ascii=False)

print(we)

with open('qiushi.txt', 'a', encoding='utf-8') as f: #注意在这里转为utf-8格式

f.write((we + '\n'))

效果:

不

不

不以json格式存储:

#_*_ coding: utf-8 _*_

'''

Created on 2018年7月17日

@author: sss

function: 爬取糗事百科里面的内容 ''' import requests

import json

from lxml import etree url = "https://www.qiushibaike.com/8hr/page/3/"

headers = {'User-Agent': 'Mozilla/5.0 (compatible; MSIE 9.0; Windows NT 6.1 Trident/5.0;'}

html= requests.get(url, headers = headers).text

# print(html) #将返回的字符串格式,转为HTML DOM模式

text = etree.HTML(html) #获得包含每个糗事的链表

#返回所有糗事的节点位置,contains()模糊查询方法,第一个参数为要匹配的标签,第二个参数为标签的内容

node_list = text.xpath('//div[contains(@id, "qiushi_tag_")]') items = {}

for node in node_list:

#用户名

# username = node.xpath('./div/a/h2')[0].text

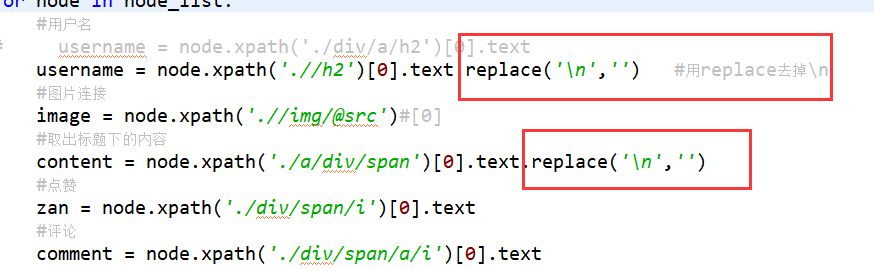

username = node.xpath('.//h2')[0].text.replace('\n','') #用replace去掉\n

#图片连接

image = node.xpath('.//img/@src')#[0]

#取出标题下的内容

content = node.xpath('./a/div/span')[0].text.replace('\n','')

#点赞

zan = node.xpath('./div/span/i')[0].text

#评论

comment = node.xpath('./div/span/a/i')[0].text items = {

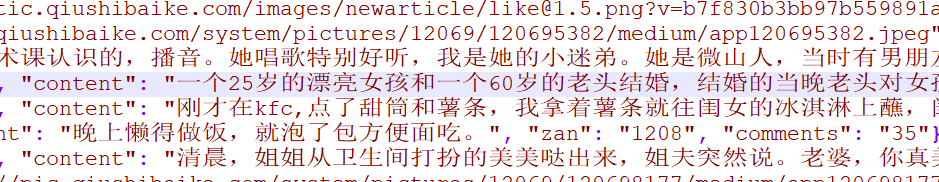

'username' : username,

'image' : image,

'content' : content,

'zan' : zan,

'comments' : comment

} #把python格式的转换为json格式,此时转换成了字符串,就可以写入糗事段子.txt文件中了

# we=json.dumps(items, ensure_ascii=False)

# print(we)

# with open('qiushi.json', 'a', encoding='utf-8') as f: #注意在这里转为utf-8格式

# f.write((we + '\n'))

with open('qiushi_wenben.txt', 'a', encoding = "utf-8") as f:

f.write('用户:' + username + '\n')

f.write('图片链接:https:' + image[0] + '\n')

f.write('内容:' + content + '\n')

f.write('赞:' + zan + '\n')

f.write('评论:' + comment + '\n\n')

效果:

15-糗事百科(python+xpath)的更多相关文章

- 糗事百科python爬虫

# -*- coding: utf-8 -*- #coding=utf-8 import urllib import urllib2 import re import thread import ti ...

- Python爬虫(十八)_多线程糗事百科案例

多线程糗事百科案例 案例要求参考上一个糗事百科单进程案例:http://www.cnblogs.com/miqi1992/p/8081929.html Queue(队列对象) Queue是python ...

- Python爬虫实战一之爬取糗事百科段子

大家好,前面入门已经说了那么多基础知识了,下面我们做几个实战项目来挑战一下吧.那么这次为大家带来,Python爬取糗事百科的小段子的例子. 首先,糗事百科大家都听说过吧?糗友们发的搞笑的段子一抓一大把 ...

- python 多线程糗事百科案例

案例要求参考上一个糗事百科单进程案例 Queue(队列对象) Queue是python中的标准库,可以直接import Queue引用;队列是线程间最常用的交换数据的形式 python下多线程的思考 ...

- python scrapy实战糗事百科保存到json文件里

编写qsbk_spider.py爬虫文件 # -*- coding: utf-8 -*- import scrapy from qsbk.items import QsbkItem from scra ...

- python爬虫30 | scrapy后续,把「糗事百科」的段子爬下来然后存到数据库中

上回我们说到 python爬虫29 | 使用scrapy爬取糗事百科的例子,告诉你它有多厉害! WOW!! scrapy awesome!! 怎么会有这么牛逼的框架 wow!! awesome!! 用 ...

- python爬虫29 | 使用scrapy爬取糗事百科的例子,告诉你它有多厉害!

是时候给你说说 爬虫框架了 使用框架来爬取数据 会节省我们更多时间 很快就能抓取到我们想要抓取的内容 框架集合了许多操作 比如请求,数据解析,存储等等 都可以由框架完成 有些小伙伴就要问了 你他妈的 ...

- Xpath--使用Xpath爬取糗事百科成人版图片

#!usr/bin/env python#-*- coding:utf-8 _*-"""@author:Hurrican@file: 爬取糗事百科.py@time: 20 ...

- Python爬虫批量下载糗事百科段子,怀念的天王盖地虎,小鸡炖蘑菇...

欢迎添加华为云小助手微信(微信号:HWCloud002 或 HWCloud003),输入关键字"加群",加入华为云线上技术讨论群:输入关键字"最新活动",获取华 ...

- 爬取糗事百科热门段子的数据并保存到本地,xpath的使用

和之前的爬虫类博客的爬取思路基本一致: 构造url_list,因为糗事百科的热门栏目默认是13页,所以这个就简单了 遍历发送请求获取响应 提取数据,这里用的是xpath提取,用的是Python的第三方 ...

随机推荐

- foreach(PHP学习)

先来看一个例子: $arr = array(0,1,2,3,4);让数组的每个值都变成原来的两倍,应该怎么来实现? 如果没有学习foreach之前,会想到用for循环 <?php $arr = ...

- 理解C/C++中const char*、char* const、const char* const、char* const*等等

先说些题外话,今天学习execve(2)的使用,由于书上代码使用的是C89标准,所以下面这种代码都被我修改了 char* s[] = { "aaa", "bbb" ...

- python 网络编程--socket模块/struct模块

socket模块: 客户端:CS架构, client -> server 浏览器:BS架构, browser -> server 网络通信本质:传输字节 doc命令查看ip地址:ipc ...

- 一、Jetty介绍

简介: Jetty 是一个用 Java 实现.开源.基于标准的,并且具有丰富功能的 Http 服务器和 Web 容器,可以免费的用于商业行为.Jetty 这个项目成立于 1995 年,现在已经有非常多 ...

- 爬虫高性能相关(协程效率最高,IO密集型)

一背景常识 爬虫的本质就是一个socket客户端与服务端的通信过程,如果我们有多个url待爬取,采用串行的方式执行,只能等待爬取一个结束后才能继续下一个,效率会非常低. 需要强调的是:串行并不意味着低 ...

- Linux 设备总线驱动模型

尽管LDD3中说对多数程序员掌握设备驱动模型不是必要的,但对于嵌入式Linux的底层程序员而言,对设备驱动模型的学习非常重要. Linux设备模型的目的:为内核建立一个统一的设备模型,从而又一 ...

- Drools简单例子

转自:http://www.blogjava.net/diggbag/articles/359347.html 1.Drools简单例子 首先是搭建一个可供进行Drools开发的框架.Jboss官方推 ...

- python操作csv

# -*- coding: utf-8 -*- #python 27 #xiaodeng #CSV文件的写入(按行写入) import csv #csv文件,是一种常用的文本格式,用以存储表格数据,很 ...

- django的实现异步机制celery

celery 一句话总结:celery是一种实现异步的机制,对于比较耗时的任务可以使用其来减少客户端等待时间(注册邮箱验证),提高用户体验. 官方网站 中文文档 示例一:用户发起request,并等待 ...

- Mellanox infinoband RDMA SDP

IPoIB Internet Protocol over InfiniBand 就是指利用物理IB网络(IB卡,线缆,交换机,更甚者IB3层交换)通过ip协议进行连接,并进行数据传输! SDP Soc ...