spark streaming的应用

今天我们讲spark streaming的应用,这个是实时处理的,类似于Storm以及Flink相关的知识点,

说来也巧,今天的自己也去听了关于Flink的相关的讲座,可惜自己没有听得特别清楚,好像是

spark streaming与flink是竞争关系,好了,我们进入今天的主题吧

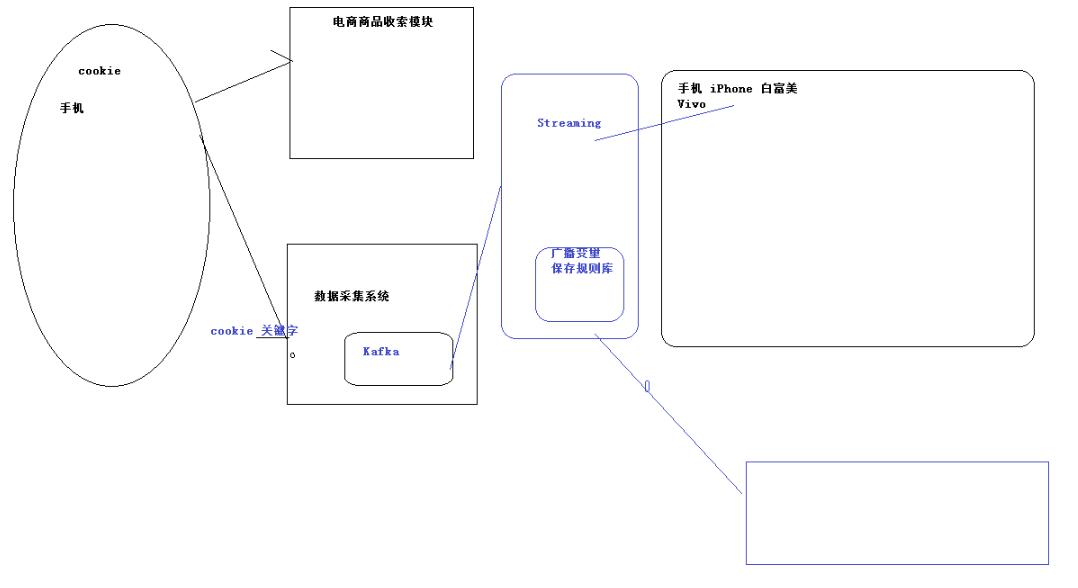

1.一般会做用户画像的差不多集中在两个行业,电商以及广告行业

一般根据现实给这个人打上一个标签,在根据标签来确定画像

2.如果一个人不登录,怎样确定这个人的详情

这个就是spark streaming的应用

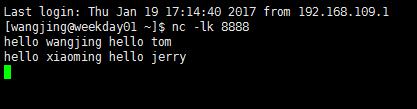

nc -lk 8888 这个端口可以一直发送数据

请记住,spark中产生的rdd,可能会由于某种意外的原因,从而这个计算可能就要重新开始计算,

但是假如我们设置了checkpoint(如果多个进程同时开始的话,我们可以搞一个共享存储)的时候,

就可以保存这个值,当再一次出现意外的时候,就可以从恢复的这个值重新读取

对于map来说,可以map(),同时也可以map{},这样的两种表达形式,不过当我们写成了case()的

这种形式,则我们必须使用map的大括号的这种形式了,后文附带代码

package cn.wj.spark.day09

import org.apache.spark.streaming.{Seconds, StreamingContext}

import org.apache.spark.{HashPartitioner, SparkConf, SparkContext}

/**

* Created by WJ on 2017/1/18.

*/

object StateFulWordCount {

//Seq这个批次某个单词的次数

//Option[Int]:以前的结果

//(hello,1),(hello,1),(tom,1)

//(hello,Seq(1,1)),(tom,Seq(1))

//此时x=>String(Key的值),y=>Seq[Int](当前的这个value的值),z=>Option[Int],这个代表的是以前的value的值

val updateFunc = (iter:Iterator[(String,Seq[Int],Option[Int])]) =>{

iter.flatMap{case(x,y,z) => Some(y.sum+z.getOrElse()).map(m =>(x,m))}

}

def main(args: Array[String]): Unit = {

LoggerLevels.setStreamingLogLevels()

//StreamingContext

val conf = new SparkConf().setAppName("StreamingContext").setMaster("local[2]")

val sc = new SparkContext(conf)

sc.setCheckpointDir("/tmp/ck")

// sc.setCheckpointDir("hdfs://192.168.109.136:9000/person/myfile")

val ssc = new StreamingContext(sc,Seconds())

val ds = ssc.socketTextStream("192.168.109.136",)

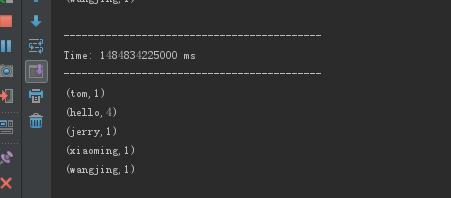

//updateStateByKey:这个方法的意思是说将每一次的partition都进行一次累计

val result = ds.flatMap(_.split(" ")).map((_,)).updateStateByKey(updateFunc,new HashPartitioner(sc.defaultParallelism),true)

result.print()

ssc.start()

ssc.awaitTermination()

}

}

其中,LoggerLevels.setStreamingLogLevels()这个是设置日志文件的显示情况的,是让打出来的日志更清晰,

如果没必要,可以删除的。

首先我们在linux里面向8888端口发送信息:

然后启动项目,这个时候就可以看见这个效果了(可以叠加的spark streaming)

spark streaming的应用的更多相关文章

- Spark踩坑记——Spark Streaming+Kafka

[TOC] 前言 在WeTest舆情项目中,需要对每天千万级的游戏评论信息进行词频统计,在生产者一端,我们将数据按照每天的拉取时间存入了Kafka当中,而在消费者一端,我们利用了spark strea ...

- Spark Streaming+Kafka

Spark Streaming+Kafka 前言 在WeTest舆情项目中,需要对每天千万级的游戏评论信息进行词频统计,在生产者一端,我们将数据按照每天的拉取时间存入了Kafka当中,而在消费者一端, ...

- Storm介绍及与Spark Streaming对比

Storm介绍 Storm是由Twitter开源的分布式.高容错的实时处理系统,它的出现令持续不断的流计算变得容易,弥补了Hadoop批处理所不能满足的实时要求.Storm常用于在实时分析.在线机器学 ...

- flume+kafka+spark streaming整合

1.安装好flume2.安装好kafka3.安装好spark4.流程说明: 日志文件->flume->kafka->spark streaming flume输入:文件 flume输 ...

- spark streaming kafka example

// scalastyle:off println package org.apache.spark.examples.streaming import kafka.serializer.String ...

- Spark Streaming中动态Batch Size实现初探

本期内容 : BatchDuration与 Process Time 动态Batch Size Spark Streaming中有很多算子,是否每一个算子都是预期中的类似线性规律的时间消耗呢? 例如: ...

- Spark Streaming源码解读之No Receivers彻底思考

本期内容 : Direct Acess Kafka Spark Streaming接收数据现在支持的两种方式: 01. Receiver的方式来接收数据,及输入数据的控制 02. No Receive ...

- Spark Streaming架构设计和运行机制总结

本期内容 : Spark Streaming中的架构设计和运行机制 Spark Streaming深度思考 Spark Streaming的本质就是在RDD基础之上加上Time ,由Time不断的运行 ...

- Spark Streaming中空RDD处理及流处理程序优雅的停止

本期内容 : Spark Streaming中的空RDD处理 Spark Streaming程序的停止 由于Spark Streaming的每个BatchDuration都会不断的产生RDD,空RDD ...

- Spark Streaming源码解读之State管理之UpdataStateByKey和MapWithState解密

本期内容 : UpdateStateByKey解密 MapWithState解密 Spark Streaming是实现State状态管理因素: 01. Spark Streaming是按照整个Bach ...

随机推荐

- Android开发之——依赖冲突Program type already present

前言 实际开发中,为了提高开发速度和效率,总避免不了引用第三方提供的依赖和类库,如果含有相同依赖的类库被我们引用时,而他们的版本又不相同,就有可能会导致一系列问题和异常,本文结合本人时间总结和他人经验 ...

- linux下查找字符串

如果你想在当前目录下 查找"hello,world!"字符串,可以这样: grep -rn "hello,world!" * * : 表示当前目录所有文件,也可 ...

- 回归JDK源代码(2)Enumeration<E>接口

现在的Java程序员习惯使用Iterator<E>接口或者增强for循环来遍历集合.如果回到JDK 1.0,Enumeration接口则是遍历向量.哈希表的不二之选.本节就解读和翻译一下E ...

- 建立本地yum源

使用环境 服务器处于内网,需要更新 网络资源紧张,节约带宽 建立yum目录 mkdir -p /opt/opmgmt/yum rsync服务器列表 centos mirrors epel mirror ...

- SQL Server 2008数据备份与还原的原理是什么?

为什么SqlServer有完整备份.差异备份和事务日志备份三种备份方式,以及为什么数据库又有简单模式.完整模式和大容量日志模式这三种恢复模式.本文内容适用于2005以上所有版本的SqlServer数据 ...

- 概念:静态static相关知识

在面向对象中,有‘静态’概念,通过关键字static进行说明, 例如: 静态属性:public static $name = '小仓鼠' 静态方法:public static function Nam ...

- 【js基础修炼之路】- 微任务,宏任务和Event-Loop

一段代码让你了解Event-Loop console.log(1); setTimeout(() => { console.log(2); }, 0); new Promise((resolve ...

- ROS机器人程序设计

在<ROS机器人程序设计>中,在第二章创建节点时给出一个接收和发送的例子,但是按照书中步骤编译时,遇到按个三个问题,现在罗列出来解决方案供参考. 建议在工作空间直接输入 catkin_ ...

- 通过ServletContext取Spring的WebApplicationContext

当 Web 应用集成 Spring 容器后,代表 Spring 容器的 WebApplicationContext 对象将以WebApplicationContext.ROOT_WEB_APPLICA ...

- Swift小记一

1.输出地址 print(String(format: "%p", "temp")) 2.判断字符串是否为空串.是否为nil 为String添加一个分类 ext ...