大数据之路- Hadoop环境搭建(Linux)

前期部署

1.JDK

2.上传HADOOP安装包

2.1官网:http://hadoop.apache.org/

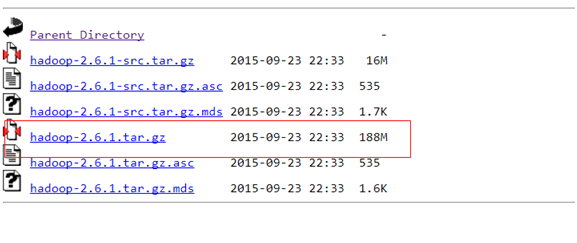

2.2下载hadoop-2.6.1的这个tar.gz文件,官网:

https://archive.apache.org/dist/hadoop/common/hadoop-2.6.1/

下载成功后,把这个tar.gz包上传到服务器上,命令:

通过SecureCRT软件alt+p打开SFTP,然后把这个文件上传

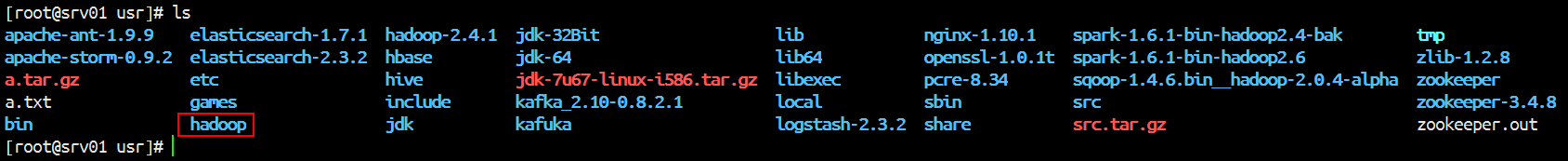

上传成后,解压

tar -xvzf hadoop-2.6..tar.gz

然后把解压后的文件移动到/usr下,改名为hadoop

命令:

mv hadoop-2.6. /usr/hadoop

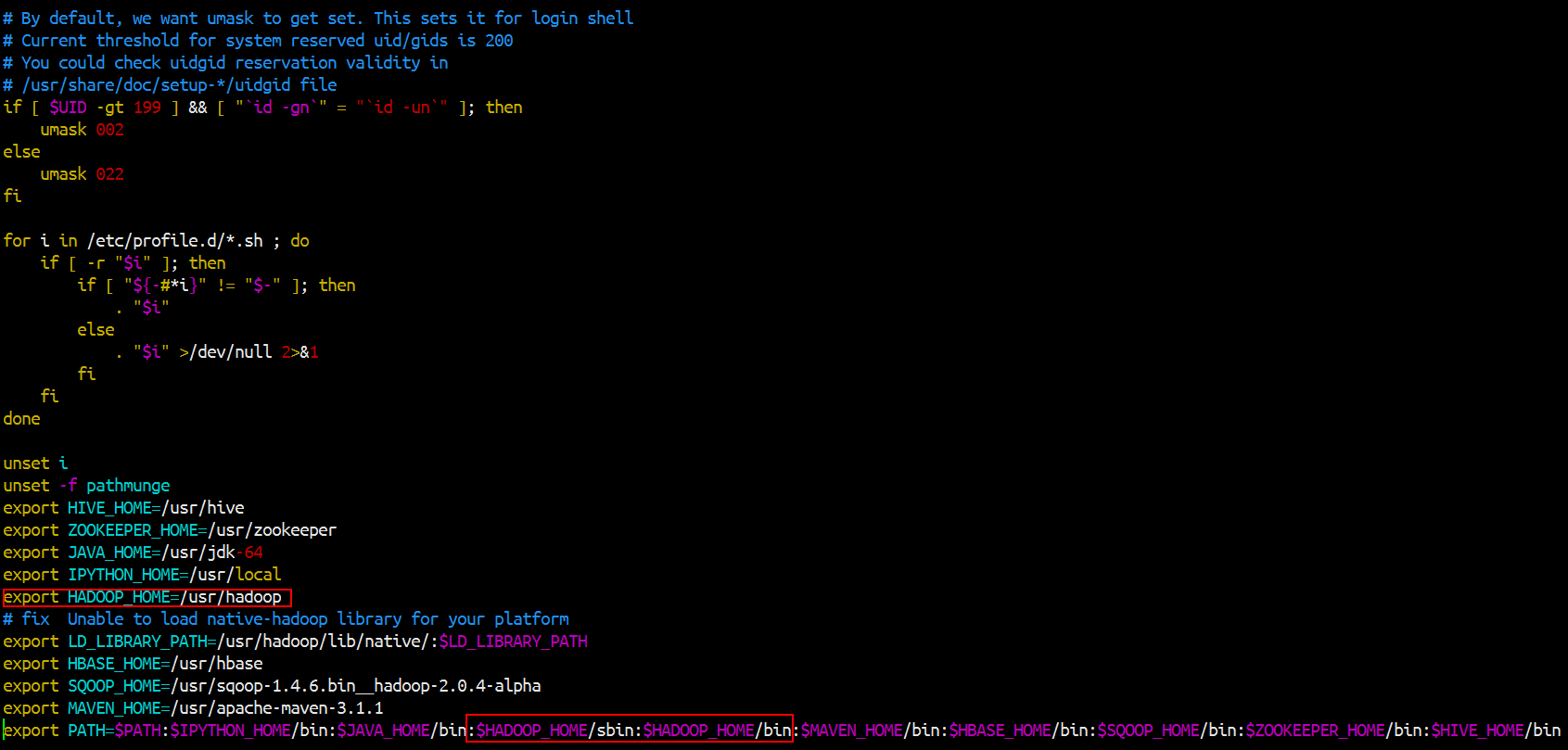

然后开始把hadoop的命令加到环境变量里面去

然后记得source一下

然后再修改配置文件,配置文件查看查看官网:

http://hadoop.apache.org/docs/r2.6.5/hadoop-project-dist/hadoop-common/SingleCluster.html

最简化配置如下:(在/usr/hadoop/etc/hadoop)

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://hdp-node-01:9000</value>

</property>

<property>

<name>hadoop.tmp.dir</name> //指定进程工作目录,数据存放目录

<value>/home/HADOOP/apps/hadoop-2.6./tmp</value>

</property>

//设置保留副本的数量,即备份的数量,默认是3。客户端把文件交给fds之后,fds保留的副本数量

<property>

<name>dfs.replication</name>

<value></value>

</property>

vim mapre-site.xml

mapreduce要放在一个资源调度平台上面跑,所以需要指定资源调度平台yarn,默认是local,不是在集群上运行

192.168.1.88 srv01

192.168.1.89 srv02

192.168.1.90 srv03

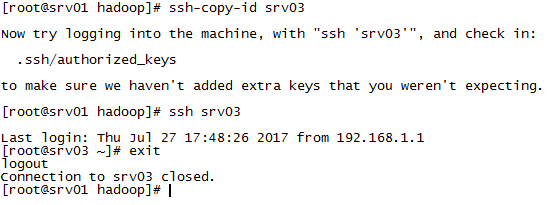

scp /etc/profile srv02:/etc/ //记得到srv02去source它的profile文件

scp /etc/profile srv03:/etc/ //记得到srv02去source它的profile文件

scp -R /usr/hadoop srv02:/usr/hadoop

scp -R /usr/hadoop srv03:/usr/hadoop

hadoop格式化是为了生成fsimage文件。

hdfs namenode -format

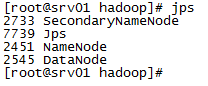

可以在浏览器上看到hadoop集群状态

namenode的ip加上50070端口

http://192.168.1.88:50070/

配置HDFS垃圾回收

fs.trash.interval

描述:检查点被删除的分钟数。如果为零,垃圾功能将被禁用。可以在服务器和客户端上配置此选项。如果垃圾桶被禁用服务器端,则客户端配置被检查。如果在服务器端启用垃圾箱,则使用服务器上配置的值,并忽略客户端配置值。

例子:7天后自动清理

<property>

<name>fs.trash.interval</name>

<value>7 * 24 * 60</value>

</property>

NameNode启动过程详解

namenode的数据存放在两个地方,一个是内存,一个是磁盘(edits,fsimage)

第一次启动HDFS

1.format : 格式化hdfs

2.make image : 生成image文件

3.start NameNode:read fsimage

4.start Datenode : datanode 向 NameNdoe 注册,汇报 block report ,

5.create dir /user/xxx/temp :写入edits文件

6.put files /user/xxx/tmp(*=site,xml) :写入edites文件

7.delete file /user/xxx/tmp/(core-site.xml):写入edits文件

对dfs的操作都会记录到edits里面

第二次启动hdfs:

1.启动NameNode,读取fsimage里面的镜像文件,读取edits文件,因为edits记录着上一次hdfs的操作,写入一个新的fsimage,创建一个新的edits记录操作

2.start Datenode : datanode 向 NameNdoe 注册,汇报 block report ,

3.create dir /user/xxx/temp :写入edits文件

4.put files /user/xxx/tmp(*=site,xml) :写入edites文件

5.delete file /user/xxx/tmp/(core-site.xml):写入edits文件

6.Secondly NameNode定期将edits文件和fsimage文件合并成一个新的fsimage文件替换掉NameNode上面的fsimage

另:手动编译hadoop记得要联网,因为它是用maven管理的,很多依赖需要下载

大数据之路- Hadoop环境搭建(Linux)的更多相关文章

- 大数据学习之Hadoop环境搭建

一.Hadoop的优势 1)高可靠性:因为Hadoop假设计算元素和存储会出现故障,因为它维护多个工作数据副本,在出现故障时可以对失败的节点重新分布处理. 2)高扩展性:在集群间分配任务数据,可方便的 ...

- 《OD大数据实战》Hive环境搭建

一.搭建hadoop环境 <OD大数据实战>hadoop伪分布式环境搭建 二.Hive环境搭建 1. 准备安装文件 下载地址: http://archive.cloudera.com/cd ...

- 《OD大数据实战》Hue环境搭建

官网: http://archive.cloudera.com/cdh5/cdh/5/hue-3.7.0-cdh5.3.6/ 一.Hue环境搭建 1. 下载 http://archive.cloude ...

- 《OD大数据实战》Oozie环境搭建

一.Oozie环境搭建 1. 下载oozie-4.0.0-cdh5.3.6.tar.gz 下载地址:http://archive.cloudera.com/cdh5/cdh/5/ 2. 解压 tar ...

- 《OD大数据实战》MongoDB环境搭建

一.MongonDB环境搭建 1. 下载 https://fastdl.mongodb.org/linux/mongodb-linux-x86_64-3.0.6.tgz 2. 解压 tar -zxvf ...

- 《OD大数据实战》HBase环境搭建

一.环境搭建 1. 下载 hbase-0.98.6-cdh5.3.6.tar.gz 2. 解压 tar -zxvf hbase-0.98.6-cdh5.3.6.tar.gz -C /opt/modul ...

- 《OD大数据实战》Storm环境搭建

一.环境搭建 1. 下载 http://www.apache.org/dyn/closer.lua/storm/apache-storm-0.9.6/apache-storm-0.9.6.tar.gz ...

- 《OD大数据实战》Flume环境搭建

一.CentOS 6.4安装Nginx http://shiyanjun.cn/archives/72.html 二.安装Flume 1. 下载flume-ng-1.5.0-cdh5.3.6.tar. ...

- Linux集群搭建与Hadoop环境搭建

今天是8月19日,距离开学还有15天,假期作业完成还是遥遥无期,看来开学之前的恶补是躲不过了 今天总结一下在Linux环境下安装Hadoop的过程,首先是对Linux环境的配置,设置主机名称,网络设置 ...

随机推荐

- HTML5 Canvas 绘制六叶草

注意: context.arc(横坐标,纵坐标,弧半径,起始角度,终止角度,逆顺时针);这个函数挺难用,主要原因是最后参数和角度的关系.不管文档怎么说,按我的实际经验,逆顺时针=false时,是逆时针 ...

- 聚合数据 iOS 项目开发实战:条码查询器

记录下,聚合数据 iOS 项目开发实战:条码查询器:视频地址:http://www.jikexueyuan.com/course/324.html 条码查询API:https://www.juhe.c ...

- AWK 思维导图

完整的AWK思维导图 文章来源:刘俊涛的博客 地址:http://www.cnblogs.com/lovebing

- Android 进程间通信——AIDL

代码地址如下:http://www.demodashi.com/demo/12321.html 原文地址:http://blog.csdn.net/vnanyesheshou/article/deta ...

- oled屏幕

oled作为一种新型的有机显示屏,越来越现实出其重要性,它不但超薄可弯折并且可视视角较宽.处在不论什么角度看屏幕都不会造成图像的失真. 且它有三中原色:绿.红,蓝. 我近期在学安在智能车上的oled ...

- VueJS事件处理器v-on:事件修饰符&按键修饰符

事件修饰符 Vue.js 为 v-on 提供了事件修饰符来处理 DOM 事件细节,如:event.preventDefault() 或 event.stopPropagation(). Vue.js通 ...

- DNA分子结构3D模型

生物信息资源更新越来越快,使用可视化的方法来分析DNA序列已成为生物信息学的一个研究热点,用图形表示DNA序列的方法也越来越成熟.2011年,著名杂志<Science>发表一篇引起轰动的文 ...

- Xenomai 3 POSIX

Xenomai 3在架构设计上确实优先Xenomai 2,至少对开发者来说,少维护了不少东西,看下面两张图就知道了 第一张图是Xenomai2的,第二张图是Xenomai3的,Xenomai3在内核中 ...

- Asp.Net北大青鸟总结(四)-使用GridView实现真假分页

这段时间看完了asp.net视频.可是感觉到自己的学习好像没有巩固好,于是又在图书馆里借了几本关于asp.net的书感觉真的非常好自己大概对于asp.net可以实现主要的小Demo.可是我知道仅仅有真 ...

- Appium python Uiautomator2 多进程问题

appium更新uiautomator后可以获取tost了,大家都尝试,课程中也讲解了,但是这些跑的时候都在单机上,当我们多机并发的时候会出现一个端口问题,因为我们appium最后会调用uiautom ...