030 RDD Join中宽依赖与窄依赖的判断

1.规律

如果JoinAPI之前被调用的RDD API是宽依赖(存在shuffle), 而且两个join的RDD的分区数量一致,join结果的rdd分区数量也一样,这个时候join api是窄依赖

除此之外的,rdd 的join api是宽依赖

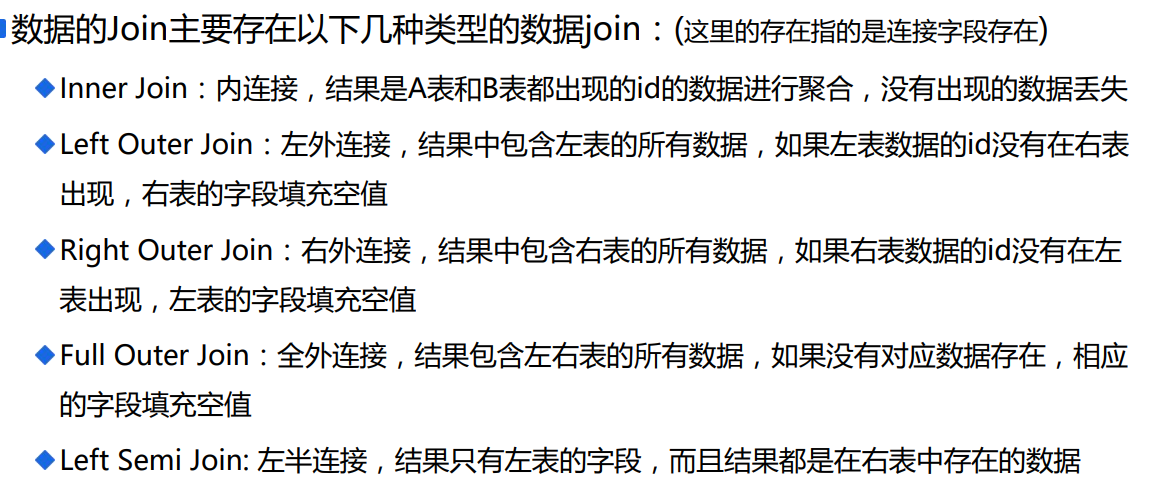

2.Join的理解

3.举例

A表数据:

1 a

2 b

3 c

B表数据:

1 aa1

1 aa2

2 bb1

2 bb2

2 bb3

4 dd1 A inner join B:

1 a 1 aa1

1 a 1 aa2

2 b 2 bb1

2 b 2 bb2

2 b 2 bb3 A left outer join B:

1 a 1 aa1

1 a 1 aa2

2 b 2 bb1

2 b 2 bb2

2 b 2 bb3

3 c null null A right outer join B:

1 a 1 aa1

1 a 1 aa2

2 b 2 bb1

2 b 2 bb2

2 b 2 bb3

null null 4 dd1 A full outer join B:

1 a 1 aa1

1 a 1 aa2

2 b 2 bb1

2 b 2 bb2

2 b 2 bb3

3 c null null

null null 4 dd1 A left semi join B:

1 a

2 b

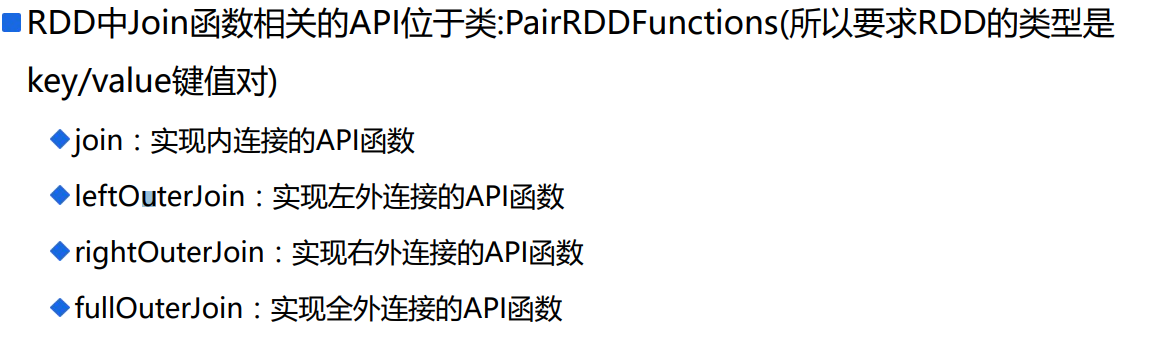

4.API

必须是Key/value键值对

5.测试程序

import org.apache.spark.{SparkConf, SparkContext}

/**

* RDD数据Join相关API讲解

* Created by ibf on 02/09.

*/

object RDDJoin {

def main(args: Array[String]): Unit = {

val conf = new SparkConf()

.setMaster("local[*]")

.setAppName("RDD-Join")

val sc = SparkContext.getOrCreate(conf)

// ==================具体代码======================

// 模拟数据产生

val rdd1 = sc.parallelize(Array(

(1, "张三1"),

(1, "张三2"),

(2, "李四"),

(3, "王五"),

(4, "Tom"),

(5, "Gerry"),

(6, "莉莉")

), 1)

val rdd2 = sc.parallelize(Array(

(1, "上海"),

(2, "北京1"),

(2, "北京2"),

(3, "南京"),

(4, "纽约"),

(6, "深圳"),

(7, "香港")

), 1)

// 调用RDD API实现内连接

val joinResultRDD = rdd1.join(rdd2).map {

case (id, (name, address)) => {

(id, name, address)

}

}

println("----------------")

joinResultRDD.foreachPartition(iter => {

iter.foreach(println)

})

// 调用RDD API实现左外连接

val leftJoinResultRDd = rdd1.leftOuterJoin(rdd2).map {

case (id, (name, addressOption)) => {

(id, name, addressOption.getOrElse("NULL"))

}

}

println("----------------")

leftJoinResultRDd.foreachPartition(iter => {

iter.foreach(println)

})

// 左外连接稍微变化一下:需要左表出现,右表不出现的数据(not in)

println("----------------")

rdd1.leftOuterJoin(rdd2).filter(_._2._2.isEmpty).map {

case (id, (name, _)) => (id, name)

}.foreachPartition(iter => {

iter.foreach(println)

})

// 右外连接

println("----------------")

rdd1

.rightOuterJoin(rdd2)

.map {

case (id, (nameOption, address)) => {

(id, nameOption.getOrElse("NULL"), address)

}

}

.foreachPartition(iter => iter.foreach(println))

// 全外连接

println("----------------")

rdd1

.fullOuterJoin(rdd2)

.map {

case (id, (nameOption, addressOption)) => {

(id, nameOption.getOrElse("NULL"), addressOption.getOrElse("NULL"))

}

}

.foreachPartition(iter => iter.foreach(println))

// 休眠为了看4040页面

Thread.sleep(1000000)

}

}

6.说明

RDD join API:

def join[W](other: RDD[(K, W)]): RDD[(K, (V, W))]

返回值是RDD,RDD中的类型是一个二元组(a),a第一个元素是KEY类型的值(join的key), a第二个元素又是二元组(b), b的第一个元素是来自调用join函数的RDD的value,

b的第二个元素是来自参数other这个RDD的value

def leftOuterJoin[W](other: RDD[(K, W)]): RDD[(K, (V, Option[W]))]

对于右边的数据返回的是Option类型是数据,所以如果右表数据不存在,返回的是None;否则是一个Some的具体数据

def rightOuterJoin[W](other: RDD[(K, W)]): RDD[(K, (Option[V], W))]

对于左边的数据返回的是Option类型是数据,所以如果左表数据不存在,返回的是None;否则是一个Some的具体数据

def fullOuterJoin[W](other: RDD[(K, W)]): RDD[(K, (Option[V], Option[W]))]

返回的value类型是Option封装后的数据,如果数据不存在, 返回的是None,存在返回的是Some具体数据

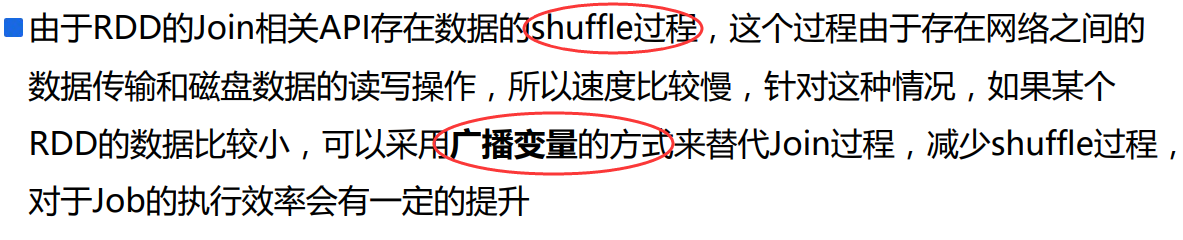

7.缺点

8.优化程序

没有使用API,根据原理写一个。

减少shufflw算子的使用。

import org.apache.spark.{SparkConf, SparkContext}

/**

* RDD数据Join相关API讲解

* Created by ibf on 02/09.

*/

object RDDJoin {

def main(args: Array[String]): Unit = {

val conf = new SparkConf()

.setMaster("local[*]")

.setAppName("RDD-Join")

val sc = SparkContext.getOrCreate(conf)

// ==================具体代码======================

// 模拟数据产生

val rdd1 = sc.parallelize(Array(

(1, "张三1"),

(1, "张三2"),

(2, "李四"),

(3, "王五"),

(4, "Tom"),

(5, "Gerry"),

(6, "莉莉")

), 1)

val rdd2 = sc.parallelize(Array(

(1, "上海"),

(2, "北京1"),

(2, "北京2"),

(3, "南京"),

(4, "纽约"),

(6, "深圳"),

(7, "香港")

), 1)

// 假设rdd2的数据比较少,将rdd2的数据广播出去

val leastRDDCollection = rdd2.collect()

val broadcastRDDCollection = sc.broadcast(leastRDDCollection)

println("++++++++++++++++++")

// 类似Inner Join的操作,Inner Join的功能:将两个表都出现的数据合并

println("-------------------")

rdd1

// 过滤rdd1中的数据,只要在rdd1中出现的数据,没有出现的数据过滤掉

.filter(tuple => broadcastRDDCollection.value.map(_._1).contains(tuple._1))

// 数据合并,由于一条rdd1的数据可能在rdd2中存在多条对应数据,所以使用flatMap

.flatMap {

case (id, name) => {

broadcastRDDCollection.value.filter(_._1 == id).map {

case (_, address) => {

(id, name, address)

}

}

}

}

.foreachPartition(iter => iter.foreach(println))

// 左外连接

println("---------------------")

rdd1

.flatMap {

case (id, name) => {

// 从右表所属的广播变量中获取对应id的集合列表

val list = broadcastRDDCollection.value.filter(_._1 == id)

// 对应id的集合可能为空,也可能数据有多个

if (list.nonEmpty) {

// 存在多个

list.map(tuple => (id, name, tuple._2))

} else {

// id在右表中不存在,填默认值

(id, name, "NULL") :: Nil

}

}

}

.foreachPartition(iter => iter.foreach(println))

// 右外连接

/**

* rdd2中所有数据出现,由于rdd2中的数据在driver中可以存储,可以认为rdd1和rdd2通过right join之后的数据也可以在driver中保存下

**/

println("---------------------")

// 将rdd1中符合条件的数据过滤出来保存到driver中

val stage1 = rdd1

.filter(tuple => broadcastRDDCollection.value.map(_._1).contains(tuple._1))

.collect()

// 将driver中两个集合进行right join

val stage2 = leastRDDCollection.flatMap {

case (id, address) => {

val list = stage1.filter(_._1 == id)

if (list.nonEmpty) {

list.map(tuple => (id, tuple._2, address))

} else {

Iterator.single((id, "NULL", address))

}

}

}

stage2.foreach(println)

// TODO: 全外连接,不写代码,因为代码比较复杂

//====================================

// 左半连接:只出现左表数据(要求数据必须在右表中也出现过),如果左表的数据在右表中出现多次,最终结果只出现一次

println("+++++++++++++++++")

println("-----------------------")

rdd1

.join(rdd2)

.map {

case (id, (name, _)) => (id, name)

}

.distinct()

.foreachPartition(iter => iter.foreach(println))

println("------------------------")

rdd1

.filter(tuple => broadcastRDDCollection.value.map(_._1).contains(tuple._1))

.foreachPartition(iter => iter.foreach(println))

// 休眠为了看4040页面

Thread.sleep(1000000)

}

}

9.Join的窄依赖程序

使用reduceByKey,里面的程序会给一个分区。

package com.ibeifeng.senior.join

import org.apache.spark.{SparkConf, SparkContext}

/**

* RDD数据Join相关API讲解

* Created by ibf on 02/09.

*/

object RDDJoin2 {

def main(args: Array[String]): Unit = {

val conf = new SparkConf()

.setMaster("local[*]")

.setAppName("RDD-Join")

val sc = SparkContext.getOrCreate(conf)

// ==================具体代码======================

// 模拟数据产生, 添加map、reduceByKey、mapPartitions等api的主要功能是给rdd1和rdd2中添加一个分区器(表示当前rdd是存在shuffle过程的)

val rdd1 = sc.parallelize(Array(

(1, "张三1"),

(1, "张三2"),

(2, "李四"),

(3, "王五"),

(4, "Tom"),

(5, "Gerry"),

(6, "莉莉")

), 1).map(x => (x, null)).reduceByKey((x,y) => x, 1).mapPartitions(

iter => iter.map(tuple => tuple._1),

true // 使用上一个RDD的分区器,false表示不使用, 设置为None

)

val rdd2 = sc.parallelize(Array(

(1, "上海"),

(2, "北京1"),

(2, "北京2"),

(3, "南京"),

(4, "纽约"),

(6, "深圳"),

(7, "香港")

), 1).map(x => (x, null)).reduceByKey((x,y) => x, 1).mapPartitions(

iter => iter.map(tuple => tuple._1),

true // 使用上一个RDD的分区器,false表示不使用, 设置为None

)

// 调用RDD API实现内连接

val joinResultRDD = rdd1.join(rdd2).map {

case (id, (name, address)) => {

(id, name, address)

}

}

println("----------------")

joinResultRDD.foreachPartition(iter => {

iter.foreach(println)

})

// 休眠为了看4040页面

Thread.sleep(1000000)

}

}

030 RDD Join中宽依赖与窄依赖的判断的更多相关文章

- Spark 中的宽依赖和窄依赖

Spark中RDD的高效与DAG图有着莫大的关系,在DAG调度中需要对计算过程划分stage,而划分依据就是RDD之间的依赖关系.针对不同的转换函数,RDD之间的依赖关系分类窄依赖(narrow de ...

- 大数据开发-从cogroup的实现来看join是宽依赖还是窄依赖

前面一篇文章提到大数据开发-Spark Join原理详解,本文从源码角度来看cogroup 的join实现 1.分析下面的代码 import org.apache.spark.rdd.RDD impo ...

- Spark --【宽依赖和窄依赖】

前言 Spark中RDD的高效与DAG图有着莫大的关系,在DAG调度中需要对计算过程划分stage,暴力的理解就是stage的划分是按照有没有涉及到shuffle来划分的,没涉及的shuffle的都划 ...

- Spark宽依赖、窄依赖

在Spark中,RDD(弹性分布式数据集)存在依赖关系,宽依赖和窄依赖. 宽依赖和窄依赖的区别是RDD之间是否存在shuffle操作. 窄依赖 窄依赖指父RDD的每一个分区最多被一个子RDD的分区所用 ...

- Spark剖析-宽依赖与窄依赖、基于yarn的两种提交模式、sparkcontext原理剖析

Spark剖析-宽依赖与窄依赖.基于yarn的两种提交模式.sparkcontext原理剖析 一.宽依赖与窄依赖 二.基于yarn的两种提交模式深度剖析 2.1 Standalne-client 2. ...

- Spark RDD概念学习系列之RDD的依赖关系(宽依赖和窄依赖)(三)

RDD的依赖关系? RDD和它依赖的parent RDD(s)的关系有两种不同的类型,即窄依赖(narrow dependency)和宽依赖(wide dependency). 1)窄依赖指的是每 ...

- 小记--------spark的宽依赖与窄依赖分析

窄依赖: Narrow Dependency : 一个RDD对它的父RDD,只有简单的一对一的依赖关系.RDD的每个partition仅仅依赖于父RDD中的一个partition,父RDD和子RDD的 ...

- spark-宽依赖和窄依赖

一.窄依赖(Narrow Dependency,) 即一个RDD,对它的父RDD,只有简单的一对一的依赖关系.也就是说, RDD的每个partition ,仅仅依赖于父RDD中的一个partition ...

- spark 划分stage Wide vs Narrow Dependencies 窄依赖 宽依赖 解析 作业 job stage 阶段 RDD有向无环图拆分 任务 Task 网络传输和计算开销 任务集 taskset

每个job被划分为多个stage.划分stage的一个主要依据是当前计算因子的输入是否是确定的,如果是则将其分在同一个stage,从而避免多个stage之间的消息传递开销. http://spark. ...

随机推荐

- Python3中的编码问题

编码方式介绍 我们首先来熟悉一下常见的一些编码方式,按照时间轴来划分,共有以下几种编码方式(常见): ASCII编码方式:对127个常见字符进行编码,其中包含了10个阿拉伯数字,共52个大小写英文字母 ...

- 高阶函数map(),filter(),reduce()

接受函数作为参数,或者把函数作为结果返回的函数是高阶函数,官方叫做 Higher-order functions. map()和filter()是内置函数.在python3中,reduce()已不再是 ...

- hdu 1358 Period 最小循环节

题目链接:http://acm.hdu.edu.cn/showproblem.php?pid=1358 分析:已知字符串,求其由最小循环节构成的前缀字符串. /*Period Time Limit: ...

- mysql concat_ws 与 concat 多字段模糊匹配应用

有时我们希望在表中多个字段检索是否有我们给出的关键字,我们可以使用 concat_ws 和 concat 连接需要检索的字段,如: select * from userInfo where conca ...

- Red Pen - 快速高效的获取设计项目的反馈

Red Pen 让设计师能够快速,高效的从你的同事和客户获取反馈.只需要简单的拖放图像到 Red Pen 主页,然后把生成的链接分享给你的同事或者客户.他们打开链接就能看到设计稿,并给予实时的反馈,所 ...

- 浏览器存储:cookie

Cookie是什么:cookie是指存储在用户本地终端上的数据,同时它是与具体的web页面或者站点相关的.Cookie数据会自动在web浏览器和web服务器之间传输,也就是说HTTP请求发送时,会把保 ...

- php-url地址加密

下面是可以将我们的url地址加密.确保我们提交的数据安全 以下是代码片段: <?php function keyED($txt,$encrypt_key) //定义一个keyED { $encr ...

- iOS代码规范之命名规范

技术博客http://www.cnblogs.com/ChenYilong/ 新浪微博http://weibo.com/luohanchenyilong 命名规范类命名 首字母大写,之 ...

- 爬虫笔记之自如房屋价格图片识别(价格字段css背景图片偏移显示)

一.前言 自如房屋详情页的价格字段用图片显示,特此破解一下以丰富一下爬虫笔记系列博文集. 二.分析 & 实现 先打开一个房屋详情页观察一下: 网页的源代码中没有直接显示价格字段,价格的显示是使 ...

- c语言.函数指针数组

函数指针: 一个指向函数的指针.一般用函数名表示. 函数指针数组:元素为函数指针的数组.转移表.c语言中函数不可以定义为数组,只能通过定义函数指针来操作. #include<stdio.h> ...