Orders matters: seq2seq for set 实验

论文提出了input的顺序影响seq2seq结果 有一些输入本身是无序的怎么去处理呢

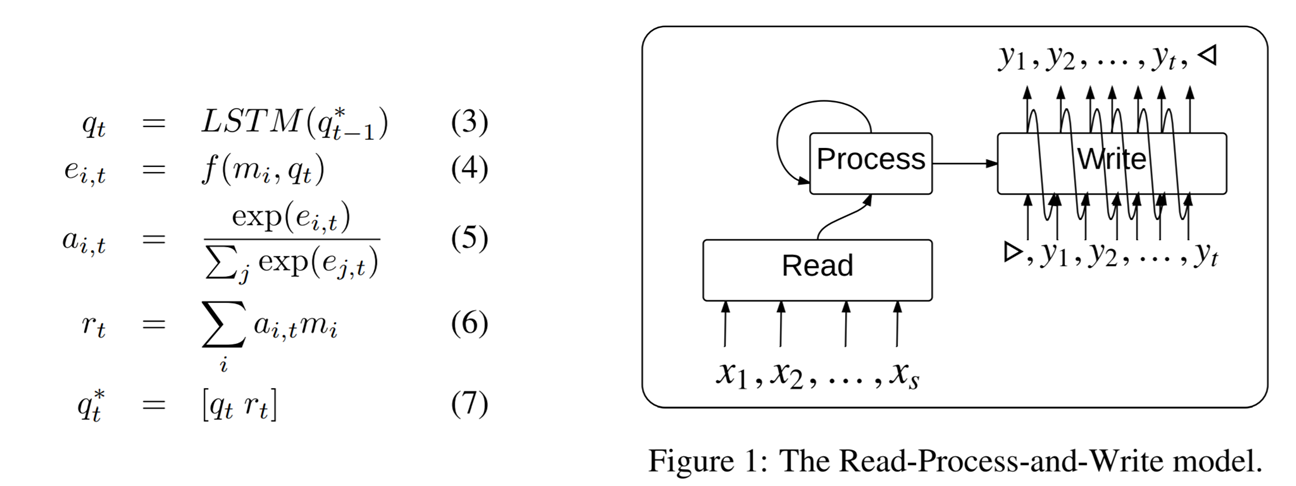

作者提出LSTM controller的方式 替代输入的LSTM encode方式

作者实验这种方式对应无序浮点数序列排序效果好于直接seq2seq

N是要排序的数的数目

P = 10 steps 表示 LSTM contorller process 10次

glimpses = 1 表示输出使用attention机制

不过实验复现这个结果不太一致

这里实验结果如下,也许实验细节和论文有出入,比如排序问题

要求输入是set 与顺序无关,那么LSTM的初始 input query是啥?

这里使用了全0向量作为input query实验

另外这个排序训练过程decoder是否使用feed prev?

这里使用feed prev 同时

使用soft attention读取输入作为下一步输入

实验结论:

- Ptr-Net 和作者提出的 set2seq方式

都是收敛有效的 - Ptr-Net 采用glimplse=1 N=15 使用tensorflow lstm训练,adgrad optimizer,learning rate 0.1初始,

运行10000次的结果

比上图所示要好很多AverageEvals:[0.37186, 0.14407] loss 是0.37186 序列完全预测准确情况的比例是14.4% 远远好于上面提到的4%的结果

- Set2seq虽然work 但是没有看出比直接ptr-net效果要好。。。

开始几步收敛确实更快

但是后续收敛远远慢于ptr net

选用Step = 20 对比 ptr net

所以是哪里出了问题

没有正确复现?

还是本来sort这个例子 lstm controller相比直接lstm序列encode就没有提升效果呢?

实验地址

https://github.com/chenghuige/hasky/tree/master/applications/set2seq

Orders matters: seq2seq for set 实验的更多相关文章

- 数据库中间件DBLE学习(二) 学习配置schema.xml

前言 一边有一个经常引诱我让我"娱乐至死"的视频,还有一个不停"鞭策"我让我快点学习的大BOSS.正是有这两种极端的爱才让我常常在自信中明白自己努力的方向.嗯, ...

- 《Do Neural Dialog Systems Use the Conversation History Effectively? An Empirical Study》

https://zhuanlan.zhihu.com/p/73723782 请复制粘贴到markdown 查看器查看! Do Neural Dialog Systems Use the Convers ...

- oracle 11g实验五——触发器的使用

实验要求: 实验五 触发器的使用 实验目的 1. 理解触发器的概念.作用及分类: 2. 掌握触发器的创建.使用: 实验内容 1. 建立表orders:用于存储订单列表信息:表order_item ...

- DL4NLP —— seq2seq+attention机制的应用:文档自动摘要(Automatic Text Summarization)

两周以前读了些文档自动摘要的论文,并针对其中两篇( [2] 和 [3] )做了presentation.下面把相关内容简单整理一下. 文本自动摘要(Automatic Text Summarizati ...

- Pytorch系列教程-使用Seq2Seq网络和注意力机制进行机器翻译

前言 本系列教程为pytorch官网文档翻译.本文对应官网地址:https://pytorch.org/tutorials/intermediate/seq2seq_translation_tutor ...

- pytorch做seq2seq注意力模型的翻译

以下是对pytorch 1.0版本 的seq2seq+注意力模型做法语--英语翻译的理解(这个代码在pytorch0.4上也可以正常跑): # -*- coding: utf-8 -*- " ...

- deeplearning.ai学习seq2seq模型

一.seq2seq架构图 seq2seq模型左边绿色的部分我们称之为encoder,左边的循环输入最终生成一个固定向量作为右侧的输入,右边紫色的部分我们称之为decoder.单看右侧这个结构跟我们之前 ...

- google nmt 实验踩坑记录

最近因为要做一个title压缩的任务,所以调研了一些text summary的方法. text summary 一般分为抽取式和生成式两种.前者一般是从原始的文本中抽取出重要的word o ...

- 时间序列深度学习:seq2seq 模型预测太阳黑子

目录 时间序列深度学习:seq2seq 模型预测太阳黑子 学习路线 商业中的时间序列深度学习 商业中应用时间序列深度学习 深度学习时间序列预测:使用 keras 预测太阳黑子 递归神经网络 设置.预处 ...

随机推荐

- ./configure && make && make install 编译安装和卸载 (Linux)

./configure && make && make install 编译安装和卸载 (Linux) 正常的编译安装/卸载: 源码的安装一般由3个步骤组成:配置( ...

- web的几种轮播

我们在开发当中经常用到轮播.我在这里总结了一下几种,仅供参考: 第一种: 1.jQuery:用display :none/block控制的一种轮播: // CSS部分 #igs { margin: 3 ...

- 【搜索】WAR大佬的SET @upcexam6201

时间限制: 1 Sec 内存限制: 128 MB 题目描述 WAR大佬认为一个包含重复元素的集合认为是优美的,当且仅当集合中的元素的和等于他们的积. 求包含n个元素的优美的集合的个数. WAR大佬当然 ...

- SpringMVC(2)—SpringMVC整合Spring的HelloWorld

一.这是一个SpringMVC框架的案例HelloWorld 功能:HelloWorld 二.SpringMVC运行流程 1.流程 请求-->springDispatcherServlet的ur ...

- CentOS下安装Jenkins(Docker/war/tomcat/java -jar)

参考官方提供的安装教程:https://jenkins.io/doc/book/installing/,可以发现官方推荐使用Docker进行安装.虽然用Docker有很多好处,但也有缺点. 下面是各种 ...

- Scala详解

1 快速入门... 4 1.1 分号... 4 1.2 常变量声明... 4 1.2.1 val常量... 4 1.2.2 ...

- netty中的ChannelHandler和ChannelPipeline

netty中的ChannelHandler和ChannelPipeline ChannelHandler 家族 https://www.w3cschool.cn/essential_netty_in_ ...

- 我的第一个 react redux demo

最近学习react redux,先前看过了几本书和一些博客之类的,感觉还不错,比如<深入浅出react和redux>,<React全栈++Redux+Flux+webpack+Bab ...

- C# 枚举类型 enum

我个人感觉平日用到的enum应该是非常简单的,无非就是枚举和整数.字符串之间的转换.最近工作发现一些同事居然不太会用这个东东,于是就整理一下. 枚举类型是定义了一组“符号名称/值”配对.枚举类型是强类 ...

- sql注入工具:sqlmap命令

sqlmap是一款专业的sql注入工具, 让你告别人工注入, 程序高效自动注入 前提是你有找到注入点 , 工具的官方网站:http://sqlmap.org/ kali系统默认安装sqlmap, 不需 ...