Attention模型

李宏毅深度学习

https://www.bilibili.com/video/av9770302/?p=8

Generation

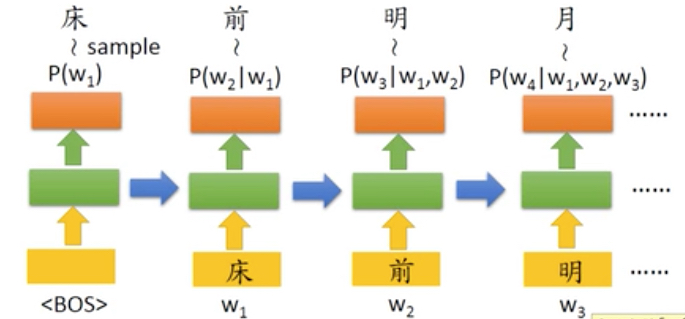

生成模型基本结构是这样的,

这个生成模型有个问题是我不能干预数据生成,这里是随机的,

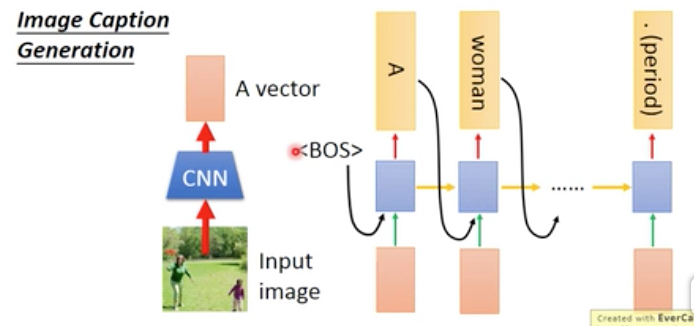

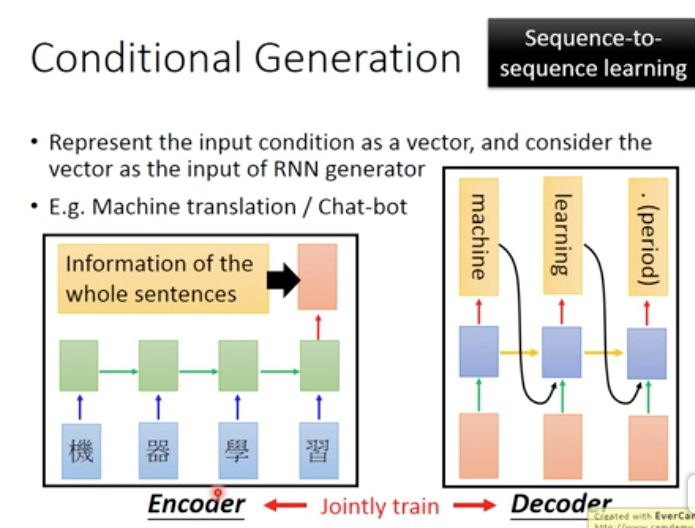

Conditional Generation

这里我们通过初始输入来增加条件,

比如要根据图片来深层文字,这里以image作为输入

当然首先要用cnn将图片生成embeding

为了防止RNN在进行的过程中forget这个输入,可以把图片作为每一步的输入传给网络

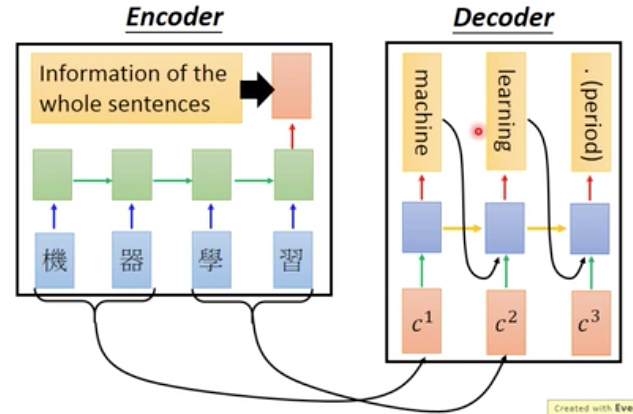

在NLP中,就是Sequence to Sequence模型,

seq2seq可以用作机器翻译或chatbot应用,

和上面的image case不同在于,

首先sentence的编码需要用rnn,而不是cnn,并且这里encoder和decoder是可以jointly train的,即同时train出encoder和decoder的参数

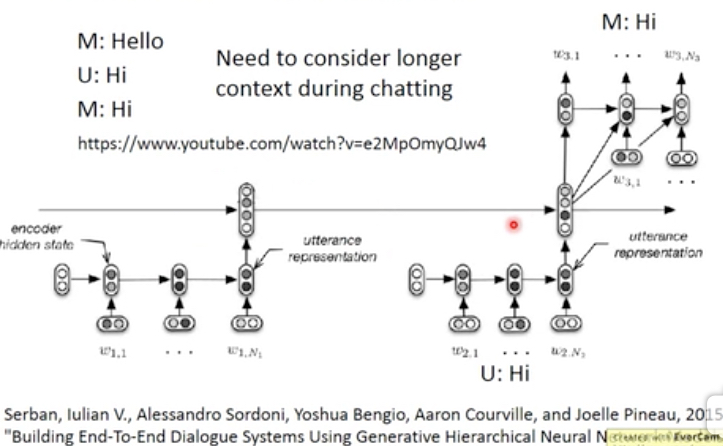

如果做的是chatbot,那么会有下面的问题,

会出现Hi,Hi,Hi........的对话

因为在没有上下文的情况下,对Hi的回答会一直是Hi

直觉的解法,要让网络知道上下文,就把历史encoder的结果级联起来,输出给decoder,让他知道之前说过什么

Attention

attention模型如其名,就是注意力模型

传统的情况,会把整个数据,比如整张图片,或者整段话,作为输入给网络

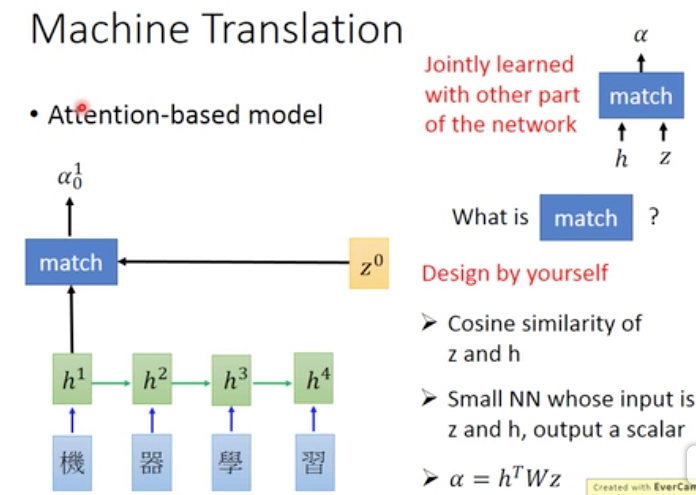

但这样也许是不合理的,比如下面的例子,在翻译machine的时候,我只需要看机器两个字就好,这样可以更加专注

那么怎么达到这个效果了

对于网络的设计而言,直觉上,我们可以通过一组参数来选择输入中的那一部分对网络可见

这组参数可称为attention,如何产生这些参数,

可以看到,我们可以用decode的输出z0和每个输入,用match function算一个attention

match function,这里给出多种选择

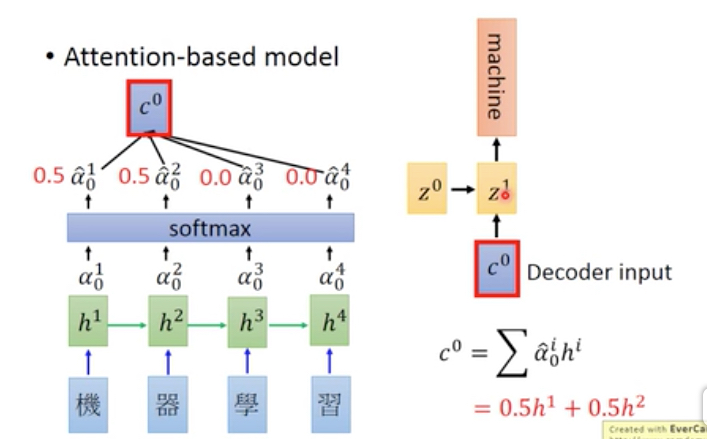

Attention模型的整个过程如下,

算出一组attention向量a,然后这里加上一个softmax是为了normalization,让向量的和为1

然后用attention和输入笛卡尔积,得到c0,把c0作为输入给到decoder

可以看到这里,c0是根据attention产生的,这里只包含‘机器’

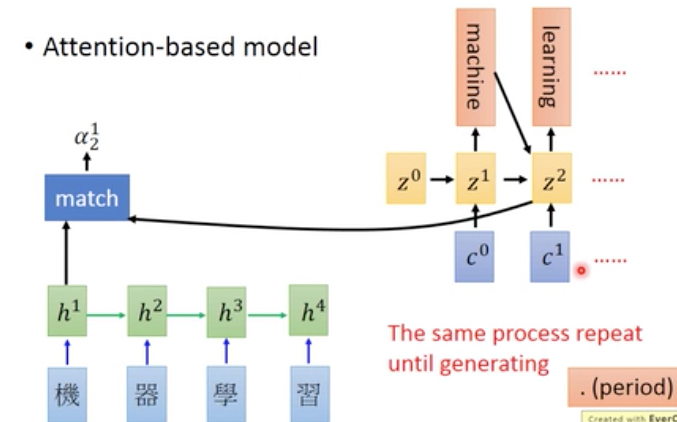

然后这个过程可以这么一直做下去,

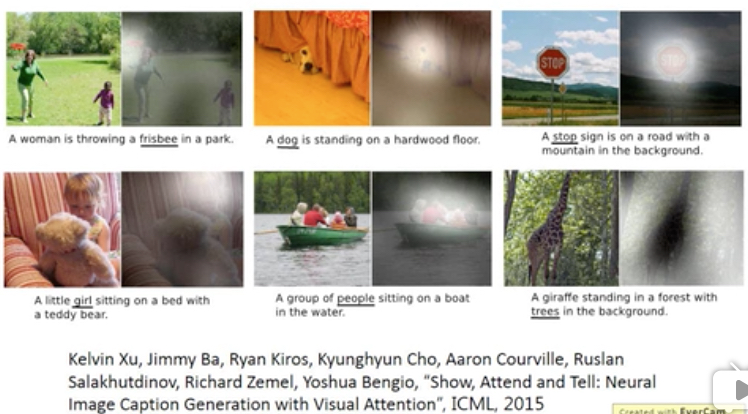

同样对于图片,我们也可以用attention模型,

用attention去选择每次激活哪些filter

最终得到效果如下,高亮部分表示下面划线的词,所attention的部分

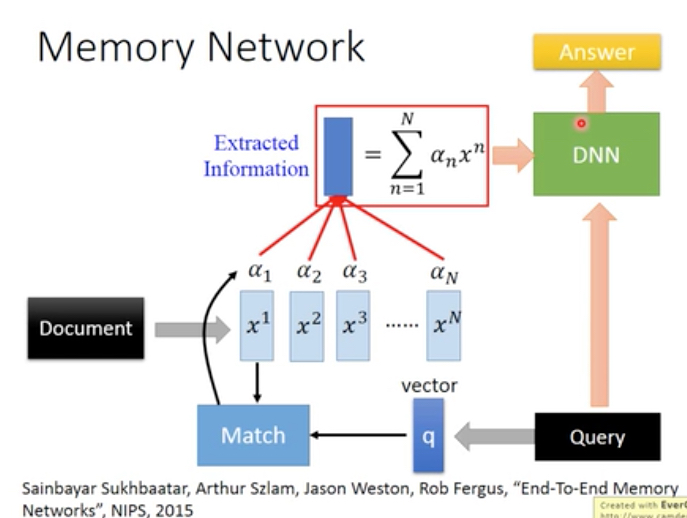

Memory Network

个人理解,这个是attention network的一种,

比如下面的例子,是一个智能问答系统,

通过query和document来计算attention,从而选择相应的文档子集,传给深度网络,得到answer

这个模型是可以整个joinit训练的,包含document产生embedding的参数,query embedding的参数,Match的参数等

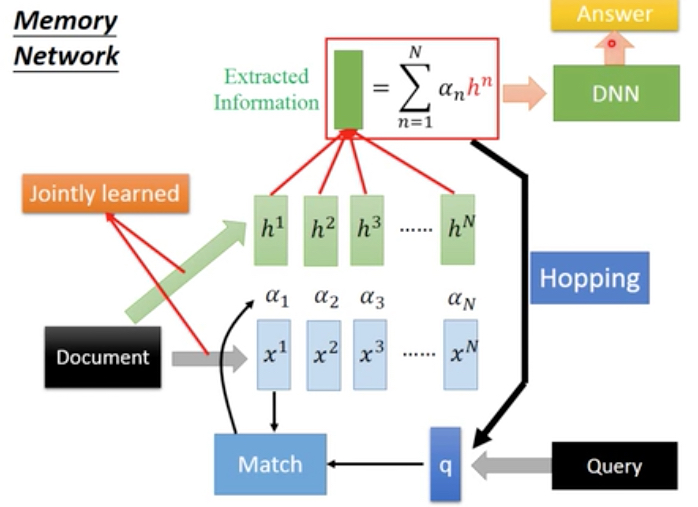

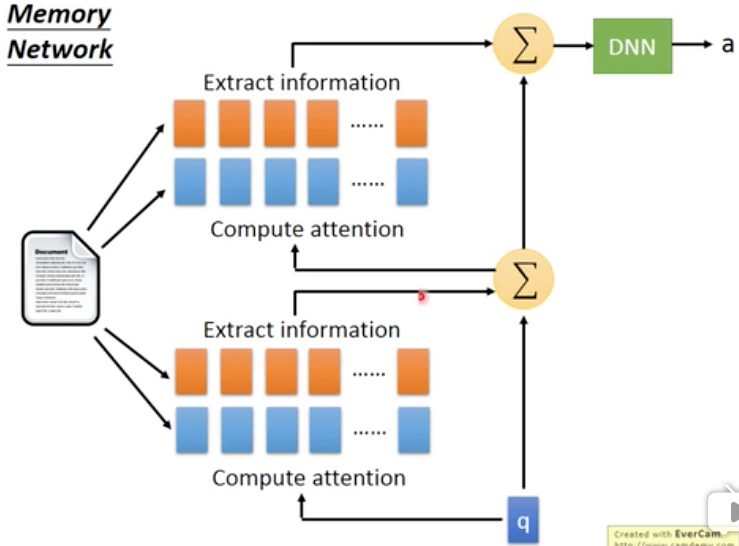

更复杂的模型,

这里产生attention和抽象文档内容,分别使用不同的embedding,这样就需要把document做两次encoding,参数会比较多

还加上Hopping过程,即得到Extracted Informatica后,不立刻传给DNN做为输入

而是循环做多次,attention生成和内容抽取的工作,过程如下,

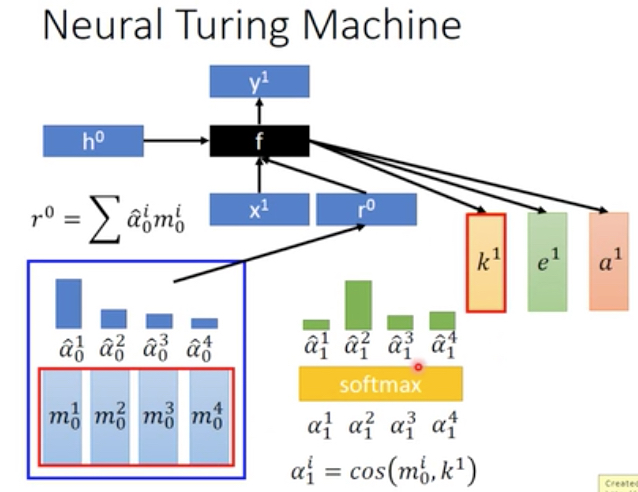

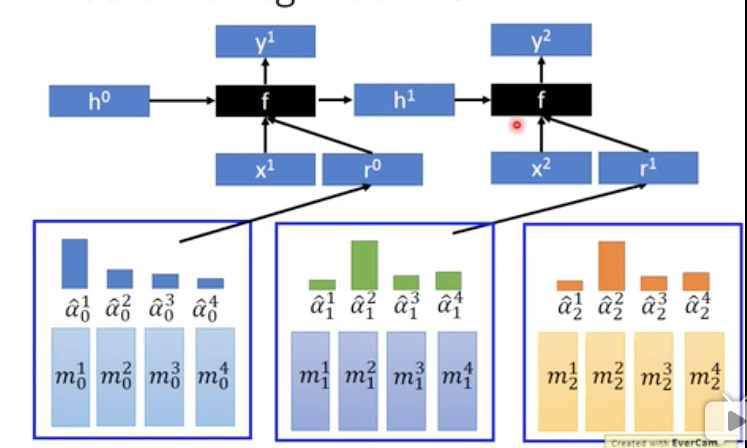

Nenual Turing Machine

这种网络的区别在于,前面的attention网络都是在不断的变化attention,但是不会修改内容

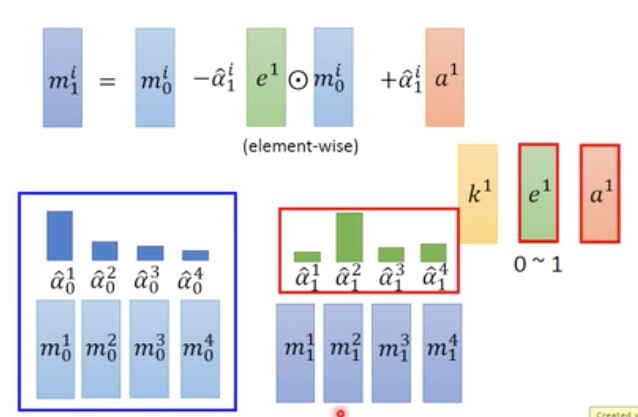

这种网络每次会去改变memory本身的内容

这一部分和attention一样,先更加memory和attention生成抽样内容r0,将r0输入网络后,产生3个输出,k,e,a

这里k是用来更新attention的,和之前一样,

而e和a是用来改变内容的,e用于清空内容,a用于填充内容,具体公式如下,

级联起来就是这样,

Attention模型的更多相关文章

- 文本分类实战(五)—— Bi-LSTM + Attention模型

1 大纲概述 文本分类这个系列将会有十篇左右,包括基于word2vec预训练的文本分类,与及基于最新的预训练模型(ELMo,BERT等)的文本分类.总共有以下系列: word2vec预训练词向量 te ...

- 人工机器:NDC-谷歌机器翻译破世界纪录,仅用Attention模型,无需CNN和RNN

终于找到ML日报的微信链接,抄之...................................... 请拜访原文链接:[谷歌机器翻译破世界纪录]仅用Attention模型,无需CNN和RNN. ...

- 从Seq2seq到Attention模型到Self Attention

Seq2seq Seq2seq全名是Sequence-to-sequence,也就是从序列到序列的过程,是近年当红的模型之一.Seq2seq被广泛应用在机器翻译.聊天机器人甚至是图像生成文字等情境. ...

- seq2seq聊天模型(三)—— attention 模型

注意力seq2seq模型 大部分的seq2seq模型,对所有的输入,一视同仁,同等处理. 但实际上,输出是由输入的各个重点部分产生的. 比如: (举例使用,实际比重不是这样) 对于输出"晚上 ...

- 吴裕雄--天生自然 pythonTensorFlow自然语言处理:Attention模型--训练

import tensorflow as tf # 1.参数设置. # 假设输入数据已经转换成了单词编号的格式. SRC_TRAIN_DATA = "F:\\TensorFlowGoogle ...

- 吴裕雄--天生自然 pythonTensorFlow自然语言处理:Attention模型--测试

import sys import codecs import tensorflow as tf # 1.参数设置. # 读取checkpoint的路径.9000表示是训练程序在第9000步保存的ch ...

- 深度学习之seq2seq模型以及Attention机制

RNN,LSTM,seq2seq等模型广泛用于自然语言处理以及回归预测,本期详解seq2seq模型以及attention机制的原理以及在回归预测方向的运用. 1. seq2seq模型介绍 seq2se ...

- [转] 图解Seq2Seq模型、RNN结构、Encoder-Decoder模型 到 Attention

from : https://caicai.science/2018/10/06/attention%E6%80%BB%E8%A7%88/ 一.Seq2Seq 模型 1. 简介 Sequence-to ...

- 深度学习之Attention Model(注意力模型)

1.Attention Model 概述 深度学习里的Attention model其实模拟的是人脑的注意力模型,举个例子来说,当我们观赏一幅画时,虽然我们可以看到整幅画的全貌,但是在我们深入仔细地观 ...

随机推荐

- LIBTUX_CAT:466: ERROR: tpopen TPERMERR xa_open returned XAER_INVAL

tmboot 启动Tuxedo服务失败,从ULOG日志中看到以下错误: 100534.MATHXH!TMS_ORA10G.22600.4076.0: LIBTUX_CAT:466: ERROR: tp ...

- Android 异常 android.os.NetworkOnMainThreadException

近期在实现一个Android下的数据採集的SDK,收集用户使用数据使用HTTP发送到云平台.进行数据分析.但在发送数据时报例如以下错误: Caused by: android.os.NetworkOn ...

- 【Vegas原创】SQLServer2008防小人利器:审核/审计功能

小人见怪不怪,世界上最可怕的就是会技术的小人,防不胜防! sa密码泄露也就算了,关键是人家也可以前台攻击,直接把你弄的没辙! 在诅咒这种小人的同时,除了加强服务器安全管理,密码策略等,SQL Serv ...

- 游戏行业DDoS攻击解决方案

行业综述 根据全球游戏和全球移动互联网行业第三方分析机构Newzoo的数据显示:2017年上半年,中国以275亿美元的游戏市场收入超过美国和日本,成为全球榜首. 游戏行业的快速发展.高额的攻击利润.日 ...

- 在 WPF 中如何在控件上屏蔽系统默认的触摸长按事件

来源:https://stackoverflow.com/questions/5962108/disable-a-right-click-press-and-hold-in-wpf-applicati ...

- [HDFS Manual] CH3 HDFS Commands Guide

HDFS Commands Guide HDFS Commands Guide 3.1概述 3.2 用户命令 3.2.1 classpath 3.2.2 dfs 3.2.3 envvars 3.2.4 ...

- c++中的var_dump

var_dump 在PHP中可以使用var_dump来输出变量,而且输出的内容很详细 用习惯后,再回来用c++的cout,各种不习惯,于是在github上找了一下,果然有类似的,而且是重载了 < ...

- 【转载】基于rasa的对话系统搭建(上)

文章介绍使用rasa nlu和 rasa core 实现一个电信领域对话系统demo,实现简单的业务查询办理功能,更完善的实现需要进一步数据的收集.demo基于玩具数据集,可以达到下面的效果: Bot ...

- shell脚本自动登录服务器

#!/bin/sh function trapper(){ trap 'exit 1' EXIT QUIT; } serverArr=( guard-boot-001,10.1.17.12 guard ...

- Wifi OKC 验证

OKC(Opportunistic Key Caching) OKC,也叫OPC(Opportunistic PMK Caching),是微软定义的一套标准,并不在802.11标准中.不过多数厂商都支 ...