机器学习-非线性回归(Logistic Regression)及应用

1. 概率

1.1 定义:概率(Probability):对一件事情发生的可能性的衡量。

1.2 范围:0 <= P <= 1

1.3 计算方法:

1.3.1 根据个人置信

1.3.2 根据历史数据

1.3.3 根据模拟数据

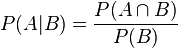

1.4 条件概率:

2. Logistic Regression(逻辑回归)

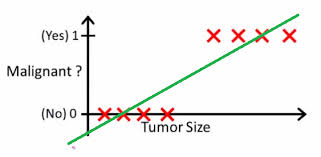

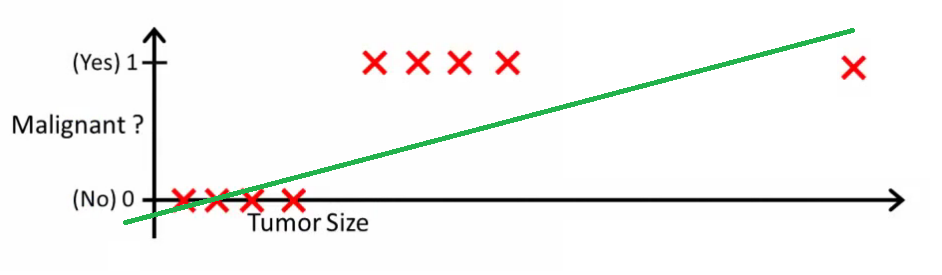

2.1 列子:模拟癌症肿瘤是良性还是恶性

h(x) > 0.5

h(x) > 0.2

2.2 基本模型

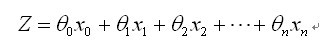

测试数据为:

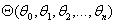

要学习的参数为:

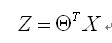

向量表示:

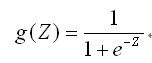

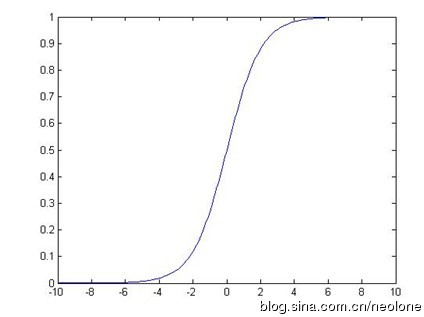

由于y取值在[0,1]之间,所有需要处理二值数据,引入Sigmoid函数来使得曲线平滑化

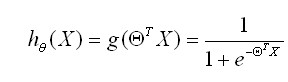

预测函数:

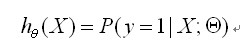

用概率表示:

正例(y = 1):

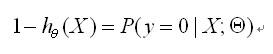

反例(y = 0):

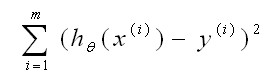

2.3 Cost函数

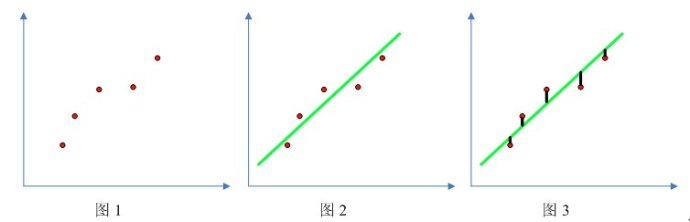

线性回归:

(预测值-实例值)

(预测值-实例值)

(类似于线性模型)

(类似于线性模型)

在简单线性模型中找到合适的 使得上式最小

使得上式最小

Logistic regression:

Cost函数:

上式合并可以得到下面的式子

目标:找到合适的 使得上式最小

使得上式最小

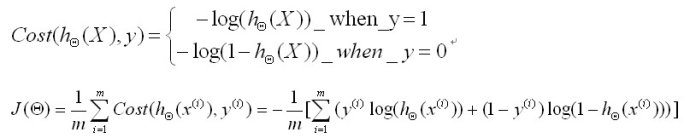

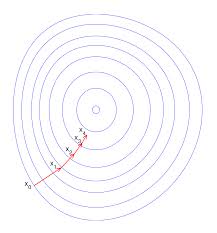

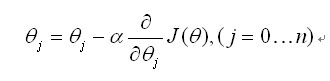

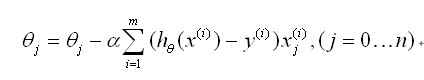

2.4 解法:梯度下降法(gradient decent)

为学习率

为学习率

更新法则:

为学习率

为学习率

同时对所有的 进行更新,重复更新知道收敛

进行更新,重复更新知道收敛

# -*- coding:utf-8 -*- import numpy as np

import random #产生模拟数据 numPoints实例个数 bias偏好值 variance方差

def genData(numPoints, bias, variance):

x = np.zeros(shape=(numPoints, 2))

y = np.zeros(shape=(numPoints)) #1行 如:1x100

for i in range(0, numPoints):#每一行循环

x[i][0] = 0 #每行第一列等于1

x[i][1] = i #每行第二列等于i

y[i] = (i + bias) + random.uniform(0, 1) + variance

return x,y #梯度下降

def gradientDescent(x, y, theta, alpha, m, numIterations): #alpha学习率 m实例个数 numIterations更新次数

xTran = np.transpose(x)#转置

for i in range(numIterations):

hypothesis = np.dot(x, theta)#估计值

loss = hypothesis - y#估计值-实际值

cost = np.sum(loss**2)/(2*m)#这里的定义最简单的cost函数和实际定义有出入

gradient = np.dot(xTran,loss)/m#更新量

theta = theta - alpha*gradient

print("Iteration %d | cost: %f" %(i, cost))

return theta #测试

x, y = genData(100, 25, 10)

# print("x:")

# print(x)

# print("y:")

# print(y)

#

m, n = np.shape(x)

n_y = np.shape(y)

#

# print("x_shape:" ,str(m)," ",str(n))

# print("y_shape:" , str(n_y)) numIterations = 100000

alpha = 0.0005

theta = np.ones(n)

theta = gradientDescent(x, y, theta, alpha, m, numIterations)

print(theta)

机器学习-非线性回归(Logistic Regression)及应用的更多相关文章

- 【机器学习】Logistic Regression 的前世今生(理论篇)

Logistic Regression 的前世今生(理论篇) 本博客仅为作者记录笔记之用,不免有非常多细节不正确之处. 还望各位看官能够见谅,欢迎批评指正. 博客虽水,然亦博主之苦劳也. 如需转载,请 ...

- Python机器学习笔记 Logistic Regression

Logistic回归公式推导和代码实现 1,引言 logistic回归是机器学习中最常用最经典的分类方法之一,有人称之为逻辑回归或者逻辑斯蒂回归.虽然他称为回归模型,但是却处理的是分类问题,这主要是因 ...

- 【模式识别与机器学习】——logistic regression

虽然叫做“回归”,但是这个算法是用来解决分类问题的.回归与分类的区别在于:回归所预测的目标量的取值是连续的(例如房屋的价格):而分类所预测的目标变量的取值是离散的(例如判断邮件是否为垃圾邮件).当然, ...

- 在opencv3中实现机器学习之:利用逻辑斯谛回归(logistic regression)分类

logistic regression,注意这个单词logistic ,并不是逻辑(logic)的意思,音译过来应该是逻辑斯谛回归,或者直接叫logistic回归,并不是什么逻辑回归.大部分人都叫成逻 ...

- Stanford机器学习---第三讲. 逻辑回归和过拟合问题的解决 logistic Regression & Regularization

原文:http://blog.csdn.net/abcjennifer/article/details/7716281 本栏目(Machine learning)包括单参数的线性回归.多参数的线性回归 ...

- 机器学习总结之逻辑回归Logistic Regression

机器学习总结之逻辑回归Logistic Regression 逻辑回归logistic regression,虽然名字是回归,但是实际上它是处理分类问题的算法.简单的说回归问题和分类问题如下: 回归问 ...

- 机器学习入门11 - 逻辑回归 (Logistic Regression)

原文链接:https://developers.google.com/machine-learning/crash-course/logistic-regression/ 逻辑回归会生成一个介于 0 ...

- 李宏毅机器学习笔记3:Classification、Logistic Regression

李宏毅老师的机器学习课程和吴恩达老师的机器学习课程都是都是ML和DL非常好的入门资料,在YouTube.网易云课堂.B站都能观看到相应的课程视频,接下来这一系列的博客我都将记录老师上课的笔记以及自己对 ...

- 【机器学习】逻辑回归(Logistic Regression)

注:最近开始学习<人工智能>选修课,老师提纲挈领的介绍了一番,听完课只了解了个大概,剩下的细节只能自己继续摸索. 从本质上讲:机器学习就是一个模型对外界的刺激(训练样本)做出反应,趋利避害 ...

随机推荐

- 20175215 2018-2019-2 第五周java课程学习总结

第六章学习内容 1.接口 使用interface来定义一个接口. 接口体中包含常量的声明(没有变量)和抽象方法两部分.接口体中只有抽象方法,没有普通的方法,而且接口体中所有的常量的访问权限一定都是pu ...

- 191112Django项目常用配置

创建项目 >django-admin startproject project01 创建应用 >python manage.py startapp app01 settings.py 配置 ...

- typescript 类(类的定义、继承、修饰符、抽象类)

代码: // 本节内容 // 1.类的定义 // 2.类的继承 // 3.访问修饰符 // 4.静态属性和静态方法 // 5.抽象类和多态 // js // function Person(name) ...

- leetcode-easy-math-326. Power of Three

mycode class Solution(object): def isPowerOfThree(self, n): """ :type n: int :rtype: ...

- NavisWorks连接外部数据库,为模型附加属性

可以直接从Navisworks 文件连接到外部数据库,并在场景中的对象与数据库表中的字段之间创建链接以引入额外特性. 1.连接mdb数据库 新建数据连接 单击“新建”按钮,新建数据连接,输入一个名称, ...

- 第八章 SpringCloud之Feign、Hystrix结合使用

#这个章节主要是针对Hystrix的使用,因为Feign的章节在上一节已经实现了,整个代码也是在上一个章节的基础上修改的 ##################Hystrix一个简单Demo实现#### ...

- python之拷贝文件

做了个小实验, 用于拷贝文件夹下面的jpg. 用于拓展, 可以引入类和方法, 拷贝你指定的任意类型的文件. import os src = 'C:\\Users\\Administrator\\Des ...

- Android 调用相机、相册功能

清单文件中增加对应权限,动态申请权限(此部分请参考Android 动态申请权限,在此不作为重点描述) private static final int REQUEST_CODE_ALBUM = 100 ...

- django QueryDict 类型

如果没有值,返回默认值的写法 允许有多个同名的值,但是需要用getlist 访问. 如果用常规的访问只能访问到最后一个值.

- java:JavaScript3(innerHTML,post和get,单选框,多选框,下拉列表值得获取,JS中的数组,JS中的正则)

1.innerHTML用户登录验证: <!DOCTYPE> <html> <head> <meta charset="UTF-8"> ...