安装hadoop集群--hdfs

准备一台干净的虚拟机-centos7

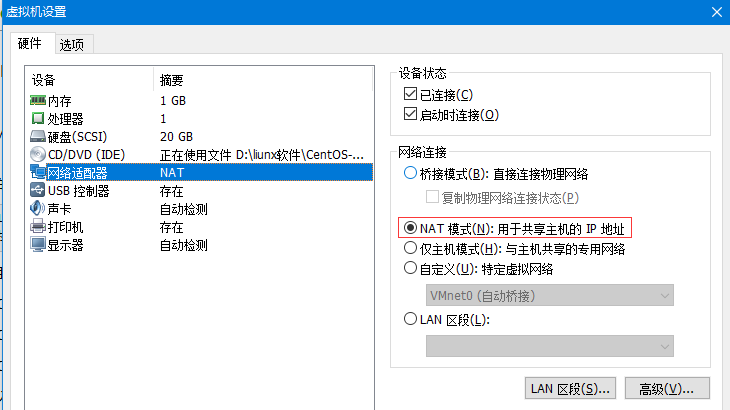

网络连接改成NAT模式 进行下一步安装

[root@hdp-01 ~]# vi /etc/sysconfig/network-scripts/ifcfg-ens33

ONBOOT=no改为ONBOOT=yes

重启网络服务:

[root@hdp-01 ~]# sudo service network restart

[root@hdp-01 ~]# mkdir apps

[root@hdp-01 ~]# tar -zxvf jdk-8u152-linux-x64.tar.gz -C apps/

[root@hdp-01 ~]# mv jdk1.8.0_152 java

[root@hdp-01 ~]# vi /etc/profile

[root@hdp-01 ~]# vi /etc/profile

在文件最后加入:

export JAVA_HOME=/root/apps/java

export PATH=$PATH:$JAVA_HOME/bin

修改完成后,记得 source /etc/profile使配置生效

hdp-01为模板克隆四台虚拟机 分别为hdp-02 hdp-03 hdp-04

Windows配置hosts文件

C:\Windows\System32\drivers\etc

192.168.137.138 hdp-01

192.168.137.139 hdp-02

192.168.137.140 hdp-03

192.168.137.141 hdp-04

配置SSH免密登录

在每台服务器或虚拟机上配置hosts,命令行输入:

vi /etc/hosts

在其中添加所有服务器或虚拟机节点ip和对应的域名

192.168.137.138 hdp-01

192.168.137.139 hdp-02

192.168.137.140 hdp-03

192.168.137.141 hdp-04

在hdp-01中输入ssh-keygen 一直回车

复制公钥到其他节点

ssh-copy-id -i .ssh/id_rsa.pub root@hdp-01

ssh-copy-id -i .ssh/id_rsa.pub root@hdp-02

ssh-copy-id -i .ssh/id_rsa.pub root@hdp-03

ssh-copy-id -i .ssh/id_rsa.pub root@hdp-04

复制完成即可实现免密登录,测试一下:

ssh 0.0.0.0

上传hadoop-2.8.4.tar.gz到hdp-01

[root@hdp-01 ~]# tar -zxvf hadoop-2.8.4.tar.gz -C apps/

[root@hdp-01 apps]# mv hadoop-2.8.4/ hadoop

修改配置文件

指定hadoop的默认文件系统为:hdfs

指定hdfs的namenode节点为哪台机器

指定namenode软件存储元数据的本地目录

指定datanode软件存放文件块的本地目录

hadoop的配置文件在:/root/apps/hadoop/etc/hadoop/

[root@hdp-01 ~]# cd apps/hadoop/etc/hadoop

[root@hdp-01 hadoop]# vi hadoop-env.sh

修改hadoop-env.sh

export JAVA_HOME=/root/apps/java

修改core-site.xml

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://hdp-01:9000</value>

</property>

</configuration>

修改hdfs-site.xml

<configuration>

<property>

<name>dfs.namenode.name.dir</name>

<value>/root/dfs/name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>/root/dfs/data</value>

</property>

</configuration>

[root@hdp-01 ~]# cd apps/hadoop/share/

[root@hdp-01 share]# rm -rf doc/

拷贝整个hadoop安装目录到其他机器

scp -r /root/apps/hadoop hdp-02:/root/apps/

scp -r /root/apps/hadoop hdp-03:/root/apps/

scp -r /root/apps/hadoop hdp-04:/root/apps/

启动HDFS

提示:要运行hadoop的命令,需要在linux环境中配置HADOOP_HOME和PATH环境变量

vi /etc/profile

export JAVA_HOME=/root/apps/java

export HADOOP_HOME=/root/apps/hadoop

export PATH=$PATH:$JAVA_HOME/bin:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

source /etc/profile

[root@hdp-01 ~]# scp -r /etc/profile hdp-02:/etc/profile

[root@hdp-01 ~]# scp -r /etc/profile hdp-03:/etc/profile

[root@hdp-01 ~]# scp -r /etc/profile hdp-04:/etc/profile

初始化namenode的元数据目录

hdp-01上执行hadoop的一个命令来初始化namenode的元数据存储目录

[root@hdp-01 ~]# hadoop namenode -format

创建一个全新的元数据存储目录

生成记录元数据的文件fsimage

生成集群的相关标识:如:集群id——clusterID

启动namenode进程(在hdp-01上)

关闭防火墙

[root@hdp-01 ~]# hadoop-daemon.sh start namenode

启动完后,ps查看一下namenode的进程是否存在

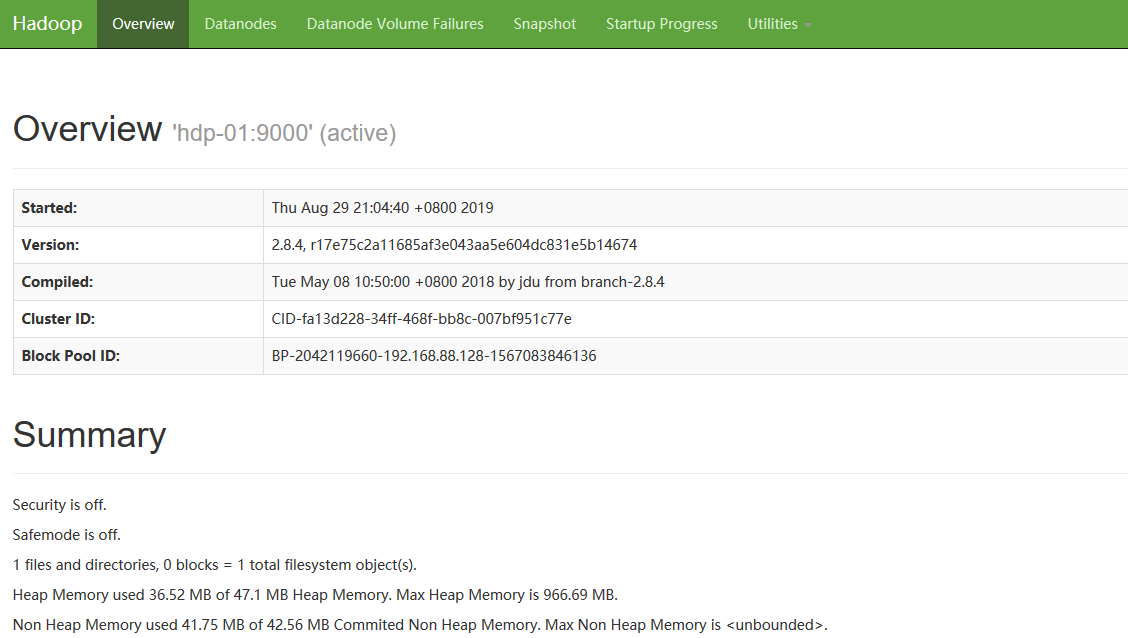

windows中用浏览器访问namenode提供的web端口:50070

启动众datanode们(在任意地方)

hadoop-daemon.sh start datanode

用自动批量启动脚本来启动HDFS

修改hadoop安装目录中/etc/hadoop/slaves(把需要启动datanode进程的节点列入)

[root@hdp-01 ~]# vi apps/hadoop/etc/hadoop/slaves

//加入

hdp-01

hdp-02

hdp-03

hdp-04

在hdp-01上用脚本:start-dfs.sh 来自动启动整个集群

停止则用脚本:stop-dfs.sh

安装hadoop集群--hdfs的更多相关文章

- 高可用,完全分布式Hadoop集群HDFS和MapReduce安装配置指南

原文:http://my.oschina.net/wstone/blog/365010#OSC_h3_13 (WJW)高可用,完全分布式Hadoop集群HDFS和MapReduce安装配置指南 [X] ...

- docker安装hadoop集群

docker安装hadoop集群?图啥呢?不图啥,就是图好玩.本篇博客主要是来教大家如何搭建一个docker的hadoop集群.不要问 为什么我要做这么无聊的事情,答案你也许知道,因为没有女票.... ...

- Hadoop集群-HDFS集群中大数据运维常用的命令总结

Hadoop集群-HDFS集群中大数据运维常用的命令总结 作者:尹正杰 版权声明:原创作品,谢绝转载!否则将追究法律责任. 本篇博客会简单涉及到滚动编辑,融合镜像文件,目录的空间配额等运维操作简介.话 ...

- 安装Hadoop集群的最快的软件

Quick Hadoop是一款安装Hadoop集群的桌面软件,只需要点两下鼠标,一分钟之内安装Hadoop到集群上,超快! 还在每台主机的Shell里一行一行地敲安装Hadoop的命令?别苦逼了! 用 ...

- CentOS7 搭建Ambari-Server,安装Hadoop集群(一)

2017-07-05:修正几处拼写错误,之前没发现,抱歉! 第一次在cnblogs上发表文章,效果肯定不会好,希望各位多包涵. 编写这个文档的背景是月中的时候,部门老大希望我们能够抽时间学习一下Had ...

- 通过ambari安装hadoop集群,ZT

通过ambari安装hadoop集群,ZT http://www.cnblogs.com/cenyuhai/p/3295635.html http://www.cnblogs.com/cenyuhai ...

- Linux上安装Hadoop集群(CentOS7+hadoop-2.8.0)--------hadoop环境的搭建

Linux上安装Hadoop集群(CentOS7+hadoop-2.8.0)------https://blog.csdn.net/pucao_cug/article/details/71698903 ...

- 安装hadoop集群服务器(hadoop1.2.1)

摘要:hadoop,一个分布式系统基础架构,可以充分利用集群的威力进行高速运算和存储.本文主要介绍hadoop的安装与集群服务器的配置. 准备文件: ▪ VMware11.0.0 ▪ Cen ...

- CentOS7 安装Hadoop集群环境

先按照上一篇安装与配置好CentOS以及zookeeper http://www.cnblogs.com/dopeter/p/4609276.html 本章介绍在CentOS搭建Hadoop集群环境 ...

随机推荐

- Modify column Vs change column

引言 I know, we can not rename a column using modify column syntax,but can change column syntax. My qu ...

- Linux系统安装Tomcat——.tar.gz版

1.rpm.deb.tar.gz的区别: rpm格式的软件包适用于基于Red Hat发行版的系统,例如Red Hat Linux.SUSE.Fedora. deb格式的软件包则是适用于基于Debian ...

- Java网络和代理

Java网络和代理 1)简介 在当今的网络环境中,特别是企业网络环境中,应用程序开发人员必须像系统管理员一样频繁地处理代理.在某些情况下,应用程序应该使用系统默认设置,在其他情况下,我们希望能够非常严 ...

- 勘误:EOS资源抵押退还

关键字:勘误,delegatebw,undelegatebw,listbw,资源管理,抵押,解抵押,返还资源 EOS中,资源抵押与解抵押是通过一对命令完成的:delegatebw,undelegate ...

- IrisSkin2.dll 添加皮肤

使用说明:把控件拖到你的form上,只需一行代码,即可实现整个form包括其所有控件的皮肤的更换,总共有几十套皮肤供使用,非常方便.省去你设计开发软件皮肤系统的时间和精力.全部源代码就一行: skin ...

- HTTP_2_HTTP协议概要

http协议概要 HTTP 通信对象 通信方式 通信状态 定位资源 节省通信量 超文本传输协议 客户端与服务器端 请求和响应 不保存状态(借助cookie) 请求URI keep-alive/pipe ...

- spring aop(四)

直接找到解析aop标签的方法: protected void parseBeanDefinitions(Element root, BeanDefinitionParserDelegate deleg ...

- 提交bug的标准及书写规范

Bug有效性 1.交付过程中测试者需按照专家设定好的模块,对Bug进行归类提交: 2.Bug的类型默认为UI问题.功能问题.崩溃问题,提交Bug时不能弄错: 3.需求是否明确.前提条件是否满足.输入数 ...

- SpringMVC项目案例之---数据的获取与显示

数据的获取与显示 (一)功能 1.对用户输入的数据进行获取 2.将获取的数据显示到页面 3.使用了SpringMVC技术的注解方式 4.使用了过滤器,处理中文乱码问题 5.在web.xml中设置了访问 ...

- 【Java例题】7.6文件题3-文本文件统计

6.文本文件统计.已有一个文本文件文件,请统计数字.大写字母.小写字母.汉字及其它字符出现的次数:然后将这些次数由大到小写到另一个文件之中.说明:将次数为零的过滤掉排序 package chapter ...