Inception系列理解

写在前面

Inception 家族成员:Inception-V1(GoogLeNet)、BN-Inception、Inception-V2、Inception-V3、Inception-ResNet-V1、Inception-V4、Inception-ResNet-V2。

Inception系列网络结构可以模块化为:

\]

- Stem:前处理部分

- A B C:网络主体“三段式”,A B C每段的输入feature size依次折半,channel增加

- ReductionA B:完成feature size折半操作(降采样)

- Avg Pooling (+ Linear):后处理部分

Inception系列的演化过程就是上面各环节不断改进(越来越复杂)的过程,其进化方向大致为

- Stem:大卷积层→多个小卷积层堆叠→multi-branch 小卷积层堆叠

- A B C:相同multi-branch结构→每阶段不同multi-branch结构→每阶段不同Residual+multi-branch结构,big convolution→ small convolution + BN → factorized convolution

- ReductionA B:max pooling → 不同multi-branch conv(stride 2)结构

- 后处理:Avg Pooling + Linear → Avg Pooling

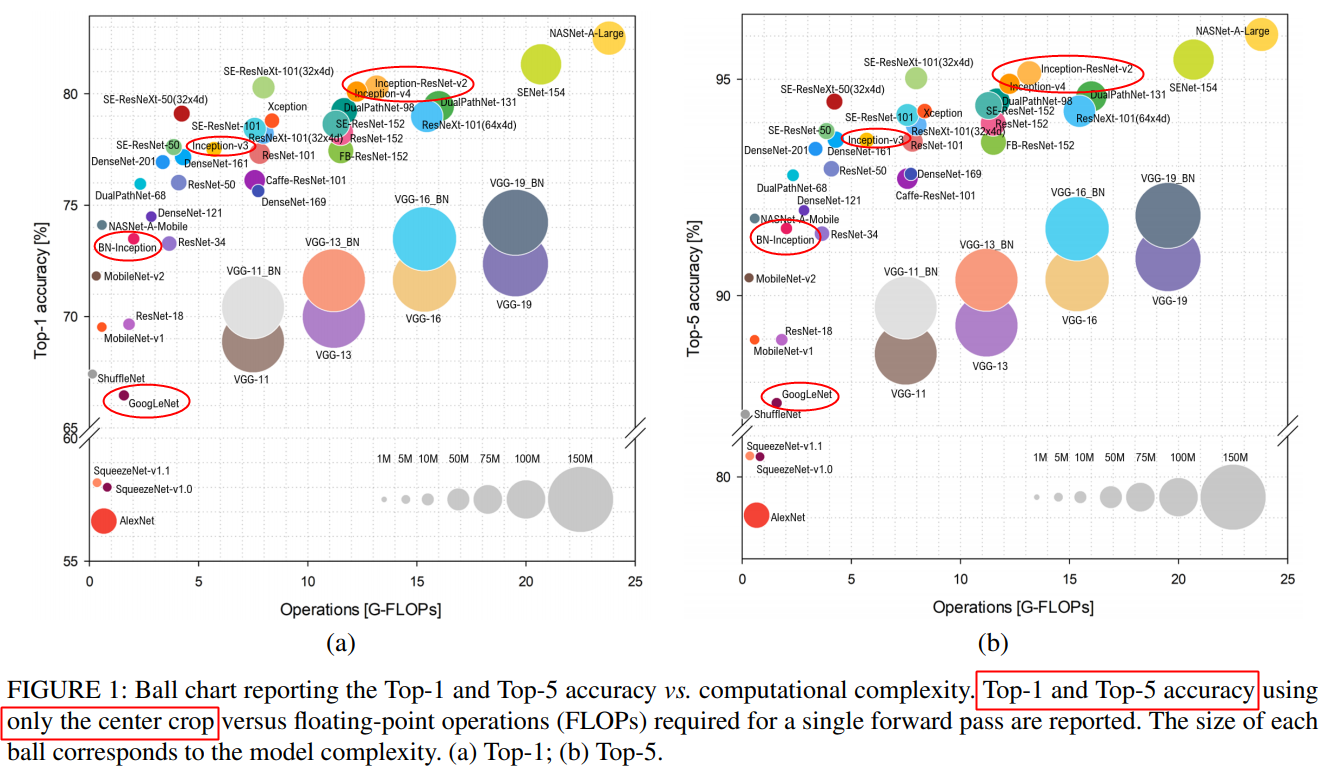

性能进化如下图所示,single model通过center crop 在ImageNet上 Top1 和 Top5 准确率,

具体如下。

Inception-V1 (GoogLeNet)

Inception-V1,更被熟知的名字为GoogLeNet,意向Lenet致敬。

通过增加网络深度和宽度可以提升网络的表征能力。

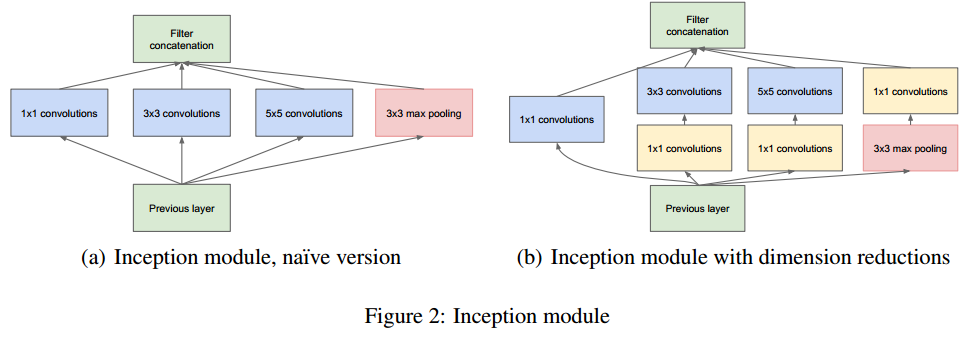

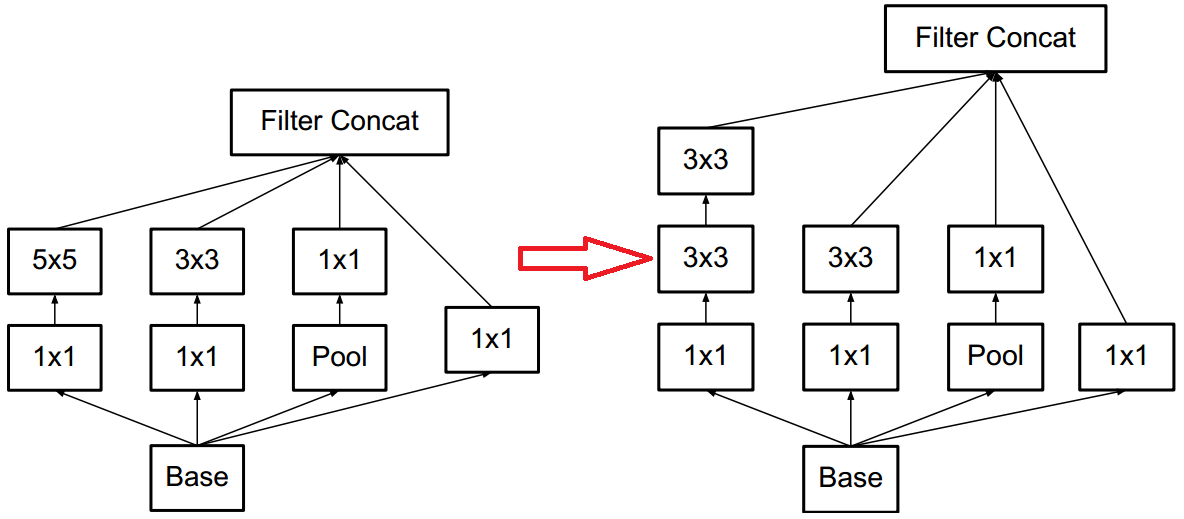

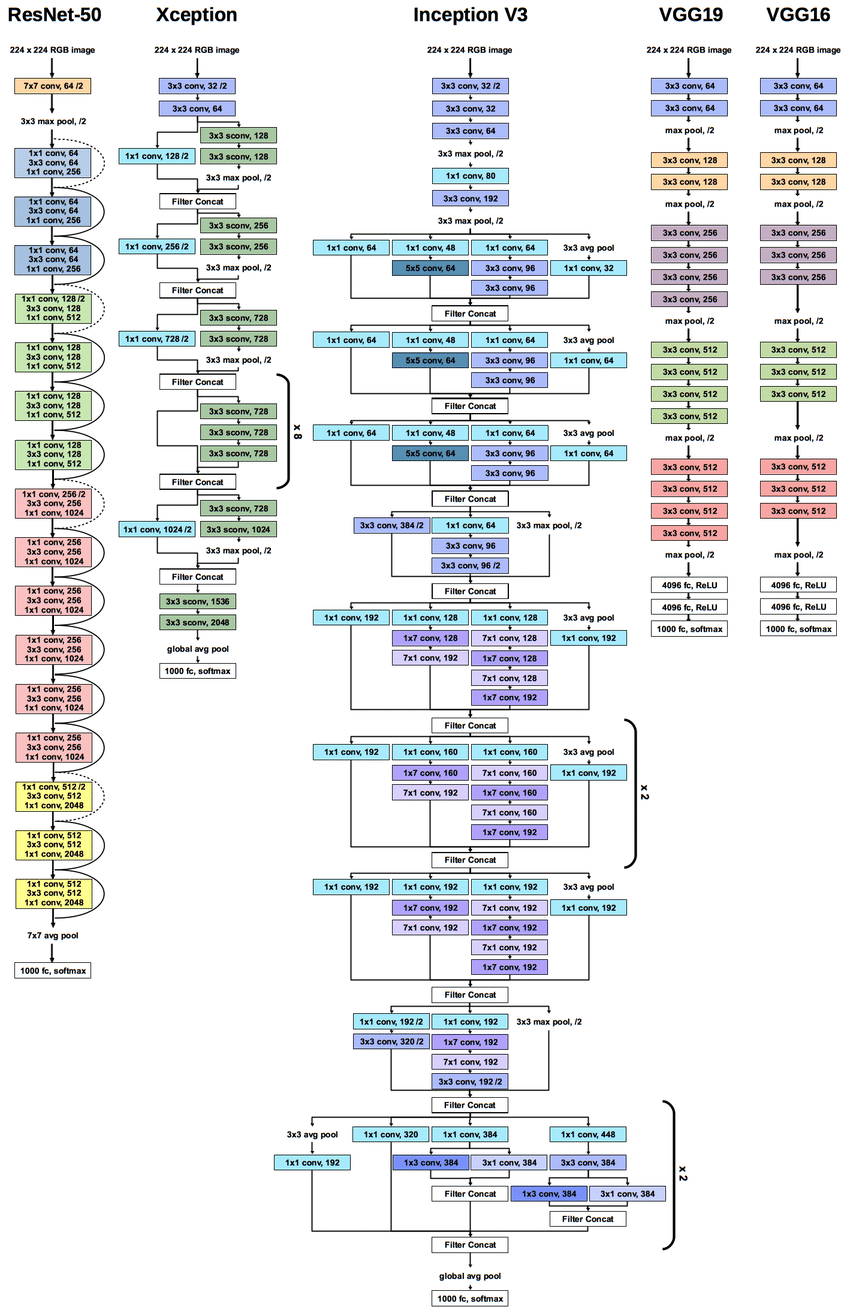

增加宽度可以简单地通过增加卷积核数量来实现,GoogLeNet在增加卷积核数量的同时,引入了不同尺寸的卷积核,来捕捉不同尺度的特征,形成了multi-branch结构——这是GoogLeNet网络结构的最大特点,如下图所示,然后将不同branch得到的feature map 拼接在一起,为了让feature map的尺寸相同,每个branch均采用SAME padding方式,同时stride为1(包括max pooling)。为了降低计算量,又引入了\(1\times 1\)卷积层来降维,如下图右所示,该multi-branch结构称之为一个Inception Module,在GoogLeNet中采用的是下图右的Inception Module。

直接增加深度会导致浅层出现严重的梯度消失现象,GoogLeNet引入了辅助分类器(Auxiliary Classifier),在浅层和中间层插入,来增强回传时的梯度信号,引导浅层学习到更具区分力的特征。

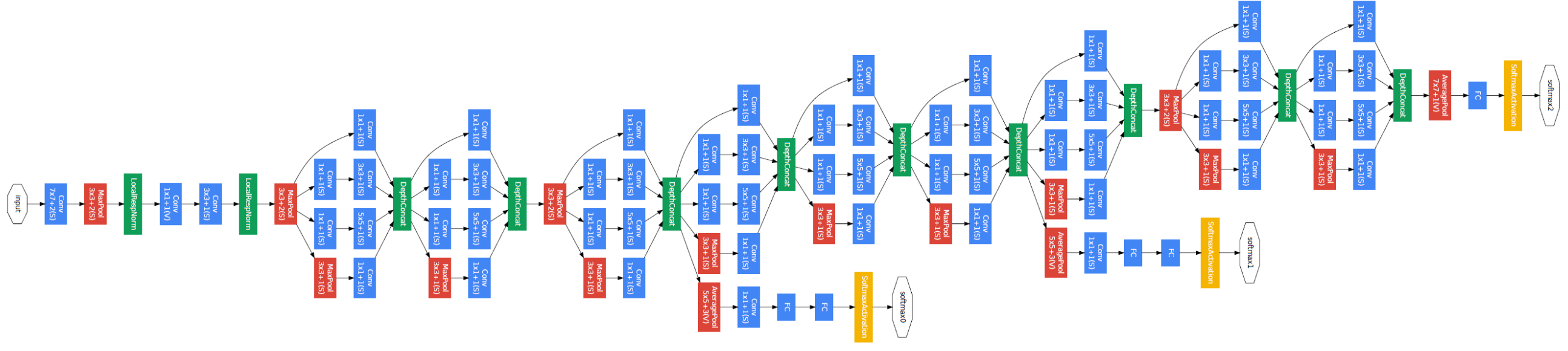

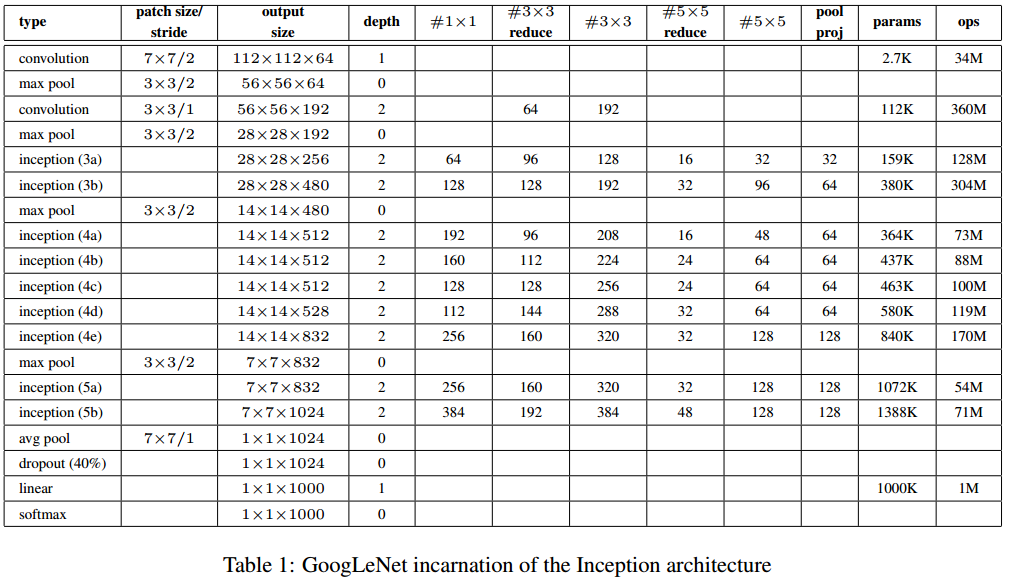

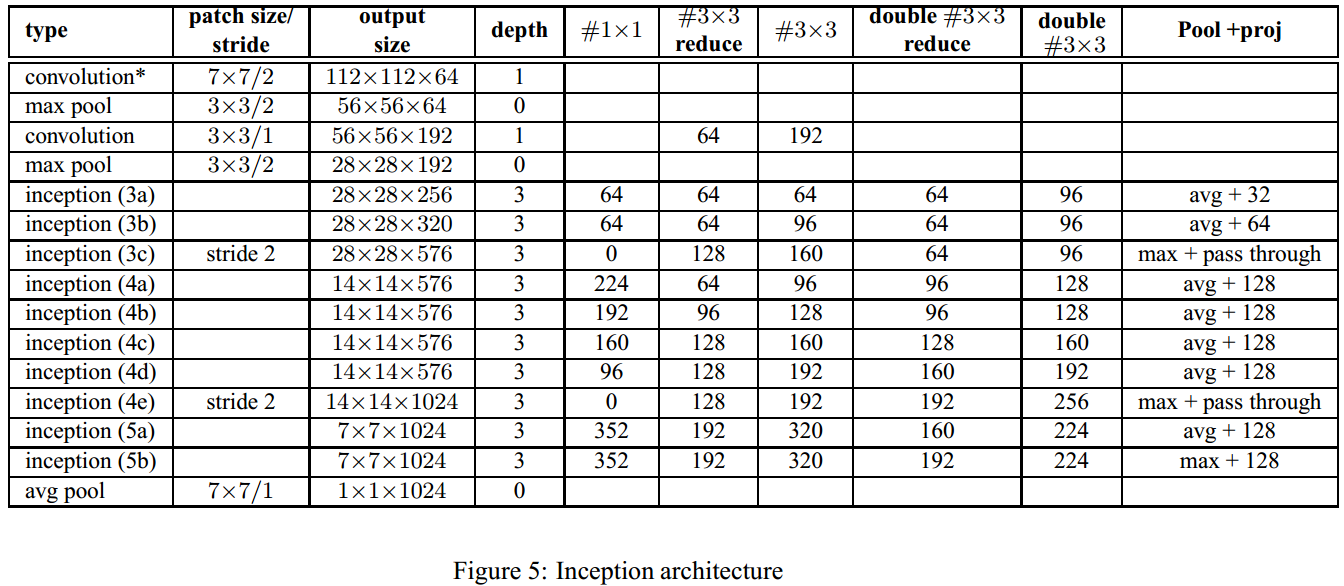

最终,网络结构如下,主体三段式A B C 即 3x、4x、5x,

GoogLeNet网络结构的特点可以概括为,

- 同时使用不同尺寸的卷积核,形成multi-branch结构,来捕捉不同尺度的特征

- 使用\(1 \times 1\)卷积降维,压缩信息,降低计算量

- 在classifier前使用average pooling

BN-Inception

BN-Inception网络实际是在Batch Normalization论文中顺带提出的,旨在表现BN的强大。

与GoogLeNet的不同之处在于,

- 在每个激活层前增加BN层

- 将Inception Module中的\(5 \times 5\) 卷积替换为2个\(3\times 3\) 卷积,如上图所示

- 在Inception 3a和3b之后增加Inception 3c

- 部分Inception Module中的Pooling层改为average pooling

- 取消Inception Module之间衔接的pooling层,而将下采样操作交给Inception 3c和4e,令stride为2

BN-Inception网络结构如下

Inception-V2, V3

Inception V2和V3出自同一篇论文Rethinking the Inception Architecture for Computer Vision。

GoogLeNet和BN-Inception网络结构中Inception Module可分为3组,称之为3x、4x和5x(即主体三段式A B C),GoogLeNet和BN-Inception这3组采用相同Inception Module结构,只是堆叠的数量不同。

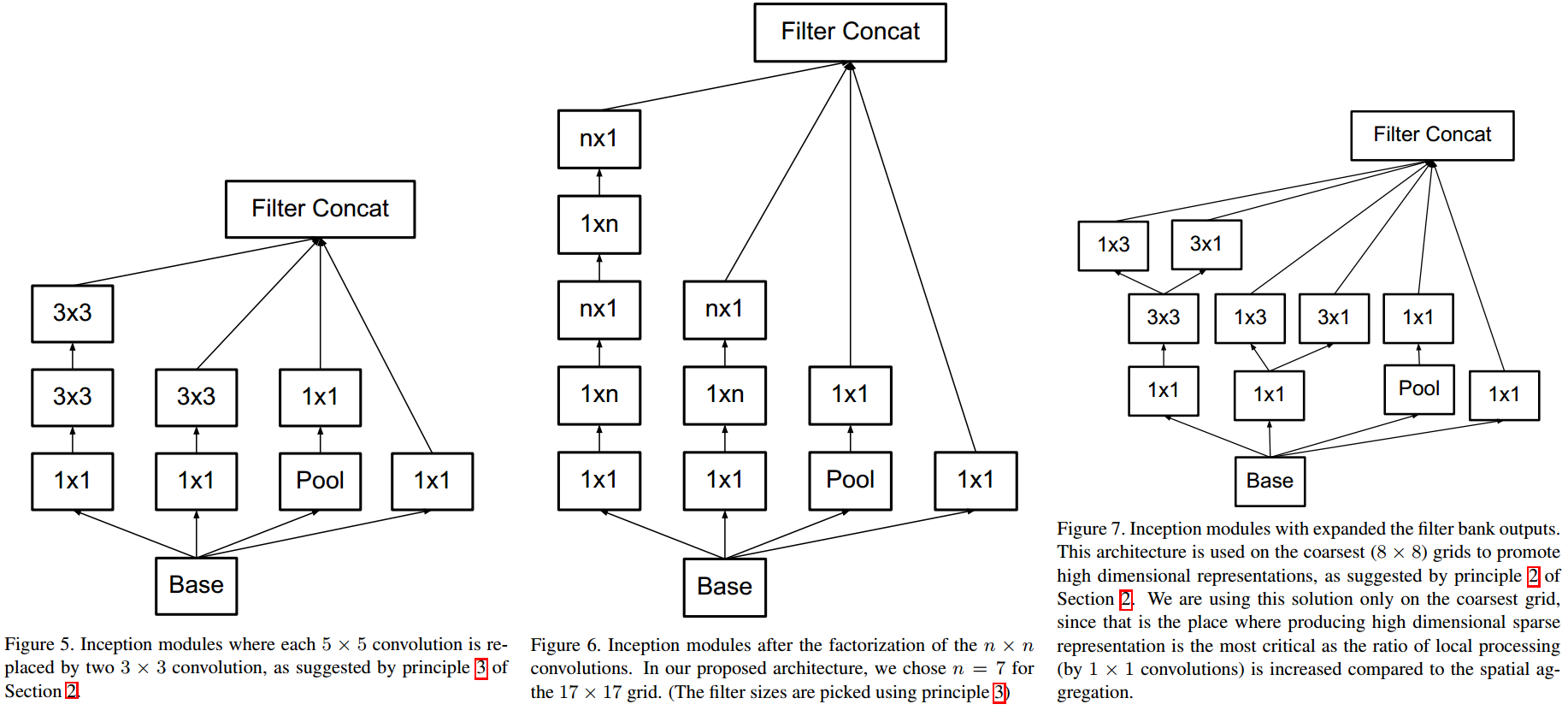

Inception V2和V3与以往最大的不同之处在于3组分别使用了不同结构的Inception Module,分别如下图从左到右所示,

具体地,

- 3x使用的Inception Module与BN-Inception相同,即将\(5\times 5\)拆分成2个堆叠的\(3\times 3\) ;

- 4x使用的Inception Module采用了factorized convolutions ,将2维卷积拆分成2个堆叠的1维卷积,可类比传统计算机视觉中的“行列可分解卷积”,但中间夹了个激活,1维卷积的长度为7;

- 5x使用的Inception Module,1维卷积不再堆叠而是并列,将结果concat;

除此之外,

- 3x和4x之间,4x和5x之间,均不存在衔接的池化层,下采样通过Inception Module中的stride实现

- 取消了浅层的辅助分类器,只保留中层的辅助分类器

- 最开始的几个卷积层调整为多个堆叠的\(3\times 3\) 卷积

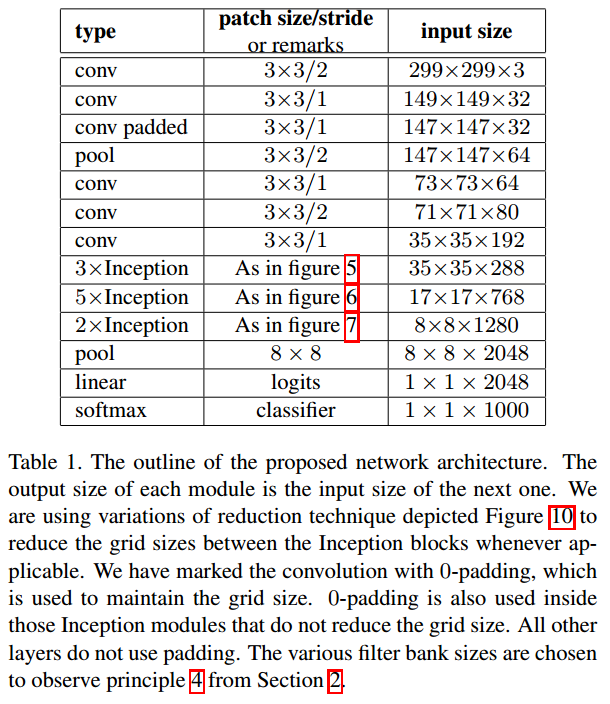

据论文所述,V2的网络结构如下

据论文所述,V3与V2的差异在于,

- RMSProp Optimizer

- Label Smoothing,训练中使用的label为one hot label与均匀分布的加权,可以看成一种正则

- Factorized \(7 \times 7\),即将第一个\(7 \times 7\)卷积层变为堆叠的3个\(3 \times 3\)

- BN-auxiliary,辅助分类器中的全连接层也加入BN

但是,实际发布的Inception V3完全是另外一回事,参见pytorch/inception,有人绘制了V3的网络架构如下——网上少有绘制正确的,下图中亦存在小瑕疵,最后一个下采样Inception Module中\(1\times 1\)的stride为1。

需要注意的是,起下采样作用两个Inception Module并不相同。

有的时候,Inception-V2和BN-Inception是混淆的。从Inception-V3开始,Inception架构变得越来越不像人搞的……

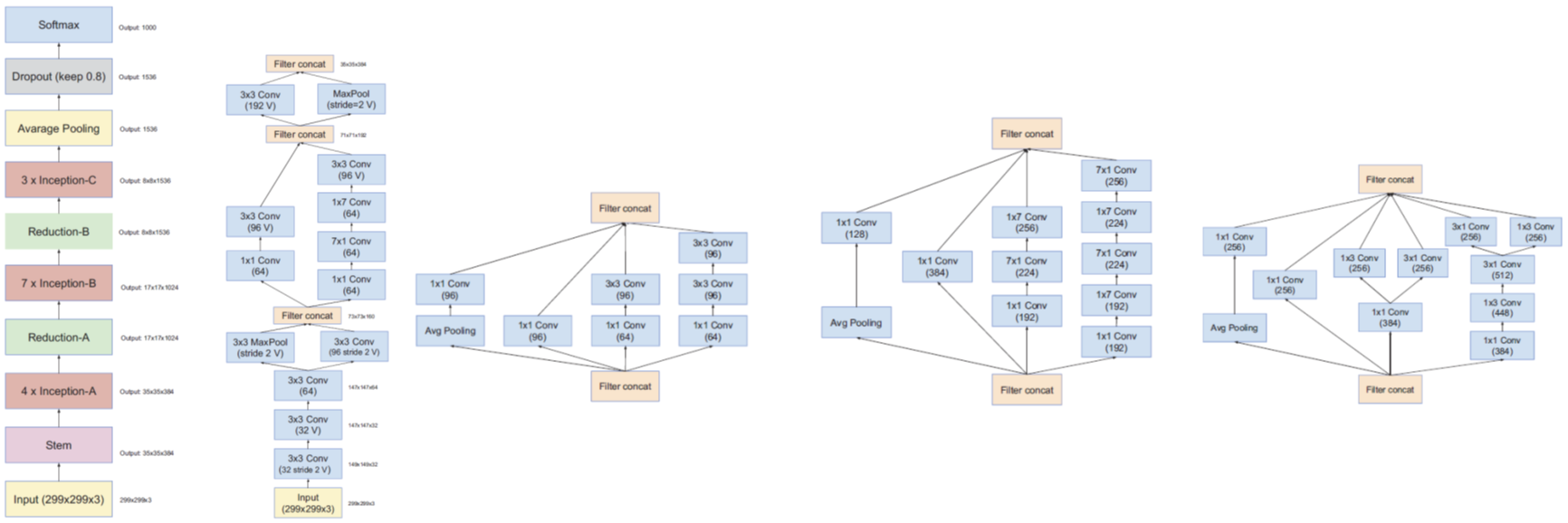

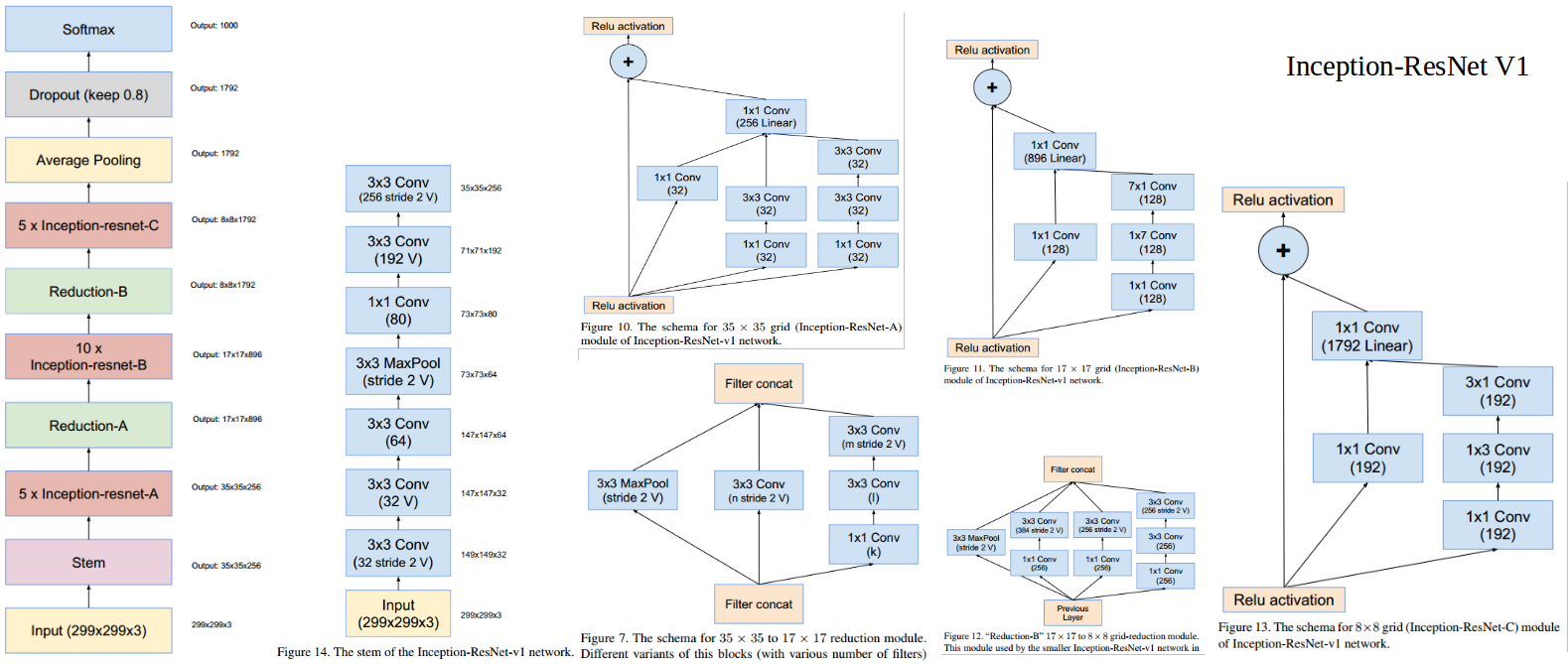

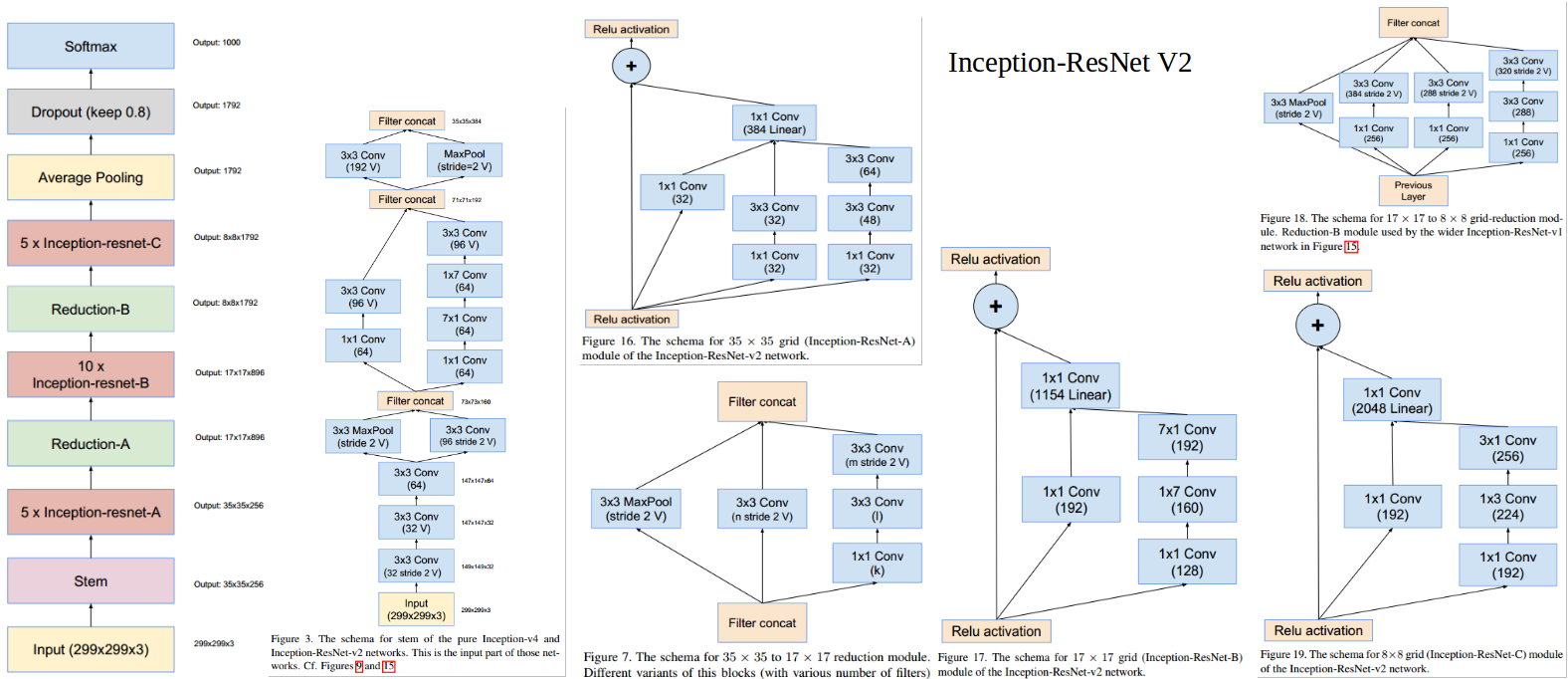

Inception-V4,Inception-ResNet-v1,Inception-ResNet-v2

Inception-V4,Inception-ResNet-v1 和 Inception-ResNet-v2出自同一篇论文Inception-V4, Inception-ResNet and the Impact of Residual Connections on Learning,

Inception-V4相对V3的主要变化在于,前处理使用更复杂的multi-branch stem模块,主体三段式与V3相同。

Inception-ResNet-V1与Inception-ResNet-V2,将Inception与ResNet结合,使用Inception结构来拟合残差部分,两者在A B C部分结构相同,只是后者channel数更多,两者的主要差异在前处理部分,后者采用了更复杂的multi-branch stem结构(与V4相同)。相比纯Inception结构,引入ResNet结构极大加快了网络的收敛速度。

以上。

参考

- GoogLeNet, Inception-V1: Going Deeper with Convolutions

- Batch Normalization, BN-Inception: Accelerating Deep Network Training by Reducing Internal Covariate Shift

- Inception-V2, V3: Rethinking the Inception Architecture for Computer Vision

- [Inception-V4, Inception-ResNet and the Impact of Residual Connections on Learning](

Inception系列理解的更多相关文章

- 网络结构解读之inception系列四:Inception V3

网络结构解读之inception系列四:Inception V3 Inception V3根据前面两篇结构的经验和新设计的结构的实验,总结了一套可借鉴的网络结构设计的原则.理解这些原则的背后隐藏的 ...

- 网络结构解读之inception系列一:Network in Network

网络结构解读之inception系列一:Network in Network 网上有很多的网络结构解读,之前也是看他人博客的介绍,但当自己看论文的时候,发现存在很多的细节和动机解读,而这部分能加深 ...

- Windows 8实例教程系列 - 理解应用框架

原文:Windows 8实例教程系列 - 理解应用框架 Windows 操作系统之所以风靡世界,是因为其“易学易用”,从用户的角度出发,让数以万计的非IT人员使用计算机实现娱乐,工作等目的.Windo ...

- 『高性能模型』卷积复杂度以及Inception系列

转载自知乎:卷积神经网络的复杂度分析 之前的Inception学习博客: 『TensorFlow』读书笔记_Inception_V3_上 『TensorFlow』读书笔记_Inception_V3_下 ...

- ResNets和Inception的理解

ResNets和Inception的理解 ResNet解析

- 网络结构解读之inception系列五:Inception V4

网络结构解读之inception系列五:Inception V4 在残差逐渐当道时,google开始研究inception和残差网络的性能差异以及结合的可能性,并且给出了实验结构. 本文思想阐述不多, ...

- 网络结构解读之inception系列三:BN-Inception(Inception V2)

网络结构解读之inception系列三:BN-Inception(Inception V2) BN的出现大大解决了训练收敛问题.作者主要围绕归一化的操作做了一系列优化思路的阐述,值得细看. Batch ...

- 网络结构解读之inception系列二:GoogLeNet(Inception V1)

网络结构解读之inception系列二:GoogLeNet(Inception V1) inception系列的开山之作,有网络结构设计的初期思考. Going deeper with convolu ...

- Inception系列之Inception_v1

目前,神经网络模型为了得到更好的效果,越来越深和越来越宽的模型被提出.然而这样会带来以下几个问题: 1)参数量,计算量越来越大,在有限内存和算力的设备上,其应用也就越难以落地. 2)对于一些数据集较少 ...

随机推荐

- C++中cin的输入分隔符问题及相关

1.C/C++中的类型转换函数(区分类中的类型转换构造函数): 头文件:C中stdlib.h C++中cstdlib atof(将字符串转换成浮点型数) atoi(将字符串转换成整型数) atol(将 ...

- 7-2 jmu-python-九九乘法表(矩形) (10 分)

本题目要求输出如下图所示的九九乘法表 注:乘积要求做格式控制,占4个位置的宽度 输入样例: 无 输出样例: 1*1=1 1*2=2 1*3=3 1*4=4 1*5=5 1*6=6 1*7=7 1*8= ...

- HTML5 Canvas(基础知识)

最近笔者在学习HTML5的新元素<canvas>,会分享一些基础知识以及小例子,最终使用<canvas>实现一个绘制简单图表(条形图.线图或者饼图)的js库,会更新一到两篇文章 ...

- 【原创】为什么我的 Kafka 总是连接失败呢?

提出问题 近日助友 Docker 部署 Kafka 服务,服务日志启动正常,但客户端却无法连接 往日曾踩过此坑,然方法均源于博客,其语焉不详,不知为何不行,亦不知为何行,印象不甚深刻,耗费大量时间 为 ...

- 必备技能三、render渲染函数

Vue 推荐使用在绝大多数情况下使用 template 来创建你的 HTML.然而在一些场景中,你真的需要 JavaScript 的完全编程的能力,这就是 render 函数,它比 template ...

- seo搜索优化教程09 - seo搜索优化外链优化

为了使大家更方便的了解及学习网络营销推广.seo搜索优化,星辉科技强势推出seo搜索优化教程.此为seo教程第九课 网络营销推广中有句行话,叫做"内容为王,外链为王",可见外链对于 ...

- Python装饰器及内置函数

装饰器 听名字应该知道这是一个装饰的东西,我们今天就来讲解一下装饰器,有的铁子们应该听说,有的没有听说过.没有关系我告诉你们这是一个很神奇的东西 这个有多神奇呢? 我们先来复习一下闭包 def fun ...

- 结题报告--hih0CoderP1041

题目:点此 描述 小Hi和小Ho准备国庆期间去A国旅游.A国的城际交通比较有特色:它共有n座城市(编号1-n):城市之间恰好有n-1条公路相连,形成一个树形公路网.小Hi计划从A国首都(1号城市)出发 ...

- 把读取sql的结果写入到excel文件

1.利用pandas模块 # encoding: utf-8 import time import pandas as pd import pymysql def getrel(sql): ''' 连 ...

- Core + Vue 后台管理基础框架4——前端授权

1.前言 上篇,我们讲了后端的授权.与后端不同,前端主要是通过功能入口如菜单.按钮的显隐来控制授权的.具体来讲,就是根据指定用户的制定权限来加载对应侧边栏菜单和页面内的功能按钮.我们一个个来讲. 2. ...