improve deep learning network 课程笔记

公开课笔记

Bias & variance

bias: 1. more epoch 2. deeper network 3.hyperparameters

variance : larger dataset 2. regularization

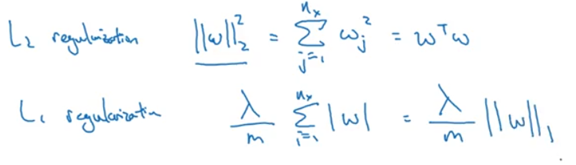

regularization

L2 norm: weight decay

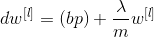

dropout regularization

dropout:在反向传播误差更新权值时候,随机删除一部分hidden units,以防止过拟合。

other methods for variance:

data augmentation:图像有 翻转、裁剪、扭曲、旋转等操作

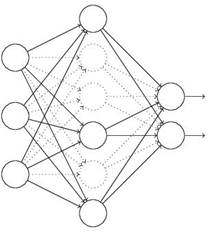

early stopping:

在validation error开始上升时,停止训练

当神经网络还未运行太多迭代过程的时候,w参数接近于0。开始迭代过程,w的值会变得越来越大。early stopping要做的就是在中间点停止迭代过程。这样我们将会得到一个中等大小的w参数,这个结果与得到与L2正则化的结果相似,最终得到w参数较小的神经网络。

梯度消失和梯度爆炸vanishing & exploding

神经网络过深时易产生的现象.

解决方法:1.高斯分布权重初始化 2. relu 3.clip gradient(解决梯度爆炸)

4. shortcut

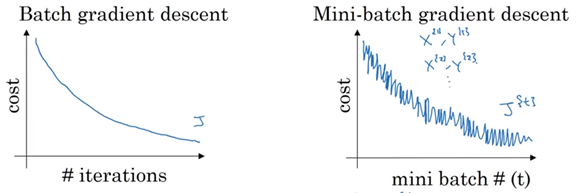

Mini batches

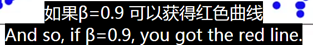

Exponentially weighted average

Bias correction

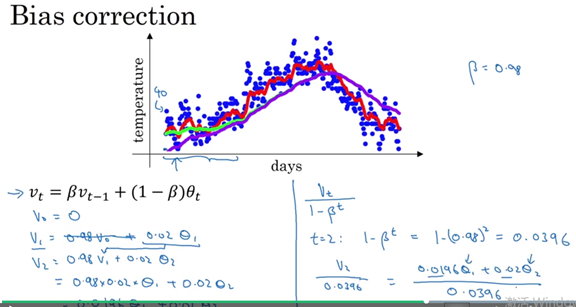

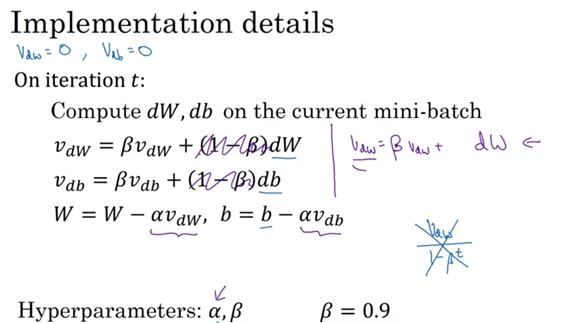

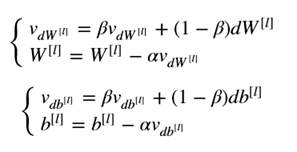

Monumentum

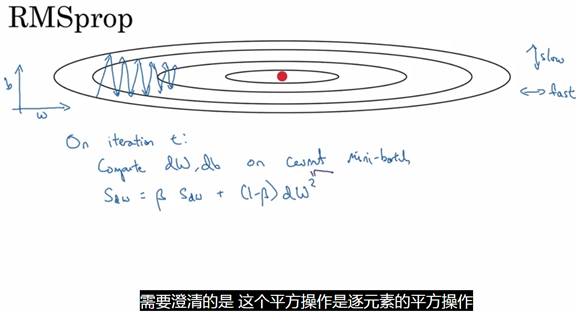

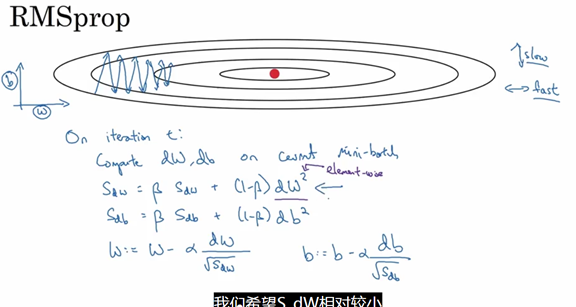

RMSprop

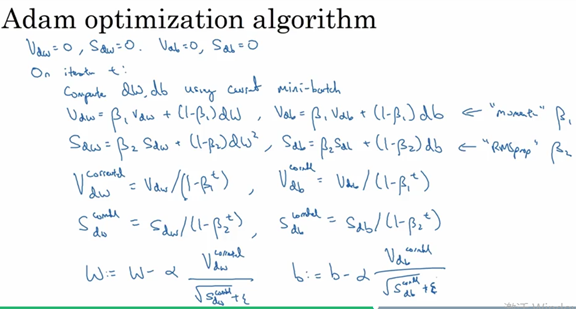

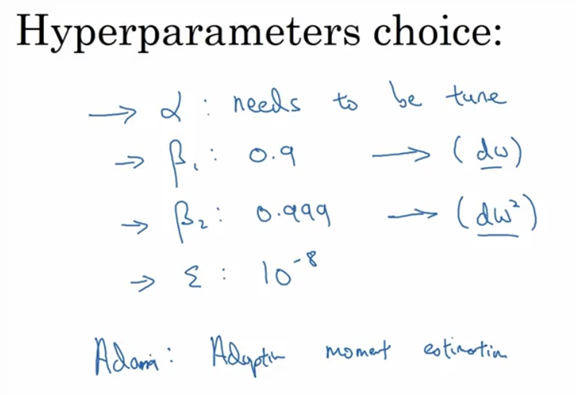

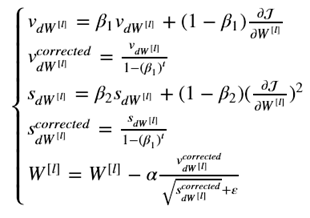

Adam OPTIMIZER

Momentum + RMSprop

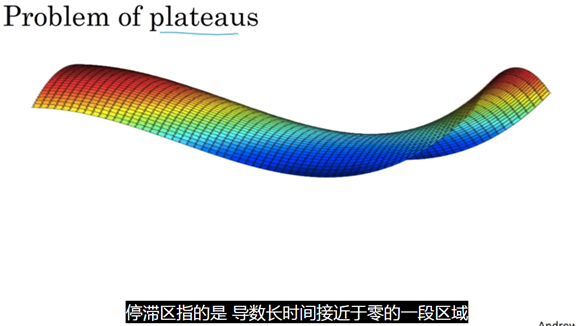

Learning rate decay

解决方法:Adam optimizer等

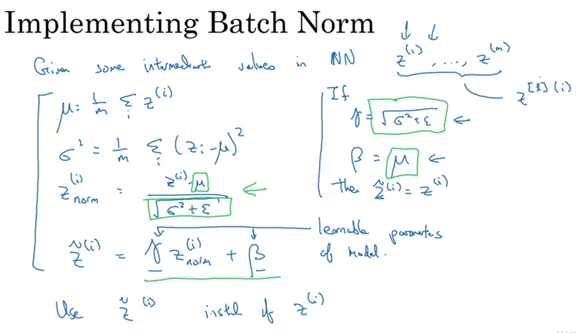

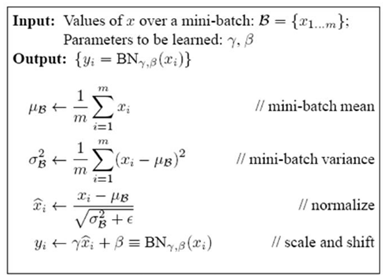

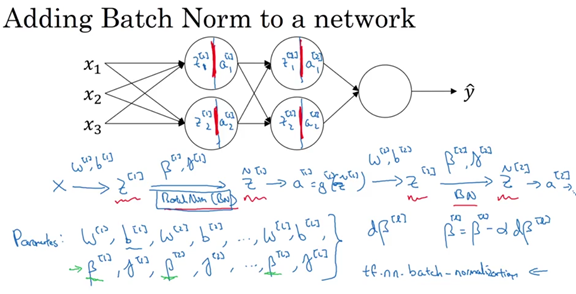

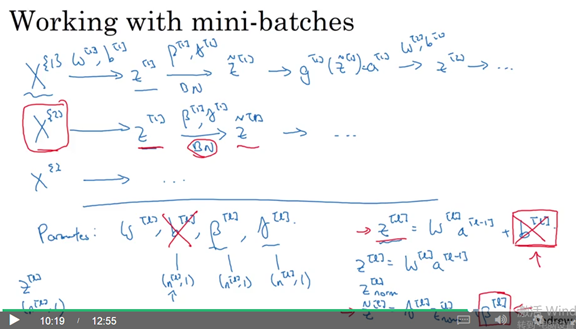

Batch normalize

关于batch normalization 论文解读:https://www.cnblogs.com/guoyaohua/p/8724433.html

IID独立同分布假设,就是假设训练数据和测试数据是满足相同分布的,这是通过训练数据获得的模型能够在测试集获得好的效果的一个基本保障。那BatchNorm的作用是什么呢?BatchNorm就是在深度神经网络训练过程中使得每一层神经网络的输入保持相同分布的。

Scale and shift:

经过变换后网络表达能力下降,为了防止这一点,每个神经元增加两个调节参数(scale和shift),这两个参数通过训练来学习,用于对变换后的激活反变换,使得网络表达能力增强。

在我们训练的过程中,对于训练集的Mini-batch,使用指数加权平均,当训练结束的时候,得到指数加权平均后的均值和方差,而这些值直接用于Batch Norm公式的计算,用以对测试样本进行预测。

improve deep learning network 课程笔记的更多相关文章

- 《Neural Networks and Deep Learning》课程笔记

Lesson 1 Neural Network and Deep Learning 这篇文章其实是 Coursera 上吴恩达老师的深度学习专业课程的第一门课程的课程笔记. 参考了其他人的笔记继续归纳 ...

- 【Deep Learning Nanodegree Foundation笔记】第 1 课:INTRODUCTION Welcome

Welcome to the Deep Learning Nanodegree Foundations Program! In this lesson, you'll meet your instru ...

- How To Improve Deep Learning Performance

如何提高深度学习性能 20 Tips, Tricks and Techniques That You Can Use ToFight Overfitting and Get Better Genera ...

- Deep Learning.ai学习笔记_第一门课_神经网络和深度学习

目录 前言 第一周(深度学习引言) 第二周(神经网络的编程基础) 第三周(浅层神经网络) 第四周(深层神经网络) 前言 目标: 掌握神经网络的基本概念, 学习如何建立神经网络(包含一个深度神经网络), ...

- 【Deep Learning Nanodegree Foundation笔记】第 10 课:Sentiment Analysis with Andrew Trask

In this lesson, Andrew Trask, the author of Grokking Deep Learning, will walk you through using neur ...

- 【Deep Learning Nanodegree Foundation笔记】第 0 课:课程计划

第一周 机器学习的类型,以及何时使用机器学习 我们将首先简单介绍线性回归和机器学习.这将让你熟悉这些领域的常用术语,你需要了解的技术进展,并了解深度学习在更大的机器学习背景中的位置. 直播:线性回归 ...

- 吴恩达《深度学习》-第一门课 (Neural Networks and Deep Learning)-第四周:深层神经网络(Deep Neural Networks)-课程笔记

第四周:深层神经网络(Deep Neural Networks) 4.1 深层神经网络(Deep L-layer neural network) 有一些函数,只有非常深的神经网络能学会,而更浅的模型则 ...

- 【Deep Learning Nanodegree Foundation笔记】第 7 课:NEURAL NETWORKS Intro to Neural Networks

In this lesson, you'll dive deeper into the intuition behind Logistic Regression and Neural Networks ...

- Deep Learning.ai学习笔记_第五门课_序列模型

目录 第一周 循环序列模型 第二周 自然语言处理与词嵌入 第三周 序列模型和注意力机制 第一周 循环序列模型 在进行语音识别时,给定一个输入音频片段X,并要求输出对应的文字记录Y,这个例子中输入和输出 ...

随机推荐

- 运用Unity实现AOP拦截器[结合异常记录实例]

本篇文章将通过Unity实现Aop异常记录功能:有关Unity依赖注入可以看前两篇文章: 1:运用Unity实现依赖注入[结合简单三层实例] 2:运用Unity实现依赖注入[有参构造注入] 另早期 ...

- margin外边距问题

1 .上下边距会叠加 !DOCTYPE html> <html> <head> <m<etacharset="UTF-8"> < ...

- nodejs入门篇---创建project并具体解释

想了非常久.总想写点对大家有优点的,今天解说生成项目. 如今市面上一般须要人全栈-----mean(mongo,express.angular,nodejs),这样能够从前端开发到后端以及数据库,听起 ...

- IBATIS+ORACLE(一)

迁移时间:2017年6月1日15:55:17 Author:Marydon (四)IBATIS + ORACLE 第一部分:基础篇 1.4.1.1 分页SQL <!-- 开头 --> ...

- Linux命令-网络命令:traceroute

首先需要设置VM里面的linux系统能够上网.菜单项->虚拟机->设置,选择NAT模式 菜单项->编辑->虚拟网络编辑器->VMnet8 NAT模式->NAT设置, ...

- 关于数组中加入相同的view的试验

随便新建一个工程,然后在控制器中粘贴如下代码 - (void)viewDidLoad { [super viewDidLoad]; UIView * view = [[UIView alloc]ini ...

- 纯div+css制作的弹出菜单

<!DOCTYPE html PUBLIC "-//W3C//DTD XHTML 1.0 Transitional//EN" "http://www.w3.org/ ...

- shared-service.ts

shared-service.ts import { Observable } from 'rxjs/Observable'; import { Injectable } from '@angular ...

- maven添加额外archetype

用Eclipse + m2e 插件新建maven项目时发现archetype太少了,网上搜索如何添加额外的archetype. http://maven.apache.org/archetype/ma ...

- C# ZPL II 命令打印标签

public class BarPrinter { public static byte[] ZPLPrinter(string p_title = "", string p_sp ...