KNN算法--python实现

邻近算法

或者说K最近邻(kNN,k-NearestNeighbor)分类算法是数据挖掘分类技术中最简单的方法之一。所谓K最近邻,就是k个最近的邻居的意思,说的是每个样本都可以用它最接近的k个邻居来代表。

关于K最近邻算法,非常好的一篇文章:KNN算法理解; 另外一篇文章也值得参考:KNN最近邻Python实现

行业应用: 客户流失预测、欺诈侦测等(更适合于稀有事件的分类问题)

写在前面的:Python2.7

数据iris: http://pan.baidu.com/s/1bHuQ0A 测试数据集: iris的第1行数据; 训练数据: iris的2到150行数据

#coding:utf-8

import pandas as pd

import numpy as np class KNNa(object): #获取训练数据集

def getTrainData(self):

dataSet = pd.read_csv('C:\pythonwork\practice_data\iris.csv', header=None)

dataSetNP = np.array(dataSet[1:150])

trainData = dataSetNP[:,0:dataSetNP.shape[1]-1] #获得训练数据

labels = dataSetNP[:,dataSetNP.shape[1]-1] #获得训练数据类别

return trainData,labels

#得到测试数据的类别

def classify(self, testData, trainData, labels, k):

#计算测试数据与训练数据之间的欧式距离

dist = []

for i in range(len(trainData)):

td = trainData[i,:] #训练数据

dist.append(np.linalg.norm(testData - td)) #欧式距离

dist_collection = np.array(dist) #获得所有的欧氏距离,并转换为array类型

dist_index = dist_collection.argsort()[0:k] #按升序排列,获得前k个下标

k_labels = labels[dist_index] #获得对应下标的类别 #计算k个数据中,类别的数目

k_labels = list(k_labels) #转换为list类型

labels_count = {}

for i in k_labels:

labels_count[i] = k_labels.count(i) #计算每个类别出现的次数

testData_label = max(labels_count, key=labels_count.get) #次数出现最多的类别

return testData_label if __name__ == '__main__':

kn = KNNa()

trainData,labels = kn.getTrainData() #获得训练数据集,iris从第2行到第150行的149条数据

testData = np.array([5.1, 3.5, 1.4, 0.2]) #取iris中的数据的第1行

k = 10 #最近邻数据数目

testData_label = kn.classify(testData,trainData,labels,k) #获得测试数据的分类类别

print '测试数据的类别:',testData_label

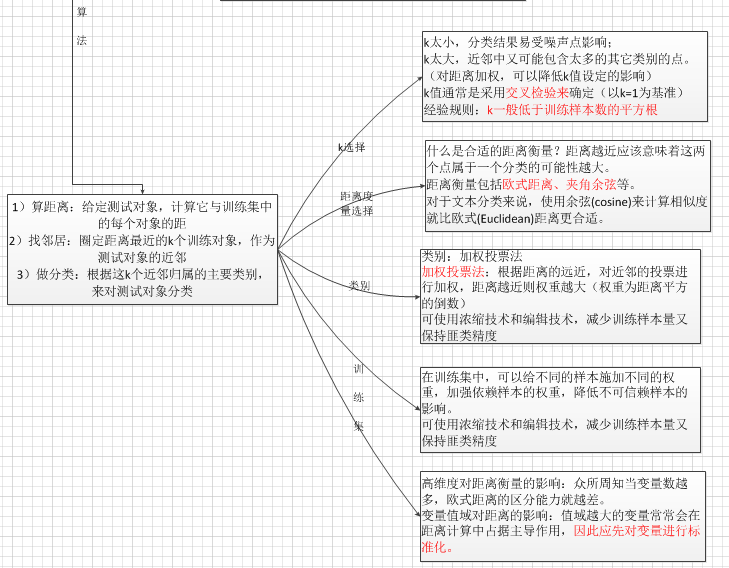

理论:

KNN算法--python实现的更多相关文章

- kNN算法python实现和简单数字识别

kNN算法 算法优缺点: 优点:精度高.对异常值不敏感.无输入数据假定 缺点:时间复杂度和空间复杂度都很高 适用数据范围:数值型和标称型 算法的思路: KNN算法(全称K最近邻算法),算法的思想很简单 ...

- KNN算法python实现

1 KNN 算法 knn,k-NearestNeighbor,即寻找与点最近的k个点. 2 KNN numpy实现 效果: k=1 k=2 3 numpy 广播,聚合操作. 这里求距离函数,求某点和集 ...

- KNN算法——python实现

二.Python实现 对于机器学习而已,Python需要额外安装三件宝,分别是Numpy,scipy和Matplotlib.前两者用于数值计算,后者用于画图.安装很简单,直接到各自的官网下载回来安装即 ...

- KNN算法python实现小样例

K近邻算法概述优点:精度高.对异常数据不敏感.无数据输入假定缺点:计算复杂度高.空间复杂度高适用数据范围:数值型和标称型工作原理:存在一个样本数据集合,也称作训练样本集,并且样本集中每个数据都存在标签 ...

- 机器学习——KNN算法(k近邻算法)

一 KNN算法 1. KNN算法简介 KNN(K-Nearest Neighbor)工作原理:存在一个样本数据集合,也称为训练样本集,并且样本集中每个数据都存在标签,即我们知道样本集中每一数据与所属分 ...

- 机器学习之KNN算法

1 KNN算法 1.1 KNN算法简介 KNN(K-Nearest Neighbor)工作原理:存在一个样本数据集合,也称为训练样本集,并且样本集中每个数据都存在标签,即我们知道样本集中每一数据与所属 ...

- [Python] 应用kNN算法预测豆瓣电影用户的性别

应用kNN算法预测豆瓣电影用户的性别 摘要 本文认为不同性别的人偏好的电影类型会有所不同,因此进行了此实验.利用较为活跃的274位豆瓣用户最近观看的100部电影,对其类型进行统计,以得到的37种电影类 ...

- k-近邻(KNN)算法改进约会网站的配对效果[Python]

使用Python实现k-近邻算法的一般流程为: 1.收集数据:提供文本文件 2.准备数据:使用Python解析文本文件,预处理 3.分析数据:可视化处理 4.训练算法:此步骤不适用与k——近邻算法 5 ...

- kNN算法基本原理与Python代码实践

kNN是一种常见的监督学习方法.工作机制简单:给定测试样本,基于某种距离度量找出训练集中与其最靠近的k各训练样本,然后基于这k个“邻居”的信息来进行预测,通常,在分类任务中可使用“投票法”,即选择这k ...

随机推荐

- Python之数据加密与解密及相关操作(hashlib模块、hmac模块、random模块、base64模块、pycrypto模块)

本文内容 数据加密概述 Python中实现数据加密的模块简介 hashlib与hmac模块介绍 random与secrets模块介绍 base64模块介绍 pycrypto模块介绍 总结 参考文档 提 ...

- Python进阶-继承中的MRO与super

Python进阶-继承中的MRO与super 写在前面 如非特别说明,下文均基于Python3 摘要 本文讲述Python继承关系中如何通过super()调用"父类"方法,supe ...

- AJAX请求小项目

<!DOCTYPE html> <html lang="en"> <head> <meta charset="UTF-8&quo ...

- Example018主页加载时获取焦点

<!DOCTYPE html> <html lang="en"> <head> <meta charset="UTF-8&quo ...

- 巧用五招提升Discuz!X运行速度

Discuz!X使用的是数据库应用程序,所以,当数据库的大小.帖子的数目.会员的数目,这些因素都会影响到程序的检索速度,尤其是当论坛的影响力大了,这个问题就更为突出了,虽然,康盛对Discuz进行了更 ...

- I/O多路复用之epoll实战

概念 IO多路复用是指内核一旦发现进程指定的一个或者多个IO条件准备读取,它就通知该进程 通俗理解(摘自网上一大神) 这些名词比较绕口,理解涵义就好.一个epoll场景:一个酒吧服务员(一个线程),前 ...

- Linux系统安全配置基线

一:共享账号检查 配置名称:用户账号分配检查,避免共享账号存在 配置要求:1.系统需按照实际用户分配账号: 2.避免不同用户间共享账号,避免用户账号和服务器间通信使用的账号共享. 操作指南:参考配置操 ...

- Web开发资料

慢慢更新 1. Quackit 墙裂推荐!提供了一系列教程,bootstrap的模板也很好用. 2. Bootstrap 4 Cheat Sheet 好用,比官网更加一目了染.  3.Chart. ...

- 网络流入门—用于最大流的Dinic算法

"网络流博大精深"-sideman语 一个基本的网络流问题 最早知道网络流的内容便是最大流问题,最大流问题很好理解: 解释一定要通俗! 如右图所示,有一个管道系统,节点{1,2,3 ...

- Java 容器在实际项目开发中应用

前言:在java开发中我们离不开集合数组等,在java中有个专有名词:"容器" ,下面会结合Thinking in Java的知识和实际开发中业务场景讲述一下容器在Web项目中的用 ...