RDD java API使用

1.RDD介绍:

JavaRDD<String> lines=sc.textFile(inputFile);

(2)分发对象集合,这里以list为例

List<String> list=new ArrayList<String>();

list.add("a");

list.add("b");

list.add("c");

JavaRDD<String> temp=sc.parallelize(list);

//上述方式等价于

JavaRDD<String> temp2=sc.parallelize(Arrays.asList("a","b","c"));

List<String> list=new ArrayList<String>();

//建立列表,列表中包含以下自定义表项

list.add("error:a");

list.add("error:b");

list.add("error:c");

list.add("warning:d");

list.add("hadppy ending!");

//将列表转换为RDD对象

JavaRDD<String> lines = sc.parallelize(list);

//将RDD对象lines中有error的表项过滤出来,放在RDD对象errorLines中

JavaRDD<String> errorLines = lines.filter(

new Function<String, Boolean>() {

public Boolean call(String v1) throws Exception {

return v1.contains("error");

}

}

);

//遍历过滤出来的列表项

List<String> errorList = errorLines.collect();

for (String line : errorList)

System.out.println(line);

union

/**

* Take the first num elements of the RDD. This currently scans the partitions *one by one*, so

* it will be slow if a lot of partitions are required. In that case, use collect() to get the

* whole RDD instead.

*/

def take(num: Int): JList[T]

程序示例:接上

JavaRDD<String> unionLines=errorLines.union(warningLines); for(String line :unionLines.take(2))

System.out.println(line);

输出:

List<String> unions=unionLines.collect();

for(String line :unions)

System.out.println(line);

遍历输出RDD数据集unions的每一项

|

函数名

|

实现的方法

|

用途

|

|

Function<T,R>

|

R call(T)

|

接收一个输入值并返回一个输出值,用于类似map()和filter()的操作中 |

| Function<T1,T2,R> |

R call(T1,T2)

|

接收两个输入值并返回一个输出值,用于类似aggregate()和fold()等操作中

|

| FlatMapFunction<T,R> |

Iterable <R> call(T)

|

接收一个输入值并返回任意个输出,用于类似flatMap()这样的操作中

|

JavaRDD<String> errorLines=lines.filter(

new Function<String, Boolean>() {

public Boolean call(String v1)throws Exception {

return v1.contains("error");

}

}

);

List<String> strLine=new ArrayList<String>();

strLine.add("how are you");

strLine.add("I am ok");

strLine.add("do you love me")

JavaRDD<String> input=sc.parallelize(strLine);

JavaRDD<String> words=input.flatMap(

new FlatMapFunction<String, String>() {

public Iterable<String> call(String s) throws Exception {

return Arrays.asList(s.split(" "));

}

}

);

List<String> strLine=new ArrayList<String>();

strLine.add("how are you");

strLine.add("I am ok");

strLine.add("do you love me");

JavaRDD<String> input=sc.parallelize(strLine);

JavaRDD<String> words=input.flatMap(

new FlatMapFunction<String, String>() {

public Iterable<String> call(String s) throws Exception {

return Arrays.asList(s.split(" "));

}

}

);

JavaPairRDD<String,Integer> counts=words.mapToPair(

new PairFunction<String, String, Integer>() {

public Tuple2<String, Integer> call(String s) throws Exception {

return new Tuple2(s, 1);

}

}

);

JavaPairRDD <String,Integer> results=counts.reduceByKey(

new org.apache.spark.api.java.function.Function2<Integer, Integer, Integer>() {

public Integer call(Integer v1, Integer v2) throws Exception {

return v1 + v2;

}

}

) ;

class ContainError implements Function<String,Boolean>{

public Boolean call(String v1) throws Exception {

return v1.contains("error");

}

}

JavaRDD<String> errorLines=lines.filter(new ContainError());

for(String line :errorLines.collect())

System.out.println(line);

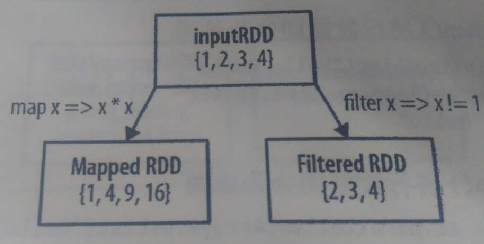

JavaRDD<Integer> rdd =sc.parallelize(Arrays.asList(1,2,3,4));

JavaRDD<Integer> result=rdd.map(

new Function<Integer, Integer>() {

public Integer call(Integer v1) throwsException {

return v1*v1;

}

}

);

System.out.println( StringUtils.join(result.collect(),","));

输出:

JavaRDD<Integer> rdd =sc.parallelize(Arrays.asList(1,2,3,4));

JavaRDD<Integer> results=rdd.filter(

new Function<Integer, Boolean>() {

public Boolean call(Integer v1) throws Exception {

return v1!=1;

}

}

);

System.out.println(StringUtils.join(results.collect(),","));

结果:

JavaRDD<String> rdd =sc.parallelize(Arrays.asList("hello world","hello you","world i love you"));

JavaRDD<String> words=rdd.flatMap(

new FlatMapFunction<String, String>() {

public Iterable<String> call(String s) throws Exception {

return Arrays.asList(s.split(" "));

}

}

);

System.out.println(StringUtils.join(words.collect(),'\n'));

输出:

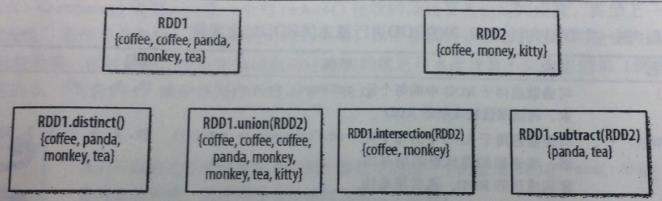

|

函数

|

用途

|

|

RDD1.distinct()

|

生成一个只包含不同元素的新RDD。需要数据混洗。 |

|

RDD1.union(RDD2)

|

返回一个包含两个RDD中所有元素的RDD |

|

RDD1.intersection(RDD2)

|

只返回两个RDD中都有的元素 |

|

RDD1.substr(RDD2)

|

返回一个只存在于第一个RDD而不存在于第二个RDD中的所有元素组成的RDD。需要数据混洗。 |

|

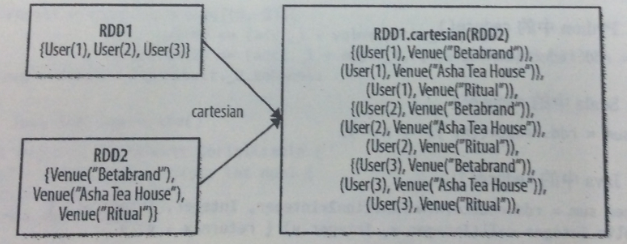

RDD1.cartesian(RDD2)

|

返回两个RDD数据集的笛卡尔集 |

JavaRDD<Integer> rdd1 = sc.parallelize(Arrays.asList(1,2));

JavaRDD<Integer> rdd2 = sc.parallelize(Arrays.asList(1,2));

JavaPairRDD<Integer ,Integer> rdd=rdd1.cartesian(rdd2);

for(Tuple2<Integer,Integer> tuple:rdd.collect())

System.out.println(tuple._1()+"->"+tuple._2());

输出:

JavaRDD<Integer> rdd = sc.parallelize(Arrays.asList(1,2,3,4,5,6,7,8,9,10));

Integer sum =rdd.reduce(

new Function2<Integer, Integer, Integer>() {

public Integercall(Integer v1, Integer v2) throws Exception {

return v1+v2;

}

}

);

System.out.println(sum.intValue());

输出:55

JavaRDD<Integer> rdd = sc.parallelize(Arrays.asList(1,2,3,4,5,6,7,8,9,10));

Integer sum =rdd.fold(0,

new Function2<Integer, Integer, Integer>() {

public Integer call(Integer v1, Integer v2) throws Exception {

return v1+v2;

}

}

);

System.out.println(sum);

②计算RDD数据集中所有元素的积:

JavaRDD<Integer> rdd = sc.parallelize(Arrays.asList(1,2,3,4,5,6,7,8,9,10));

Integer result =rdd.fold(1,

new Function2<Integer, Integer, Integer>() {

public Integer call(Integer v1, Integer v2) throws Exception {

return v1*v2;

}

}

);

System.out.println(result);

(3)aggregate()操作

public class AvgCount implements Serializable{

public int total;

public int num;

public AvgCount(int total,int num){

this.total=total;

this.num=num;

}

public double avg(){

return total/(double)num;

}

static Function2<AvgCount,Integer,AvgCount> addAndCount=

new Function2<AvgCount, Integer, AvgCount>() {

public AvgCount call(AvgCount a, Integer x) throws Exception {

a.total+=x;

a.num+=1;

return a;

}

};

static Function2<AvgCount,AvgCount,AvgCount> combine=

new Function2<AvgCount, AvgCount, AvgCount>() {

public AvgCount call(AvgCount a, AvgCount b) throws Exception {

a.total+=b.total;

a.num+=b.num;

return a;

}

};

public static void main(String args[]){

SparkConf conf = new SparkConf().setMaster("local").setAppName("my app");

JavaSparkContext sc = new JavaSparkContext(conf);

AvgCount intial =new AvgCount(0,0);

JavaRDD<Integer> rdd =sc.parallelize(Arrays.asList(1, 2, 3, 4, 5, 6));

AvgCount result=rdd.aggregate(intial,addAndCount,combine);

System.out.println(result.avg());

}

}

这个程序示例可以实现求出RDD对象集的平均数的功能。其中addAndCount将RDD对象集中的元素合并起来放入AvgCount对象之中,combine提供两个AvgCount对象的合并的实现。我们初始化AvgCount(0,0),表示有0个对象,对象的和为0,最终返回的result对象中total中储存了所有元素的和,num储存了元素的个数,这样调用result对象的函数avg()就能够返回最终所需的平均数,即avg=tatal/(double)num。

| 级别 |

使用的空间

|

cpu时间

|

是否在内存

|

是否在磁盘

|

备注

|

|

MEMORY_ONLY

|

高 |

低

|

是

|

否

|

直接储存在内存 |

| MEMORY_ONLY_SER |

低

|

高

|

是

|

否

|

序列化后储存在内存里

|

|

MEMORY_AND_DISK

|

低 |

中等

|

部分

|

部分

|

如果数据在内存中放不下,溢写在磁盘上 |

|

MEMORY_AND_DISK_SER

|

低 |

高

|

部分

|

部分

|

数据在内存中放不下,溢写在磁盘中。内存中存放序列化的数据。 |

|

DISK_ONLY

|

低

|

高

|

否

|

是

|

直接储存在硬盘里面

|

JavaRDD<Integer> rdd =sc.parallelize(Arrays.asList(1,2,3,4,5));

rdd.persist(StorageLevel.MEMORY_ONLY());

System.out.println(rdd.count());

System.out.println(StringUtils.join(rdd.collect(),','));

RDD还有unpersist()方法,调用该方法可以手动把持久化的RDD从缓存中移除。

JavaRDD<Integer> rdd =sc.parallelize(Arrays.asList(1,2,3,4,5));

JavaDoubleRDD result=rdd.mapToDouble(

new DoubleFunction<Integer>() {

public double call(Integer integer) throws Exception {

return (double) integer*integer;

}

}

);

System.out.println(result.max());

RDD java API使用的更多相关文章

- Spark基础与Java Api介绍

原创文章,转载请注明: 转载自http://www.cnblogs.com/tovin/p/3832405.html 一.Spark简介 1.什么是Spark 发源于AMPLab实验室的分布式内存计 ...

- Spark:java api实现word count统计

方案一:使用reduceByKey 数据word.txt 张三 李四 王五 李四 王五 李四 王五 李四 王五 王五 李四 李四 李四 李四 李四 代码: import org.apache.spar ...

- 降维-基于RDD的API

降维-基于RDD的API Singular value decomposition (SVD) Performance SVD Example Principal component analysis ...

- Spark笔记:复杂RDD的API的理解(上)

本篇接着讲解RDD的API,讲解那些不是很容易理解的API,同时本篇文章还将展示如何将外部的函数引入到RDD的API里使用,最后通过对RDD的API深入学习,我们还讲讲一些和RDD开发相关的scala ...

- Atitit 图像处理 调用opencv 通过java api attilax总结

Atitit 图像处理 调用opencv 通过java api attilax总结 1.1. Opencv java api的支持 opencv2.4.2 就有了对java api的支持1 1. ...

- 【分布式】Zookeeper使用--Java API

一.前言 上一篇博客我们通过命令行来操作Zookeper的客户端和服务端并进行相应的操作,这篇主要介绍如何通过API(JAVA)来操作Zookeeper. 二.开发环境配置 首先打开Zookeeper ...

- Elasticsearch的CRUD:REST与Java API

CRUD(Create, Retrieve, Update, Delete)是数据库系统的四种基本操作,分别表示创建.查询.更改.删除,俗称"增删改查".Elasticsearch ...

- [转]HDFS中JAVA API的使用

HDFS是一个分布式文件系统,既然是文件系统,就可以对其文件进行操作,比如说新建文件.删除文件.读取文件内容等操作.下面记录一下使用JAVA API对HDFS中的文件进行操作的过程. 对分HDFS中的 ...

- HDFS中JAVA API的使用

HDFS中JAVA API的使用 HDFS是一个分布式文件系统,既然是文件系统,就可以对其文件进行操作,比如说新建文件.删除文件.读取文件内容等操作.下面记录一下使用JAVA API对HDFS中的 ...

随机推荐

- 戴尔 R730 服务器装 server 2016。

服务器里面原装系统是 centos 7 ,服务器快递过来时 我没用root账号,(主要是主管忘了这台服务器用户名密码了). 需要用的系统是 server 2016 我这边就按正常的装机流程装机. 1, ...

- Crossover 19(Mac运行Windows应用程序)

怎样才能在Mac上运行Windows应用程序?相信这是很多朋友都在问的问题,今天macdown(mac软件平台)小编为大家带来Crossover 19 Mac版下载,Crossover 19 mac版 ...

- Luogu P1290 欧几里得的游戏/UVA10368 Euclid's Game

Luogu P1290 欧几里得的游戏/UVA10368 Euclid's Game 对于博弈论的题目没接触过多少,而这道又是比较经典的SG博弈,所以就只能自己来推关系-- 假设我们有两个数$m,n$ ...

- 小知识——c++关于指针的理解

参考文章: 简介: 指针可以简化c++编程,在一些任务中没有指针是无法完成的(动态内存分配) 使用 & 可以获得变量在内存中的地址: eg: #include <iostream> ...

- 01-Spring概述

1.spring是什么 Spring是分层的Java SE/EE应用 full-stack轻量级开源框架,以IoC(Inverse Of Control:反转控制)和AOP(Aspect Orient ...

- 【xsy1103】随机数表(RanMat)矩阵快速幂

题目大意:你生成了一个随机数表,生成机制是这样子的: $a[i]=A1a[i-1]+A2(2≤i≤m)$ $b[i]=B1b[i-1]+B2(2≤i≤m)$ $M[1][y]=a[y]%P,(1≤y≤ ...

- TDOA 基础之 双曲线

TDOA 的算法基础就是时间差,根据时间差换算出距离差,后面的数学理论知识就是双曲线交点问题. 双曲线方程是2次方程,解算曲线交点也就是两个2次方程求解. 首先看双曲线定义(百度百科): 双曲线(Hy ...

- 微信公众号开发--微信JS-SDK分享到朋友圈和分享给朋友

之前写过一篇使用微信JS-SDK来实现扫一扫功能的博客 微信公众号开发–微信JS-SDK扫一扫功能 在该博客里介绍了微信JS-SDK的基本用法,其中包括以下几个步骤 还详细介绍了通过config接口注 ...

- Hadoop集群分布搭建

一.准备工作 1.最少三台虚拟机或者实体机(官网上是默认是3台),我这边是3台 s1: 10.211.55.18 s2: 10.211.55.19 s3: 10.211.55.20 2.安装JDK 3 ...

- spark的广播变量

直接上代码:包含了,map,filter,persist,mapPartitions等函数 String master = "spark://192.168.2.279:7077" ...