Spark Streaming处理Flume数据练习

把Flume Source(netcat类型),从终端上不断给Flume

Source发送消息,Flume把消息汇集到Sink(avro类型),由Sink把消息推送给Spark Streaming并处理后输出

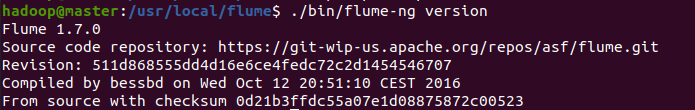

版本信息:spark2.4.0 Flume 1.7.0

(基于pyspark)

一、Flume安装

①、文件导入

# 将apache-flume-1.7.0-bin.tar.gz解压到/usr/local目录下

sudo tar -zxvf apache-flume-1.7.0-bin.tar.gz -C /usr/local

#将解压的文件修改名字为flume,简化操作

sudo mv ./apache-flume-1.7.0-bin ./flume

#把/usr/local/flume目录的权限赋予当前登录Linux系统的用户,这里假设是hadoop用户

sudo chown -R hadoop:hadoop ./flume

②、变量配置

#配置环境变量

sudo vim ~/.bashrc

#加入下面路径

export FLUME_HOME=/usr/local/flume

export FLUME_CONF_DIR=$FLUME_HOME/conf

export PATH=$PATH:$FLUME_HOME/bin

③、flume-env.sh 配置文件修改

cd /usr/local/flume/conf

sudo cp ./flume-env.sh.template ./flume-env.sh

sudo vim ./flume-env.sh

#加入java路径,根据各自路径配置

export JAVA_HOME=/usr/lib/jvm/java-8-openjdk-amd64;

④、查看Flume版本

cd /usr/local/flume

./bin/flume-ng version

二、Avro中anent配置文件建立

cd /usr/local/flume/conf2.sudo

vim ./flume-to-spark.conf

新建文件flume-to-spark.conf

# Name the components on this agent

a1.sources = r1

a1.sinks = k1

a1.channels = c1

#receive message from port 33333

# Describe/configure the source

a1.sources.r1.type = netcat

a1.sources.r1.bind = localhost

a1.sources.r1.port = 33333

#send message through port 44444

a1.sinks.k1.type = avro

a1.sinks.k1.hostname = localhost

a1.sinks.k1.port = 44444

# Use a channel which buffers events in memory

a1.channels.c1.type = memory

a1.channels.c1.capacity = 1000000

a1.channels.c1.transactionCapacity = 1000000

# Bind the source and sink to the channel

a1.sources.r1.channels = c1

a1.sinks.k1.channel = c1

1.Flume suorce类为netcat,绑定到localhost的33333端口, 消息可以通过telnet localhost 33333 发送到flume suorce

2.Flume Sink类为avro,绑定44444端口,flume sink通过 localhost 44444端口把消息发送出来。而spark streaming程序一直监听44444端口。

三、spark配置

①、下载spark-streaming-kafka-0-8_2.11-2.4.0.jar

2.11对应scala,2.4.0对应spark版本(根据自己配置版本下载)

下载地址:

把这个jar文件放到/usr/local/spark/jars/flume目录下

②、sudo cp ./spark-streaming-kafka-0-8_2.11-2.4.0.jar /usr/local/spark/jars/flume/

③、修改spark目录下conf/spark-env.sh文件中的SPARK_DIST_CLASSPATH变量.把flume的相关jar包添加到此文件中。

export SPARK_DIST_CLASSPATH=$(/usr/local/hadoop/bin/hadoopclasspath):$(/usr/local/hbase/bin/hbaseclasspath):/usr/local/spark/jars/flume/*:/usr/local/flume/lib/*

四、编写spark程序使用Flume数据源

创建python文件

cd /usr/local/spark/mycode

mkdir flume

cd flume

sudo vim FlumeEventCount.py

代码如下:

from __future__ import print_function

import sys

from pyspark import SparkContext

from pyspark.streaming import StreamingContext

from pyspark.streaming.flume import FlumeUtils

import pyspark

if __name__ == "__main__":

if len(sys.argv) != 3:

print("Usage: flume_wordcount.py <hostname> <port>", file=sys.stderr)

exit(-1)

sc = SparkContext(appName="FlumeEventCount")

ssc = StreamingContext(sc, 10)

hostname= sys.argv[1]

port = int(sys.argv[2])

stream=FlumeUtils.createStream(ssc,hostname,port,pyspark.StorageLevel.MEMORY_AND_DISK_SER_2)

stream.pprint()

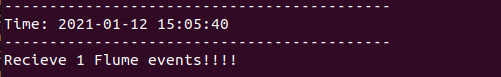

stream.count().map(lambda cnt : "Recieve " + str(cnt) +" Flume events!!!!").pprint()

ssc.start()

ssc.awaitTermination()

五、效果测试

首先启动Spark streaming程序(基于pyspark) (终端1)

入参为本地localhose 端口44444(该端口对应flume-to-spark.conf中的sinks端口)

/usr/local/spark/bin/spark-submit --driver-class-path /usr/local/spark/jars/*:/usr/local/spark/jars/flume/* ./FlumeEventCount.py localhost 44444

然后启动一个新的终端,启动Flume Agent (终端2)

cd /usr/local/flume

bin/flume-ng agent --conf ./conf --conf-file ./conf/spark-streaming.conf --name a1 -Dflume.root.logger=INFO,console

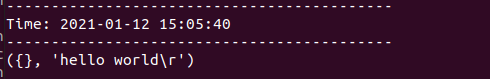

最后再启动一个新的终端连接33333端口 (终端3)

telnet localhost 33333#输入hello world

终端1结果如下:(分开返回两条信息)

学习交流,有任何问题还请随时评论指出交流。

Spark Streaming处理Flume数据练习的更多相关文章

- spark streaming集成flume

1. 安装flume flume安装,解压后修改flume_env.sh配置文件,指定java_home即可. cp hdfs jar包到flume lib目录下(否则无法抽取数据到hdfs上): $ ...

- Spark学习之路(十五)—— Spark Streaming 整合 Flume

一.简介 Apache Flume是一个分布式,高可用的数据收集系统,可以从不同的数据源收集数据,经过聚合后发送到分布式计算框架或者存储系统中.Spark Straming提供了以下两种方式用于Flu ...

- Spark 系列(十五)—— Spark Streaming 整合 Flume

一.简介 Apache Flume 是一个分布式,高可用的数据收集系统,可以从不同的数据源收集数据,经过聚合后发送到分布式计算框架或者存储系统中.Spark Straming 提供了以下两种方式用于 ...

- 通过Spark Streaming处理交易数据

Apache Spark 是加州大学伯克利分校的 AMPLabs 开发的开源分布式轻量级通用计算框架. 由于 Spark 基于内存设计,使得它拥有比 Hadoop 更高的性能(极端情况下可以达到 10 ...

- Spark Streaming 整合 Flume

Spark Streaming 整合 Flume 一.简介二.推送式方法 2.1 配置日志收集Flume 2.2 项目依赖 2.3 Spark Strea ...

- Spark Streaming揭秘 Day16 数据清理机制

Spark Streaming揭秘 Day16 数据清理机制 今天主要来讲下Spark的数据清理机制,我们都知道,Spark是运行在jvm上的,虽然jvm本身就有对象的自动回收工作,但是,如果自己不进 ...

- Spark Streaming接收Kafka数据存储到Hbase

Spark Streaming接收Kafka数据存储到Hbase fly spark hbase kafka 主要参考了这篇文章https://yq.aliyun.com/articles/60712 ...

- Spark Streaming从Flume Poll数据案例实战和内幕源码解密

本节课分成二部分讲解: 一.Spark Streaming on Polling from Flume实战 二.Spark Streaming on Polling from Flume源码 第一部分 ...

- cdh环境下,spark streaming与flume的集成问题总结

文章发自:http://www.cnblogs.com/hark0623/p/4170156.html 转发请注明 如何做集成,其实特别简单,网上其实就是教程. http://blog.csdn.n ...

随机推荐

- 阿里云OSS生成sts令牌

业务场景: 如果前端直接上传文件到OSS,势必要暴露令牌,无法精准控制上传内容等,使用临时令牌即可解决这个问题. 先去阿里云后台设置好token,角色,地区等 pom.xml <dependen ...

- 二、Linux文件系统结构

为了方便管理文件和目录,Linux 系统将它们组织成一个以根目录 / 开始的倒置的树状结构.Linux 中的目录,和 Windows 系统中的文件夹类似,不同之处在于,Linux 系统中的目录也被当做 ...

- JAVA中创建线程池的五种方法及比较

之前写过JAVA中创建线程的三种方法及比较.这次来说说线程池. JAVA中创建线程池主要有两类方法,一类是通过Executors工厂类提供的方法,该类提供了4种不同的线程池可供使用.另一类是通过Thr ...

- Linux命令-1.远程登录

原网站:http://www.runoob.com/linux/linux-remote-login.html Linux一般作为服务器使用,而服务器一般放在机房,你不可能在机房操作你的Linux服务 ...

- MyBatisPlus-快速入门

一.创建Maven工程 二.pom.xml文件 引入 MyBatis Plus 的依赖, <?xml version="1.0" encoding="UTF-8&q ...

- Spark-5-如何定位导致数据倾斜的代码

数据倾斜只会发生在shuffle过程中.这里给大家罗列一些常用的并且可能会触发shuffle操作的算子:distinct.groupByKey.reduceByKey.aggregateByKey.j ...

- DirectX12的初始化

DirectX12的初始化主要分为以下若干步骤: 创建device和gifactory 创建与GPU通信同步相关的objects,command和fence 创建swap chain 为render ...

- Ch2信息的表示和处理——caspp深入理解计算机系统

目录 第2章 信息的表示和处理 2.1 信息存储 2.1.1 十六进制 一.表示法 二.加减 三.进制转换 2.1.2 字 2.1.3 数据大小 2.1.4 字节顺序与表示 一.字节的排列规则 二.打 ...

- 个人微信公众号搭建Python实现 -个人公众号搭建-处理消息和事件(14.3.4)

@ 目录 1.消息处理 2.事件处理 3.返回处理 关于作者 1.消息处理 现在只处理text文本消息 没有关键字的就交给qingyunke机器人去应付,这是一个免费的对话api 从配置文件中读取关键 ...

- Codis集群相关

在大数据高并发场景下,单个 Redis 实例往往会显得捉襟见肘.首先体现在内存上,单个 Redis 的内存不宜过大,内存太大会导致 rdb 文件过大,进一步导致主从同步时全量同步时间过长,在实例重启恢 ...