ShardingSphere-proxy-5.0.0分布式哈希取模分片实现(四)

一、说明

主要是对字符串的字段进行hash取模

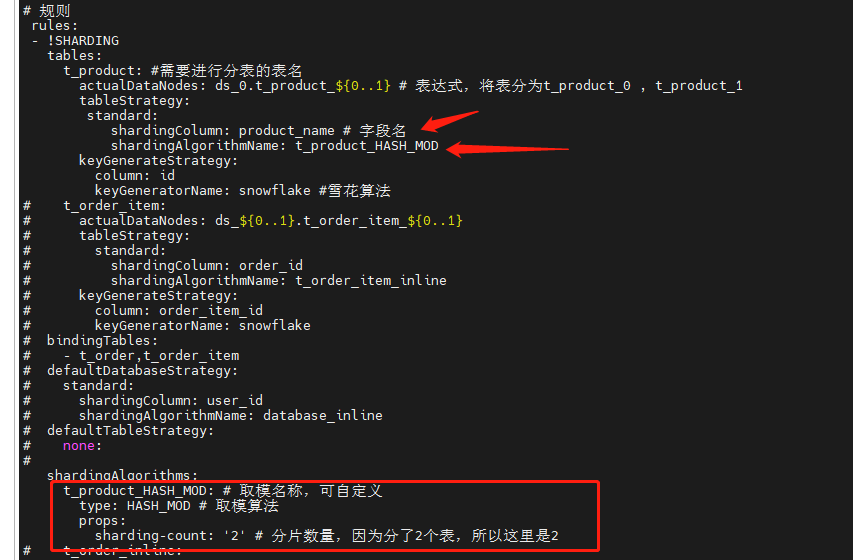

二、修改配置文件config-sharding.yaml,并重启服务

#

# Licensed to the Apache Software Foundation (ASF) under one or more

# contributor license agreements. See the NOTICE file distributed with

# this work for additional information regarding copyright ownership.

# The ASF licenses this file to You under the Apache License, Version 2.0

# (the "License"); you may not use this file except in compliance with

# the License. You may obtain a copy of the License at

#

# http://www.apache.org/licenses/LICENSE-2.0

#

# Unless required by applicable law or agreed to in writing, software

# distributed under the License is distributed on an "AS IS" BASIS,

# WITHOUT WARRANTIES OR CONDITIONS OF ANY KIND, either express or implied.

# See the License for the specific language governing permissions and

# limitations under the License.

# ######################################################################################################

#

# Here you can configure the rules for the proxy.

# This example is configuration of sharding rule.

#

######################################################################################################

#

#schemaName: sharding_db

#

#dataSources:

# ds_0:

# url: jdbc:postgresql://127.0.0.1:5432/demo_ds_0

# username: postgres

# password: postgres

# connectionTimeoutMilliseconds: 30000

# idleTimeoutMilliseconds: 60000

# maxLifetimeMilliseconds: 1800000

# maxPoolSize: 50

# minPoolSize: 1

# ds_1:

# url: jdbc:postgresql://127.0.0.1:5432/demo_ds_1

# username: postgres

# password: postgres

# connectionTimeoutMilliseconds: 30000

# idleTimeoutMilliseconds: 60000

# maxLifetimeMilliseconds: 1800000

# maxPoolSize: 50

# minPoolSize: 1

#

#rules:

#- !SHARDING

# tables:

# t_order:

# actualDataNodes: ds_${0..1}.t_order_${0..1}

# tableStrategy:

# standard:

# shardingColumn: order_id

# shardingAlgorithmName: t_order_inline

# keyGenerateStrategy:

# column: order_id

# keyGeneratorName: snowflake

# t_order_item:

# actualDataNodes: ds_${0..1}.t_order_item_${0..1}

# tableStrategy:

# standard:

# shardingColumn: order_id

# shardingAlgorithmName: t_order_item_inline

# keyGenerateStrategy:

# column: order_item_id

# keyGeneratorName: snowflake

# bindingTables:

# - t_order,t_order_item

# defaultDatabaseStrategy:

# standard:

# shardingColumn: user_id

# shardingAlgorithmName: database_inline

# defaultTableStrategy:

# none:

#

# shardingAlgorithms:

# database_inline:

# type: INLINE

# props:

# algorithm-expression: ds_${user_id % 2}

# t_order_inline:

# type: INLINE

# props:

# algorithm-expression: t_order_${order_id % 2}

# t_order_item_inline:

# type: INLINE

# props:

# algorithm-expression: t_order_item_${order_id % 2}

#

# keyGenerators:

# snowflake:

# type: SNOWFLAKE

# props:

# worker-id: 123 ######################################################################################################

#

# If you want to connect to MySQL, you should manually copy MySQL driver to lib directory.

#

###################################################################################################### # 连接mysql所使用的数据库名

schemaName: MyDb dataSources:

ds_0:

url: jdbc:mysql://127.0.0.1:3306/MyDb?serverTimezone=UTC&useSSL=false

username: root # 数据库用户名

password: mysql123 # 登录密码

connectionTimeoutMilliseconds: 30000

idleTimeoutMilliseconds: 60000

maxLifetimeMilliseconds: 1800000

maxPoolSize: 50

minPoolSize: 1

# ds_1:

# url: jdbc:mysql://127.0.0.1:3306/demo_ds_1?serverTimezone=UTC&useSSL=false

# username: root

# password:

# connectionTimeoutMilliseconds: 30000

# idleTimeoutMilliseconds: 60000

# maxLifetimeMilliseconds: 1800000

# maxPoolSize: 50

# minPoolSize: 1

#

# 规则

rules:

- !SHARDING

tables:

t_product: #需要进行分表的表名

actualDataNodes: ds_0.t_product_${0..1} # 表达式,将表分为t_product_0 , t_product_1

tableStrategy:

standard:

shardingColumn: product_name # 字段名

shardingAlgorithmName: t_product_HASH_MOD

keyGenerateStrategy:

column: id

keyGeneratorName: snowflake #雪花算法

# t_order_item:

# actualDataNodes: ds_${0..1}.t_order_item_${0..1}

# tableStrategy:

# standard:

# shardingColumn: order_id

# shardingAlgorithmName: t_order_item_inline

# keyGenerateStrategy:

# column: order_item_id

# keyGeneratorName: snowflake

# bindingTables:

# - t_order,t_order_item

# defaultDatabaseStrategy:

# standard:

# shardingColumn: user_id

# shardingAlgorithmName: database_inline

# defaultTableStrategy:

# none:

#

shardingAlgorithms:

t_product_HASH_MOD: # 取模名称,可自定义

type: HASH_MOD # 取模算法

props:

sharding-count: '2' # 分片数量,因为分了2个表,所以这里是2

# t_order_inline:

# type: INLINE

# props:

# algorithm-expression: t_order_${order_id % 2}

# t_order_item_inline:

# type: INLINE

# props:

# algorithm-expression: t_order_item_${order_id % 2}

#

keyGenerators:

snowflake: # 雪花算法名称,自定义名称

type: SNOWFLAKE

props:

worker-id: 123

三、数据准备

-- 创建表

SET NAMES utf8mb4;

SET FOREIGN_KEY_CHECKS = 0; -- ----------------------------

-- Table structure for t_product_0

-- ----------------------------

DROP TABLE IF EXISTS `t_product`;

CREATE TABLE `t_product_0` (

`id` varchar(225) CHARACTER SET utf8mb4 COLLATE utf8mb4_general_ci NOT NULL,

`product_id` int(11) NOT NULL,

`product_name` varchar(255) CHARACTER SET utf8mb4 COLLATE utf8mb4_general_ci NOT NULL,

PRIMARY KEY (`id`, `product_id`) USING BTREE

) ENGINE = InnoDB CHARACTER SET = utf8mb4 COLLATE = utf8mb4_general_ci ROW_FORMAT = Dynamic; SET FOREIGN_KEY_CHECKS = 1; -- 插入表数据

INSERT INTO t_product(product_id,product_name) VALUES(3,'apple');

INSERT INTO t_product(product_id,product_name) VALUES(2,'iphone');

四、查看数据

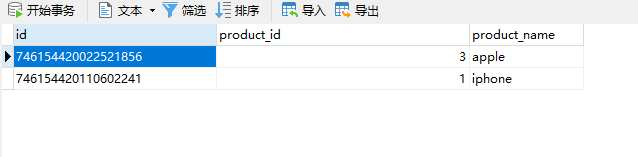

1、查看shardingsphere中间件t_product表数据

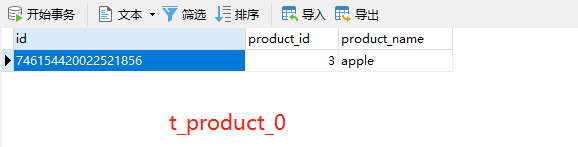

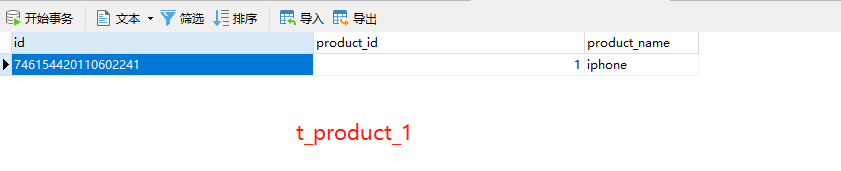

2、查看t_product_0、t_product_1表数据,同时对数据进行了分表存储(因为配置文件中有做分表配置)

ShardingSphere-proxy-5.0.0分布式哈希取模分片实现(四)的更多相关文章

- Memcached 之取模与哈希算法命中率实验

当5台memcache服务器中有一台宕机时的命中率实验. 一.php实现代码 1. config.php $server = array( "A" => array(&quo ...

- 重磅|Apache ShardingSphere 5.0.0 即将正式发布

Apache ShardingSphere 5.0.0 GA 版在经历 5.0.0-alpha 及 5.0.0-beta 接近两年时间的研发和打磨,终于将在 11 月份与大家正式见面! 11 月 10 ...

- Apache ShardingSphere 5.0.0 内核优化及升级指南

经过近两年时间的优化和打磨,Apache ShardingSphere 5.0.0 GA 版终于在本月正式发布,相比于 4.1.1 GA 版,5.0.0 GA 版在内核层面进行了大量的优化.首先,基于 ...

- ElasticJob 3.0.0:打造面向互联网生态和海量任务的分布式调度解决方案

ElasticJob 于 2020 年 5 月 28 日重启并成为 Apache ShardingSphere 子项目.新版本借鉴了 ShardingSphere 可拔插架构的设计理念,对内核进行了大 ...

- ShardingSphere-proxy-5.0.0分布式雪花ID生成(三)

一.目的 保证在分库分表中每条数据具有唯一性 二.修改配置文件config-sharding.yaml,并重启服务 # # Licensed to the Apache Software Founda ...

- Spark-1.0.0 standalone分布式安装教程

Spark目前支持多种分布式部署方式:一.Standalone Deploy Mode:二Amazon EC2.:三.Apache Mesos:四.Hadoop YARN.第一种方式是单独部署,不需要 ...

- Hadoop2.6.0完全分布式安装

本文地址:http://www.cnblogs.com/myresearch/p/hadoop-full-distributed-operation.html,转载请注明源地址. 我这边是使用了两台主 ...

- Hadoop上路-01_Hadoop2.3.0的分布式集群搭建

一.配置虚拟机软件 下载地址:https://www.virtualbox.org/wiki/downloads 1.虚拟机软件设定 1)进入全集设定 2)常规设定 2.Linux安装配置 1)名称类 ...

- 琐碎-hadoop2.2.0伪分布式和完全分布式安装(centos6.4)

环境是centos6.4-32,hadoop2.2.0 伪分布式文档:http://pan.baidu.com/s/1kTrAcWB 完全分布式文档:http://pan.baidu.com/s/1s ...

随机推荐

- ASMCMD-8102: no connection to Oracle ASM

通过ASMCMD命令连接ASM,Connected to an idle instance [root@shdb02 ~]# su - oracle [oracle@shdb02 ~]$ asmcmd ...

- 修复tunl0-二进制安装calico

这篇博文很重要,出现这个问题导致pod之间无法通讯,pod无法连接外网. 出现的问题是二进制方式安装了节点之后, tunl0没有显示,通过ifconfig tunl0 up 启动tunl0 没有意义, ...

- mysql-cluster-gpl-7.5.10-linux-glibc2.12-x86_64.tar.gz (有必要解释一下)

大部分软件我们接触的时候会发现,起的名称有点怪异,所以我觉得有必要解释一下. 比如: mysql-cluster-gpl-7.5.10-linux-glibc2.12-x86_64.tar.gz 名称 ...

- Color Constancy 颜色恒定性

1:Color Constancy? 世界上并不存在颜色.颜色仅仅是我们的眼睛和大脑对不同可见光的波长进行的一层映射.也就说颜色只是我们大脑和视网膜处理的结果. 1.1 关键问题 我们的视觉系统有一个 ...

- [翻译] 使用 TensorFlow 进行分布式训练

本文以两篇官方文档为基础来学习TensorFlow如何进行分布式训练,借此进入Strategy世界.

- SpringMVC基础原理

1.拦截所有请求到DispatcherServlet 2.去寻找映射器 3.根据处理器适配器处理业务,返回视图 4.视图解析器解析显示视图

- 用js实现倒计时效果

首先获得两个时间的时间戳 var newdate = new Date('2021-01-22 21:25:00').getTime(); var olddate = new Date().getTi ...

- 基于Ansible实现Apache Doris快速部署运维指南

Doris Ansible 使用指南 Apache Doris 介绍 Apache Doris是一个现代化的MPP分析型数据库产品.仅需亚秒级响应时间即可获得查询结果,有效地支持实时数据分析.Apac ...

- QMetaObject::connectSlotsByName: No matching signal for XXX 原理探究

问题引出: 在尝试实现<Qt5.9 c++开发指南>混合UI编程章节时,用纯代码形式实现了个小按钮,然后加了个对应的槽函数,运行时就提示了这个信息. 原因探究: 首先查阅官方手册中的说明: ...

- Hadoop介绍篇

Hadoop详解 1.前言 对于初次接触Hadoop的小伙伴来说,Hadoop是一个很陌生的东西,尤其是Hadoop与大数据之间的关联,写这篇文章之前,我也有许多关于Hadoop与大数据的疑惑,接下来 ...