Andrew Ng-ML-第九&十章-神经网络

1.神经网络模型1

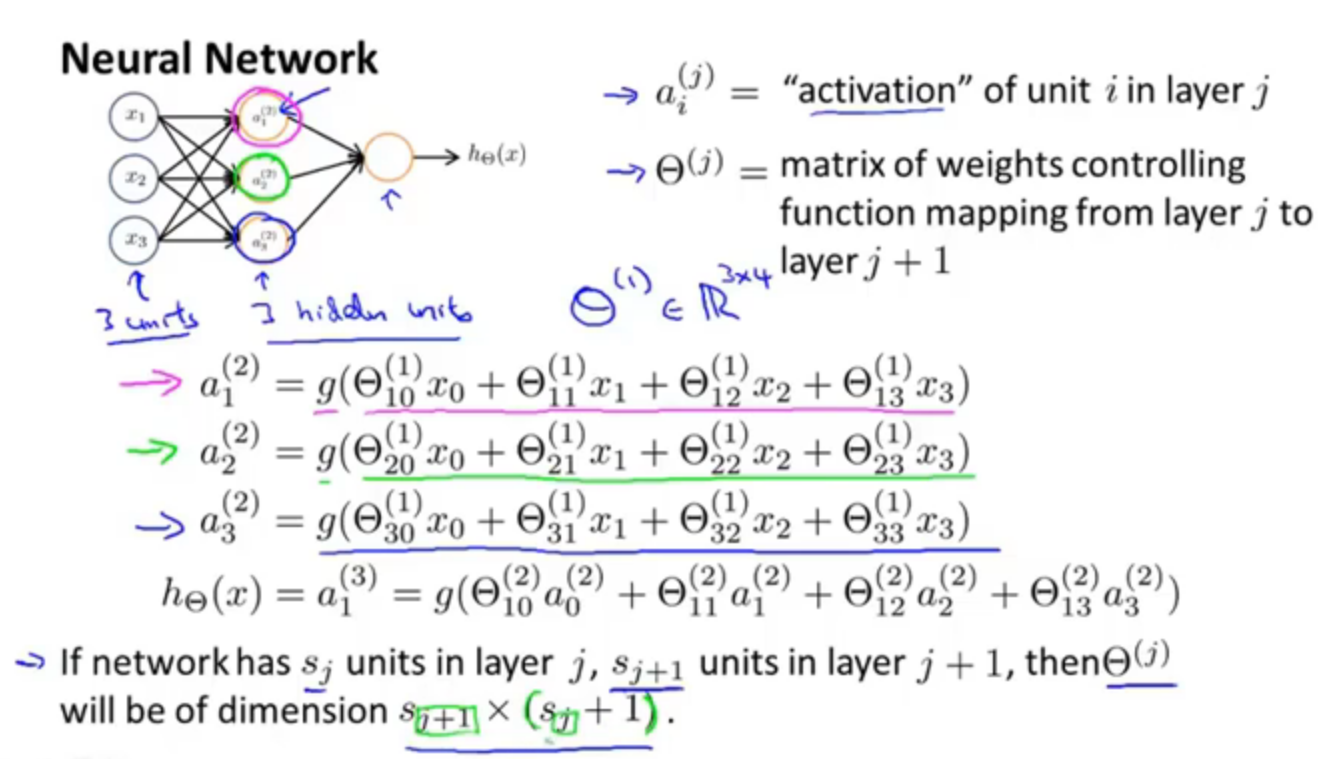

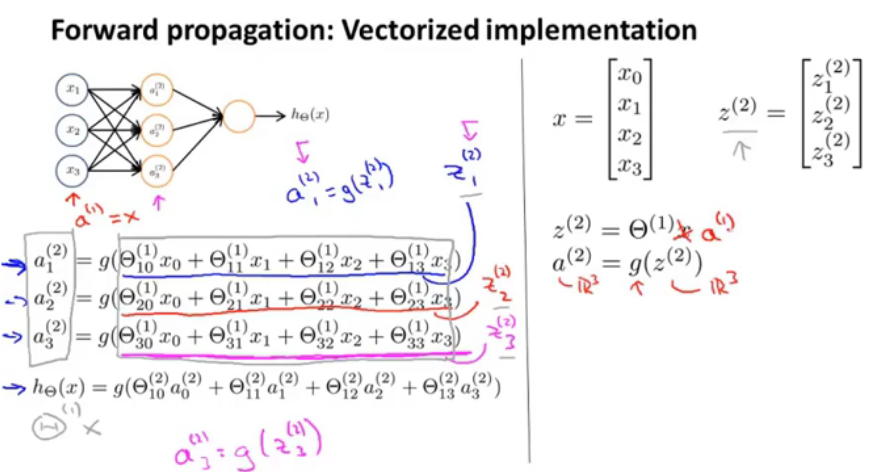

图1

这是一个神经网络的模型,通常设置一个x0,作为偏执单元或者偏置(bias)神经元。

图2

这里最后一句话,说的是系数矩阵θ,神经网络模型中,如果当前在j层有s_j个单元,在j+1层有s_j+1个单元,那么第j层的系数矩阵theta_j,是s_j+1(s_j +1)维的。

//就像图中,三个公式,应该是每层其实都有一个偏置单元。s_j+1是因为输入层得到的结果要是隐含层的输入,隐含层有s_j+1个单元,(s_j +1)是+上本层的偏置单元。

2.神经网络中的分类问题

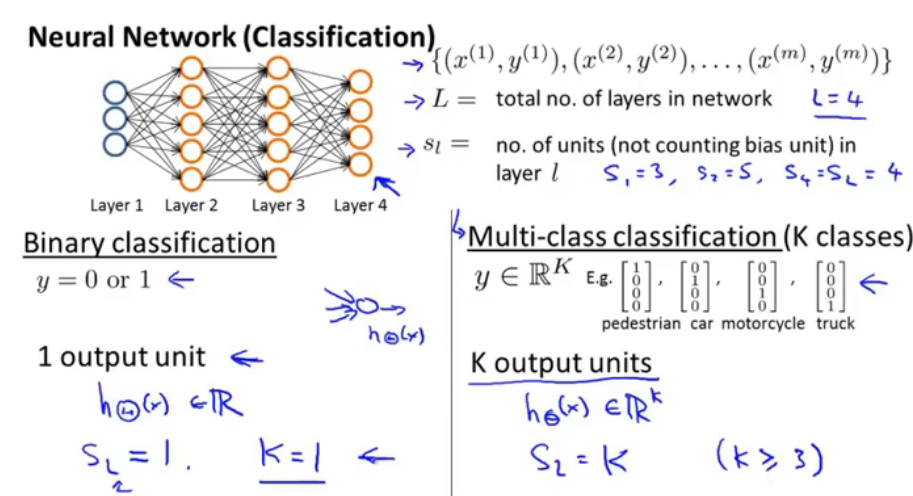

图3

对于二分类的问题,输出层只有一个输出单元,对于多分类问题(k≥3),那么输出层就有k个输出单元。

3.神经网络的代价函数

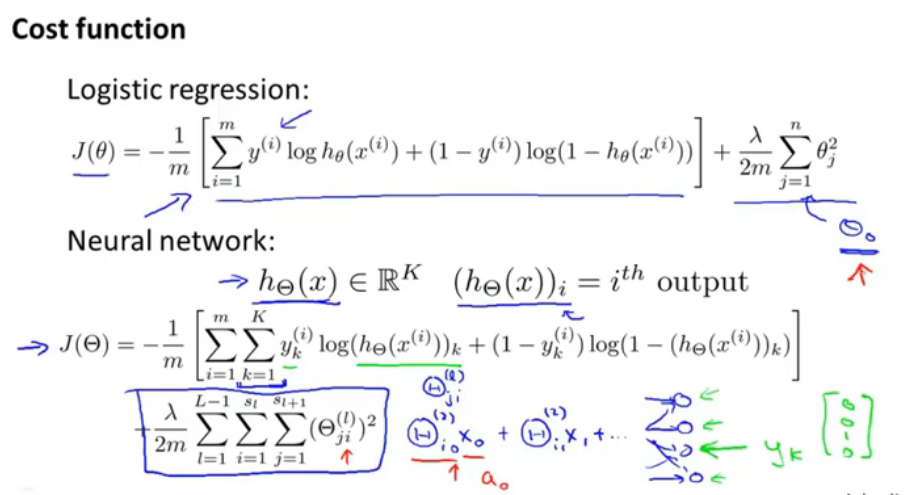

图4

首先第一项是对输出层的输出求和,每个都乘上yk;正则项,theta右上角的(l)表示的是层数,j表示的是第j行吧,也就是一共s_j+1行,i表示的是s_j列,那么一共是L-1层的相加。每一层都加上了一个偏置,但是在图中并没有画出。通常正则化项都不把偏置项加入到其中,但是加入了之后影响也不大。

4.反向传播算法

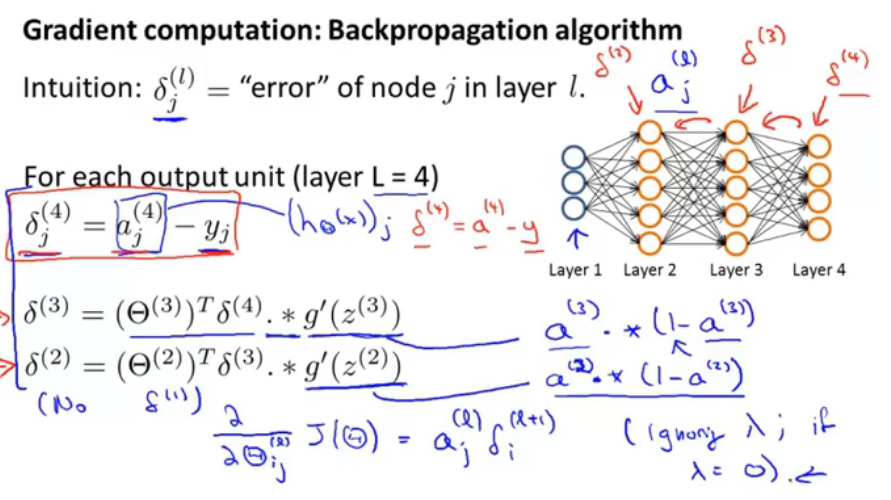

图5

首先就是需要计算每个单元的误差,怎么计算呢?如图,输出层也就是第4层,就等于当前的计算结果-实际结果;第三层的误差,第三层权重矩阵转置*第四层误差向量*激活函数的导数。

图中还给了一个公式就是——求偏导项的公式——代价函数的对每层权重矩阵单个,求导的公式=l层第j个节点的值*l+1层第i个节点的误差。 (证明过程十分复杂)

图7

z这里代表的是:每层的计算结果,代入激活函数之后就可以作为下一层神经元的输入。是三维的。

以下为伪代码:

图8

将所有误差(三角形的

Andrew Ng-ML-第九&十章-神经网络的更多相关文章

- Andrew Ng机器学习课程笔记(四)之神经网络

Andrew Ng机器学习课程笔记(四)之神经网络 版权声明:本文为博主原创文章,转载请指明转载地址 http://www.cnblogs.com/fydeblog/p/7365730.html 前言 ...

- 【原】Coursera—Andrew Ng机器学习—编程作业 Programming Exercise 4—反向传播神经网络

课程笔记 Coursera—Andrew Ng机器学习—课程笔记 Lecture 9_Neural Networks learning 作业说明 Exercise 4,Week 5,实现反向传播 ba ...

- (原创)Stanford Machine Learning (by Andrew NG) --- (week 10) Large Scale Machine Learning & Application Example

本栏目来源于Andrew NG老师讲解的Machine Learning课程,主要介绍大规模机器学习以及其应用.包括随机梯度下降法.维批量梯度下降法.梯度下降法的收敛.在线学习.map reduce以 ...

- (原创)Stanford Machine Learning (by Andrew NG) --- (week 7) Support Vector Machines

本栏目内容来源于Andrew NG老师讲解的SVM部分,包括SVM的优化目标.最大判定边界.核函数.SVM使用方法.多分类问题等,Machine learning课程地址为:https://www.c ...

- (原创)Stanford Machine Learning (by Andrew NG) --- (week 4) Neural Networks Representation

Andrew NG的Machine learning课程地址为:https://www.coursera.org/course/ml 神经网络一直被认为是比较难懂的问题,NG将神经网络部分的课程分为了 ...

- (原创)Stanford Machine Learning (by Andrew NG) --- (week 5) Neural Networks Learning

本栏目内容来自Andrew NG老师的公开课:https://class.coursera.org/ml/class/index 一般而言, 人工神经网络与经典计算方法相比并非优越, 只有当常规方法解 ...

- matlab基础教程——根据Andrew Ng的machine learning整理

matlab基础教程--根据Andrew Ng的machine learning整理 基本运算 算数运算 逻辑运算 格式化输出 小数位全局修改 向量和矩阵运算 矩阵操作 申明一个矩阵或向量 快速建立一 ...

- 斯坦福大学Andrew Ng教授主讲的《机器学习》公开课观后感[转]

近日,在网易公开课视频网站上看完了<机器学习>课程视频,现做个学后感,也叫观后感吧. 学习时间 从2013年7月26日星期五开始,在网易公开课视频网站上,观看由斯坦福大学Andrew Ng ...

- 机器学习笔记(一)- from Andrew Ng的教学视频

最近算是一段空闲期,不想荒废,记得之前有收藏一个机器学习的链接Andrew Ng的网易公开课,其中的overfiting部分做组会报告时涉及到了,这几天有时间决定把这部课程学完,好歹算是有个粗浅的认识 ...

- 2014-7 Andrew Ng 自动化所报告听后感

原文:http://blog.sina.com.cn/s/blog_593af2a70102uwhl.html 一早出发,8点20就赶到现场, 人越聚越多,Ng提前几分钟到达现场,掌声一片. N ...

随机推荐

- 行逻辑链接的顺序表实现稀疏矩阵的相乘(Java语言描述)

行逻辑链接,带行链接信息.程序有空指针BUG,至今未解决.还是C/C++适合描述算法数据结构.以后复杂的算法还是改用C/C++吧. 有BUG的代码,总有一天会换成没有BUG的. package 行逻辑 ...

- Github for Windows 登录时报代理问题?

Github for Windows 登录时报如下错误: 不要被它的提示信息误导了. 登录失败,跟代理半毛钱关系都没有. 是 .net framework 组件 的问题. 更新下 .net frame ...

- python tkinter学习——布局

目录 一.pack() 二.grid() 三.place() 四.Frame() 正文 布局 一.pack() pack()有以下几个常用属性: side padx pady ipadx ipady ...

- 题目1042:Coincidence(最长公共子序列 dp题目)

题目链接:http://ac.jobdu.com/problem.php?pid=1042 详解链接:https://github.com/zpfbuaa/JobduInCPlusPlus 参考代码: ...

- tcp连接的状态变迁以及如何调整tcp连接中处于time_wait的时间

一.状态变迁图 二.time_wait状态 针对time_wait和close_wait有个简单的描述帮助理解: Due to the way TCP/IP works, connections ca ...

- PtH(hash传递攻击)原理探秘

背景知识 Windows 横向渗透的两种方式 1.hash传递攻击,通过传递NTLM-Hash,登录机器,简称PtH: 2.ticket传递攻击,通过传递kerberos的ticket,登录机器,简称 ...

- 提高VS2010运行速度的技巧

任务管理器,CPU和内存都不高,为何?原因就是VS2010不停地读硬盘导致的; 写代码2/3的时间都耗在卡上了,太难受了; 研究发现,VS2010如果你装了VC等语言,那么它就会自动装SQL Serv ...

- 【转】C内存管理

在任何程序设计环境及语言中,内存管理都十分重要.在目前的计算机系统或嵌入式系统中,内存资源仍然是有限的.因此在程序设计中,有效地管理内存资源是程序员首先考虑的问题. 第1节主要介绍内存管理基本概念,重 ...

- 新浪的动态策略灰度发布系统:ABTestingGateway

原文链接:http://www.open-open.com/lib/view/open1439889185239.html ABTesingGateway 是一个可以动态设置分流策略的灰度发布系统,工 ...

- Unity3D笔记十六 输入输出-键盘事件、鼠标事件

输入与控制操作Unity为开发者提供了Input类库,其中包括键盘事件.鼠标事件和触摸事件等一切跨平台所需要的控制事件. 一.键盘事件 1.按下事件 Input.GetKeyDown():如果按键被按 ...