scrapy (四)基本配置

scrapy使用细节配置

一、建立项目

1、scrapy startproject 项目名字

2、进入项目:

scrapy genspider 名字 不带http的根网址

3、默认模板(或改变模板)

默认模板:class HuaSpider(scrapy.Spider):

改变模板:scapy genspider -t crwal 名字(hua2) 不带http的根网址:

(class Hua2Spider(CrawlSpider)

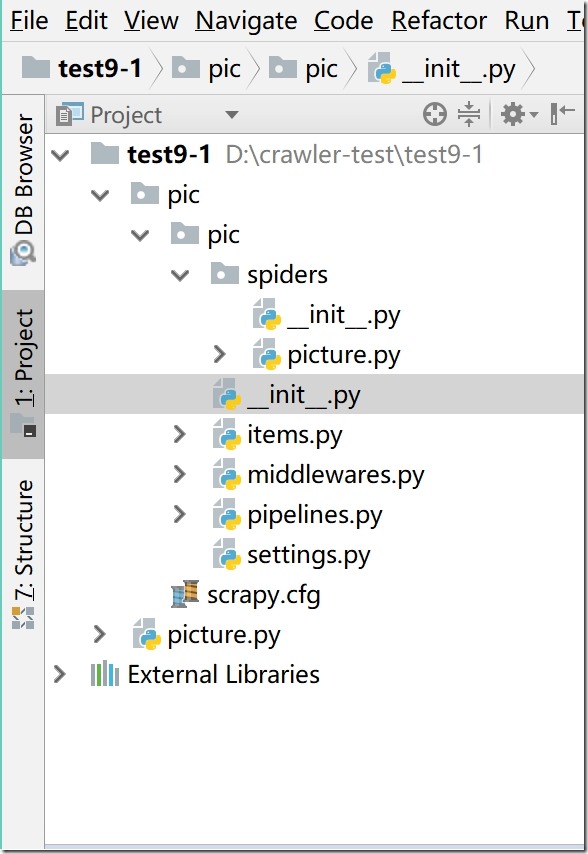

4、目录结构

二、setting基本设置

1、log日志输出的级别:

INFO、ERROR......

LOG_LEVEL = 'ERROR'

2、将log写到文件中(自动创建log.txt)

LOG_FILE = './log.txt'

3、robots

是否遵守各大网站的爬虫规则(robots),默认是True,为了得到我们想要的数据,设置ROBOTSTXT_OBEY为F alse: ROBOTSTXT_OBEY = False

查看各大网站的规则:根网址+/robots.txt,例如https://www.baidu.com/robots.txt

4、设置代理middlewares.py

下载中间件设置:

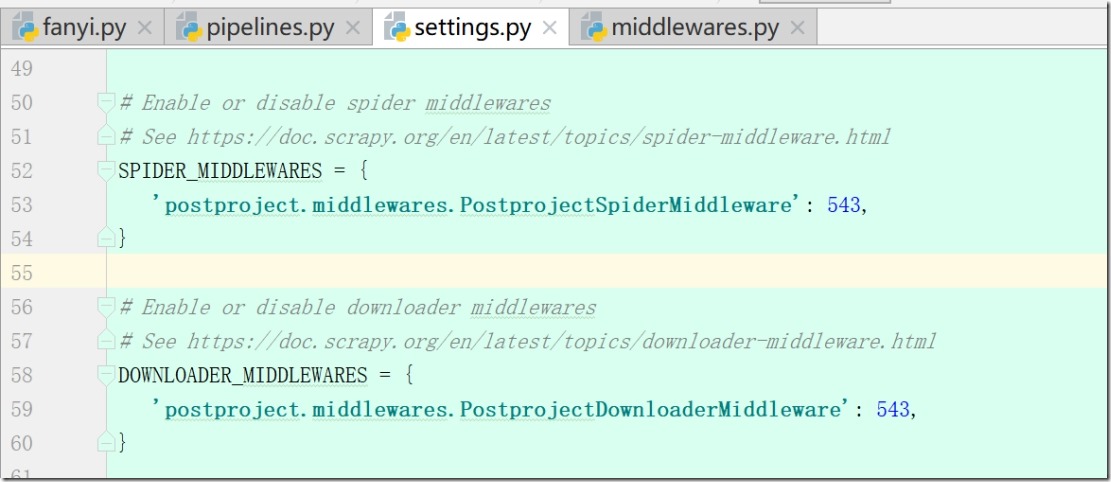

1) 在setting中打开以下配置

DOWNLOADER_MIDDLEWARES = {

'postproject.middlewares.PostprojectDownloaderMiddleware': 543,

}

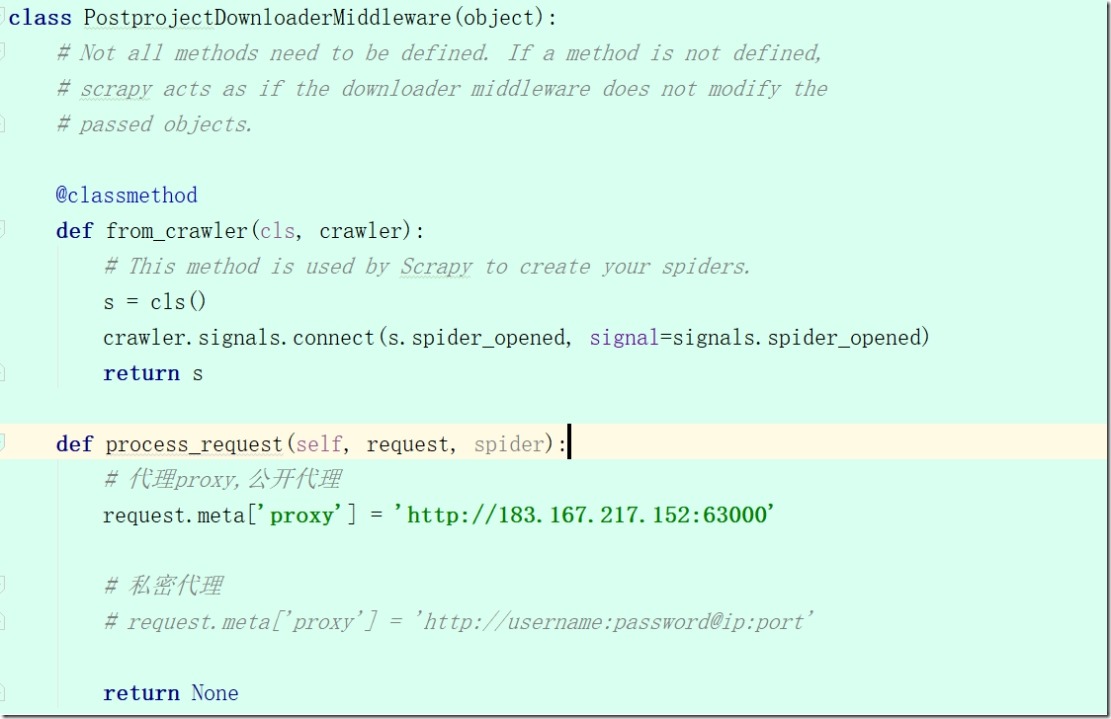

2)在middlewares.py中添加代理

在class PostprojectDownloaderMiddleware(object):

def process_request(self, request, spider):

公开代理格式:request.meta['proxy'] ='http://ip:port'

私密代理格式:request.meta['proxy'] = 'http://username:password@ip:port'

3)回到setting,解开下载中间件DOWNLOADER_MIDDLEWARES

欢迎关注小婷儿的博客:

csdn:https://blog.csdn.net/u010986753

博客园:http://www.cnblogs.com/xxtalhr/

有问题请在博客下留言或加QQ群:483766429 或联系作者本人 QQ :87605025

OCP培训说明连接:https://mp.weixin.qq.com/s/2cymJ4xiBPtTaHu16HkiuA

OCM培训说明连接:https://mp.weixin.qq.com/s/7-R6Cz8RcJKduVv6YlAxJA

小婷儿的python正在成长中,其中还有很多不足之处,随着学习和工作的深入,会对以往的博客内容逐步改进和完善哒。

小婷儿的python正在成长中,其中还有很多不足之处,随着学习和工作的深入,会对以往的博客内容逐步改进和完善哒。

小婷儿的python正在成长中,其中还有很多不足之处,随着学习和工作的深入,会对以往的博客内容逐步改进和完善哒。

重要的事说三遍。。。。。。

scrapy (四)基本配置的更多相关文章

- 第三篇——第二部分——第四文 配置SQL Server镜像——非域环境

原文:第三篇--第二部分--第四文 配置SQL Server镜像--非域环境 本文为非域环境搭建镜像演示,对于域环境搭建,可参照上文:http://blog.csdn.net/dba_huangzj/ ...

- Nginx教程(四) Location配置与ReWrite语法

Nginx教程(四) Location配置与ReWrite语法 1 Location语法规则 1.1 Location规则 语法规则: location [=|~|~*|^~] /uri/ {- } ...

- centOS7 mini配置linux服务器(四) 配置jdk

这里简单写一下centos7Mini 安装jdk1.8的全过程. 一.下载jdk,linux版本. 地址:http://www.oracle.com/technetwork/java/javase/ ...

- CAS 5.1.x 的搭建和使用(四)—— 配置使用HTTP协议访问的服务端

CAS单点登录系列: CAS 5.1.x 的搭建和使用(一)—— 通过Overlay搭建服务端 CAS5.1.x 的搭建和使用(二)—— 通过Overlay搭建服务端-其它配置说明 CAS5.1.x ...

- Python爬虫进阶三之Scrapy框架安装配置

初级的爬虫我们利用urllib和urllib2库以及正则表达式就可以完成了,不过还有更加强大的工具,爬虫框架Scrapy,这安装过程也是煞费苦心哪,在此整理如下. Windows 平台: 我的系统是 ...

- 使用亚马逊云服务器EC2做深度学习(四)配置好的系统镜像

这是<使用亚马逊云服务器EC2做深度学习>系列的第四篇文章. (一)申请竞价实例 (二)配置Jupyter Notebook服务器 (三)配置TensorFlow (四)配置好的系统 ...

- scrapy框架中间件配置代理

scrapy框架中间件配置代理import random#代理池PROXY_http = [ '106.240.254.138:80', '211.24.102.168:80',]PROXY_http ...

- Scrapy笔记10- 动态配置爬虫

Scrapy笔记10- 动态配置爬虫 有很多时候我们需要从多个网站爬取所需要的数据,比如我们想爬取多个网站的新闻,将其存储到数据库同一个表中.我们是不是要对每个网站都得去定义一个Spider类呢? 其 ...

- Python爬虫进阶之Scrapy框架安装配置

Python爬虫进阶之Scrapy框架安装配置 初级的爬虫我们利用urllib和urllib2库以及正则表达式就可以完成了,不过还有更加强大的工具,爬虫框架Scrapy,这安装过程也是煞费苦心哪,在此 ...

- Cisco基础(四):配置标准ACL、配置扩展ACL、配置标准命名ACL、配置扩展命名ACL

一.配置标准ACL 目标: 络调通后,保证网络是通畅的.同时也很可能出现未经授权的非法访问.企业网络既要解决连连通的问题,还要解决网络安全的问题. 配置标准ACL实现拒绝PC1(IP地址为192.16 ...

随机推荐

- 阿里云数据库配置学习笔记(二):下载并配置MySQL数据库

参考资料:阿里云官方文档 2018-02-20 一.MySQL数据库的下载 在Ubuntu环境下安装MySQL数据库十分简单 在命令行中输入 sudo apt-get update(更新软件源,预防出 ...

- JavaScript--DOM元素尺寸和位置(22)

一 获取元素的CSS大小 1.通过style内联获取元素的大小 var box = document.getElementById('box'); // 获得元素; box.style.width; ...

- 转载文章CSS3的calc()使用

calc()对大家来说,或许很陌生,不太会相信calc()是css中的部分.因为看其外表像个函数,既然是函数为何又出现在CSS中呢?这一点也让我百思不得其解,今天有一同事告诉我,说CSS3中有一个属性 ...

- 常见Java问题二

1.什么是B/S架构?什么是C/S架构? B/S browser/server Web应用程序 C/S Client/Server 桌面应用程序 2.String str="www" ...

- 火狐hr标签的兼容性问题

想在盒子里加一条白色横线 加了以下代码 页面效果如下<hr style="width:80%;height:1px;border:none;border-top:1px solid # ...

- IntelliJ idea 备份与恢复

为了防止突然断电或者电脑突然关机导致idea恢复出厂设置,需要定期备份配置. 一.备份 File---Export Settings 将settings.jar 文件导入到C:\Users\xutin ...

- KCF的弊端

一.前情提要 如果你对目标跟踪和KCF是什么东西还不了解的话欢迎你看前一篇博文KCF入门详解:https://www.cnblogs.com/jins-note/p/10215511.html ...

- Nginx的日志剖析

1.访问日志(access.log) Nginx的访问日志就是一个文件,它存储着每个用户对网站的访问请求,这个功能是有ngx_http_log_module模块来负责的,这个文件存在的主要目的就是为了 ...

- Android--将实体类转化成Json和Map的基类

package com.newair.talk.base; import android.text.TextUtils; import com.google.gson.Gson; import jav ...

- Express浅谈

写给鸟自己的,大家如果不慎百度到这里来了,真好也在做这块功能,不懂的可以联系鸟.微信:jkxx123321 const Sequelize = require('sequelize'); const ...