Scrapy爬取Ajax(异步加载)网页实例——简书付费连载

这两天学习了Scrapy爬虫框架的基本使用,练习的例子爬取的都是传统的直接加载完网页的内容,就想试试爬取用Ajax技术加载的网页。

这里以简书里的优选连载网页为例分享一下我的爬取过程。

网址为:

https://www.jianshu.com/mobile/books?category_id=284

一、分析网页

进入之后,鼠标下拉发现内容会不断更新,网址信息也没有发生变化,于是就可以判断这个网页使用了异步加载技术。

f

f

首先明确爬取的内容,本次我爬取的是作品名称、照片、作者、阅读量。然后将照片下载存储在文件夹中,然后将全部内容生成csv文件夹保存。

查看网页源代码发现代码里只有已加载的作品的内容,编写爬虫代码发现爬取不到收录的信息。

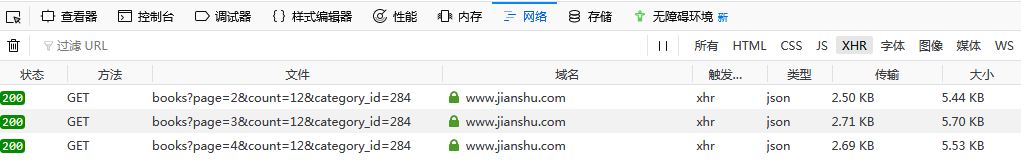

进入Network选项,勾选XHR选项,通过下滑网页发现Network选项卡会加载文件,如下图:

注:这里我用的是火狐浏览器

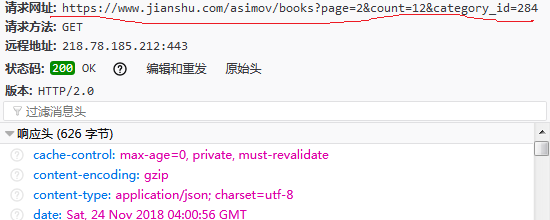

点击其中一个加载文件,可以在消息头看到请求网址:

继续下滑,发现Headers部分请求的URL只是page后面的数字在改变,通过改变数字,我们就能在后面调用回调函数爬取多个网页了。

二、Scrapy爬取

1.在命令提示符输入:

cd Desktop #进入桌面

scrapy startproject jian #生成名为jian的Scrapy文件夹 cd jian

scrapy genspider lianzai jianshu.com #爬虫名为lianzai

这里我用的是pycharm,打开文件夹。

2.在items.py定义爬虫字段

class JianItem(scrapy.Item):

# define the fields for your item here like:

# name = scrapy.Field()

book_name=scrapy.Field()

img=scrapy.Field()

author=scrapy.Field()

readers=scrapy.Field()

pass

3.在lianzai.py编写爬虫代码,爬取数据

# -*- coding: utf-8 -*-

import scrapy

from jian.items import JianItem

import json

import requests class LianzaiSpider(scrapy.Spider):

name = 'lianzai'

allowed_domains = ['jianshu.com']

start_urls = ['https://www.jianshu.com/asimov/books?page=1&count=12&category_id=284'] #第一页的url

def parse(self, response):

data=json.loads(response.body) #str转为json对象

try:

for i in range(0, 12):

item = JianItem()

img=data['books'][i]['image_url']

book_name=data['books'][i]['name']

author=data['books'][i]['user']['nickname']

readers=data['books'][i]['views_count'] item['img']=img

item['book_name']=book_name

item['author']=author

item['readers']=readers

yield item #返回数据

except IndexError:

pass

urls=['https://www.jianshu.com/asimov/books?page={}&count=12&category_id=284'.format(str(i))for i in range(2, 11)] #

for url in urls:

yield scrapy.Request(url,callback=self.parse) #回调函数

这里特别要注意的是要爬取内容的所在位置。

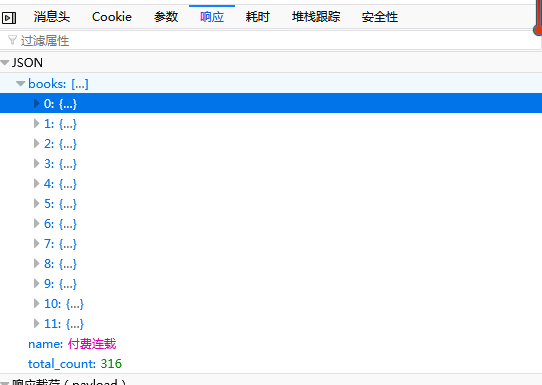

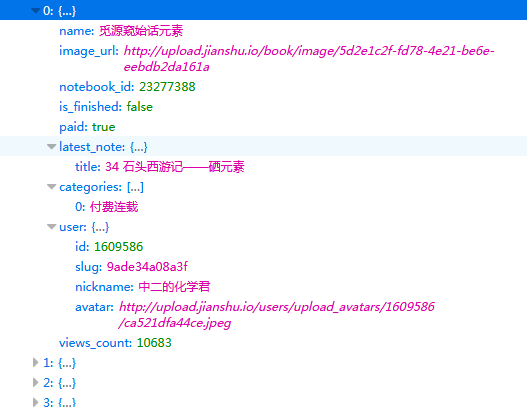

上图中左图可以看出爬取的内容的位置在response里的['books']里面,且一个网页有12个作品,因此上面循环出为(0,12)。

打开后如上右图,可以看到我们要爬取的作品名、图片地址、作者、阅读量都在里面,爬取就相对容易了。

4.在setting.py设置爬虫配置

USER_AGENT='Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.96 Safari/537.36' #请求头

DOWNLOAD_DELAY=0.5 #延时0.5

FEED_URI='file:C:/Users/lenovo/Desktop/jianshulianzai.csv' #在桌面生成CSV文件

FEED_FORMAT='csv' #存入

ITEM_PIPELINES={'jian.pipelines.JianPipeline':300}

5.在pipelines.py处理照片数据

# -*- coding: utf-8 -*- # Define your item pipelines here

#

# Don't forget to add your pipeline to the ITEM_PIPELINES setting

# See: https://doc.scrapy.org/en/latest/topics/item-pipeline.html

import os

import urllib.request class JianPipeline(object):

def process_item(self, item, spider):

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.96 Safari/537.36'

}

try:

if item['img'] != None:

req=urllib.request.Request(url=item['img'],headers=headers)

res=urllib.request.urlopen(req)

file_name = os.path.join(r'C:\Users\lenovo\Desktop\my_pic', item['book_name'] + '.jpg')

with open(file_name,'wb')as f:

f.write(res.read())

except urllib.request.URLError:

pass

return item

6.全部保存后,在命令行终端输入:

scrapy crawl lianzai

就将结果爬取下来并保存啦。

三、结果

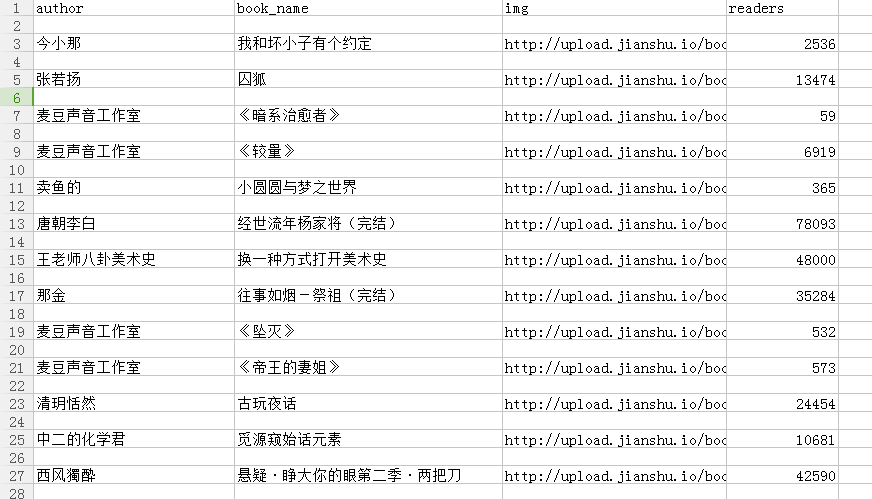

.csv文件的内容:

下载的照片:

初入爬虫,还有很多不足需要改正,还有很多知识需要学习,希望有疑问或建议的朋友多多指正或留言。谢谢。

Scrapy爬取Ajax(异步加载)网页实例——简书付费连载的更多相关文章

- Scrapy爬虫框架教程(四)-- 抓取AJAX异步加载网页

欢迎关注博主主页,学习python视频资源,还有大量免费python经典文章 sklearn实战-乳腺癌细胞数据挖掘 https://study.163.com/course/introduction ...

- 爬虫——爬取Ajax动态加载网页

常见的反爬机制及处理方式 1.Headers反爬虫 :Cookie.Referer.User-Agent 解决方案: 通过F12获取headers,传给requests.get()方法 2.IP限制 ...

- Python网络爬虫_爬取Ajax动态加载和翻页时url不变的网页

1 . 什么是 AJAX ? AJAX = 异步 JavaScript 和 XML. AJAX 是一种用于创建快速动态网页的技术. 通过在后台与服务器进行少量数据交换,AJAX 可以使网页实现异步更新 ...

- scrapy项目5:爬取ajax形式加载的数据,并用ImagePipeline保存图片

1.目标分析: 我们想要获取的数据为如下图: 1).每本书的名称 2).每本书的价格 3).每本书的简介 2.网页分析: 网站url:http://e.dangdang.com/list-WY1-dd ...

- htmlunit爬取js异步加载后的页面

直接上代码: 一. index.html 调用后台请求获取content中的内容. <html> <head> <script type="text/javas ...

- 淘宝购物车页面 智能搜索框Ajax异步加载数据

如果有朋友对本篇文章的一些知识点不了解的话,可以先阅读此篇文章.在这篇文章中,我大概介绍了一下构建淘宝购物车页面需要的基础知识. 这篇文章主要探讨的是智能搜索框Ajax异步加载数据.jQuery的社区 ...

- jQuery的AJax异步加载

主要用到load()方法以及getScript()方法,具体以一个例子说明: 在现有html文件中加载一个拟好的片段,以及在片段加载完成之前阻止用户进一步操作的弹出框. 首先是现有html代码,无任何 ...

- ajax异步加载问题

使用ajax异步加载数据,在之后需要用到这个数据时,应该将之后的js一并写入ajax函数中,否则后面的js不能找到动态拼接的dom节点. 或者将其封装成方法,在ajax动态加载数据的最后调用该方法.

- Ajax 异步加载

AJAX (Asynchronous JavaScript and XML,异步的 JavaScript 和 XML).它不是新的编程语言,而是一种使用现有标准的新方法,是在不重新加载整个页面的情况下 ...

随机推荐

- 利用arcserver 自带tomcat实现上传shapefile、cad等文件,然后用soe解析。

一.功能实现分析 1.soe中传入指定路径目录和文件名就能读取shp.cad并解析,然后返回JSON格式数据给flex端生成图形.(soe读取的是本地绝对路径) 2.所以首先要上传文件到soe发布所在 ...

- lambda隐藏函数的嵌套

# 隐藏函数嵌套 f = (lambda a,b :a if a>b else b)(1000, 2000008) print((lambda a,g:a if a > g else g) ...

- python爬虫入门(二)Opener和Requests

Handler和Opener Handler处理器和自定义Opener opener是urllib2.OpenerDirector的实例,我们之前一直在使用urlopen,它是一个特殊的opener( ...

- Sublime中文编码问题

1. 改配置 Preferences->Settings 三个全部加上 "default_encoding": "UTF-8" 2. 代码编写 2.1 ...

- SpringCloud实战-Hystrix请求熔断与服务降级

我们知道大量请求会阻塞在Tomcat服务器上,影响其它整个服务.在复杂的分布式架构的应用程序有很多的依赖,都会不可避免地在某些时候失败.高并发的依赖失败时如果没有隔离措施,当前应用服务就有被拖垮的风险 ...

- 深入理解SpringBoot之自动装配

SpringBoot的自动装配是拆箱即用的基础,也是微服务化的前提.其实它并不那么神秘,我在这之前已经写过最基本的实现了,大家可以参考这篇文章.这次主要的议题是,来看看它是怎么样实现的,我们透过源代码 ...

- 利用box-shadow属性实现页面层叠效果

效果图如下 box-shadow的语法 代码展示 .footer { color: #777; padding: 10px 15px; height: 20px; text-align: center ...

- PAT1115:Counting Nodes in a BST

1115. Counting Nodes in a BST (30) 时间限制 400 ms 内存限制 65536 kB 代码长度限制 16000 B 判题程序 Standard 作者 CHEN, Y ...

- Docker的安装和测试

1,Docker安装 Docker是啥,以及其与虚拟机的对比,就不介绍了,网上有很多资源可以学习和了解. 本篇文章重点介绍Docker的安装和测试使用. Docker的安装,分为离线安装和在线安装两种 ...

- .Net Core微服务系列--理论篇

微服务的由来 微服务最早由Martin Fowler与James Lewis于2014年共同提出来的,但是微服务也不是一个全新的概念,它是由一系列在实践中获得成功并流行起来的概念中总结出来的一种模式, ...