Spark基础脚本入门实践2:基础开发

1、最基本的Map用法

val data = Array(1, 2, 3, 4, 5)

val distData = sc.parallelize(data)

val result = distData.map(x=>x*x)

println(result.collect().mkString(","))

其中最关键的操作就是:从分布式数据集 --转换--> 并行数据集

from a distributed dataset to Parallelized collections

Spark分布式数据集包含:

- local file system

- HDFS

- Cassandra

- HBase

- Amazon S3

Spark supports text files, SequenceFiles, and any other Hadoop InputFormat.

- 比如文件:val distFile = sc.textFile("data.txt")

- 比如hdfs:hdfs://

- 比如s3:s3n://

读取文件时需要注意的是:

- 如果使用的是本地文件路径,那么worker节点一定是有访问权限的.

- 文本文件的访问方式: textFile("/my/directory"), textFile("/my/directory/*.txt"), and textFile("/my/directory/*.gz").

- hdfs系统会把文件按128MB进行分区

2、从外部文件系统获取数据

val lines = sc.textFile("file:///usr/local/spark/examples/src/main/resources/people.json")

val lineLengths = lines.map(s => s.length)

val totalLength = lineLengths.reduce((a, b) => a + b)

3、flatMap用法

flatMap的做法有点象把迭代器拍扁拍碎,比如以下代码

val lines = sc.parallelize(List("hi man","ha girl"))

val wordsFlatmap = lines.flatMap(line=>line.split(" "))

val wordsMap = lines.map(line=>line.split(" "))

看看区别:

scala> wordsFlatmap.first

res9: String = hi

scala> wordsMap.first

res10: Array[String] = Array(hi, man)

实际上wordsFlatmap被拆成了4个string,而wordsMap是对输入的list每个元素进行了split操作,所以说flatMap的做法有点象把迭代器拍扁拍碎。比如说分词就容易用flatMap

4、笛卡尔积

在推荐系统中,要计算各用户对多个产品的兴趣度,就可以制作一个笛卡尔积,用于比较用户的的喜爱产品的相似度。

val man = sc.parallelize(List("Tom","Cat"))

val product = sc.parallelize(List("car","iphone","android","surfacePro"))

val result = man.cartesian(product)

result.collect

运行结果:

res0: Array[(String, String)] = Array((Tom,car), (Tom,iphone), (Tom,android), (Tom,surfacePro), (Cat,car), (Cat,iphone), (Cat,android), (Cat,surfacePro))

笛卡儿计算是很恐怖的,它会迅速消耗大量的内存,所以在使用这个函数的时候请小心

5、cache操作

在spark中使用cache是非常重要的,因为行动操作都是惰性求值,每次都会重新计算所有的依赖,如果有大量迭代,代价巨大。

缓存就可以从内容读取,无需再次计算

scala> var data = sc.parallelize(List(1,2,3,4))

data: org.apache.spark.rdd.RDD[Int] =

ParallelCollectionRDD[44] at parallelize at <console>:12

scala> data.getStorageLevel

res65: org.apache.spark.storage.StorageLevel =

StorageLevel(false, false, false, false, 1)

scala> data.cache

res66: org.apache.spark.rdd.RDD[Int] =

ParallelCollectionRDD[44] at parallelize at <console>:12

scala> data.getStorageLevel

res67: org.apache.spark.storage.StorageLevel =

StorageLevel(false, true, false, true, 1)

我们先是定义了一个RDD,然后通过getStorageLevel函数得到该RDD的默认存储级别,这里是NONE。然后我们调用cache函数,将RDD的存储级别改成了MEMORY_ONLY(看StorageLevel的第二个参数)

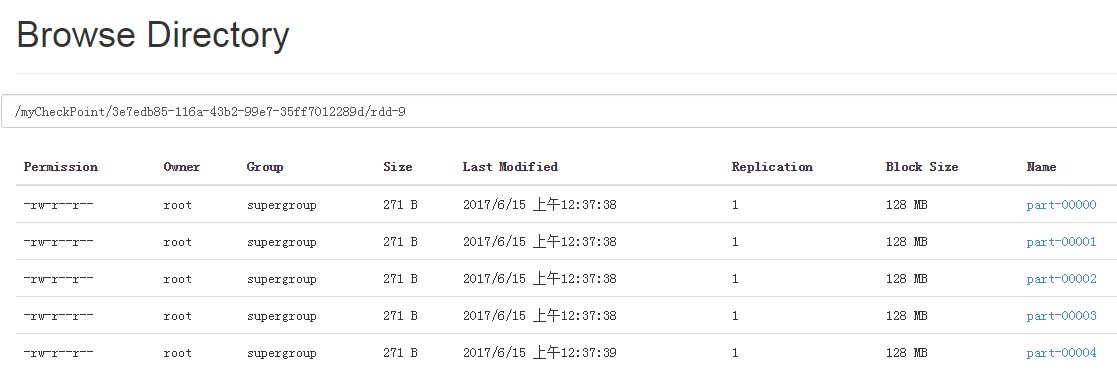

6、检查点

将生成的RDD保存到外部可靠的存储当中,对于一些数据跨度为多个bactch的有状态tranformation操作来说,checkpoint非常有必要,因为在这些transformation操作生成的RDD对前一RDD有依赖,随着时间的增加,依赖链可能会非常长,checkpoint机制能够切断依赖链,将中间的RDD周期性地checkpoint到可靠存储当中,从而在出错时可以直接从checkpoint点恢复。

val data = sc.parallelize(1 to 100 , 5)

sc.setCheckpointDir("/myCheckPoint")

data.checkpoint

data.count

7、cogroup组合

将多个RDD中同一个Key对应的Value组合到一起。

scala> val data1 = sc.parallelize(List((1, "www"), (2, "bbs")))

scala> val data2 = sc.parallelize(List((1, "iteblog"), (2, "iteblog"), (3, "very")))

scala> val data3 = sc.parallelize(List((1, "com"), (2, "com"), (3, "good")))

scala> val result = data1.cogroup(data2, data3)

scala> result.collect

res30: Array[(Int, (Iterable[String], Iterable[String], Iterable[String]))] =

Array((1,(CompactBuffer(www),CompactBuffer(iteblog),CompactBuffer(com))),

(2,(CompactBuffer(bbs),CompactBuffer(iteblog),CompactBuffer(com))),

(3,(CompactBuffer(),CompactBuffer(very),CompactBuffer(good))))

8、广播变量

广播变量是通过调用sparkcontext从变量v创建。广播变量是V的包装器,它的值可以通过调用值方法来访问。下面的代码显示了这一点:

scala> val broadcastVar = sc.broadcast(Array(1, 2, 3))

broadcastVar: org.apache.spark.broadcast.Broadcast[Array[Int]] = Broadcast(0)

scala> broadcastVar.value

res0: Array[Int] = Array(1, 2, 3)

在创建广播变量之后,应该使用它在集群上运行的任何函数中代替V值,这样v就不会不止一次地发送到节点。此外,对象v在广播之后不应该被修改,以确保所有节点获得相同的广播变量值(例如,如果变量稍后被运送到新节点)。

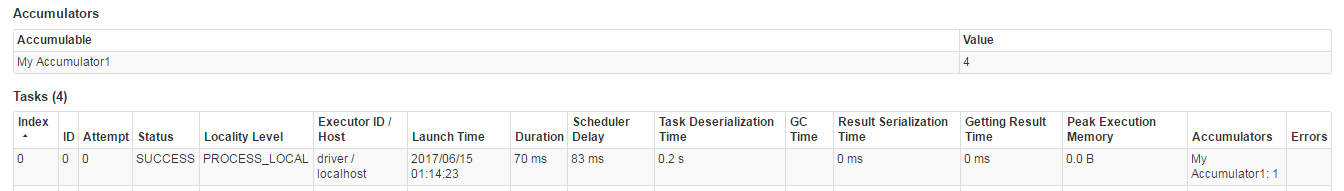

9、累加器

累加器一般用来累计和计数

val accum = sc.longAccumulator("My Accumulator")

//计数

sc.parallelize(Array(1, 2, 3, 4)).foreach(x => accum.add(1))

accum.value

res1: Long = 4

//累加

sc.parallelize(Array(1, 2, 3, 4)).foreach(x => accum.add(x))

accum.value

res2: Long = 10

Spark基础脚本入门实践2:基础开发的更多相关文章

- Spark基础脚本入门实践3:Pair RDD开发

Pair RDD转化操作 val rdd = sc.parallelize(List((1,2),(3,4),(3,6))) //reduceByKey,通过key来做合并val r1 = rdd.r ...

- Spark基础脚本入门实践1

1.创建数据框架 Creating DataFrames val df = spark.read.json("file:///usr/local/spark/examples/src/mai ...

- cmd 与 bash 基础命令入门

身为一个程序员会用命令行来进行一些简单的操作,不是显得很装逼嘛!?嘿嘿~ ヾ(>∀<) cmd 与 bash 基础命令入门 简介 CMD 基础命令 ...

- 零基础入门微信小程序开发

注:本文来源于:<零基础入门微信小程序开发> 课程介绍 本达人课是一个系列入门教程,目标是从 0 开始带领读者上手实战,课程以微信小程序的核心概念作为主线,介绍配置文件.页面样式文件.Ja ...

- 0.Python 爬虫之Scrapy入门实践指南(Scrapy基础知识)

目录 0.0.Scrapy基础 0.1.Scrapy 框架图 0.2.Scrapy主要包括了以下组件: 0.3.Scrapy简单示例如下: 0.4.Scrapy运行流程如下: 0.5.还有什么? 0. ...

- 006 01 Android 零基础入门 01 Java基础语法 01 Java初识 06 使用Eclipse开发Java程序

006 01 Android 零基础入门 01 Java基础语法 01 Java初识 06 使用Eclipse开发Java程序 Eclipse下创建程序 创建程序分为以下几个步骤: 1.首先是创建一个 ...

- 快速入门系列--WebAPI--01基础

ASP.NET MVC和WebAPI已经是.NET Web部分的主流,刚开始时两个公用同一个管道,之后为了更加的轻量化(WebAPI是对WCF Restful的轻量化),WebAPI使用了新的管道,因 ...

- CTF入门指南(0基础)

ctf入门指南 如何入门?如何组队? capture the flag 夺旗比赛 类型: Web 密码学 pwn 程序的逻辑分析,漏洞利用windows.linux.小型机等 misc 杂项,隐写,数 ...

- IM开发者的零基础通信技术入门(二):通信交换技术的百年发展史(下)

1.系列文章引言 1.1 适合谁来阅读? 本系列文章尽量使用最浅显易懂的文字.图片来组织内容,力求通信技术零基础的人群也能看懂.但个人建议,至少稍微了解过网络通信方面的知识后再看,会更有收获.如果您大 ...

随机推荐

- 使用__slots__节省python内存技巧

__slots__作用 __slots__有一个作用是:限制类实例绑定的属性,但是它有一个更重要的作用就是节省内存,当然更适用于数据量大的情况(万量级以上). __slots__节省内存的原理 cla ...

- linux环境:创建数据库用户,表空间,启动数据库

1.启动数据库 首先使用oracle用户登录Linux,然后在shell命令行中执行下面的命令:第一步:打开Oracle监听(先查看状态:oracle监听是否启动:lsnrctl status)$ l ...

- [leetcode]52. N-Queens II N皇后

The n-queens puzzle is the problem of placing n queens on an n×n chessboard such that no two queens ...

- leveldb 学习记录(五)SSTable格式介绍

本节主要记录SSTable的结构 为下一步代码阅读打好基础,考虑到已经有大量优秀博客解析透彻 就不再编写了 这里推荐 https://blog.csdn.net/tankles/article/det ...

- python 用文本来提供输入信息的模板,不用每次都手动粘贴了

#下面这一段用一个txt来保存input的信息来模拟input.最后提交代码时候删除这一段即可. a9999=open('1.txt','r') def input(): return a9999.r ...

- 必须知道的Spring Boot中的一些Controller注解

这篇文章是抄其他人的,原址:https://cloud.tencent.com/developer/article/1082720 本文旨在向你介绍在Spring Boot中controller中最基 ...

- java多线程系列13 设计模式 Future 模式

Future 模式 类似于ajax请求 页面异步的进行后台请求 用户无需等待请求的结果 就可以继续浏览或者操作 核心就是:去除了主函数的等待时间,并使得原本需要等待的时间段可以用于处理其他业务逻辑 ...

- PowerShell 命令行调试指引(转)

How to manage a debugging session Before you start debugging, you must set one or more breakpoints. ...

- Struts2学习第三天——保存登陆信息及数据校验

在JSP中服务器端保存数据的作用域通常有request.session.application,它们对应的Servlet API分别是HttpServletRquerst.HttpSession.Se ...

- electron、vue.js、vuex、element-ui、sqlite3

总结一下这两周的入门之路. 1.安装node.js 过程就是下载:https://nodejs.org/en/,安装,完了在命令行窗口,在任何目录下都可录入node -v应能看到类似反馈 如果提示&q ...