pytorch0.4版的CNN对minist分类

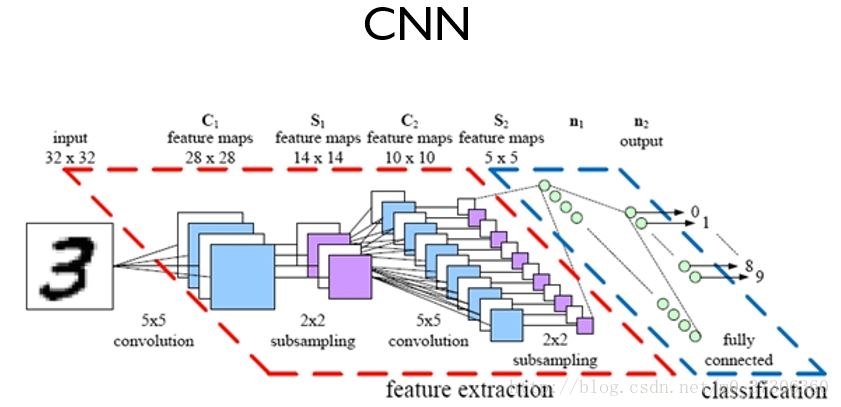

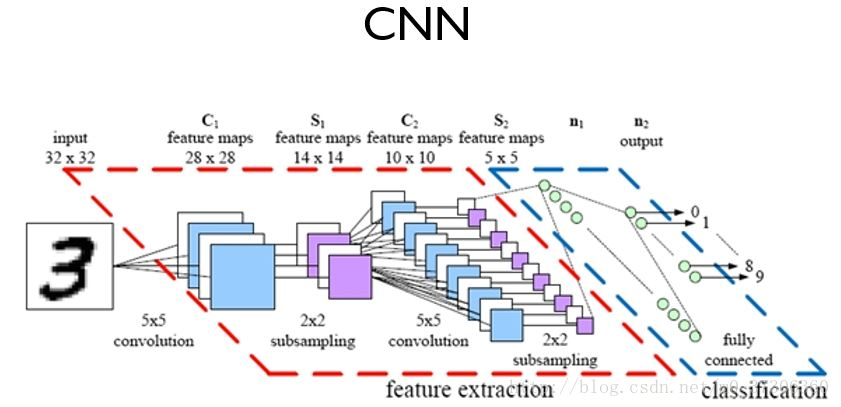

卷积神经网络(Convolutional Neural Network, CNN)是深度学习技术中极具代表的网络结构之一,在图像处理领域取得了很大的成功,在国际标准的ImageNet数据集上,许多成功的模型都是基于CNN的。

卷积神经网络CNN的结构一般包含这几个层:

- 输入层:用于数据的输入

- 卷积层:使用卷积核进行特征提取和特征映射

- 激励层:由于卷积也是一种线性运算,因此需要增加非线性映射

- 池化层:进行下采样,对特征图稀疏处理,减少数据运算量。

- 全连接层:通常在CNN的尾部进行重新拟合,减少特征信息的损失

- 输出层:用于输出结果

用pytorch0.4 做的cnn网络做的minist 分类,代码如下:

import torch

import torch.nn as nn

import torch.nn.functional as F

import torch.optim as optim

from torchvision import datasets, transforms

from torch.autograd import Variable # Training settings

batch_size = 64 # MNIST Dataset

train_dataset = datasets.MNIST(root='./data/',train=True,transform=transforms.ToTensor(),download=True)

test_dataset = datasets.MNIST(root='./data/',train=False,transform=transforms.ToTensor()) # Data Loader (Input Pipeline)

train_loader = torch.utils.data.DataLoader(dataset=train_dataset,batch_size=batch_size,shuffle=True)

test_loader = torch.utils.data.DataLoader(dataset=test_dataset,batch_size=batch_size,shuffle=False) class Net(nn.Module):

def __init__(self):

super(Net, self).__init__()

# 输入1通道,输出10通道,kernel 5*5

self.conv1 = nn.Conv2d(1, 10, kernel_size=5) # 定义conv1函数的是图像卷积函数:输入为图像(1个频道,即灰度图),输出为 10张特征图, 卷积核为5x5正方形

self.conv2 = nn.Conv2d(10, 20, kernel_size=5) # # 定义conv2函数的是图像卷积函数:输入为10张特征图,输出为20张特征图, 卷积核为5x5正方形

self.mp = nn.MaxPool2d(2)

# fully connect

self.fc = nn.Linear(320, 10) def forward(self, x):

# in_size = 64

in_size = x.size(0) # one batch

# x: 64*10*12*12

x = F.relu(self.mp(self.conv1(x)))

# x: 64*20*4*4

x = F.relu(self.mp(self.conv2(x)))

# x: 64*320

x = x.view(in_size, -1) # flatten the tensor

# x: 64*10

x = self.fc(x)

return F.log_softmax(x,dim=0) model = Net()

optimizer = optim.SGD(model.parameters(), lr=0.01, momentum=0.5) def train(epoch):

for batch_idx, (data, target) in enumerate(train_loader):

data, target = Variable(data), Variable(target)

optimizer.zero_grad()

output = model(data)

loss = F.nll_loss(output, target)

loss.backward()

optimizer.step()

if batch_idx % 200 == 0:

print('Train Epoch: {} [{}/{} ({:.0f}%)]\tLoss: {:.6f}'.format(

epoch, batch_idx * len(data), len(train_loader.dataset),

100. * batch_idx / len(train_loader), loss.item())) def test():

test_loss = 0

correct = 0

for data, target in test_loader:

data, target = Variable(data), Variable(target)

output = model(data)

# sum up batch loss

#test_loss += F.nll_loss(output, target, size_average=False).item()

test_loss += F.nll_loss(output, target, reduction = 'sum').item()

# get the index of the max log-probability

pred = output.data.max(1, keepdim=True)[1]

correct += pred.eq(target.data.view_as(pred)).cpu().sum() test_loss /= len(test_loader.dataset)

print('\nTest set: Average loss: {:.4f}, Accuracy: {}/{} ({:.0f}%)\n'.format(

test_loss, correct, len(test_loader.dataset),

100. * correct / len(test_loader.dataset))) if __name__=="__main__":

for epoch in range(1, 4):

train(epoch)

test()

运行效果如下:

Train Epoch: [/ (%)] Loss: 4.163342

Train Epoch: [/ (%)] Loss: 2.689871

Train Epoch: [/ (%)] Loss: 2.553686

Train Epoch: [/ (%)] Loss: 2.376630

Train Epoch: [/ (%)] Loss: 2.321894 Test set: Average loss: 2.2703, Accuracy: / (%) Train Epoch: [/ (%)] Loss: 2.321601

Train Epoch: [/ (%)] Loss: 2.293680

Train Epoch: [/ (%)] Loss: 2.377935

Train Epoch: [/ (%)] Loss: 2.150829

Train Epoch: [/ (%)] Loss: 2.201805 Test set: Average loss: 2.1848, Accuracy: / (%) Train Epoch: [/ (%)] Loss: 2.238524

Train Epoch: [/ (%)] Loss: 2.224833

Train Epoch: [/ (%)] Loss: 2.240626

Train Epoch: [/ (%)] Loss: 2.217183

Train Epoch: [/ (%)] Loss: 2.357141 Test set: Average loss: 2.1426, Accuracy: / (%)

pytorch0.4版的CNN对minist分类的更多相关文章

- 深度学习之 cnn 进行 CIFAR10 分类

深度学习之 cnn 进行 CIFAR10 分类 import torchvision as tv import torchvision.transforms as transforms from to ...

- 使用CNN做文本分类——将图像2维卷积换成1维

使用CNN做文本分类 from __future__ import division, print_function, absolute_import import tensorflow as tf ...

- Tensorflow&CNN:裂纹分类

版权声明:本文为博主原创文章,转载 请注明出处:https://blog.csdn.net/sc2079/article/details/90478551 - 写在前面 本科毕业设计终于告一段落了.特 ...

- TensorFlow实现多层感知机MINIST分类

TensorFlow实现多层感知机MINIST分类 TensorFlow 支持自动求导,可以使用 TensorFlow 优化器来计算和使用梯度.使用梯度自动更新用变量定义的张量.本文将使用 Tenso ...

- 如何基于TensorFlow使用LSTM和CNN实现时序分类任务

https://www.jiqizhixin.com/articles/2017-09-12-5 By 蒋思源2017年9月12日 09:54 时序数据经常出现在很多领域中,如金融.信号处理.语音识别 ...

- 利用CNN进行多分类的文档分类

# coding: utf-8 import tensorflow as tf class TCNNConfig(object): """CNN配置参数"&qu ...

- TensorFlow基础笔记(2) minist分类学习

(1) 最简单的神经网络分类器 # encoding: UTF-8 import tensorflow as tf from tensorflow.examples.tutorials.mnist i ...

- 用keras的cnn做人脸分类

keras介绍 Keras是一个简约,高度模块化的神经网络库.采用Python / Theano开发. 使用Keras如果你需要一个深度学习库: 可以很容易和快速实现原型(通过总模块化,极简主义,和可 ...

- 深度学习原理与框架-CNN在文本分类的应用 1.tf.nn.embedding_lookup(根据索引数据从数据中取出数据) 2.saver.restore(加载sess参数)

1. tf.nn.embedding_lookup(W, X) W的维度为[len(vocabulary_list), 128], X的维度为[?, 8],组合后的维度为[?, 8, 128] 代码说 ...

随机推荐

- kickstart-G

感觉自己很蠢,large数据只能交一次,忘记这回事了 A题 O(n^2)解法,用vector<set> 缓存j后面的数据,减少一重循环 #include <string> #i ...

- Tarjan算法【强连通分量】

转自:byvoid:有向图强连通分量的Tarjan算法 Tarjan算法是基于对图深度优先搜索的算法,每个强连通分量为搜索树中的一棵子树.搜索时,把当前搜索树中未处理的节点加入一个堆栈,回溯时可以判断 ...

- BZOJ 4282(慎二的随机数列

题解: 网上题解还没看 我的方法是用平衡树维护一个单调栈 由于N用了一定是赚的 所以它的作用是让f[i+1]=f[i]+1 这个是可以记录的 就跟noip蚯蚓那题一样 然后插入一个值的时候查询前面的最 ...

- IOS内存约定-【ios】

IOS中内存采用引用计数的方式,在释放内存编程时采用约定的方式,在这里不长篇大论具体内存的原理,只从实用角度出发记录下如何根据这些约定来释放内存. 具体约定为: 当你使用new.alloc.copy ...

- python全栈开发day52-bootstrap的运用

1. css样式 2. 插件 3. 创建一个项目的步骤 1) npm init --yes 或 npm init -y npm init npm init:这个命令用于创建一个package.js ...

- net core体系-web应用程序-4net core2.0大白话带你入门-2asp.net core新建项目

新建asp.net core项目 开发环境:Windows Server R2 2008 开发工具:Microsoft Visual Studio 2017 新建asp.net core项目 创建 ...

- Python自用笔记

函数:raw_input()和input() 注意:在python3.x中,已经删除raw_input(),取而代之的是input(),当然这仅仅是重命名,用法还是一样.因此在这里介绍的是python ...

- Python中GIL

GIL(global interpreter lock)全局解释器锁 python中GIL使得同一个时刻只有一个线程在一个cpu上执行,无法将多个线程映射到多个cpu上执行,但GIL并不会一直占有,它 ...

- appium-电脑连不上手机设备如何解决

在自动化过程中,会遇到电脑无法连接到手机情况,首先在cmd命令输入adb devices查看是否报错,报错绝大可能是5037端口被占用了,因为adb默认绑定的是5037端口 1.查看占用端口的进程PI ...

- IDEA快速入门(Mac版)

[持续更新]一篇今年年头的老文章顺道发布了,大家有任何问题可以留言沟通.当时刚刚加入团团,愿大家有机会还是购买一台MAC,确实能给大家的效率赋能,虽然在一开始会有一些艰难!⛽️ 望借着换工作的东风,好 ...