Tensorflow神经网络进行fiting function

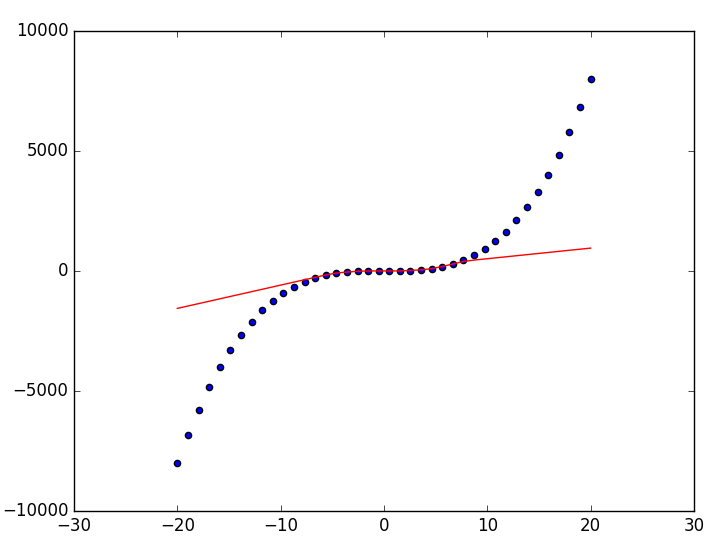

使用Tensorflow中的神经网络来拟合函数(y = x ^ 3 + 0.7)

# -*- coding:utf-8 -*-

import tensorflow as tf

import numpy as np

import matplotlib.pyplot as plt #训练数据

x_data = np.linspace(-6.0,6.0,30)[:,np.newaxis]

y_data = np.power(x_data,3) + 0.7

#验证数据

t_data = np.linspace(-20.0,20.0,40)[:,np.newaxis]

ty_data = np.power(t_data,3) + 0.7

#占位符

x = tf.placeholder(tf.float32,[None,1])

y = tf.placeholder(tf.float32,[None,1]) #network

#--layer one--

l_w_1 = tf.Variable(tf.random_normal([1,10]))

l_b_1 = tf.Variable(tf.zeros([1,10]))

l_fcn_1 = tf.matmul(x, l_w_1) + l_b_1

relu_1 = tf.nn.relu(l_fcn_1)

#---layer two----

l_w_2 = tf.Variable(tf.random_normal([10,20]))

l_b_2 = tf.Variable(tf.zeros([1,20]))

l_fcn_2 = tf.matmul(relu_1, l_w_2) + l_b_2

relu_2 = tf.nn.relu(l_fcn_2) #---output---

l_w_3 = tf.Variable(tf.random_normal([20,1]))

l_b_3 = tf.Variable(tf.zeros([1,1]))

l_fcn_3 = tf.matmul(relu_2, l_w_3) + l_b_3

#relu_3 = tf.tanh(l_fcn_3)

# init

init = tf.global_variables_initializer()

#定义 loss func

loss = tf.reduce_mean(tf.square(y-l_fcn_3))

learn_rate =0.001

train_step = tf.train.GradientDescentOptimizer(learn_rate).minimize(loss) with tf.Session() as sess:

sess.run(init);

for epoch in range(20):

for step in range(5000):

sess.run(train_step,feed_dict={x:x_data,y:y_data})

y_pred = sess.run(l_fcn_3,feed_dict={x:t_data})

print sess.run(l_fcn_3,feed_dict={x:[[10.]]})

plt.figure()

plt.scatter(t_data,ty_data)

plt.plot(t_data,y_pred,'r-')

plt.show()

实验结果

Tensorflow神经网络进行fiting function的更多相关文章

- TensorFlow神经网络集成方案

TensorFlow神经网络集成方案 创造张力流create_tensorflow_neuropod 将TensorFlow模型打包为neuropod包. create_tensorflow_neur ...

- TensorFlow 神经网络教程

TensorFlow 是一个用于机器学习应用程序的开源库.它是谷歌大脑的第二代系统,在取代了近源的 DistBelief 之后,被谷歌用于研究和生产应用.TensorFlow 提供了很多种语言接口,包 ...

- 【Magenta 项目初探】手把手教你用Tensorflow神经网络创造音乐

原文链接:http://www.cnblogs.com/learn-to-rock/p/5677458.html 偶然在网上看到了一个让我很感兴趣的项目 Magenta,用Tensorflow让神经网 ...

- Tensorflow 神经网络

Tensorflow让神经网络自动创造音乐 前几天看到一个有意思的分享,大意是讲如何用Tensorflow教神经网络自动创造音乐.听起来好好玩有木有!作为一个Coldplay死忠粉,第一想法就是自动生 ...

- 学习笔记TF055:TensorFlow神经网络简单实现一元二次函数

TensorFlow运行方式.加载数据.定义超参数,构建网络,训练模型,评估模型.预测. 构造一个满足一元二次函数y=ax^2+b原始数据,构建最简单神经网络,包含输入层.隐藏层.输出层.Tensor ...

- TensorFlow 神经网络相关函数

TensorFlow 激活函数 激活操作提供用于神经网络的不同类型的非线性.这些包括平滑的非线性(sigmoid,tanh,elu,softplus,和softsign),连续的,但不是到处可微函数( ...

- tensorflow神经网络拟合非线性函数与操作指南

本实验通过建立一个含有两个隐含层的BP神经网络,拟合具有二次函数非线性关系的方程,并通过可视化展现学习到的拟合曲线,同时随机给定输入值,输出预测值,最后给出一些关键的提示. 源代码如下: # -*- ...

- tflearn tensorflow LSTM predict sin function

from __future__ import division, print_function, absolute_import import tflearn import numpy as np i ...

- TensorFlow神经网络中的激活函数

激活函数是人工神经网络的一个极其重要的特征.它决定一个神经元是否应该被激活,激活代表神经元接收的信息与给定的信息有关. 激活函数对输入信息进行非线性变换. 然后将变换后的输出信息作为输入信息传给下一层 ...

随机推荐

- python学习之运算表达式优先级

python中,有变量.值和运算符参与的语句叫做表达式. 比如: #字符串表达式 "hello" #运算表达式 + #赋值表达式 test = "hello" ...

- tensolrflow之基础变量

#优化一个乘法算子 #coding:utf- __author__ = 'similarface' import tensorflow as tf sess=tf.Session() #创建一个常量张 ...

- CSS学习笔记(3)--表格边框

http://www.alixixi.com/web/a/2009082657736.shtml 对于很多初学HTML的人来说,表格<table>是最常用的标签了,但对于表格边框的控制,很 ...

- javascript属性详解

在js中,没有公共属性和私有属性之分,只有全局变量(全局属性)和局部变量以及对象属性.但是,程序员可以通过一定的技巧来实现面向对象语言的功能.下面我们来介绍这几种属性(变量) 全局变量也叫全局属性 / ...

- 善用php-fpm的慢执行日志slow log,分析php性能问题

众所周知,mysql有slow query log,根据慢查询日志,我们可以知道那些sql语句有性能问题.作为mysql的好搭档,php也有这样的功能.如果你使用php-fpm来管理php的话,你可以 ...

- 第一百五十五节,封装库--JavaScript,轮播器

封装库--JavaScript,轮播器 html <div id="banner"> <img src="img/banner1.jpg" a ...

- Servlet Servlet是Java平台上的CGI技术

Servlet Servlet是Java平台上的CGI技术.Servlet在服务器端运行,动态地生成Web页面.与传统的CGI和许多其它类似CGI的技术相比,Java Servlet具有更高的效率并更 ...

- 哈希表类Hashtable

哈希表是一种重要的存储方式,也是一种常见的检索方法.其基本思想是将关系码的值作为自变量,通过一定的函数关系计算出对应的函数值,把这个数值解释为结点的存储地址,将结点存入计算得到存储地址所对应的存储单元 ...

- 嵌入式开发之davinci--- MSB和LSB

简介: MSB是Most Significant Bit的缩写,最高有效位.在二进制数中,MSB是最高加权位.与十进制数字中最左边的一位类似.通常,MSB位于二进制数的最左侧,LSB位于二进制数的最右 ...

- 【PyQt】算法-插入、递归、冒泡

# coding=utf-8 import sys from PyQt4.QtGui import * from PyQt4.QtCore import * class MainWindow(QMai ...