[会装]Spark standalone 模式的安装

1. 简介

以standalone模式安装spark集群bin运行demo。

2.环境和介质准备

2.1 下载spark介质,根据现有hadoop的版本选择下载,我目前的环境中的hadoop版本是2.6,所以下载spark-2.0.0-bin-hadoop2.6.tgz

当然你也可以下载源码自行根据hadoop版本进行编译,这里不再赘述。

地址:http://ftp.cuhk.edu.hk/pub/packages/apache.org/spark/spark-2.0.0/

2.2 环境准备

| 主机名称 | 进程名称 |

| xufeng-1 | work |

| xufeng-2 | work |

| xufeng-3 | master |

3. 安装步骤:

【以下步骤不单独说明所有主机都需要执行】

步骤 1:将介质包拷贝到服务器上,并将配置文件和bin文件分开。

可以看到spark目录使用了软连接,配置文件被单独放在了spark-config中,这样做的目的是便于升级。

步骤 2:设定环境变量.

在~/.bash_profile文件中增加如下信息:

#spark

export SPARK_HOME=/opt/hadoop/spark

export SPARK_CONF_DIR=/opt/hadoop/spark-config PATH=$PATH:$HOME/bin:$JAVA_HOME/bin:$HADOOP_HOME/bin:$HADOOP_HOME/sbin:$HBASE_HOME/bin:$ZOOKEEPER_HOME/bin:$SPARK_HOME/bin:$SPARK_HOME/sbin

步骤 3:配置slaves:

打开spark-config目录下的slaves文件将work部署的主机名信息写入:

# A Spark Worker will be started on each of the machines listed below.

xufeng-

xufeng-

步骤 4:配置javahome

打开spark-config目录下的spark-env.sh文件,设定如下信息(根据自己的java路径信息):

# - SPARK_NICENESS The scheduling priority for daemons. (Default: )

export JAVA_HOME=/opt/hadoop/java/jdk1..0_79

4. 启动集群

4.1 登录上master节点,也就是xufeng-3节点,进入spark/sbin目录,执行

./start-all.sh ------- spark的脚本和hadoop的脚本是同名的,如果我们直接执行start-all.sh,那么很有可能执行的是hadoop的脚本,所以这里进入spark安装目录,具体调用他的脚本

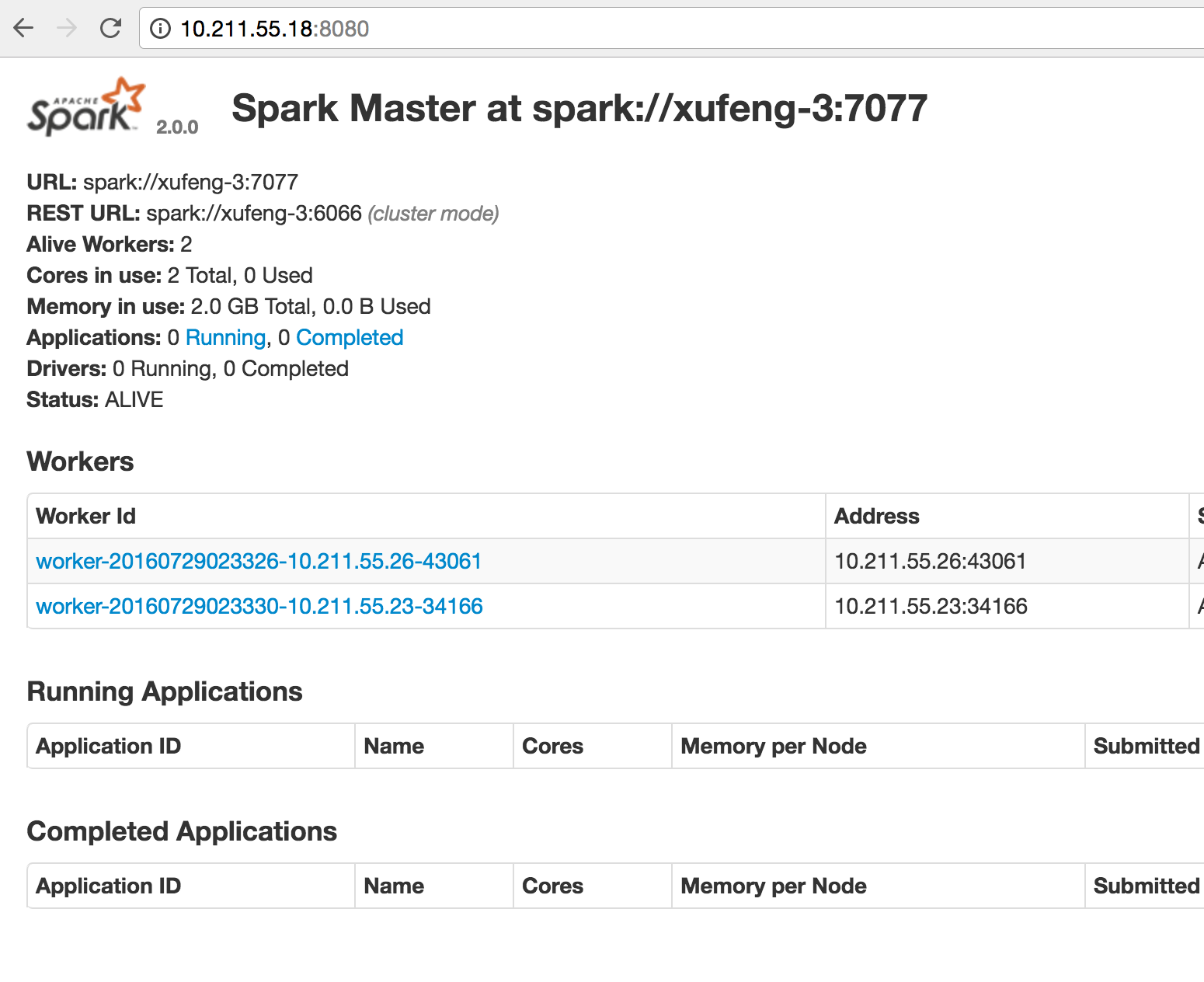

4.2 检查Master 的 webUI

以上Mater和worker在standalone模式中就是一个资源管理器系统,分配app的资源使用或者我们可以直接说他是一个【Cluster Manager】。

在其他模式中,如在YARN模式中资源的分配就交给YARN去处理,YARN集群就是【Cluster Manager】角色了。

5. 验证

进入spark-shell 简单的去执行一个任务用于验证

如果不知道后续参数,那么这个shell将会在本地执行,在Mater页面上是看不到信息的。

spark-shell --master spark://xufeng-3:7077 --executor-memory 500M

1.创建一个rdd

scala> val rdd = sc.parallelize(List(,,,,,))

2.执行两次count和一次collect操作(action操作)

scala> rdd.count()

res0: Long = scala> rdd.count()

res1: Long = scala> rdd.collect

res2: Array[Int] = Array(, , , , , )

查看页面监控:

以上,standalone模式安装完毕。

[会装]Spark standalone 模式的安装的更多相关文章

- Spark standalone模式的安装(spark-1.6.1-bin-hadoop2.6.tgz)(master、slave1和slave2)

前期博客 Spark运行模式概述 Spark standalone简介与运行wordcount(master.slave1和slave2) 开篇要明白 (1)spark-env.sh 是环境变量配 ...

- 大数据学习day18----第三阶段spark01--------0.前言(分布式运算框架的核心思想,MR与Spark的比较,spark可以怎么运行,spark提交到spark集群的方式)1. spark(standalone模式)的安装 2. Spark各个角色的功能 3.SparkShell的使用,spark编程入门(wordcount案例)

0.前言 0.1 分布式运算框架的核心思想(此处以MR运行在yarn上为例) 提交job时,resourcemanager(图中写成了master)会根据数据的量以及工作的复杂度,解析工作量,从而 ...

- 【原】Spark Standalone模式

Spark Standalone模式 安装Spark Standalone集群 手动启动集群 集群创建脚本 提交应用到集群 创建Spark应用 资源调度及分配 监控与日志 与Hadoop共存 配置网络 ...

- Spark Standalone模式应用程序开发

作者:过往记忆 | 新浪微博:左手牵右手TEL | 能够转载, 但必须以超链接形式标明文章原始出处和作者信息及版权声明博客地址:http://www.iteblog.com/文章标题:<Spar ...

- 关于spark standalone模式下的executor问题

1.spark standalone模式下,worker与executor是一一对应的. 2.如果想要多个worker,那么需要修改spark-env的SPARK_WORKER_INSTANCES为2 ...

- Spark Standalone模式HA环境搭建

Spark Standalone模式常见的HA部署方式有两种:基于文件系统的HA和基于ZK的HA 本篇只介绍基于ZK的HA环境搭建: $SPARK_HOME/conf/spark-env.sh 添加S ...

- spark standalone模式单节点启动多个executor

以前为了在一台机器上启动多个executor都是通过instance多个worker来实现的,因为standalone模式默认在一台worker上启动一个executor,造成了很大的不便利,并且会造 ...

- Spark Standalone模式伪分布式环境搭建

前提:安装好jdk1.7,hadoop 安装步骤: 1.安装scala 下载地址:http://www.scala-lang.org/download/ 配置环境变量: export SCALA_HO ...

- Spark Standalone模式 高可用部署

本文使用Spark的版本为:spark-2.4.0-bin-hadoop2.7.tgz. spark的集群采用3台机器进行搭建,机器分别是server01,server02,server03. 其 ...

随机推荐

- 【题解】HNOI2018转盘

何学长口中所说的‘一眼题’……然而实际上出出来我大HN全省也只有一个人A…… 首先我们需要发现一个性质:我们永远可以在最后一圈去标记所有的物品.倘若我们反复转圈,那么这完全是可以省下来的.所以我们破环 ...

- [LOJ#2542] [PKUWC2018] 随机游走

题目描述 给定一棵 n 个结点的树,你从点 x 出发,每次等概率随机选择一条与所在点相邻的边走过去. 有 Q 次询问,每次询问给定一个集合 S,求如果从 x 出发一直随机游走,直到点集 S 中所有点都 ...

- [洛谷P4092][HEOI2016/TJOI2016]树

题目大意:给你一棵树,有两个操作: $C\;x:$给第$x$个节点打上标记 $Q\;x:$询问第$x$个节点的祖先中最近的打过标记的点(自己也是自己的祖先) 题解:树剖,可以维护区间或,然后若一段区间 ...

- POJ1273:Drainage Ditches——题解

http://poj.org/problem?id=1273 题目大意: n点m边网络流,求1-n最大流. —————————————— 网络流板子,切了. #include <cstdio&g ...

- 51NOD 2026:Gcd and Lcm——题解

http://www.51nod.com/onlineJudge/questionCode.html#!problemId=2026 参考及推导:https://www.cnblogs.com/ivo ...

- [Leetcode] combination sum ii 组合之和

Given a collection of candidate numbers ( C ) and a target number ( T), find all unique combinations ...

- 剑桥offer(21~30)

21.题目描述 输入一个字符串,按字典序打印出该字符串中字符的所有排列.例如输入字符串abc,则打印出由字符a,b,c所能排列出来的所有字符串abc,acb,bac,bca,cab和cba. 还不 ...

- JQuery选择符的理解与应用

JQuery强大的选择符可以让我们获得页面中任何元素进行操作,并且使用简单方便,可读性强.本章内容根据本人在开发中常用到的选择符作为例子来进行讲解,如有更多常用的简单的例子可回复提供,参与讨论,一起学 ...

- angularJS前端分页插件

首先在项目中引入 分页插件的 js 和 css: 在html页面引入 相关js 和 css: 在控制器中引入分页插件中定义的 module[可以打开pagination.js查看,可以看到 其实,在插 ...

- 2018 BAT最新《前端必考面试题》

2018 BAT最新<前端必考面试题> 1.Doctype作用? 严格模式与混杂模式如何区分?它们有何意义? (1). 声明位于文档中的最前面,处于 标签之前.告知浏览器的解析器,用什么文 ...