python的爬虫

requests库的安装

https://blog.csdn.net/xiaokuang5020/article/details/80580631

Response对象属性

属性 说明

r.status_code HTTP请求的返回状态,200表示连接成功,404表示失败

r.text HTTP响应内容的字符串形式,即,url对应的页面内容

r.encoding 从HTTP Header中猜测的响应内容编码方式

r.apparent_encoding 从内容中分析出的响应内容编码方式(备选编码方式)

r.content HTTP响应内容的二进制形式

Requests库的7个主要方法

方法 说明

requests.request( ) 构造一个请求,支撑以下各方法的基础方法

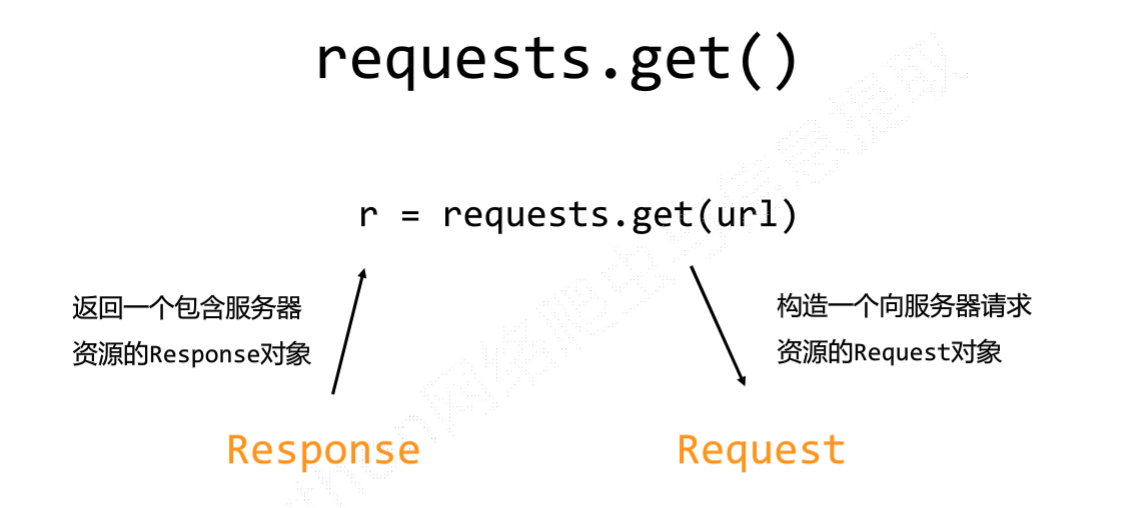

requests.get() 获取HTML网页的主要方法,对应于HTTP的GET

requests.head() 获取HTML网页头信息的方法,对应于HTTP的HEAD

requests.post( ) 向HTML网页提交POST请求的方法,对应于HTTP的POST

requests.put( ) 向HTML网页提交PUT请求的方法,对应于HTTP的PUT

requests. patch() 向HTML网页提交局部修改请求,对应于HTTP的PATCH

requests.delete( ) 向HTML页面提交删除请求,对应于HTTP的DELETE

PS:

HTTP协议

HTTP:Hypertext Transfer Protocol , 超文本传输协议

HTTP是一个基于"请求与响应"模式的, 无状态的应用层协议

HTTP协议采用URL作为定位网络资源的标识,URL格式如下:

http://host[:port][path]

host:合法的Internet主机域名或IP地址

port:端口号,缺省端口为80

path:请求资源的路径

HTTP URL实例:

http://www.baidu.com

http://220.181.111.188/duty

HTTP URL的理解

URL是通过HTTP协议存取资源的Internet路径 , 一个URL对应一个数据资源

HTTP协议对资源的操作

方法 说明

GET 请求获取URL位置的资源

HEAD 请求获取URL位置资源的响应消息报告,即获得该资源的头部信息

POST 请求向URL位置的资源后附加新的数据

PUT 请求向URL位置存储一个资源,覆盖原URL位置的资源

PATCH 请求局部更新URL位置的资源,即改变该处资源的部分内容

DELETE 请求删除URL位置存储的资源

PATCH和PUT的区别

PATCH 仅向URL提交局部更新的要求

PUT必须将所有资源更新

PATCH的最主要好处:节省网络带宽

Requests库的异常

异常 说明

requests.ConnectionError 网络连接错误异常,如DNS查询失败,拒绝连接等

requests.HTTPError HTTP错误异常

requests.URLRequired URL缺失异常

requests.TooManyRedirects 超过最大重定向次数,产生重定向异常

requests.ConnectTimeout

requests.Timeout

1. request.get()

requests.get( url , params = None , ** Kwargs)

url : 拟获取页面的url链接

params : url中的额外参数,字典或字节流格式,可选

**Kwargs : 12个控制访问的参数

2.requests.request(method , url , **kwargs)

method:请求方式,对应get/put/post等7种

url 拟获取页面的url链接

**kwargs 控制访问的参数,共12个

method :请求方式

r = requests.request('GET' , url , **kwargs)

r = requests.request('HEAD' , url , **kwargs)

r = requests.request('POST' , url , **kwargs)

r = requests.request('PUT' , url , **kwargs)

r = requests.request('PATCH' , url , **kwargs)

r = requests.request('DELETE' , url , **kwargs)

r = requests.request('OPTIONS' , url , **kwargs)

**kwargs :控制访问的参数 ,均为可选项

params : 字典或字节排列 , 作为参数增加到url中

data 字典.字节序列或文件对象,作为Request的内容

json JSON格式的数据,作为Request的内容

headers 字典。HTTP定制头

cookies 字典或CookieJar , Request中的cookie

auth 元组,支持HTTP认证功能

files 字典类型,传输文件

timeout 设定超时时间,秒为单位

proxies 字典类型,设定访问代理服务器,可以增加登录认证

allow_redirects True/False ,默认为True , 重定向开关

stream True/False , 默认为True , 获取内容立即下载开关

verify True/False, 默认为True, 认证SSL证书开关

cert 本地SSL证书路径

3.requests.head(url , ** kwargs)

url 拟获取页面的url链接

**kwargs 控制访问的参数,共12个

4.requests.post(url , data = None , json = None , **kwargs )

url 拟获取页面的url链接

data 字典.字节序列或文件 , Request的内容

json JSON格式的数据,Request的内容

**kwargs 控制访问的参数,共12个

5.requests.put(url , data=None , ** kwargs)

url 拟获取页面的url链接

data 字典.字节序列或文件 , Request的内容

**kwargs 控制访问的参数,共12个

6.requests.patch(url , data=None , ** kwargs)

url 拟获取页面的url链接

data 字典.字节序列或文件 , Request的内容

**kwargs 控制访问的参数,共12个

7..requests.delete(url , ** kwargs)

url 拟获取页面的url链接

**kwargs 控制访问的参数,共12个

python的爬虫的更多相关文章

- Python简单爬虫入门三

我们继续研究BeautifulSoup分类打印输出 Python简单爬虫入门一 Python简单爬虫入门二 前两部主要讲述我们如何用BeautifulSoup怎去抓取网页信息以及获取相应的图片标题等信 ...

- Ubuntu下配置python完成爬虫任务(笔记一)

Ubuntu下配置python完成爬虫任务(笔记一) 目标: 作为一个.NET汪,是时候去学习一下Linux下的操作了.为此选择了python来边学习Linux,边学python,熟能生巧嘛. 前期目 ...

- Python简单爬虫入门二

接着上一次爬虫我们继续研究BeautifulSoup Python简单爬虫入门一 上一次我们爬虫我们已经成功的爬下了网页的源代码,那么这一次我们将继续来写怎么抓去具体想要的元素 首先回顾以下我们Bea ...

- [Python] 网络爬虫和正则表达式学习总结

以前在学校做科研都是直接利用网上共享的一些数据,就像我们经常说的dataset.beachmark等等.但是,对于实际的工业需求来说,爬取网络的数据是必须的并且是首要的.最近在国内一家互联网公司实习, ...

- python简易爬虫来实现自动图片下载

菜鸟新人刚刚入住博客园,先发个之前写的简易爬虫的实现吧,水平有限请轻喷. 估计利用python实现爬虫的程序网上已经有太多了,不过新人用来练手学习python确实是个不错的选择.本人借鉴网上的部分实现 ...

- GJM : Python简单爬虫入门(二) [转载]

感谢您的阅读.喜欢的.有用的就请大哥大嫂们高抬贵手"推荐一下"吧!你的精神支持是博主强大的写作动力以及转载收藏动力.欢迎转载! 版权声明:本文原创发表于 [请点击连接前往] ,未经 ...

- Python分布式爬虫原理

转载 permike 原文 Python分布式爬虫原理 首先,我们先来看看,如果是人正常的行为,是如何获取网页内容的. (1)打开浏览器,输入URL,打开源网页 (2)选取我们想要的内容,包括标题,作 ...

- Python 网页爬虫 & 文本处理 & 科学计算 & 机器学习 & 数据挖掘兵器谱(转)

原文:http://www.52nlp.cn/python-网页爬虫-文本处理-科学计算-机器学习-数据挖掘 曾经因为NLTK的缘故开始学习Python,之后渐渐成为我工作中的第一辅助脚本语言,虽然开 ...

- 关于Python网络爬虫实战笔记③

Python网络爬虫实战笔记③如何下载韩寒博客文章 Python网络爬虫实战笔记③如何下载韩寒博客文章 target:下载全部的文章 1. 博客列表页面规则 也就是, http://blog.sina ...

- 关于Python网络爬虫实战笔记①

python网络爬虫项目实战笔记①如何下载韩寒的博客文章 python网络爬虫项目实战笔记①如何下载韩寒的博客文章 1. 打开韩寒博客列表页面 http://blog.sina.com.cn/s/ar ...

随机推荐

- 关于word转化成xml,图片的转换

当word另存为xml的时候,其中的图片会以Base64编码形式展示在xml文件的特定位置, java中操作图片转换成64位编码的方式: 可将返回的64直接放在前面的未知即可:

- View-Controller-Containment

willMove(toParentViewController:) 调用时机 调用addChildViewController(_:)以钱会被自动调用 调用removeFromParentViewCo ...

- npm淘宝镜像和默认镜像切换

1.得到原本的镜像地址 npm get registry > https://registry.npmjs.org/ 设成淘宝的 npm config set registry http://r ...

- Beautiful Soup解析网页

使用前步骤: 1.Beautiful Soup目前已经被移植到bs4,所以导入Beautiful Soup时先安装bs4库. 2.安装lxml库:如果不使用此库,就会使用Python默认的解析器,而l ...

- Linux基本结构

Linux 的基本目录结构: 基本介绍: Linux 的文件系统是采用级层式的树状目录结构,在此结构中的最上层是根目录“/”,然后再次目录下载创建其他的目录. 经典的一句话:linu ...

- 逆向学习-DLL注入

DLL注入技术,可以实现钩取API,改进程序,修复Bug. DLL注入指的是向运行中的其他进程强制插入特定的DLL文件. DLL注入命令进程自行调用LoadLibrary()API,加载用户指定的DL ...

- 前端统计图 echarts 实现简单柱状图

前端统计图 echarts实现简单柱状图 1. 引入 ECharts <!DOCTYPE html> <html> <head> <meta charse ...

- App功能测试的注意点

好几个月没有写博客记录学习心得了,这次回老家深夜闲来无事写一篇记录下这段时间的面试心得,这次面试过程很多面试官都问APP的有关测试,下面我就自己的认识和工作中的经验来谈谈自己对APP测试的认识: 1. ...

- Js写九宫格抽奖

国庆出去转了一圈,回来及时把以前写的一些有用的在这儿记录一下 --------------------------------------------我是分割线-------------------- ...

- table定位

Table定位 在 web 页面中经常会遇到 table 表格,特别是后台操作页面比较常见.本篇详细讲解 table 表格如何定位. 1.1 table特性 1.table 页面查看源码一般有这几个明 ...