常用损失函数 LossFunction

文章结构

- 损失函数在神经网络中的位置

- 常用的损失函数(结构:解释,公式,缺点,适用于,pytorch 函数)

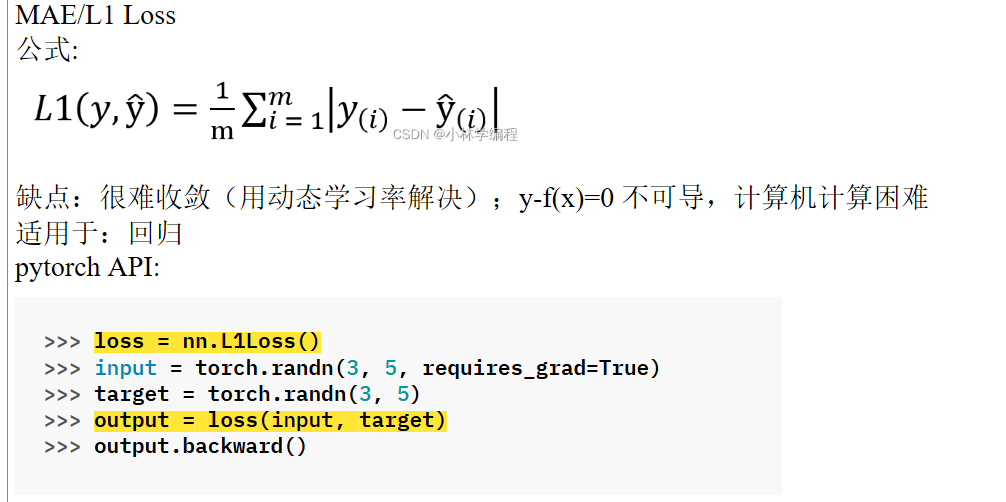

- MAE/L1 Loss

- MSE/L2 Loss

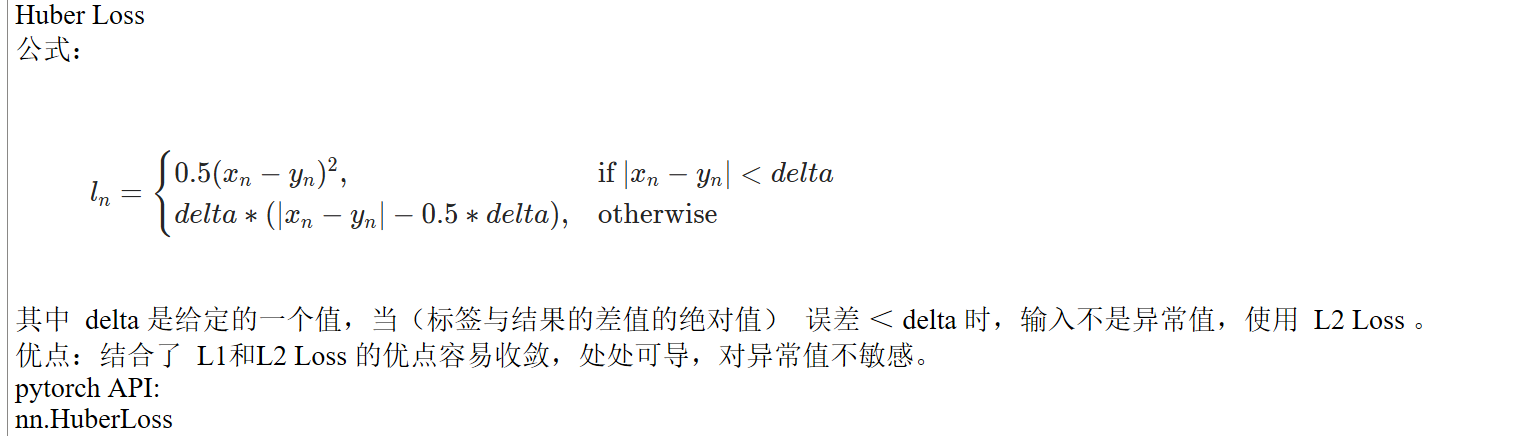

- Huber Loss

- 对信息量、熵的解释

- relative entropy 相对熵/ Kullback-Leibler KL Loss

- Cross Entropy Loss 交叉熵(包含对softmax 层的解释)

- 相对熵、熵、和交叉熵的关系

- Hinge Loss

损失函数在神经网络中的位置

forward → loss → backward

常用的损失函数

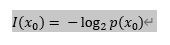

信息量

由香农引入,可以理解为对事件X发生概率的估计。一件事越经常发生,就越容易预测,它所包含的信息量就越小。

公式:

其中,  表示信息量,

表示信息量, 表示事件X中的一个种类,

表示事件X中的一个种类,  表示该种类的概率分布。

表示该种类的概率分布。

取对数  是为了方便计算,接下来都用简写

是为了方便计算,接下来都用简写 代替。

代替。

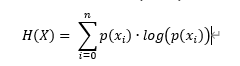

熵

每个种类的发生概率与信息量的乘积和,表示一个系统不确定性或混乱程度。

对于系统的不确定性可以理解为,由概率分布计算得到的信息量越大,表示越不容易预测,同时意味着并不遵循一定的规律,越混乱/不确定。

公式:

其中 , 表示熵,求和上标

表示熵,求和上标 表示事件X的种类/分类的个数(举例,掷硬币这一事件的种类有正、反2种),

表示事件X的种类/分类的个数(举例,掷硬币这一事件的种类有正、反2种),  表示第i种类的概率分布。

表示第i种类的概率分布。

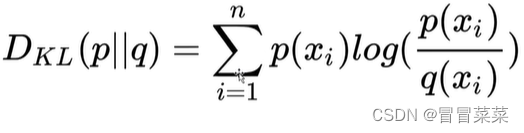

relative entropy 相对熵/ Kullback-Leibler KL Loss

、

、 为 事件X 中取值的两个概率分布,

为 事件X 中取值的两个概率分布, 对

对 的相对熵(≥ 0 ):

的相对熵(≥ 0 ):

公式引用自:http://t.csdnimg.cn/hRb5X

这里的两个概率分布可以是(由标签/target 计算得到的)真实概率 和模型预测概率

和模型预测概率 。

。

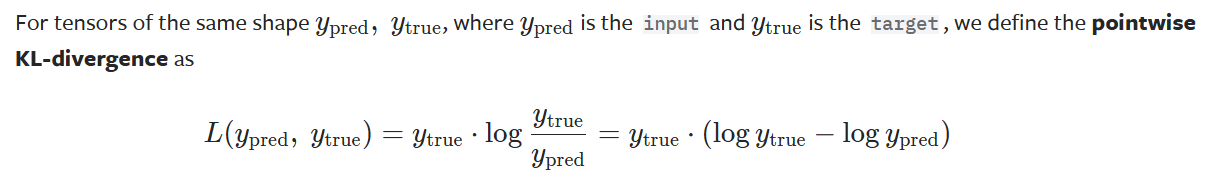

在pytorch 官方文档中 KLDivLoss — PyTorch 2.3 documentation 解释为

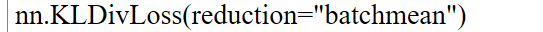

pytorch 函数:

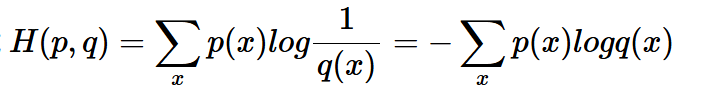

Cross Entropy Loss 交叉熵

公式:

表示 真实概率 和预测概率

和预测概率 的差距。

的差距。

公式引用自详解机器学习中的熵、条件熵、相对熵和交叉熵 - 遍地胡说 - 博客园 (cnblogs.com)

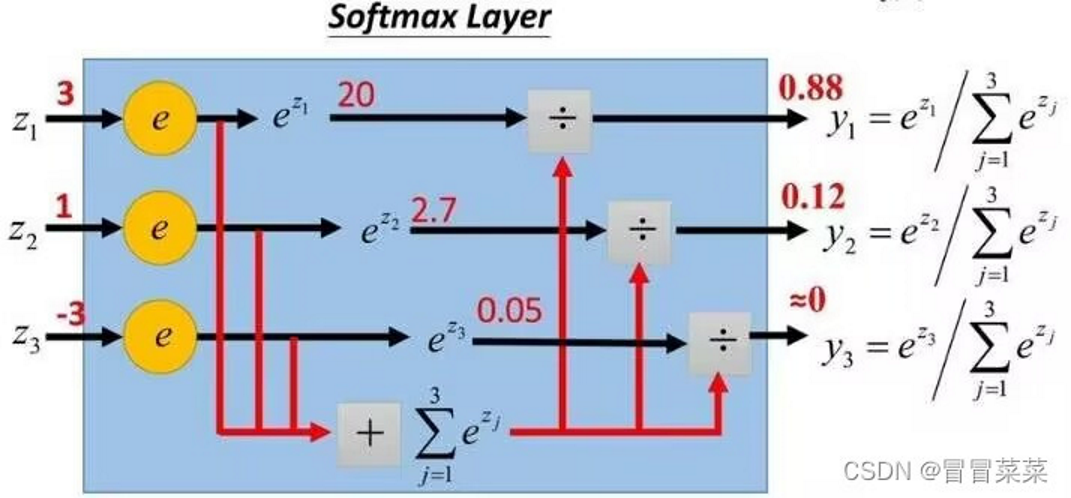

其中, 在实际运用中,由 softmax 层 计算得到 。

在实际运用中,由 softmax 层 计算得到 。

Softmax 层输出的是每个分类的概率分布,将数字转化为概率。

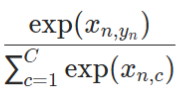

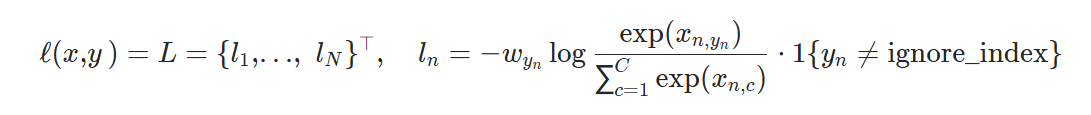

在pytorch 官方文档中,其中 是一个1D 的张量,为每个类别分配权重,C 为事件的分类总数,相当于上文中的n。

是一个1D 的张量,为每个类别分配权重,C 为事件的分类总数,相当于上文中的n。

为softmax的输出。

为softmax的输出。

适用于:分类;样本分布不平衡的训练集

pytorch 函数:

其中,官方文档解释,input不需要normalize。

常用损失函数 LossFunction的更多相关文章

- 【深度学习】一文读懂机器学习常用损失函数(Loss Function)

最近太忙已经好久没有写博客了,今天整理分享一篇关于损失函数的文章吧,以前对损失函数的理解不够深入,没有真正理解每个损失函数的特点以及应用范围,如果文中有任何错误,请各位朋友指教,谢谢~ 损失函数(lo ...

- pytorch常用损失函数

损失函数的基本用法: criterion = LossCriterion() #构造函数有自己的参数 loss = criterion(x, y) #调用标准时也有参数 得到的loss结果已经对min ...

- 损失函数 hinge loss vs softmax loss

1. 损失函数 损失函数(Loss function)是用来估量你模型的预测值 f(x) 与真实值 Y 的不一致程度,它是一个非负实值函数,通常用 L(Y,f(x)) 来表示. 损失函数越小,模型的鲁 ...

- [AI]神经网络章3 损失函数

损失函数 作用 在有监督的学习中,需要衡量神经网络输出和所预期的输出之间的差异大小.这种误差函数需要能够反映出当前网络输出和实际结果之间一种量化之后的不一致程度,也就是说函数值越大,反映出模型预测的结 ...

- 机器学习中的损失函数 (着重比较:hinge loss vs softmax loss)

https://blog.csdn.net/u010976453/article/details/78488279 1. 损失函数 损失函数(Loss function)是用来估量你模型的预测值 f( ...

- 对于分类问题的神经网络最后一层的函数:sigmoid、softmax与损失函数

对于分类问题的神经网络最后一层的函数做如下知识点总结: sigmoid和softmax一般用作神经网络的最后一层做分类函数(备注:sigmoid也用作中间层做激活函数): 对于类别数量大于2的分类问题 ...

- [ch03-00] 损失函数

系列博客,原文在笔者所维护的github上:https://aka.ms/beginnerAI, 点击star加星不要吝啬,星越多笔者越努力. 第3章 损失函数 3.0 损失函数概论 3.0.1 概念 ...

- [PyTorch 学习笔记] 4.2 损失函数

本章代码: https://github.com/zhangxiann/PyTorch_Practice/blob/master/lesson4/loss_function_1.py https:// ...

- Tensorflow 2.0 深度学习实战 —— 详细介绍损失函数、优化器、激活函数、多层感知机的实现原理

前言 AI 人工智能包含了机器学习与深度学习,在前几篇文章曾经介绍过机器学习的基础知识,包括了监督学习和无监督学习,有兴趣的朋友可以阅读< Python 机器学习实战 >.而深度学习开始只 ...

- 深度学习常见的优化方法(Optimizer)总结:Adam,SGD,Momentum,AdaGard等

机器学习的常见优化方法在最近的学习中经常遇到,但是还是不够精通.将自己的学习记录下来,以备不时之需 基础知识: 机器学习几乎所有的算法都要利用损失函数 lossfunction 来检验算法模型的优劣, ...

随机推荐

- Mac中nginx的默认安装路径和启动方式

1.安装完以后,可以在终端输出的信息里看到一些配置路径: /usr/local/etc/nginx/nginx.conf (配置文件路径) /usr/local/var/www (服务器默认路径) / ...

- 查看MySQL数据库所有的表名、表注释、字段名称、类型、长度、备注,一键导出生成数据库字典

一.先了解下INFORMATION_SCHEMA1.在MySQL中,把INFORMATION_SCHEMA看作是一个数据库,确切说是信息数据库.其中保存着关于MySQL服务器所维护的所有其他数据库的信 ...

- Qt数据库应用2-数据导出到xls

一.前言 导入导出数据到csv由于语法简单,适用场景有限,于是乎还是必须再造一个轮子导出数据到xls,在经历过数十年的项目实战经验中不断调整和优化.尤其记得当初第一个版本v0.01大概在2011年左右 ...

- ubuntu opencv安装与卸载

安装opencv 1.在下面网站上下载所需版本的源文件Releases - OpenCVhttps://opencv.org/releases/ 2.解压并进入该文件夹 3.命令行执行如下指令 ...

- IM通讯协议专题学习(八):金蝶随手记团队的Protobuf应用实践(原理篇)

本文由金蝶随手记技术团队丁同舟分享. 1.引言 跟移动端IM中追求数据传输效率.网络流量消耗等需求一样,随手记客户端与服务端交互的过程中,对部分数据的传输大小和效率也有较高的要求,普通的数据格式如 J ...

- vue3.0实现炫酷的随机验证码功能

先上图 接下来楼一眼实现代码 这里说明一下,我用到了vue3.0,vant3.0以及阿里图标,vant 很人性化针对vue3.0新出了个vant3.0版本,阿里则是适配vue3.0的.我们将verif ...

- Redis学习笔记之spring-data-redis

一.关于spring-data-redis spring-data-redis针对jedis提供了如下功能: 连接池自动管理,提供了一个高度封装的"RedisTemplate"类 ...

- [megatron代码阅读] 1. 初始化和组网

以pretrain_gpt.py为例, 看megatron的整体逻辑. 本章主要包括megatron初始化相关逻辑, 核心函数为initialize_megatron, setup_model_and ...

- XXL-JOB原理--定时任务框架简介

一.完整介绍地址:官方介绍 https://www.xuxueli.com/xxl-job/#/?id=%E4%B8%80%E3%80%81%E7%AE%80%E4%BB%8B 二.最新版本架构图: ...

- Hadoop大数据架构及关键组件-建立大数据知识体系

Hadoop大数据架构及关键组件1. Hadoop生态系统1.1 架构大数据生态的主要组件及其关系大数据生态大数据架构1. HDFS(Hadoop分布式文件系统):2. MapReduce(分布式计算 ...