python爬虫我是斗图之王

python爬虫我是斗图之王

本文会以斗图啦网站为例,爬取所有表情包。

阅读之前需要对线程池、连接池、正则表达式稍作了解。

分析网站

页面url分析

打开斗图啦网站,简单翻阅之后发现最新表情每页包含的表情是最多的。

其url是: /photo/list/?page=2 其中page参数为页码,目前有1578页

页面图片元素分析

使用chrome的开发者工具分析一个图片的元素

<img src="https://ws1.sinaimg.cn/bmiddle/9150e4e5gy1frp2ulvf8uj20dw0hdmy2.jpg" style="width: 100%; height: 184.471px; display: block;" data-original="https://ws1.sinaimg.cn/bmiddle/9150e4e5gy1frp2ulvf8uj20dw0hdmy2.jpg" alt="简直不知羞耻" class="img-responsive lazy image_dta" data-backup="//img.doutula.com/production/uploads/image//2018/05/27/20180527387499_dYXqmw.jpg!dta">

可以看到img元素中包含我们想要信息:图片地址和图片描述

注意此时实际上我看到是浏览器渲染之后的页面,所以元素可能会是动态生成的。

如果我们要提高效率则应该使用web1.0,因为web2.0需要会更慢也更复杂。

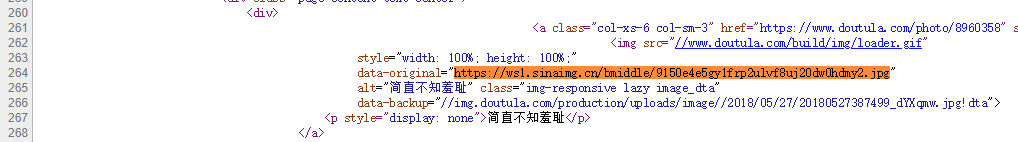

要查看未渲染之前的页面,右键查看源代码搜索图片链接

<img src="//www.doutula.com/build/img/loader.gif"

style="width: 100%; height: 100%;"

data-original="https://ws1.sinaimg.cn/bmiddle/9150e4e5gy1frp2ulvf8uj20dw0hdmy2.jpg"

alt="简直不知羞耻" class="img-responsive lazy image_dta"

data-backup="//img.doutula.com/production/uploads/image//2018/05/27/20180527387499_dYXqmw.jpg!dta">

img标签的src属性并非真正的图片地址,推测网站使用了图片懒加载技术,感兴趣可以自己搜索。

虽然src不是图片地址,但发现其实data-original就是真正的图片地址。

图床分析

根据之前的分析,其实该网站使用新浪的图床ws1.sinaimg.cn,多查看几个图片地址发现不一定是ws1子域名

可能是任何ws开头,后面跟数字。为什么会这样?

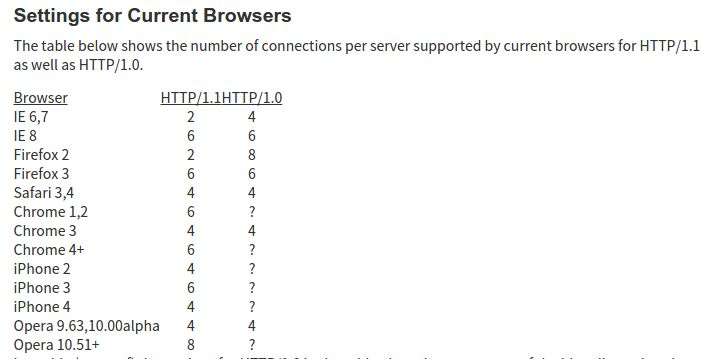

根据HTTP/1.1协议规定,浏览器客户端在同一时间,针对同一域名下的请求有一定数量限制。超过限制数目的请求会被阻塞

Clients that use persistent connections SHOULD limit the number of simultaneous connections that they maintain to a given server. A single-user client SHOULD NOT maintain more than 2 connections with any server or proxy. A proxy SHOULD use up to 2*N connections to another server or proxy, where N is the number of simultaneously active users. These guidelines are intended to improve HTTP response times and avoid congestion.

来源: RFC-2616-8.1.4 Practical Considerations

而不同的浏览器有不同的限制

所以新浪图床为了优化浏览器访问图片的速度,图片地址使用了不同的子域名来绕过这种限制

测试发现,固定子域名ws1中的数字,图片也依旧可以访问,https也使用http访问

流程梳理

通过改变page参数爬取所有列表页面

/photo/list/?page=1通过正则获取img标签的

图片地址和图片描述进一步下载图片,并保存为文件

优化说明

为更快爬取页面和图片使用线程池并发请求

连接池要保证域名不能改变,所以图片链接中

ws*均替换为ws1为了得到更快的下载图片

https退回到http

代码

需要先安装requests库pip install requests

# -*- coding: utf-8 -*-

import re

import os

import requests

import multiprocessing

from multiprocessing.pool import ThreadPool

# 设置图片保存文件夹

BASE_DIR = os.path.join(os.path.dirname(__file__), 'pic')

# 创建三个队列,分别用于图片任务、页面任务、日志记录

picqueue = multiprocessing.Queue()

pagequeue = multiprocessing.Queue()

logqueue = multiprocessing.Queue()

# 创建两个线程池,分别用于图片任务,页面任务

picpool = ThreadPool(30)

pagepool = ThreadPool(3)

error = []

def getimglist(body):

imglist = re.findall(

r'data-original="https://ws\d([^"]+)"\s+alt="([^"]+)"', body)

for url, name in imglist:

if name:

#根据图片描述拼接最终的图片文件名

name = name[:180] + url[-4:]

#https->http ws*->ws1

url = "http://ws1" + url

logqueue.put(url)

picqueue.put((name, url))

def savefile():

#当前线程位置唯一的一个连接

http = requests.Session()

while True:

name, url = picqueue.get()

#判断是否已经下载

if not os.path.isfile(os.path.join(BASE_DIR, name)):

req = http.get(url)

try:

open(os.path.join(BASE_DIR, name), 'wb').write(req.content)

except:

error.append([name, url])

def getpage():

#当前线程位置唯一的一个连接

http = requests.Session()

while True:

pageid = pagequeue.get()

req = http.get(

"https://www.doutula.com/photo/list/?page={}".format(pageid))

getimglist(req.text)

def main():

if not os.path.isdir(BASE_DIR):

os.mkdir(BASE_DIR)

# 将页码放入队列中

for x in range(1, 1579):

pagequeue.put(x)

# 启动页面任务池

for x in range(3):

pagepool.apply_async(getpage)

# 启动图片任务池

for x in range(30):

picpool.apply_async(savefile)

# 打印普片任务剩余个数,页面剩余个数,以及抓取到的url连接

while True:

print(picqueue.qsize(), pagequeue.qsize(), logqueue.get())

if __name__ == '__main__':

main()

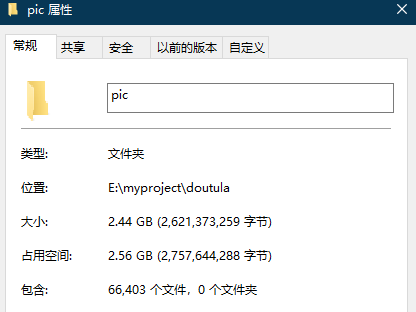

结果

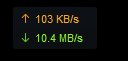

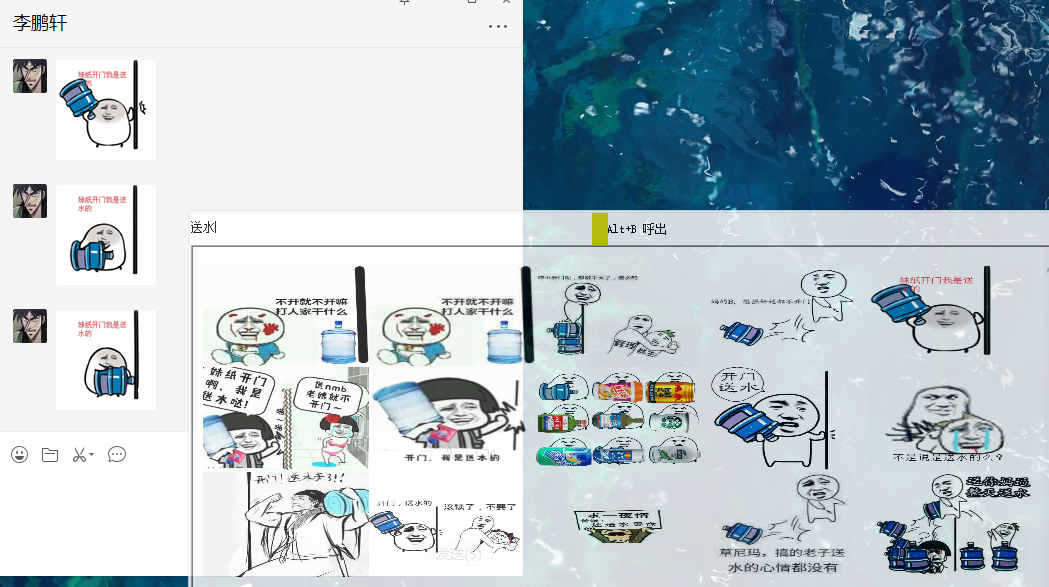

可以看到100M带宽基本吃满

环境差异、网络波动可能会使一些图片下载失败。多执行几次即可。

最终大约可以下载到六万多张表情表。

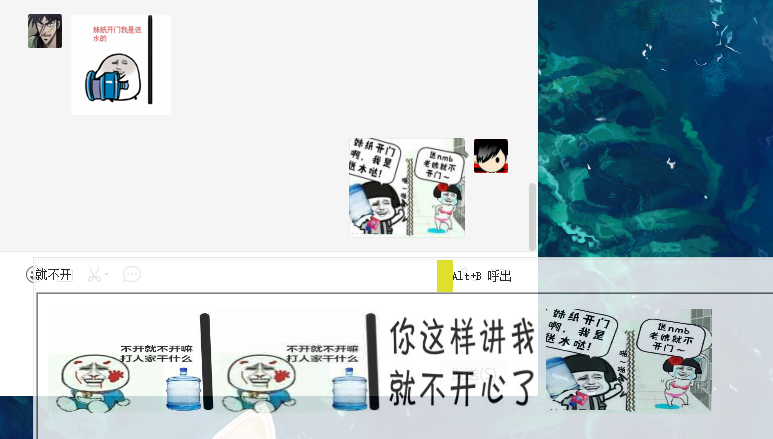

斗图

他有的图咱都有

而且可以反怼回去

想要我最后这个用大易语言写的斗图工具,赶紧来bugscan社区下载源码吧。

python爬虫我是斗图之王的更多相关文章

- python爬取斗图网中的 “最新套图”和“最新表情”

1.分析斗图网 斗图网地址:http://www.doutula.com 网站的顶部有这两个部分: 先分析“最新套图” 发现地址栏变成了这个链接,我们在点击第二页 可见,每一页的地址栏只有后面的pag ...

- Python爬取 斗图表情,让你成为斗图大佬

话不多说,上结果(只爬了10页内容) 上代码:(可直接运行) 用到Xpath #encoding:utf-8 # __author__ = 'donghao' # __time__ = 2018/ ...

- python多线程爬虫+批量下载斗图啦图片项目(关注、持续更新)

python多线程爬虫项目() 爬取目标:斗图啦(起始url:http://www.doutula.com/photo/list/?page=1) 爬取内容:斗图啦全网图片 使用工具:requests ...

- Python爬虫入门教程 13-100 斗图啦表情包多线程爬取

斗图啦表情包多线程爬取-写在前面 今天在CSDN博客,发现好多人写爬虫都在爬取一个叫做斗图啦的网站,里面很多表情包,然后瞅了瞅,各种实现方式都有,今天我给你实现一个多线程版本的.关键技术点 aioht ...

- python 爬虫系列09-异步斗图来一波

斗图斗图,妈妈再也不怕我都不赢了 import requests from lxml import etree from urllib import request import os import ...

- python 斗图图片爬虫

捣鼓了三小时,有一些小Bug,望大佬指导 废话不说,直接上代码: #!/usr/bin/python3 # -*- coding:UTF-8 -*- import os,re,requests fro ...

- python多线程爬取斗图啦数据

python多线程爬取斗图啦网的表情数据 使用到的技术点 requests请求库 re 正则表达式 pyquery解析库,python实现的jquery threading 线程 queue 队列 ' ...

- Python爬虫入门教程 12-100 半次元COS图爬取

半次元COS图爬取-写在前面 今天在浏览网站的时候,忽然一个莫名的链接指引着我跳转到了半次元网站 https://bcy.net/ 打开之后,发现也没有什么有意思的内容,职业的敏感让我瞬间联想到了 c ...

- Python爬虫入门教程 2-100 妹子图网站爬取

妹子图网站爬取---前言 从今天开始就要撸起袖子,直接写Python爬虫了,学习语言最好的办法就是有目的的进行,所以,接下来我将用10+篇的博客,写爬图片这一件事情.希望可以做好. 为了写好爬虫,我们 ...

随机推荐

- 2017ACM暑期多校联合训练 - Team 2 1011 HDU 6055 Regular polygon (数学规律)

题目链接 **Problem Description On a two-dimensional plane, give you n integer points. Your task is to fi ...

- PHP 5 MySQLi 函数总结

连接数据库 mysqli_connect() 函数打开一个到 MySQL 服务器的新的连接. <?php $con=mysqli_connect("localhost",&q ...

- 南邮综合题writeup

http://teamxlc.sinaapp.com/web3/b0b0ad119f425408fc3d45253137d33d/index.php fuckjs直接console得到地址 http: ...

- Vue-Module

由于使用单一状态树,应用的所有状态会集中到一个比较大的对象.当应用变得非常复杂时,store 对象就有可能变得相当臃肿. 为了解决以上问题,Vuex 允许我们将 store 分割成模块(module) ...

- 树莓派开发系列教程3--ssh、vnc远程访问

注意:树莓派系列的3篇文章里面的图片因为博客转移过程丢失了,非常抱歉 前言 远程访问有很多种方式可以实现.比如ssh.telnet.ftp.samba.远程桌面等等,各有优缺点.本文主要以ssh和远程 ...

- 老版本ubuntu更新源地址以及sources.list的配置方法 转

转自(http://blog.csdn.net/snaking616/article/details/52966634) 1.国内可用的更新源地址: (1)中科大地址 http://mirrors.u ...

- Linux是对用户的密码的复杂度要求设置【转】

那么Linux是如何实现对用户的密码的复杂度的检查的呢?其实系统对密码的控制是有两部分组成: 1 cracklib 2 /etc/login.defs pam_cracklib.so 才是控制密码复杂 ...

- 谷歌PageRank算法

1. 从Google网页排序到PageRank算法 (1)谷歌网页怎么排序? 先对搜索关键词进行分词,如“技术社区”分词为“技术”和“社区”: 根据建立的倒排索引返回同时包含分词后结果的网页: 将返回 ...

- Nim 游戏、SG 函数、游戏的和

Nim游戏 Nim游戏定义 Nim游戏是组合游戏(Combinatorial Games)的一种,准确来说,属于“Impartial Combinatorial Games”(以下简称ICG).满足以 ...

- Effective C++笔记(五):实现

参考:http://www.cnblogs.com/ronny/p/3754755.html 条款26:尽可能延后变量定义式的出现时间 有些对象,你可能过早的定义它,而在代码执行的过程中发生了导常,造 ...