python爬取斗图网中的 “最新套图”和“最新表情”

1.分析斗图网

1.分析斗图网

斗图网地址:http://www.doutula.com

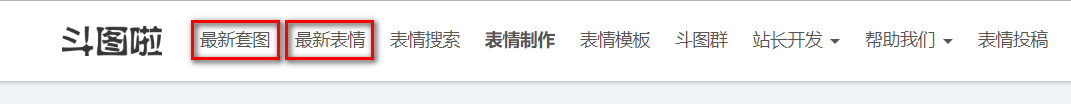

网站的顶部有这两个部分:

先分析“最新套图”

发现地址栏变成了这个链接,我们在点击第二页

可见,每一页的地址栏只有后面的page不同,代表页数;这样请求的地址就可以写了。

2.寻找表情包

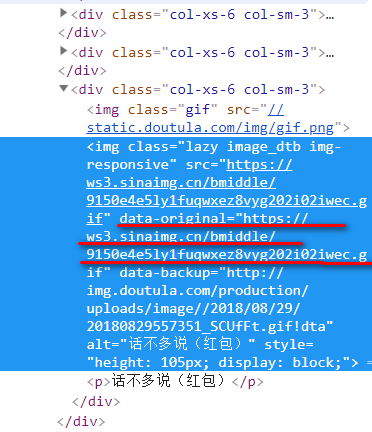

然后就要找需要爬取的表情包链接了。我用的是chrome浏览器,F12进入开发者模式。

找到图片对应的img元素,发现每个Img元素的class都是相同的。data-original属性对应的地址,就是我们要下载的图片。alt属性就是图片的名字。

对于”最新表情“的页面,同样也是如此。

3.编写代码

元素都找到了,可以上代码了:

#coding=utf-8

import requests

from lxml import etree

from urllib import request

from time import sleep

import socket

import re socket.setdefaulttimeout(20) headers = {}

headers["User-Agent"] = "Mozilla/5.0 (compatible; MSIE 9.0; Windows NT 6.1; Trident/5.0"

headers["Host"] = "www.doutula.com"

headers["Accept"] = "text/html,application/xhtml+xml,application/xml;q=0.9,*/*;q=0.8"

headers["Accept-Language"] = "zh-CN,zh;q=0.8,zh-TW;q=0.7,zh-HK;q=0.5,en-US;q=0.3,en;q=0.2"

headers["Accept-Encoding"] = "gzip, deflate"

headers["Connection"] = "close"

headers["Upgrade-Insecure-Requests"] = "" def get_url(page):

# 最新套图580页

url = "http://www.doutula.com/article/list/?page=" + str(page)

# 最新表情1855页

# url = "http://www.doutula.com/photo/list/?page=" + str(page)

response = requests.get(url, headers=headers)

html = response.text

selector = etree.HTML(html)

# print(html)

# 最新套图xpath

img_url = selector.xpath('//img[@class="lazy image_dtb img-responsive"]/@data-original')

img_name = selector.xpath('//img[@class="lazy image_dtb img-responsive"]/@alt')

# 最新表情xpath

# img_url = selector.xpath('//img[@style="width: 100%; height: 100%;"]/@data-original')

# img_name = selector.xpath('//img[@style="width: 100%; height: 100%;"]/@alt')

img_name = name_filter(img_name)

for img in img_url:

id = img_url.index(img)

get_img(id, img, img_name)

response.close() def get_img(id, img, img_name):

"""

request.urlretrieve: 保存链接地址的文件

"""

global j

try:

if img[-3:] == 'dta':

if img[-7:-4] == 'gif':

request.urlretrieve(img, 'E:\\pictures\\%s.gif' % img_name[id])

elif img[-7:-4] == 'png':

request.urlretrieve(img, 'E:\\pictures\\%s.png' % img_name[id])

else:

request.urlretrieve(img, 'E:\\pictures\\%s.jpg' % img_name[id])

elif img[-3:] == 'gif':

request.urlretrieve(img, 'E:\\pictures\\%s.gif' % img_name[id])

elif img[-3:] == 'png':

request.urlretrieve(img, 'E:\\pictures\\%s.png' % img_name[id])

else:

request.urlretrieve(img, 'E:\\pictures\\%s.jpg' % img_name[id])

print("下载第%d张表情包" % j + img)

except Exception as ex: # urlopen error time out

print(str(ex))

j += 1 def name_filter(img_name):

"""

过滤文件名中的特殊字符

"""

newlist = []

for im in img_name:

im = re.sub(r'\?', '', str(im)) # / \

newlist.append(im)

return newlist if __name__ == '__main__': j = 1

for page in range(1, 581):

print("第%s页" % page)

while True:

try:

get_url(page)

break

except Exception as e:

print(str(e))

sleep(5)

sleep(10)

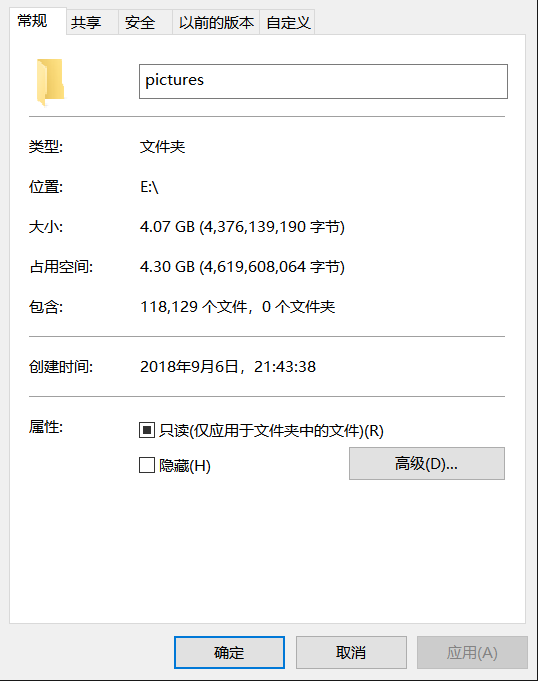

4.运行结果

爬了两天,可能代码中的sleep时间有点长,服务器那边也老是断开连接。

数据有些偏差,可能下载的过程网络的问题导致的。

5.总结

编码过程中,对于异常处理的思考,还需要多提高;有许多会出现问题的地方,都没有考虑到。

python爬取斗图网中的 “最新套图”和“最新表情”的更多相关文章

- Python爬取中国天气网

Python爬取中国天气网 基于requests库制作的爬虫. 使用方法:打开终端输入 “python3 weather.py 北京(或你所在的城市)" 程序正常运行需要在同文件夹下加入一个 ...

- python爬取天气后报网

前言 大二下学期的大数据技术导论课上由于需要获取数据进行分析,我决定学习python爬虫来获取数据.由于对于数据需求量相对较大,我最终选择爬取 天气后报网,该网站可以查询到全国各地多年的数据,而且相对 ...

- (python爬取小故事网并写入mysql)

前言: 这是一篇来自整理EVERNOTE的笔记所产生的小博客,实现功能主要为用广度优先算法爬取小故事网,爬满100个链接并写入mysql,虽然CS作为双学位已经修习了三年多了,但不仅理论知识一般,动手 ...

- python爬取千库网

url:https://i588ku.com/beijing/0-0-default-0-8-0-0-0-0-1/ 有水印 但是点进去就没了 这里先来测试是否有反爬虫 import requests ...

- Python爬取 斗图表情,让你成为斗图大佬

话不多说,上结果(只爬了10页内容) 上代码:(可直接运行) 用到Xpath #encoding:utf-8 # __author__ = 'donghao' # __time__ = 2018/ ...

- 适合初学者的Python爬取链家网教程

前言 文的文字及图片来源于网络,仅供学习.交流使用,不具有任何商业用途,版权归原作者所有,如有问题请及时联系我们以作处理. 作者: TinaLY PS:如有需要Python学习资料的小伙伴可以加点击下 ...

- Python爬取中国票房网所有电影片名和演员名字,爬取齐鲁网大陆所有电视剧名称

爬取CBO中国票房网所有电影片名和演员名字 # -*- coding: utf-8 -*- # 爬取CBO中国票房网所有电影片名 import json import requests import ...

- Python 爬取煎蛋网妹子图片

#!/usr/bin/env python # -*- coding: utf-8 -*- # @Date : 2017-08-24 10:17:28 # @Author : EnderZhou (z ...

- Python爬取中国知网文献、参考文献、引证文献

前两天老师派了个活,让下载知网上根据高级搜索得到的来源文献的参考文献及引证文献数据,网上找了一些相关博客,感觉都不太合适,因此特此记录,希望对需要的人有帮助. 切入正题,先说这次需求,高级搜索,根据中 ...

随机推荐

- IntelliJ IDEA编写的spark程序在远程spark集群上运行

准备工作 需要有三台主机,其中一台主机充当master,另外两台主机分别为slave01,slave02,并且要求三台主机处于同一个局域网下 通过命令:ifconfig 可以查看主机的IP地址,如下图 ...

- 《OpenGL编程指南第七版》学习——编译时提示“error C2381: “exit” : 重定义;__declspec(noreturn) 不同”错误的解决办法

解决办法一. #if defined(_WIN32) # ifndef GLUT_BUILDING_LIBextern _CRTIMP void __cdecl exit(int); 上面是glut. ...

- mail发邮件报错 "send-mail: fatal: parameter inet_interfaces: no local interface found for ::1"

发送邮件: [root@itfswelog123]# echo '测试邮件标题' | mail -s "数据库挂啦.挂啦.起床啦 " xx@163.com 出现异常: [r ...

- 轻量ORM-SqlRepoEx (十四)最佳实践之Dapper(1)

简介:SqlRepoEx是 .Net平台下兼容.NET Standard 2.0人一个轻型的ORM.解决了Lambda转Sql语句这一难题,SqlRepoEx使用的是Lambda表达式,所以,对c#程 ...

- 如何使用tomcat,使用域名直接访问javaweb项目首页

准备工作: 1:一台虚拟机 2:配置好jdk,将tomcat上传到服务器并解压 3:将项目上传到tomcat的webaap目录下 4:配置tomcat的conf目录下的server.xml文件 确保8 ...

- Docker 常用命令——镜像

Docker 常用命令 帮助命令 docker version --版本信息 docker info --详细信息 docker --help --帮助 镜像命令 1.doc ...

- No active profile set, falling back to default profiles: default

No active profile set, falling back to default profiles: default 这个错误是由于idea没有设置默认启动环境,设置即可

- 【ZOJ 2996】(1+x)^n(二项式定理)

Please calculate the coefficient modulo 2 of x^i in (1+x)^n. Input For each case, there are two inte ...

- XML第一次简单入门(Lab分析)

In this tutorial you will create a well-formed and verified XML file. Consider the XML document belo ...

- Golang 对接宝付、通联、富友金账户...填坑记

一.宝付私钥加密,公钥解密 由于对RSA加密解密原理不是很熟悉,宝付也没有Golang的Demo提供.Go语言库里一般都是私钥解密.公钥加密,或者私钥签名.公钥验签.宝付需要反过来,这里也到好找到了h ...