python网络爬虫入门(二)

刚去看了一下,18年2月份写了第一篇关于爬虫的文章(仅仅介绍了使用requests库去获取HTML代码),一年多之后看来很稚嫩也没有多少参考的意义,但没想着要去修改它,留着也是一个回忆吧。至少证明着我是有些许进步的,愿你也是一样!

下面是它的姊妹篇,介绍使用requests和bs4(BeautifulSoup)库来爬取静态网页中的信息。

爬虫从黑盒的角度来看,就是给出网页的链接,输出你想要的信息的一段程序。大概会涉及这几个步骤:

1. 使用requests+re正则

单纯使用requests库来做,需要会写正则表达式,这里借助之前的那篇 爬取猫眼Top100榜单 来讲。

第一步——获取HTML代码

一般使用requests库get()方法,这里封装成为一个函数

def get_one_page(url):

try:

headers = {

'user-agent':'Mozilla/5.0'

}

# use headers to avoid 403 Forbidden Error(reject spider)

response = requests.get(url, headers=headers)

if response.status_code == 200 :

return response.text

return None

except RequestException:

return None

第二部——分析页面HTML代码,写正则表达式,提取信息

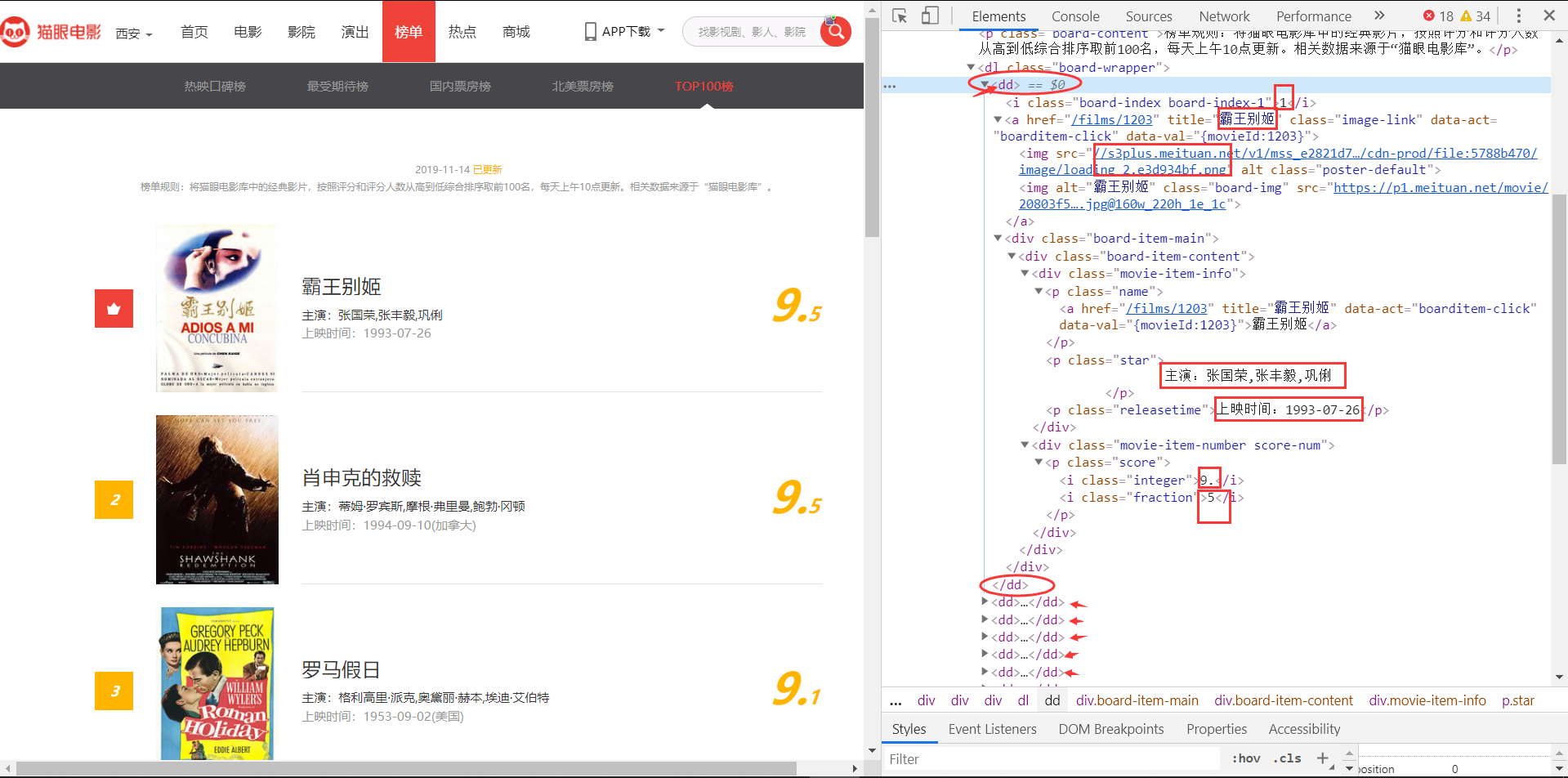

先来看页面

分析它的HTML,我目前需要排名、片名、主演、上映时间和评分信息。

可以看到,榜单中每一个电影条目都在一组<dd></dd>标签中,而且所需的信息也很明确,我们来写正则,正则的关键在于找好独一无二的参照(已在途中方格标出)

re_text =

'<dd>.*?board-index.*?>(\d+)<.*?<a.*?title="(.*?)"'

+'.*?data-src="(.*?)".*?</a>.*?star">[\\s]*(.*?)[\\n][\\s]*</p>.*?'

+'releasetime">(.*?)</p>.*?integer">(.*?)</i>.*?'

+'fraction">(.*?)</i>.*?</dd>'

def parse_one_page(html):

pattern = re.compile('<dd>.*?board-index.*?>(\d+)<.*?<a.*?title="(.*?)"'

+'.*?data-src="(.*?)".*?</a>.*?star">[\\s]*(.*?)[\\n][\\s]*</p>.*?'

+'releasetime">(.*?)</p>.*?integer">(.*?)</i>.*?'

+'fraction">(.*?)</i>.*?</dd>', re.S)

items = re.findall(pattern, html)

return items

先编译正则表达式成为pattern,然后在页面中findall符合条件的信息。这样就会将正则表达式匹配到的所有信息,以一个列表的形式返回。

第三部——持久化存储数据

我所做的实践由于数据量较小,目前都是采用excel(*.xlsx)来存储。需要用到一个openpyxl库,自行安装即可,它的使用教程有很多,不是我所述的主要内容,烦请自行学习。

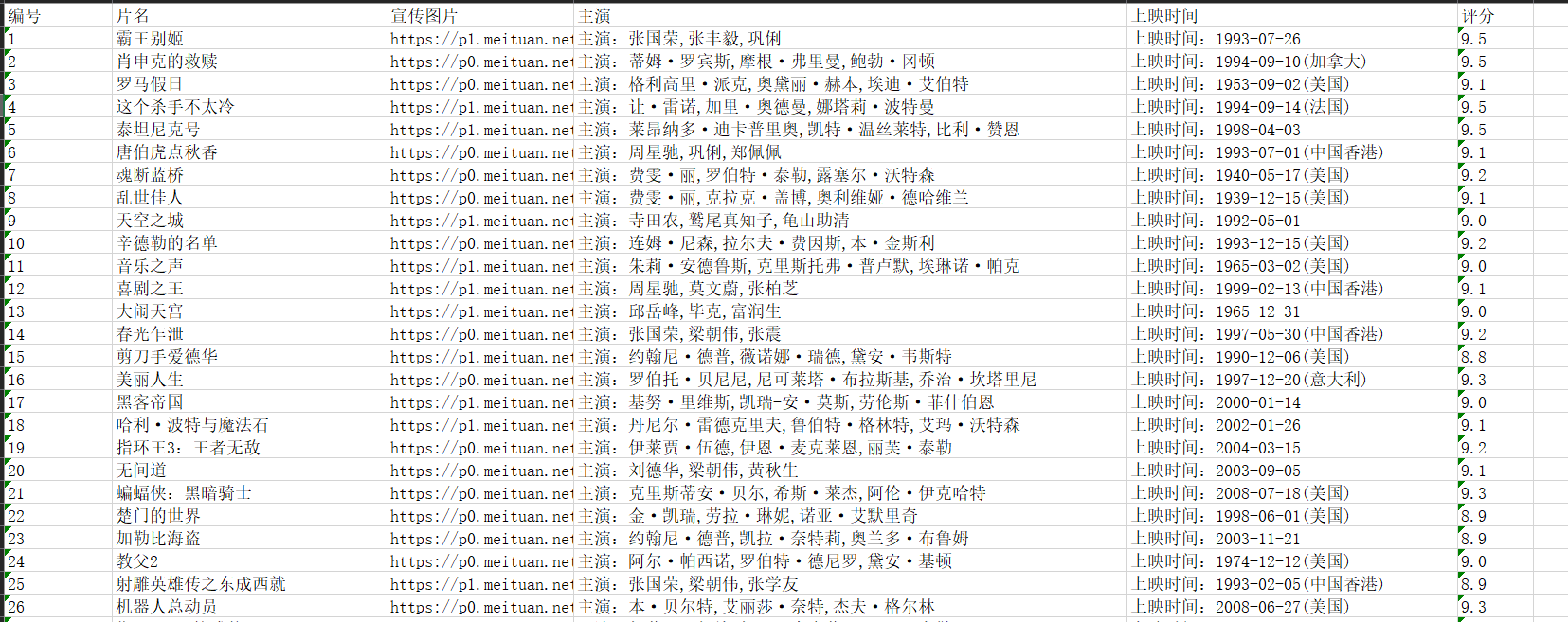

已经爬到的数据

注意:上面所讲的是获取一个页面(含20条信息,该榜单有100条,势必会有分页),所以URL肯定需要替换,但是肯定是有规律的(具体的看这篇博客吧 猫眼top100 )

2. 使用bs4(BeautifulSoup)筛选器

使用bs4库,需要先自己安装一下。

所谓筛选器,即相当于我们上面正则表达式中的“参考”,即:锚点。通过筛选器,可以非常方便的获取页面当中的信息。下面讲一个例子,就明白了。

栗子:

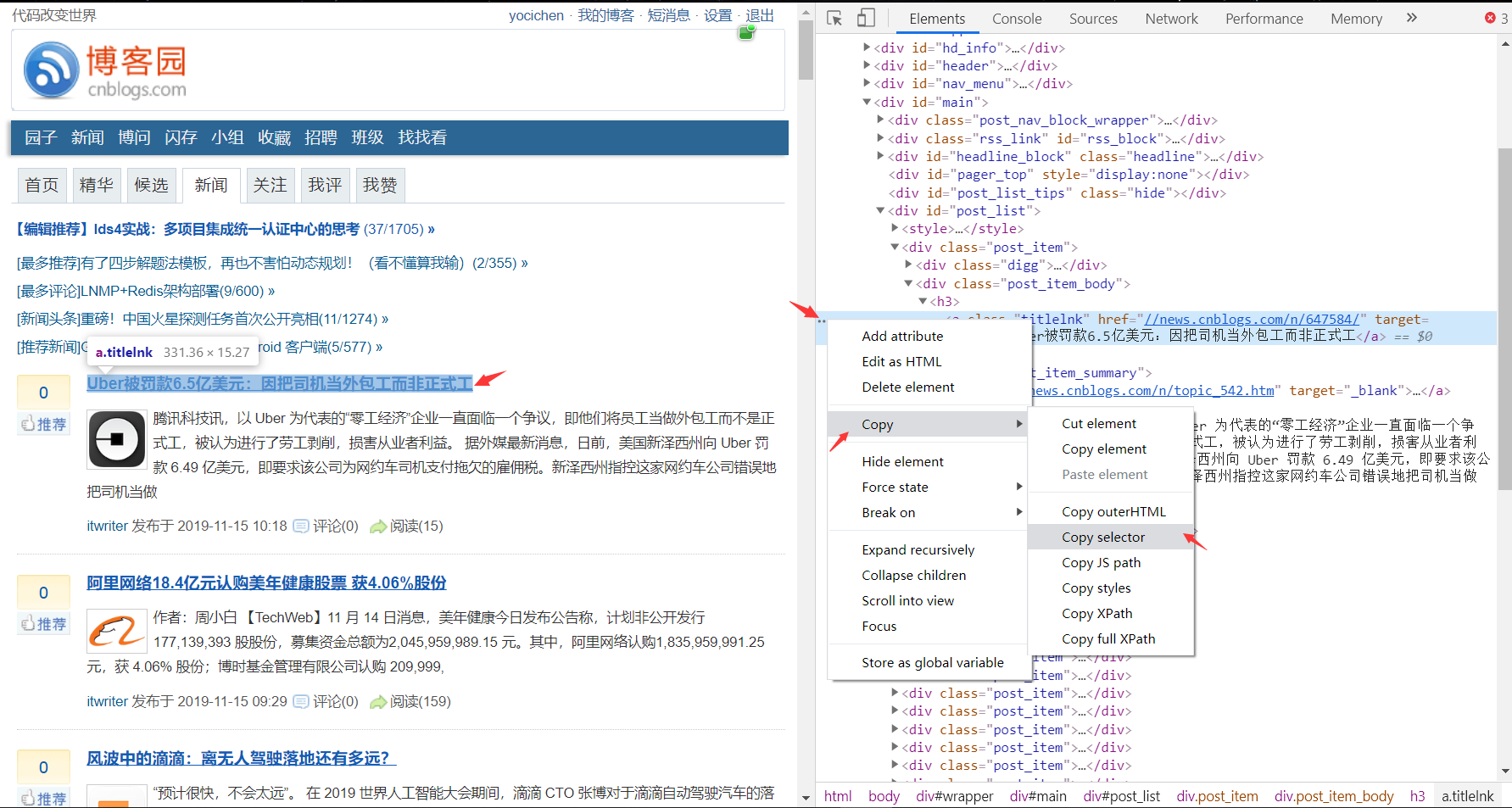

获取博客园新闻板块第一条的新闻title,先来瞧瞧HTML和selector。

代码:

# -*- coding: utf-8 -*-

# @Author : yocichen

# @Email : yocichen@126.com

# @File : test_bs4.py

# @Software: PyCharm

# @Time : 2019/11/15 10:23 import requests

from bs4 import BeautifulSoup

import lxml url = 'https://www.cnblogs.com/news/'

headers = {

'user-agent':'Mozilla/5.0'

}

# 获取HTML

html = requests.get(url, headers=headers)

# 解析HTML

soup = BeautifulSoup(html.text, 'lxml')

# 筛选器筛选信息

selector = '#post_list > div:nth-child(2) > div.post_item_body > h3 > a'

res = soup.select(selector)

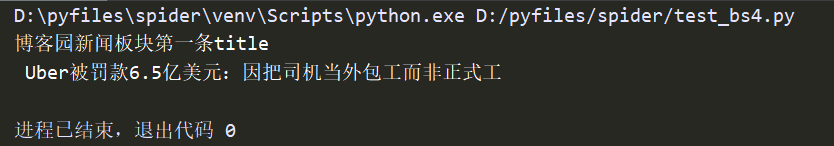

print('博客园新闻板块第一条title\n', res[0].string)

结果:

可以看到,获取selector十分简单,chrome浏览器或者其他浏览器也有支持,这样一来就避免了去写繁杂的正则表达还写不出来的窘境。

最终的持久化存储过程,同上,不再赘述。

后记

python爬虫入门篇就此结束了,爬虫深入的话还涉及到防止反爬,以及爬取动态页面等问题,有机会的话会再学习再写一篇。

以上内容其实是对我最近所学所做的总结,如果你从中也有些许收获,不妨点个“推荐”吧!

python网络爬虫入门(二)的更多相关文章

- python网络爬虫入门范例

python网络爬虫入门范例 Windows用户建议安装anaconda,因为有些套件难以安装. 安装使用pip install * 找出所有含有特定标签的HTML元素 找出含有特定CSS属性的元素 ...

- Python简单爬虫入门二

接着上一次爬虫我们继续研究BeautifulSoup Python简单爬虫入门一 上一次我们爬虫我们已经成功的爬下了网页的源代码,那么这一次我们将继续来写怎么抓去具体想要的元素 首先回顾以下我们Bea ...

- python 网络爬虫(二) BFS不断抓URL并放到文件中

上一篇的python 网络爬虫(一) 简单demo 还不能叫爬虫,只能说基础吧,因为它没有自动化抓链接的功能. 本篇追加如下功能: [1]广度优先搜索不断抓URL,直到队列为空 [2]把所有的URL写 ...

- python 网络爬虫(二)

一.编写第一个网络爬虫 为了抓取网站,我们需要下载含有感兴趣的网页,该过程一般被称为爬取(crawling).爬取一个网站有多种方法,而选择哪种方法更加合适,则取决于目标网站的结构. 首先探讨如何安全 ...

- python网络爬虫-入门(二)

为什么要学网络爬虫 可以替代人工从网页中找到数据并复制粘贴到excel中,这种重复性的工作不仅浪费时间还一不留神还会出错----解决无法自动化和无法实时获取数据 对于这些公开数据的应用价值,我 ...

- Python网络爬虫入门篇

1. 预备知识 学习者需要预先掌握Python的数字类型.字符串类型.分支.循环.函数.列表类型.字典类型.文件和第三方库使用等概念和编程方法. 2. Python爬虫基本流程 a. 发送请求 使用 ...

- Python网络爬虫入门实战(爬取最近7天的天气以及最高/最低气温)

_ 前言 本文文字及图片来源于网络,仅供学习.交流使用,不具有任何商业用途,版权归原作者所有,如有问题请及时联系我们以作处理. 作者: Bo_wen 最近两天学习了一下python,并自己写了一个 ...

- python网络爬虫-入门(一)

前言 1.爬虫程序是Dt(Data Technology,数据技术)收集信息的基础,爬取到目标网站的资料后,就可以分析和建立应用了. 2.python是一个简单.有效的语言,爬虫所需要的获取.存储.整 ...

- python网络爬虫入门(一)

python网络爬虫(一) 2018-02-10 python版本:python 3.7.0b1 IDE:PyCharm 2016.3.2 涉及模块:requests & builtwit ...

随机推荐

- Java基础 三目运算符 用if-else对其进行解释

JDK :OpenJDK-11 OS :CentOS 7.6.1810 IDE :Eclipse 2019‑03 typesetting :Markdown code ...

- Laravel 使用自己的类库三种方式

虽然Composer使得我们可以重用很多现有的类库(例如packagist.org中的),但是我们仍然可能用到一些不兼容composer的包或者类库.另外在某一项目中,我们也可能会创建某一类库,而且可 ...

- springboot使用SpringTask实现定时任务

SpringTask是Spring自主研发的轻量级定时任务工具,相比于Quartz更加简单方便,且不需要引入其他依赖即可使用. 只需要在配置类中添加一个@EnableScheduling注解即可开启S ...

- Python - Django - form 组件校验功能

app01/models.py: from django.db import models class UserInfo(models.Model): username = models.CharFi ...

- LODOP打印超文本有边距不居中的情况2

之前的博文:LODOP打印项水平居中.之前的博文有介绍超文本和纯文本的居中方式,设置超文本打印项居中时,注意打印内容要在打印项本身宽度里居中.之前的博文超文本用的是个表格,而且表格本身没有margin ...

- 【python基础】python开启GPU加速

前言 训练时使用GPU可以加速程序运行,本文介绍如何使用GPU加速. 前提条件 1. 机子有GPU显卡,并安装GPU显卡驱动: 2. 安装GPU的使用环境,CUDA等: 3. 打开nvidia-smi ...

- [LeetCode] 325. Maximum Size Subarray Sum Equals k 和等于k的最长子数组

Given an array nums and a target value k, find the maximum length of a subarray that sums to k. If t ...

- C# .NET 私钥 RSA2,SHA256,签名

私钥长度2048 -- /// <summary> /// 生成签名 /// </summary> /// <param name="str"> ...

- kubernetes之secret

Secret解决了密码.token.密钥等敏感数据的配置问题,而不需要把这些敏感数据暴露到镜像或者Pod Spec中.Secret可以以Volume或者环境变量的方式使用. Secret类型: Opa ...

- php_mvc实现步骤三,四

3.match_mvc MVC 以ecshop的前台为例: 功能一: 首页 购物车数据,商品分类数据,其他的首页需要的数据 功能二: 拍卖活动 购物车数据,商品分类数据,拍卖相关数据 功能三: 团购商 ...