Python3安装Scrapy

Microsoft Visual C++ Build Tools

最近项目在写爬虫,项目经理给了个Python Scrapy的爬虫项目,要求使用Java实现相关功能。于是乎在本地先后安装了Python3和Scrapy,在安装Scrapy时出现了个小插曲,现在总结如下:

第一、安装Scrapy

查看网上安装scrapy,网友基本就是告诉你使用命令: pip install scrapy

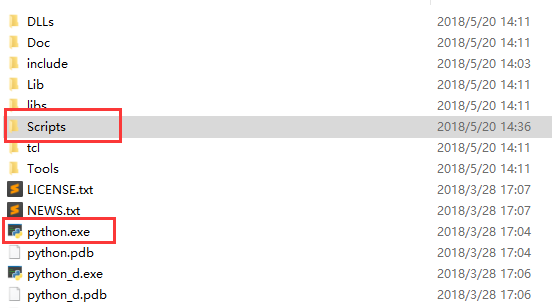

然而、不是很熟悉Python的时候,就会发现根本找不到pip命令,这里不是说在PTAH中配置了Python的环境变量就可以了,这是因为pip在python安装目录的Scripts文件夹中。如图:

所以、这里还需要将Scripts加入环境变量PATH中,这样就可以直接使=使用命令行的方式安装Scrapy了。

当你设置好环境变量后,准备安装Scrapy时,你又会惊喜的发现安装过程报了个错误:

error: Microsoft Visual C++ 14.0 is required. Get it with "Microsoft Visual C++ Build Tools": http://landinghub.visualstudio.com/visual-cpp-build-tools

第二、安装Wheel

这个错误是在安装Scrapy所需要的中间件Twisted时,所需要的编译工具,如果你老老实实的去下载 Microsoft Visual C++ Build Tools,你就会发现这个工具不是一般的大,而且据网友反映,安装后依然无法安装Scrapy;现在、教你用另一种方式安装:

1.执行命令:pip install wheel

2.手动下载:Twisted文件,网址:https://www.lfd.uci.edu/~gohlke/pythonlibs/#twisted

注意:这里你要下载和你本地的Python版本一致的Twisted文件;字符cp后为python的版本,即27表示Python2.7,36表示Python3.6,目前最新的稳定版是Python3.6

3.安装Twisted:pip install [你下载的Twisted文件在本地的路径],如:pip install E://Twisted...cp36....amd64.whl

这里可能报:Twisted-18.4.0-cp36-cp36m-win_amd64.whl is not a supported wheel on this platform.

建议:请检查安装Python版本32位还是64位,以及有可能的文件名称是否支持。

4.安装Scrapy:pip install scrapy

以上各步骤都执行成功后,即可创建Scrapy爬虫项目了。小伙伴、有木有很期待。

Python3安装Scrapy的更多相关文章

- 【转载】python3安装scrapy之windows32位爬坑

python3安装scrapy之windows32位爬坑 原创 2016年11月06日 01:38:08 标签: scrapy / windows / python / 开源框架 / 网络爬虫 早 ...

- Python3安装scrapy框架步骤

Python3安装scrapy框架步骤 1. 安装wheel a) Pip install wheel 2. 安装lxml Pip install lxml 3. ...

- ubuntu下python3安装scrapy,OpenSSL

环境:ubuntu 16.04 , python3.5.1+ 安装顺序如下: sudo apt-get install build-essential sudo apt-get install p ...

- 记录 Python3 安装 Scrapy 遇到的问题

开发环境:Windows 10 + Python 3 使用 pip 去安装 Scrapy, pip install scrapy , 报了一个错误. 原因:加 --user 的作用是显式指定安装在用 ...

- 《转载》Python3安装Scrapy

运行平台:Windows Python版本:Python3.x IDE:Sublime text3 转载自:http://blog.csdn.net/c406495762/article/detail ...

- python3网络爬虫(4):python3安装Scrapy

运行平台: Windows python版本: python3.5.2 IDE: pycharm 一.Scrapy简介 Scrapy是一个为了爬取网站数据提取结构性数据而编写的应用框架,可以应用于数 ...

- python3 安装scrapy Exception: Traceback (most recent call last): File "/usr/lib/python3/dist-packages/pip/req/req_install.py", line 1006, in check_if_exists解决方法

错误代码: Exception: Traceback (most recent call last): File , in check_if_exists self.satisfied_by = pk ...

- python3安装scrapy教程

2.1xm1http://www.lfd.uci.edu/~gohlke/pythonlibs/#lxml3. PyOpensslhttps://pypi.python.org/pypi/pyOpen ...

- python3安装scrapy问题解决

scrapy py3.5安装 pip install scrapy 直接安装失败 第一个错误 building 'lxml.etree' extension 使用 pip install lxml 安 ...

随机推荐

- ubuntu 通过ppa源安装mysql5.6

添加mysql5.6的源 sudo add-apt-repository -y ppa:ondrej/mysql-5.6 更新源 sudo apt-get update 安装mysql5.6 sudo ...

- Python json & pickle & shelve模块

json & pickle 之前我们学习过用eval内置方法可以将一个字符串转成python对象,不过,eval方法是有局限性的,对于普通的数据类型,json.loads和eval都能用,但遇 ...

- ndk编译libpcap 1.7.4(最终解决方法)

具体方法和测试见上一篇. 后来才知道,LIBPCAP本来就写了几套获取网卡的函数,这样就简单了.和上篇一样,把那5个文件从LINUX下托下来. 上篇忘了说了,还要将LINUX中/usr/include ...

- 7-26 Windows消息队列

7-26 Windows消息队列(25 分) 消息队列是Windows系统的基础.对于每个进程,系统维护一个消息队列.如果在进程中有特定事件发生,如点击鼠标.文字改变等,系统将把这个消息加到队列当中. ...

- 【瞎扯】 About Me

手动博客搬家: 本文发表于20181218 13:54:31, 原地址https://blog.csdn.net/suncongbo/article/details/85063885 来了?坐,欢迎来 ...

- Mysql学习总结(42)——MySql常用脚本大全

备份 (所有) C:\Program Files\MySQL\MySQL Server 5.6\bin>mysqldump --no-defaults -hlocalhost -P3306 -u ...

- Git学习总结(14)——Git使用前的注意事项

连接方式https.ssh 在使用git的时候,不管你的服务器是开源平台github还是私服gitlab,你都需要clone仓库到本地,这个clone的时候就需要你选择连接方式.这个连接方式决定了你与 ...

- JSON.parseObject将json字符串转换为bean类,是否大小写敏感区分---https://blog.csdn.net/mathlpz126/article/details/80684034

JSON.parseObject将json字符串转换为bean类,是否大小写敏感区分 https://blog.csdn.net/mathlpz126/article/details/80684034

- CodeForces 1000F One Occurrence

You are given an array $a$ consisting of $n$ integers, and $q$ queries to it. $i$-th query is denote ...

- Codeforces Beta Round #91 (Div. 1 Only) E. Lucky Array

E. Lucky Array Petya loves lucky numbers. Everybody knows that lucky numbers are positive integers w ...