从零搭建云原生技术kubernetes(K8S)环境-通过kubesPhere的AllInOne方式

前言

k8s云原生搭建,步骤有点多,但通过kubesphere,可以快速搭建k8s环境,同时有一个以 Kubernetes 为内核的云原生分布式操作系统-kubesphere,本文将从零开始进行kubePhere3.1.1的安装搭建,采用了KubeKey,KubeKeyKubeKey 可以将 Kubernetes 和 KubeSphere 一同安装,其他版本大同小异,只是改个版本号而已。

服务器

| 服务器 | 账号 | 密码 |

|---|---|---|

| 139.198.22.13 | root | **** |

参考官方文档

在 Linux 上以 All-in-One 模式安装 KubeSphere

通过kubekey安装KubeSphere,具体参考 官方配置/README_zh-CN.md

安装前准备

## 关闭防火墙

systemctl stop firewalld

systemctl disable firewalld

systemctl status firewalld

## 查看并关闭swap分区

swapoff -a

echo "vm.swappiness=0" >> /etc/sysctl.conf

sysctl -p /etc/sysctl.conf

sed -i 's$/dev/mapper/centos-swap$#/dev/mapper/centos-swap$g' /etc/fstab

## 查看Selinux状态

getenforce

## 安装依赖组件

yum install -y ebtables socat ipset conntrack

## 安装docker

yum install -y yum-utils

yum-config-manager --add-repo http://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

#yum-config-manager --add-repo https://download.docker.com/linux/centos/docker-ce.repo

yum makecache fast

yum -y install docker-ce docker-ce-cli

## 启动docker

systemctl enable docker && systemctl start docker

## 设置docker镜像加速器

cat > /etc/docker/daemon.json <<EOF

{

"insecure-registries":["10.8.104.247:5000","git.xcc.com:5000"],

"registry-mirrors": ["https://dzhtyzgo.mirror.aliyuncs.com"],

"exec-opts": ["native.cgroupdriver=systemd"],

"log-driver": "json-file",

"log-opts": {

"max-size": "100m"

},

"storage-driver": "overlay2",

"storage-opts": [

"overlay2.override_kernel_check=true"

]

}

EOF

## 重启docker使配置生效

#重载配置

systemctl daemon-reload

systemctl restart docker

systemctl status docker

docker info | grep "Registry Mirrors" -A 1

## 检查DNS设置

cat /etc/resolv.conf

```shell script

#需要时可改为下面dns配置

nameserver 114.114.114.114

nameserver 8.8.8.8

设置kubernetes仓库

cat <<EOF > /etc/yum.repos.d/kubernetes.repo

[kubernetes]

name = Kubernetes

baseurl = http://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64

enabled = 1

gpgcheck = 0

repo_gpgcheck = 0

gpgkey = http://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg

http://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg

EOF

yum makecache fast

安装命令

#0、放在目录里

mkdir -vp /data/kubesphere

cd /data/kubesphere

#1、下载KubeKey

curl -sfL https://get-kk.kubesphere.io | VERSION=v1.1.1 sh -

#2、添加可执行权限

chmod +x kk

#3、开始安装

#安装 KubeSphere v3.1.1 的建议 Kubernetes 版本:v1.17.9,v1.18.8,v1.19.8 以及 v1.20.4。如果不指定 Kubernetes 版本,KubeKey 将默认安装 Kubernetes v1.19.8。

#案例

# ./kk create cluster [--with-kubernetes version] [--with-kubesphere version]

#若要同时安装 Kubernetes 和 KubeSphere,可参考以下示例命令:

# ./kk create cluster --with-kubernetes v1.20.4 --with-kubesphere v3.1.1

./kk create cluster --with-kubernetes v1.18.8 --with-kubesphere v3.1.1

#验证安装结果

#输出信息会显示 Web 控制台的 IP 地址和端口号,默认的 NodePort 是 30880。现在,您可以使用默认的帐户和密码 (admin/P@88w0rd) 通过 <NodeIP>:30880 访问控制台。

kubectl logs -n kubesphere-system $(kubectl get pod -n kubesphere-system -l app=ks-install -o jsonpath='{.items[0].metadata.name}') -f

输出信息会显示 Web 控制台的 IP 地址和端口号,默认的 NodePort 是 30880。现在,您可以使用默认的帐户和密码 (admin/P@88w0rd) 通过 <NodeIP>:30880 访问控制台。

#####################################################

### Welcome to KubeSphere! ###

#####################################################

Console: http://192.168.0.2:30880

Account: admin

Password: P@88w0rd

NOTES:

1. After you log into the console, please check the

monitoring status of service components in

"Cluster Management". If any service is not

ready, please wait patiently until all components

are up and running.

2. Please change the default password after login.

#####################################################

https://kubesphere.io 20xx-xx-xx xx:xx:xx

#####################################################

删除kubesphere

* 如果您以快速入门(all-in-one)开始:

```shell script

./kk delete cluster

```

* 如果从高级安装开始(使用配置文件创建的集群):

```shell script

./kk delete cluster [-f config-sample.yaml]

```

启用多集群

参考文档:community/README_zh.md at master · kubesphere/community · GitHub

member要最小化安装,参考文档:在 Kubernetes 上最小化安装 KubeSphere

命令:

## 先安装helm

## 然后执行下面命令

kubectl apply -f https://github.com/kubesphere/ks-installer/releases/download/v3.1.1/kubesphere-installer.yaml

kubectl apply -f https://github.com/kubesphere/ks-installer/releases/download/v3.1.1/cluster-configuration.yaml

kubectl logs -n kubesphere-system $(kubectl get pod -n kubesphere-system -l app=ks-install -o jsonpath='{.items[0].metadata.name}') -f

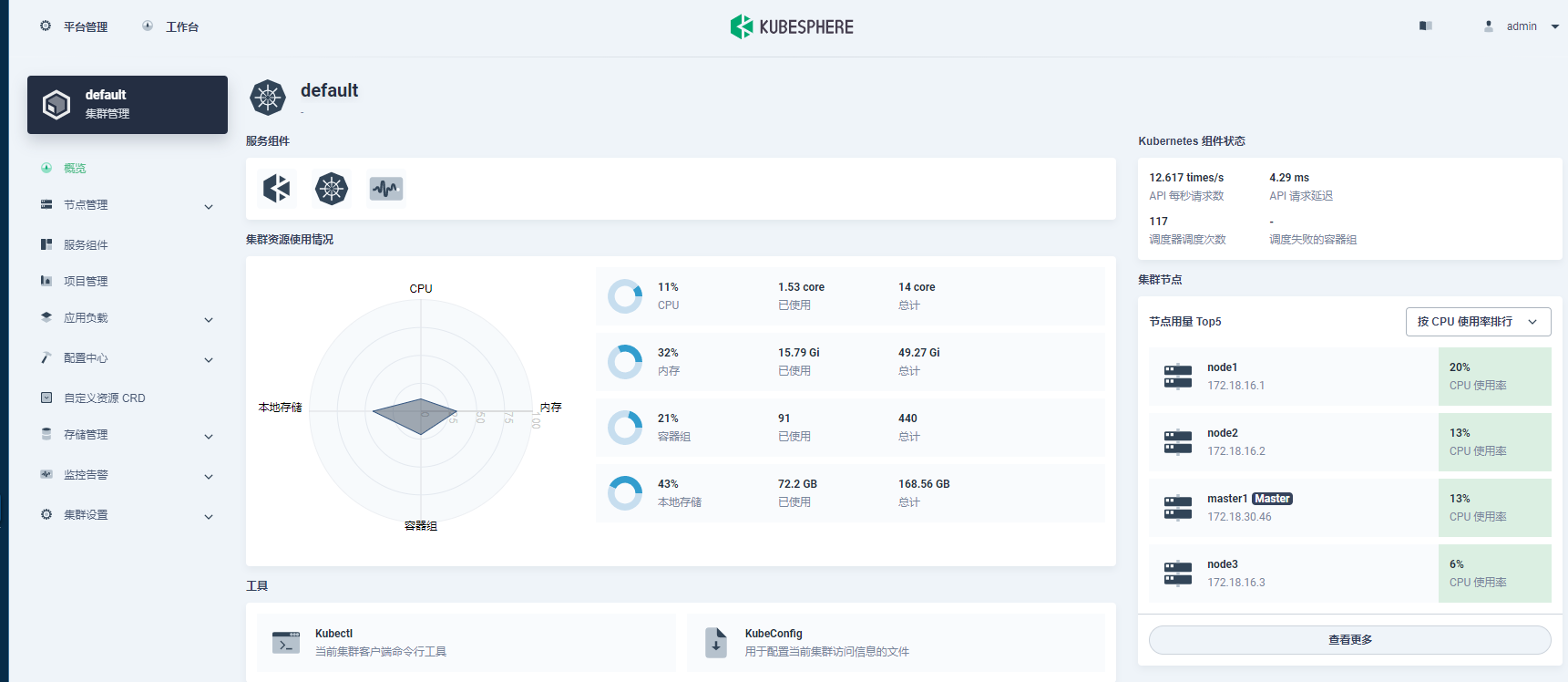

1. 概述

多集群功能涉及到多个集群之间的网络连通,了解集群之前的网络拓扑有助于减少接下来的工作量。

多集群功能需要创建一个 Host Cluster,实际即是一个开启了多集群功能的 KubeSphere 集群,简称 H 集群。H 集群管理的所有集群称之为 Member Cluster,即是一个普通的未开启多集群功能的 KubeSphere 集群,简称 M 集群。H 集群只能有一个,M 集群可以有多个。在多集群架构中,要求 H 集群和 M 集群网络可以直连或者通过代理连通,M 集群之间的网络可以是处在完全隔离的环境中。

2. 直接连接

如果 M 集群 kube-apiserver 地址可以在 H 集群上的任一节点上都能访问,即可以使用直接连接的方式。直接连接方式适用于 M 集群可以暴露 kube-apiserver 地址或者 H 和 M 集群处在同一个私网环境中。

2.1. 安装 Host Cluster 集群

安装 Host Cluster 与安装 KubeSphere 没有大的区别,唯一的区别在于安装时确保 installer 的配置文件 ClusterConfiguration 中 multicluster 项如下配置。

none改成host

multicluster:

clusterRole: host

如果你已经有一个安装好的 KubeSphere 集群,也可以通过修改 cluster configuration 的方式改变集群的角色,然后等待配置生效。

kubectl edit cc ks-installer -n kubesphere-system kubectl logs -n kubesphere-system $(kubectl get pod -n kubesphere-system -l app=ks-install -o jsonpath='{.items[0].metadata.name}') -f

直到显示出

#####################################################

### Welcome to KubeSphere! ###

#####################################################

Console: http://192.168.1.100:30880

Account: admin

Password: P@88w0rd

NOTES:

1. After you log into the console, please check the

monitoring status of service components in

"Cluster Management". If any service is not

ready, please wait patiently until all components

are up and running.

2. Please change the default password after login.

#####################################################

https://kubesphere.io 2022-02-09 15:35:57

#####################################################

2.2. 安装 Member Cluster 集群

为了能够使 host 集群直接管理 member 集群,需要将 member 集群的 jwtSecret 设置与 host 相同。 首先在 host 集群上执行下列命令获取到 host 集群的 jwtSecret。

$ kubectl -n kubesphere-system get cm kubesphere-config -o yaml | grep -v "apiVersion" | grep jwtSecret

jwtSecret: "hFsuNkESfUVBiaP9VdFW1kSPTGvvDOUX"

安装 Member Cluster 和安装普通的未开启多集群功能的集群没有任何区别。确保安装时 installer 的 ClusterConfiguration 中 multicluster 项设置角色,同时填入上面获取的 host 的 jwtSecret。

authentication:

jwtSecret: hFsuNkESfUVBiaP9VdFW1kSPTGvvDOUX multicluster:

clusterRole: member

配置完成后,执行安装。如果你已经有一个安装好的 KubeSphere 集群,也可以通过修改 cluster configuration 的方式改变集群的角色和 jwtSecret,然后等待配置生效。

kubectl edit cc ks-installer -n kubesphere-system kubectl logs -n kubesphere-system $(kubectl get pod -n kubesphere-system -l app=ks-install -o jsonpath='{.items[0].metadata.name}') -f

2.3. 导入集群

打开 H 集群 dashboard,点击添加集群,输入集群基本信息后点击下一步。

连接方式选择

直接连接 KubeSphere 集群, 将 Member 集群的 kubeconfig 内容粘贴到输入框中。确保 kubeconfig 中的server地址在 H 集群中的任一节点都可以访问。KubeSphere API Server地址填写 KubeSphere APIServer 的地址,也可以不填。

[

[点击导入,等待集群初始化完成即可

3. 代理连接

代理连接使用了 KubeSphere 的 Tower 组件,Tower 是一个可以在集群间通过代理方式创建网络连接的工具。如果 H 集群不能直接访问 M 集群,可以通过暴露 H 集群代理服务地址,M 集群通过代理来创建和 H 集群的网络连接。代理连接的方式适用于 M 集群处在非公开的 IDC 机房等私有环境,而 H 集群有能力暴露代理服务的场景。

3.1. 安装 Host Cluster

安装 Host Cluster 与安装 KubeSphere 没有大的区别,唯一的区别在于安装时确保 installer 的配置文件 ClusterConfiguration 中 multicluster 项如下配置 。

multicluster:

clusterRole: host

如果你已经有一个安装好的 KubeSphere 集群,也可以通过修改 cluster configuration 的方式改变集群的角色,然后等待配置生效。

kubectl edit cc ks-installer -n kubesphere-system

设置代理服务地址

Host Cluster 安装成功后,

kubesphere-system项目下会创建一个名称为 tower,type 为 LoadBalancer 的代理服务。如果集群有可以使用的 LoadBalancer 插件,可以看到

EXTERNAL-IP栏目有对应的地址显示,KubeSphere 会自动获取这个地址,我们可以跳过接下来的设置代理的步骤。$ kubectl -n kubesphere-system get svc

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

tower LoadBalancer 10.233.63.191 139.198.110.23 8080:30721/TCP 16h

如果一直没有对应的地址显示,则需要手动设置下代理地址。假设现在有可以对外的公网 IP 地址 139.198.120.120,已经通过端口转发的方式将此 IP 地址的 8080 端口转发到集群节点的 30721 端口 (请根据您具体的端口号转发)。

$ kubectl -n kubesphere-system get svc

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

tower LoadBalancer 10.233.63.191 <pending> 8080:30721/TCP 16h

修改配置文件,填入之前设置的地址

$ kubectl -n kubesphere-system edit clusterconfiguration ks-installer multicluster:

clusterRole: host

proxyPublishAddress: http://139.198.120.120:8080 # 增加这一行,设置 tower 服务的访问地址,填入上面设置的 IP 地址

保存设置,并且重启 ks-apiserver

kubectl -n kubesphere-system rollout restart deployment ks-apiserver

3.2. 安装 Member Cluster

为了能够使 host 集群直接管理 member 集群,需要将 member 集群的 jwtSecret 设置与 host 相同。 在 host 集群上执行下列命令获取到 host 集群的 jwtSecret。

$ kubectl -n kubesphere-system get cm kubesphere-config -o yaml | grep -v "apiVersion" | grep jwtSecret

jwtSecret: "gfIwilcc0WjNGKJ5DLeksf2JKfcLgTZU"

安装 Member Cluster 和安装普通的未开启多集群功能的集群没有任何区别。确保安装时 installer 的 ClusterConfiguration 中 multicluster 项如下配置,同时填入上面获取的 host 的 jwtSecret。

authentication:

jwtSecret: gfIwilcc0WjNGKJ5DLeksf2JKfcLgTZU multicluster:

clusterRole: member

配置完成后,执行安装。如果你已经有一个安装好的 KubeSphere 集群,也可以通过修改 cluster configuration 的方式改变集群的角色和 jwtSecret,然后等待配置生效。

kubectl edit cc ks-installer -n kubesphere-system

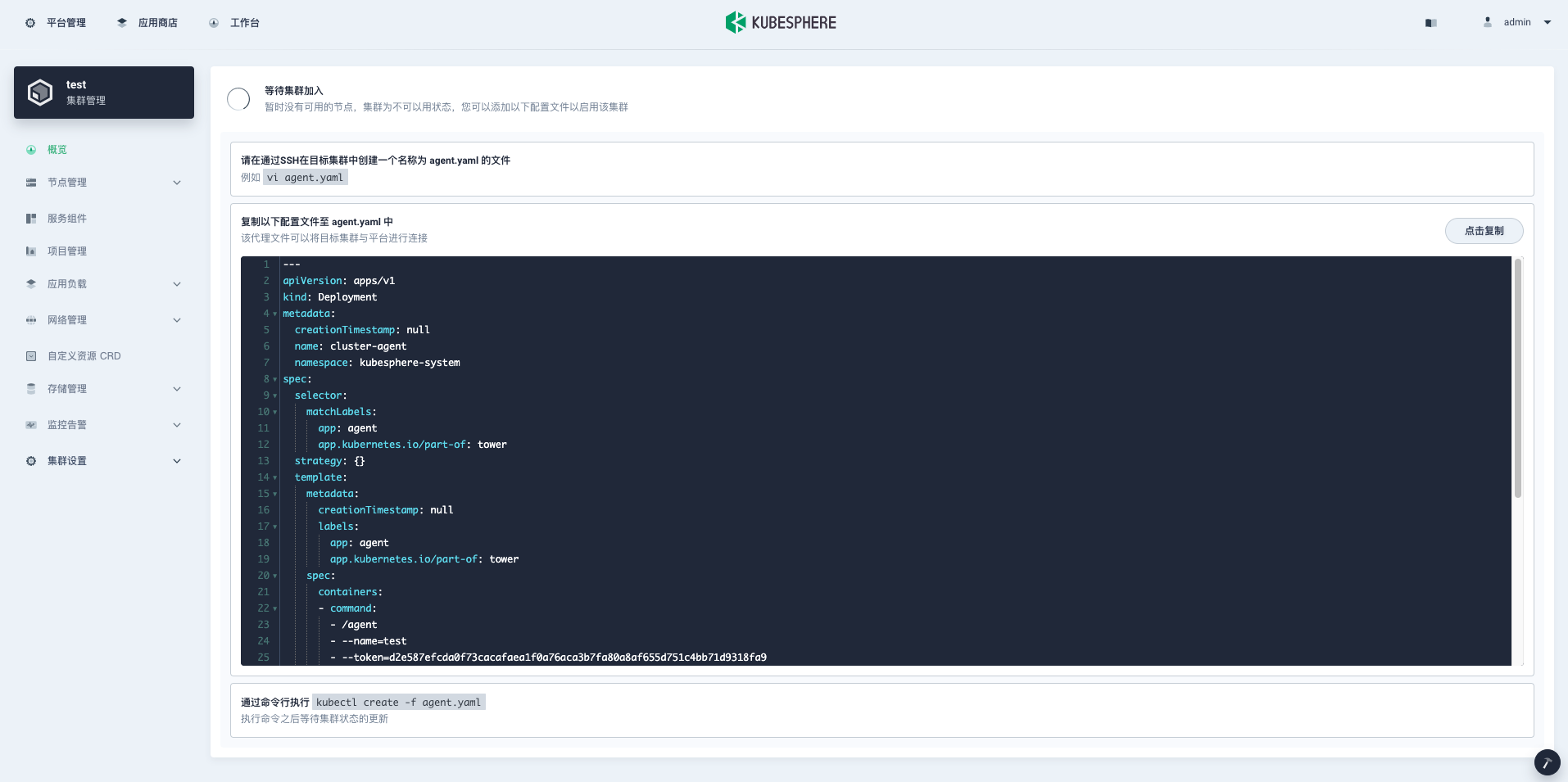

3.3. 导入集群

打开 H 集群 dashboard,点击添加集群,输入集群基本信息后点击下一步。

连接方式选择

集群连接代理,点击导入

根据提示在 M 集群中,创建一个

agent.yaml文件,并将生成的部署粘贴到文件中,在节点上执行kubectl create -f agent.yaml,等待 agent 运行正常。确保 M 集群上可以访问 H 集群的代理地址。

集群代理运行正常后即可在 H 集群上看到导入的集群

kubekey其他命令

添加新节点参考文档: 添加新节点 (kubesphere.io)

本文原创作者:奇想派、一名程序员。

文章首发平台:微信公众号【编程达人】

原创不易!各位小伙伴觉得文章不错的话,不妨关注公众号,进行点赞(在看)、转发三连走起!谢谢大家!

从零搭建云原生技术kubernetes(K8S)环境-通过kubesPhere的AllInOne方式的更多相关文章

- Docker Data Center系列(一)- 快速搭建云原生架构的实践环境

本系列文章演示如何快速搭建一个简单的云原生架构的实践环境. 基于这个基础架构,可以持续部署微服务架构的应用栈,演练敏捷开发过程,提升DevOps实践能力. 1 整体规划 1.1 拓扑架构 1.2 基础 ...

- 网易云通过KCSP认证,云原生技术实力再获认可

近日,网易云通过KCSP认证,正式成为CNCF官方认可的Kubernetes服务提供商,也标志着网易云在云原生领域的技术实力得到了业界认可. Kubernetes是第一个从CNCF毕业的开源项目,凭借 ...

- 《CNCF × Alibaba云原生技术公开课》知识点自测(一):第一堂“云原生”课

(单选)1.容器启动后,我会时常 SSH 进入到容器里然后写很多文件.请问这破坏了云原生理念了吗? A. 否 B. 是 (单选)2.云原生架构必须选型 Kubernetes 方案. A. 否 B ...

- CNCF 旗下首个为中国开发者量身打造的云原生课程,《CNCF x Alibaba 云原生技术公开课》即将上线

伴随着以 Kubernetes 为代表的云原生技术体系的日益成熟以及 CNCF 生态的逐渐壮大,“云原生”已然成为了未来云计算时代里一个当仁不让的关键词.但是,到底什么是“云原生”?云原生与 CNCF ...

- 重磅课程|《CNCF x Alibaba 云原生技术公开课》正式开讲!

到底什么是“云原生”?云原生与 CNCF.Kubernetes 是什么关系?作为云计算时代的开发者和从业者,我们该如何在“云原生”的技术浪潮中站稳脚跟,将云原生落地.实现个人的自我升级呢? 201 ...

- 牛年 dotnet云原生技术趋势

首先祝大家:新年快乐,牛年大吉,牛年发发发! 2020年的春节,新冠疫情使得全球业务停滞不前,那时候,没有人知道会发生什么,因此会议被取消,合同被搁置,项目被推迟,一切似乎都停止了.但是我们却见证了I ...

- 第3届云原生技术实践峰会(CNBPS 2020)重磅开启,“原”力蓄势待发!

CNBPS 2020将在11月19-21日全新启动!作为国内最有影响力的云原生盛会之一,云原生技术实践峰会(CNBPS)至今已举办三届. 在2019年的CNBPS上,灵雀云CTO陈恺喊出"云 ...

- 云原生技术赋能ISV实现应用现代化

日前,由BP商业伙伴主办,中国开源云联盟和云原生应用现代化联盟协办的2021-2022云计算生态峰会成功举办.头部ISV代表.最终用户和云原生技术专家等与会各方围绕"云原生技术赋能ISV&q ...

- 云原生下基于K8S声明式GitOps持续部署工具ArgoCD实战-上

@ 目录 概述 定义 工作原理 主要组件 核心概念 环境准备 概述 安装Kubekey 创建K8S 安装K9S OpenLB 安装ArgoCD 安装 ArgoCD CLI 从Git库中创建一个应用程序 ...

随机推荐

- [CSP-S 2019 Day2]Emiya家今天的饭

思路: 这种题目就考我们首先想到一个性质.这题其实容易想到:超限的菜最多只有一个,再加上这题有容斥那味,就枚举超限的菜然后dp就做完了. 推式子能力还是不行,要看题解. 式子还需要一个优化,就是废除冗 ...

- 秋招如何抱佛脚?2022最新大厂Java面试真题合集(附答案

2022秋招眼看着就要来了,但是离谱的是,很多同学最近才想起来还有秋招这回事,所以纷纷临时抱佛脚,问我有没有什么快速磨枪的方法, 我的回答是:有! 说起来,临阵磨枪没有比背八股文更靠谱的了,很多人对这 ...

- Scalable Multi-Party Private Set-Intersection-解读

本文记录阅读该paper的笔记. 摘要 本文给出两种MPSI协议,采用的是星型拓扑结构,即有一个leader,需要和其他参与者交互.优点是并非所有各方都必须同时在线: (1)能抗半诚实攻击 通信复杂度 ...

- Excel导表工具-开源

功能 支持int.float.bool.string基础类型 支持数组 支持kv 支持枚举 支持unity类型vector3,vector2,color 自动生成csharp类 单个excel中多个s ...

- 【ASP.NET Core】配置应用程序地址的N多种方法

下面又到了老周误人子弟的时间,今天要误大伙的话题是:找找有多少种方法可以设置 ASP.NET Core 应用的地址,即 URL. 精彩马上开始! 1.UseUrls 方法 这是一个扩展方法,参数是可变 ...

- 入坑KeePass(四)KeePass通过坚果云WebDav同步方法

参考博客:什么值得买平台-Keepass+坚果云:多平台密码无缝同步 .1.在坚果云上创建一个同步专用的文件夹(建议勾上"默认不同步到电脑"选项) 创建之后可以把刚才创建的数据库文 ...

- ssh打通

打通ssh https://www.cnblogs.com/yolanda-lee/p/4975453.html

- 19.Tomcat多实例部署及负载均衡、动静分离

Tomcat多实例部署及负载均衡.动静分离 目录 Tomcat多实例部署及负载均衡.动静分离 Tomcat多实例部署 安装jdk 设置jdk环境变量 安装tomcat 配置 tomcat 环境变量 修 ...

- MongoDB 的内存使用限制

本文将简述一下MongoDB的内存限制问题 1. 使用Docker限制 当我们使用docker创建mongo 容器时,可通过使用以下参数,对mongo可以使用的资源进行限制 内存限制 参数 简介 -m ...

- 机械硬盘和ssd固态硬盘的原理对比分析

固态硬盘和机械硬盘的区别 机械硬盘 磁头是不是直接和盘片接触的呢 磁盘中有几个盘片 机械硬盘的工作原理 固态硬盘的寻址方式 SMR叠瓦式真的比PMR优秀吗 固态硬盘 主控芯片 闪存颗粒 缓存单元 固态 ...